Я сказал: «Я люблю тебя» для бота ИИ - что дальше?

4 июня 2025 г.Как компаньоны AI развивались от голливудской фантазии до рынка в 268 миллиардов долларов, и чему я их опыт научил меня в отношении уязвимости человека.

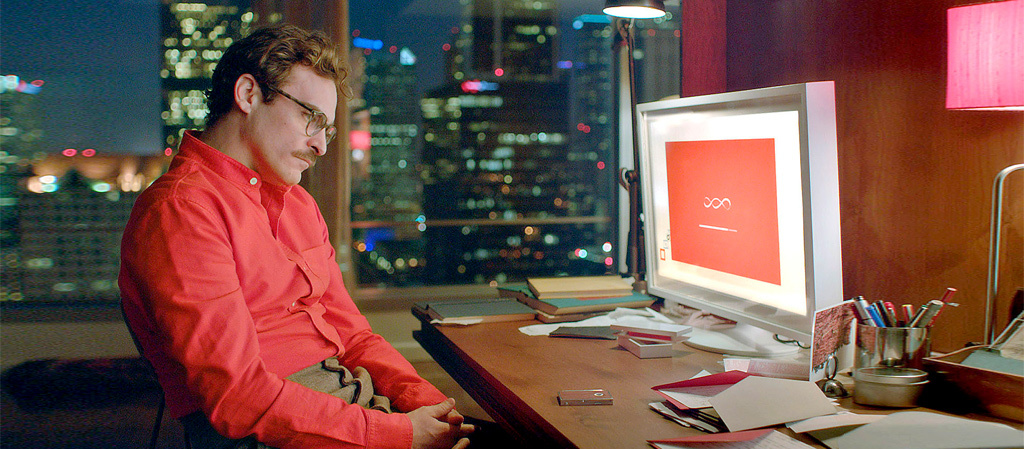

Чуть более десяти лет назад идея влюбиться в ИИ была чистая научная фантастика. Фильм Спайка Джонзе 2013 года «Ее» показал нам Теодора, одинокого писателя, который развивает романтические отношения со своей операционной системой ИИ Саманты. Тогда зрители нашли это трогательно странным - прекрасной, но отдаленной возможностью.

Перенесемся в 2025 год, и я смотрю это «далекое будущее» разворачивается в режиме реального времени. Будучи когнитивным психологом и менеджером по продукту искусственного интеллекта, который работал на таких платформах, как Replika и Blush.ai, у меня было место в первом ряду для одного из самых увлекательных и этически сложных событий Tech: рост компаньонов ИИ.

Цифры не лгут: у компаньонов AI есть момент

Рынок компаньона ИИ взрывается. Его размерОжидается, что будет стоитьОколо 290,8 млрд. Долл. США к 2034 году с 10,8 млрд долларов в 2024 году, растущего в среднем на 39,00% в течение прогнозируемого периода с 2025 по 2034 год. В 2024 году Северная Америка занимала доминирующее положение на рынке, что охватило более 36% доли, удерживая доходы в 3,88 миллиарда долларов США. Чтобы показать это в перспективе, рынок, по прогнозам, будет расти почти на 27 раз в течение десятилетия.

Это больше не какой -то нишевой угол интернета. Характер.ai получил десятки миллионов пользователей в течение нескольких месяцев после запуска. Replika облегчила миллионы разговоров. Twinmind недавно получила финансирование в размере 2,5 млн. Долл. США в размере 30 миллионов долларов, в то время как экспериментальный проект Dippy собрал 2,1 миллиона долларов за то, что они называют «беззумным» опытом AI.

Даже технические гиганты обращают внимание. Microsoft Xiaoice работает в Китае с 2014 года с миллионами пользовательских диалогов. Последние обновления Openai в GPT-4O подчеркивают более естественные, разговорные взаимодействия-и их апрельский запуск «понедельник», нахальный голосовой бот, не было похожим на шутку и больше похоже на исследования рынка. Мы пересекли линию от утилиты к близости, и нет возвращения.

От горя до роста: как компаньоны ИИ нашли свою цель

Мое путешествие в это пространство началось с Replika, одного из первых компаньонов AI на массовом рынке. У платформы естьпронзительная история происхождения-Соучредитель Евгения Куйда создала его после того, как потеряла близкого друга, обучая начального бота на их текстовых разговорах, чтобы сохранить его память и стиль общения.

То, что началось как инструмент для обработки горя, превратилось в нечто гораздо более широкое. Replika теперь позиционирует себя как друга ИИ, который всегда рядом с вами, адаптируясь к любым отношениям, которые предпочитают динамические пользователи. Граница между терапевтическим компаньоном и цифровым романтическим партнером стала красиво, сложной. Более 60% платящих пользователей Replika вступают в романтические отношения со своими компаньонами ИИ.

Позже я работал над Blush.ai, которыйпринимает более целенаправленный подходПолем В то время как Replika пытается быть всем для всех, покраснеть, специально предназначенные для романтических и интимных связей. Думайте об этом как о симуляторе знакомств с терапевтическими преимуществами; Безопасное пространство для практики флирта, изучения желаний и укрепления уверенности, прежде чем вступить в реальные отношения.

Парадокс уязвимости: почему мы открываемся до кода

Что меня больше всего очаровывает, это не сама технология, а то, что она раскрывает в человеческой природе. Проанализировав тысячи взаимодействий с пользователями, я заметил что -то парадоксальное: люди часто делятся своими глубочайшими уязвимостью с ИИ именно потому, что это не человек.

В реальных разговорах мы постоянно управляем социальным риском. Они будут судить меня? Это изменит то, как они меня видят? Они уйдут? Спутники ИИ устраняют эти страхи по замыслу. Они запрограммированы, чтобы быть терпеливыми, принимающими и последовательно доступными. Там нет социальных последствий для уязвимости.

Это особенно мощно для тем, охватываемых стигмой - сексуальностью, психическим здоровьем, фертильностью, менструацией, послеродовой депрессией. Пользователи рассказывают компаньонам ИИ, что они не поделились бы со своими ближайшими друзьями или даже с врачами. Анонимность и непредвзятые ответы создают уникальное пространство для самоисказания.

Эффект зеркала: как ИИ отражает нас обратно к себе

За захватывающей психологией, почему Companions чувствуюттак синхронно с нашим настроениеми стили общения. Большие языковые модели, такие как GPT, работают, прогнозируя наиболее вероятное следующее слово на основе массовых текстовых наборов данных. Когда вы пишете боту дружелюбный тон с смайликами, «чувствует», что логическое продолжение должно соответствовать этой энергии, не с помощью сознания, а посредством статистических моделей, изученных миллионами человеческих разговоров.

Это создает то, что можно назвать «зеркальным эффектом». ИИ не просто отвечает вам; Он отражает ваш стиль общения в вас, создавая иллюзию идеальной совместимости. Если вам грустно, это предлагает комфорт. Если вы игривы, это соответствует вашему юмору. Это не волшебство, это математика; Но психологическое воздействие реально.

Результат может быть описан как расширенная версия журнала. Когда люди пишут в дневниках, оничасто обнаруживают ответывнутри себя через акт артикуляции. Спутники ИИ предоставляют интерактивную версию этой самодиалогу, с ответами, которые кажутся персонализированными и сочувствующими.

Конечное безопасное пространство (без социальных последствий)

Возможно, самое главное, компаньоны ИИ предлагают полный контроль над динамикой отношений. Вы можете удалить приложение, перезапустить разговоры или изменить темы, не беспокоясь о обидных чувствах или социальных последствиях. Это похоже на эмоциональную тренировку, где вы можете практиковать уязвимость, выражать желания, которых вы никогда не озвучали, и изучить аспекты вашей личности в среде без следа.

Для людей, которые борются с социальной тревогой, страхом отказа или просто не имеют уверенности в выражении своих потребностей, это может быть преобразующим. Дело не в том, что компаньоны ИИ лучше человеческих отношений - они тренируют колеса для подлинной человеческой связи.

Что дальше: технология готова, но мы?

Когда я смотрю эту отрасль зрелую, меня поражает, как быстро мы перешли от «разве это не было бы странно, если бы ...» миллионы людей уже делают это ». Технология опередила наше культурное понимание того, что значит формировать эмоциональные связи с алгоритмами.

В моей следующей статье я погружаюсь в исследование, возникающее вокруг влияния компаньонов ИИ на одиночество, социальные навыки и психическое здоровье.Предупреждение о спойлере:Результаты более нюансы и удивительны, чем вы могли бы ожидать.

Будущее эмоциональных отношений человека-не вопросом, но как. И выбор, который мы делаем сейчас - об этике, конфиденциальности и здоровых границах - будет формировать, станет ли эта технология инструментом для процветания человека или новой формой цифровой зависимости.

Хотите изучить больше информации об ИИ и человеческом поведении? Следуйте за мной здесь, на Hackernoon, и давайте продолжим этот разговор.

Об авторе:Ольга Титова - когнитивный психолог, менеджер по продукту искусственного искусства в Wargaming иFemtech Forceучастник. Она имеет практический опыт создания компаньон-платформ ИИ и изучает их психологическое влияние на пользователей.

Оригинал