Начнем изучать Большие языковые модели посредством этих 479 бесплатных статей. Они расположены в порядке данных по взаимодействию читателей HackerNoon. Посетите Learn Repo или LearnRepo.com, чтобы найти самые читаемые статьи о любой технологии.

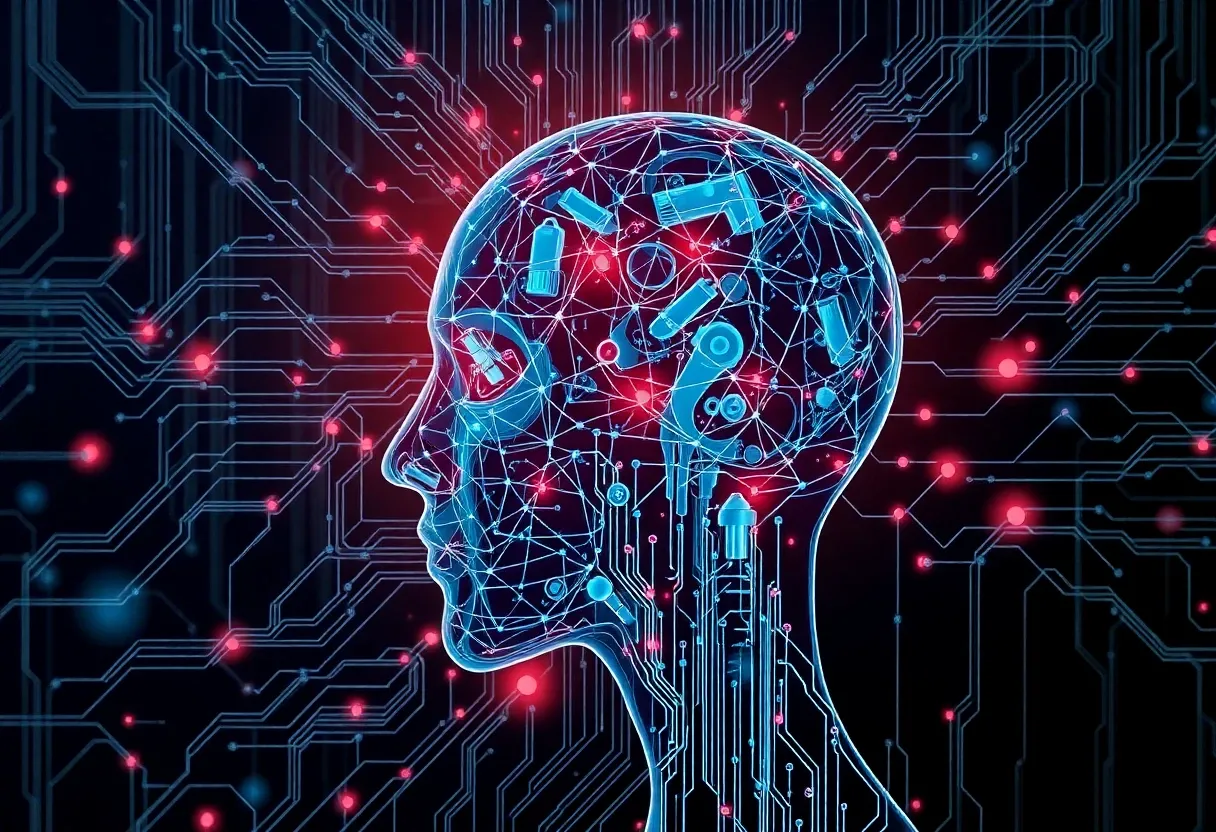

Большие языковые модели (LLMs) — это модели AI, обученные на огромных наборах текста для понимания, генерации и перевода текста, подобного человеческому, что позволяет создавать сложные приложения для естественного языка. Они критически важны для прогресса в AI-ассистентах, создании контента и интеллектуальной автоматизации.

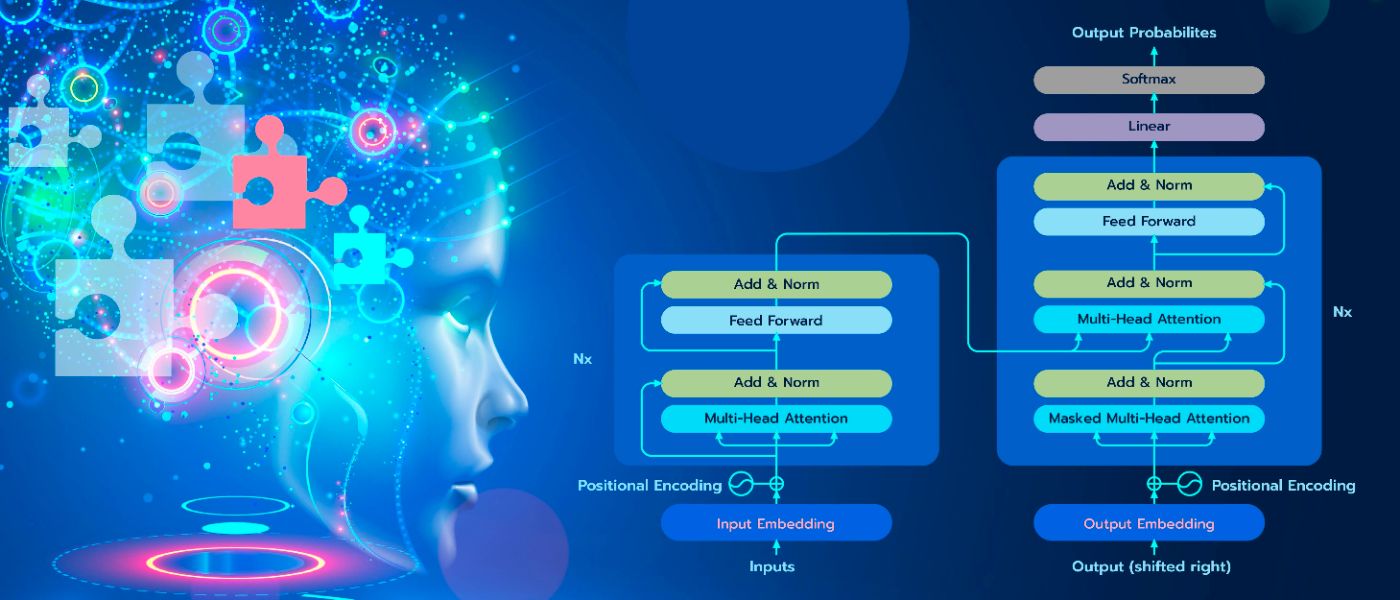

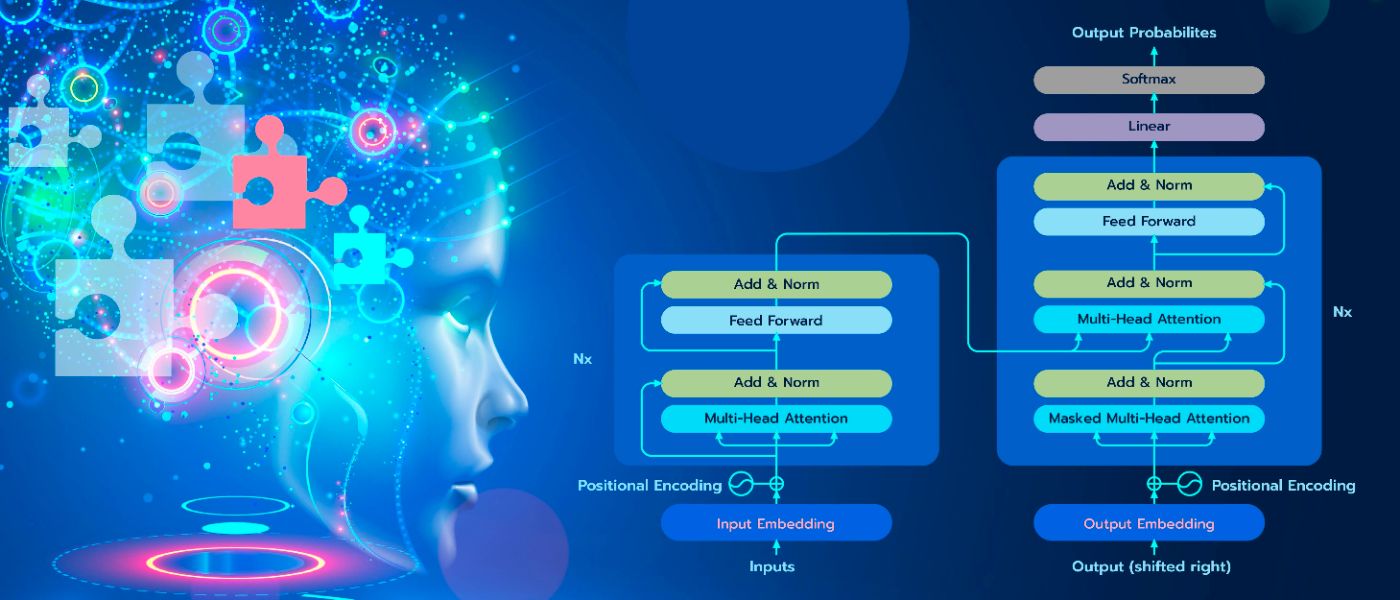

1. Почему GPT лучше, чем BERT? Подробный обзор архитектуры Transformer

Подробности архитектуры Transformer, иллюстрированные моделями BERT и GPT

Подробности архитектуры Transformer, иллюстрированные моделями BERT и GPT

2. Open-Source: следующий шаг в революции AI

Обратите внимание на революцию open-source в развитии AI, различая настоящую инновацию и попытки 'open-washing' со стороны Big Tech.

Обратите внимание на революцию open-source в развитии AI, различая настоящую инновацию и попытки 'open-washing' со стороны Big Tech.

3. Расшифровка превосходства Transformer над RNN в задачах NLP

Обратите внимание на увлекательный путь от Рекуррентных нейронных сетей (RNN) к Transformer в мире обработки естественного языка в нашей последней статье: 'The Trans

Обратите внимание на увлекательный путь от Рекуррентных нейронных сетей (RNN) к Transformer в мире обработки естественного языка в нашей последней статье: 'The Trans

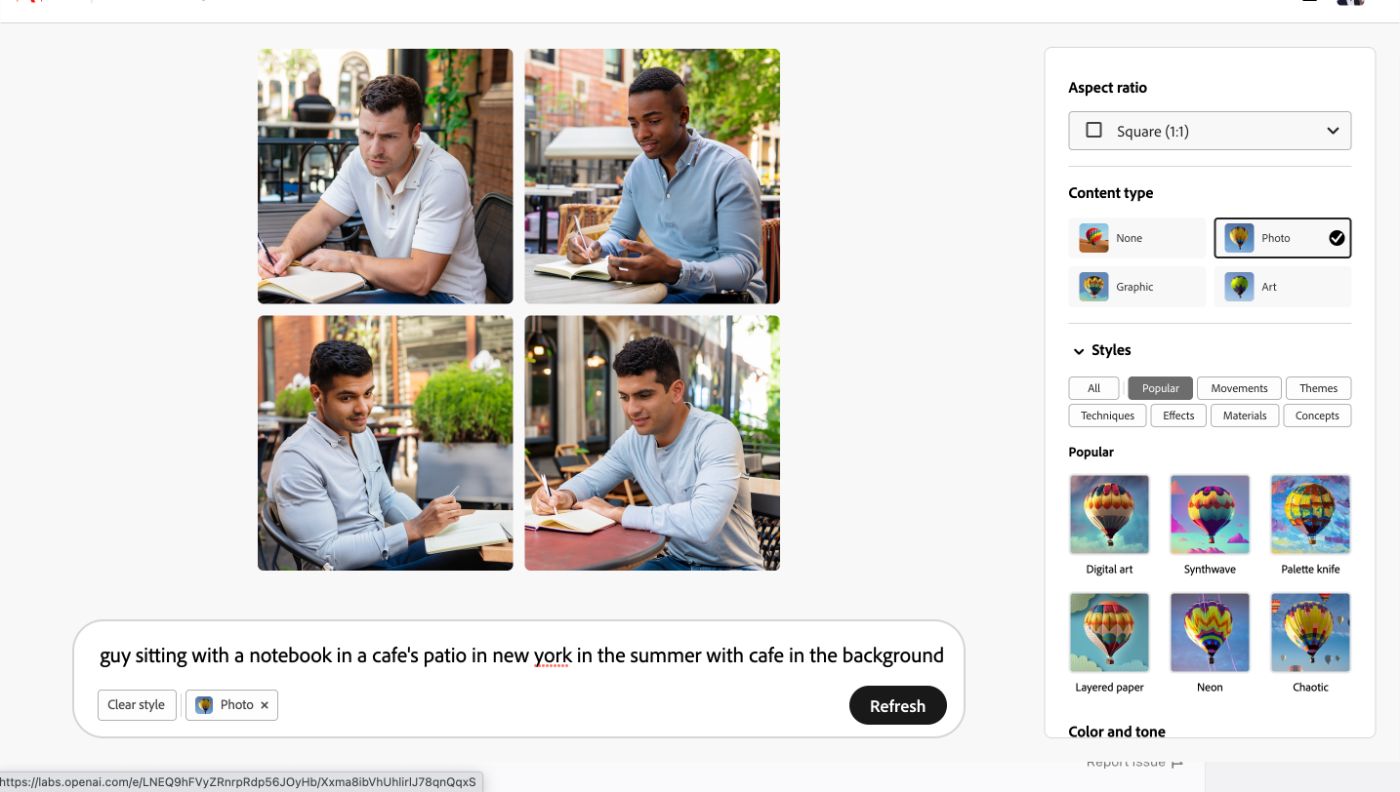

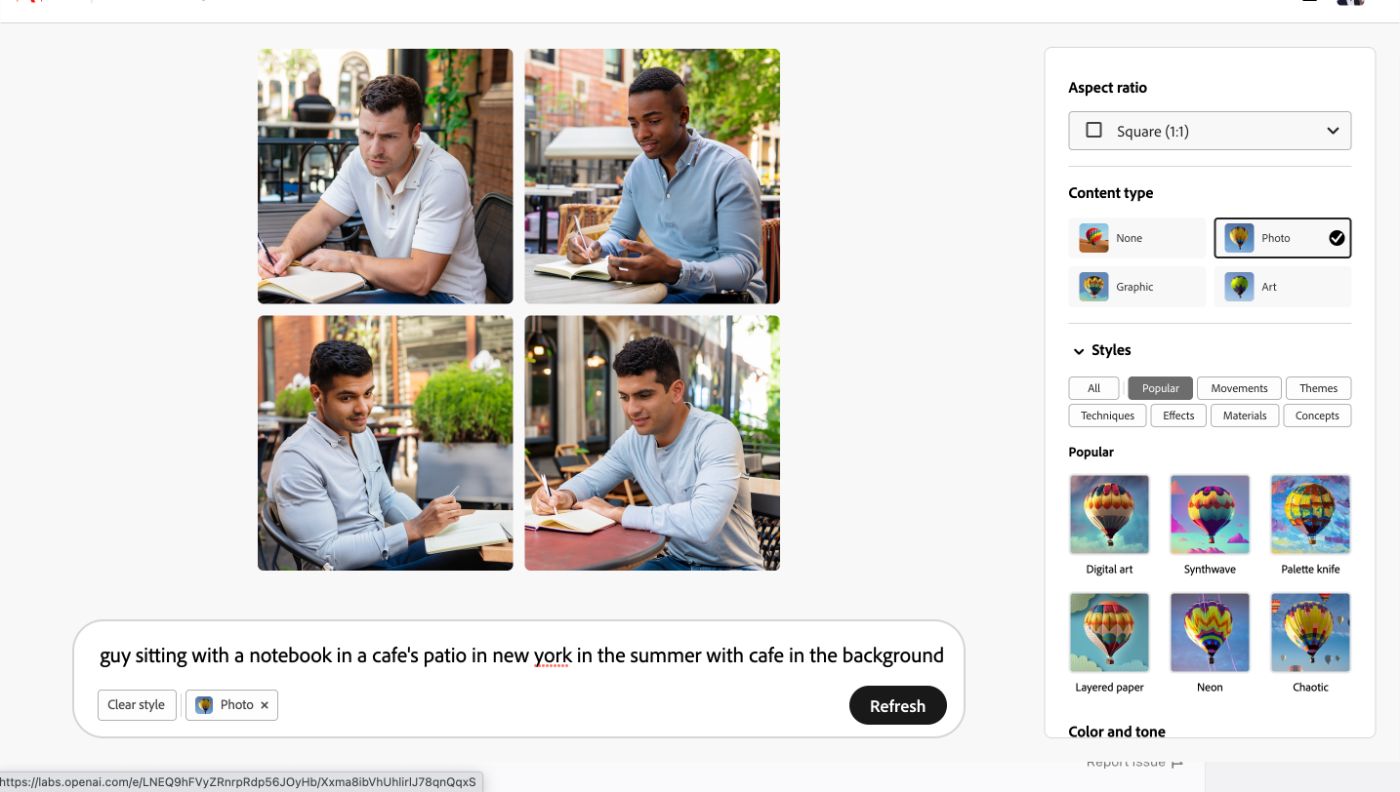

4. Какие лучшие бесплатные AI-генераторы искусства 2023 года?

Генеративные AI сделали значительные шаги в последние несколько месяцев, и генеративные модели AI стали более популярными.

Генеративные AI сделали значительные шаги в последние несколько месяцев, и генеративные модели AI стали более популярными.

5. Как использовать Ollama: Ручная работа с локальными LLM и созданием чат-бота

В пространстве локальных LLM я встретил LMStudio. Хотя сама приложение проста в использовании, я любил простоту и маневренность, которые предоставляет Ollama.

В пространстве локальных LLM я встретил LMStudio. Хотя сама приложение проста в использовании, я любил простоту и маневренность, которые предоставляет Ollama.

6. Практическое руководство по 5 шагам для выполнения семантического поиска на вашей частной информации с помощью LLM

LLMs В этой практической гайде я покажу вам 5 простых шагов для реализации семантического поиска с помощью LangChain, векторных баз данных и больших языковых моделей.

В этой практической гайде я покажу вам 5 простых шагов для реализации семантического поиска с помощью LangChain, векторных баз данных и больших языковых моделей.

7. Полное руководство по тонкой настройке для конкретных задач

Большие языковые модели (LLMs) типа GPT, BERT и RoBERTa изменили отрасли, но их истинный потенциал заключается в тонкой настройке для специализированных задач.

Большие языковые модели (LLMs) типа GPT, BERT и RoBERTa изменили отрасли, но их истинный потенциал заключается в тонкой настройке для специализированных задач.

8. Gptrim: Сократите размер вашего GPT-промта на 50% Бесплатно!

Введение gptrim – бесплатного веб-приложения, которое сократит размер вашего промта на 40-60% при сохранении большинства исходной информации для обработки GPT.

Введение gptrim – бесплатного веб-приложения, которое сократит размер вашего промта на 40-60% при сохранении большинства исходной информации для обработки GPT.

9. Руководство для экономных людей по тонкой настройке LLaMA-2 и запуску его на вашем ноутбуке

Поскольку сейчас все бедны на GPU, моя миссия – тонко настроить модель LLaMA-2 с одним GPU и запустить ее на моем ноутбуке

Поскольку сейчас все бедны на GPU, моя миссия – тонко настроить модель LLaMA-2 с одним GPU и запустить ее на моем ноутбуке

10. Вызовы, затраты и рассмотрения при создании или тонкой настройке LLM

Дорога к созданию или тонкой настройке LLM для вашей компании может быть сложной. Вам нужна гайд для начала.

Дорога к созданию или тонкой настройке LLM для вашей компании может быть сложной. Вам нужна гайд для начала.

11. Hallucinations by Design: Часть 4 – Тонкая настройка для выхода из ночных кошмаров векторных данных

Узнайте, как тонко настроить модели векторных данных для исключения галлюцинаций в системах AI. Повысьте свои RAG-системы и семантический поиск с помощью этих проверенных методов.

Узнайте, как тонко настроить модели векторных данных для исключения галлюцинаций в системах AI. Повысьте свои RAG-системы и семантический поиск с помощью этих проверенных методов.

12. Анализ плюсов, минусов и рисков LLM

LLMs не могут думать, понимать или рассуждать. Это фундаментальная ограниченность LLM.

LLMs не могут думать, понимать или рассуждать. Это фундаментальная ограниченность LLM.

13. Сделайте LLM для текстового резюме снова великим

В последние месяцы LLM стали популярными и теперь широко используются в различных приложениях. Сбор данных необходим для создания этих моделей, и

В последние месяцы LLM стали популярными и теперь широко используются в различных приложениях. Сбор данных необходим для создания этих моделей, и

crowd

14. Эра следующая AI: внутри прорывной модели GPT-4

GPT-4 представляет собой скачок вперед в возможности больших языковых моделей. Он строится на архитектуре и сильных сторонах GPT-3, достигая новых уровней масштаба.

GPT-4 представляет собой скачок вперед в возможности больших языковых моделей. Он строится на архитектуре и сильных сторонах GPT-3, достигая новых уровней масштаба.

15. Революционный потенциал 1-битовых языковых моделей (LLMs)

Революционный потенциал 1-битовых языковых моделей

Революционный потенциал 1-битовых языковых моделей

16. Конкурс AI по написанию текстов, проводимый Gadfly AI

Gadfly AI и HackerNoon с нетерпением ждут возможности представить нашу сообщество AI конкурс «Будущее AI» в августе для Cyberscape Zine.

Gadfly AI и HackerNoon с нетерпением ждут возможности представить нашу сообщество AI конкурс «Будущее AI» в августе для Cyberscape Zine.

17. Как сделать любую LLM более точной с помощью только нескольких строк кода

Обзор использования открытой пакетной системы Cleanlab для автоматического повышения точности LLM с помощью нескольких строк кода.

Обзор использования открытой пакетной системы Cleanlab для автоматического повышения точности LLM с помощью нескольких строк кода.

18. Как построить приложение для суммирования веб-страниц с помощью Next.js, OpenAI, LangChain и Supabase

Приложение, способное понять контекст любой веб-страницы. Мы покажем вам, как создать полезное веб-приложение, способное суммировать содержание любой веб-страницы

Приложение, способное понять контекст любой веб-страницы. Мы покажем вам, как создать полезное веб-приложение, способное суммировать содержание любой веб-страницы

19. Анализ настроений и AI: все, что нужно знать в 2025 году

Узнайте, как AI-подобранные инструменты анализа настроений обеспечивают точные выводы из отзывов и обратной связи клиентов, чтобы помочь улучшить вашу бизнес-стратегию.

Узнайте, как AI-подобранные инструменты анализа настроений обеспечивают точные выводы из отзывов и обратной связи клиентов, чтобы помочь улучшить вашу бизнес-стратегию.

20. Анализ распространенных уязвимостей, введенных код-генеративной AI

Автоматически сгенерированный код не может быть доверен безоговорочно, и все еще требует проверки на безопасность, чтобы избежать внедрения программных уязвимостей.

Автоматически сгенерированный код не может быть доверен безоговорочно, и все еще требует проверки на безопасность, чтобы избежать внедрения программных уязвимостей.

21. ChatSQL:Включение ChatGPT в Генерацию SQL-Запросов из Плоского Текста

ChatGPT был выпущен в июне 2020 года, что было разработано OpenAI. Это привело к революционным достижениям в многих областях. Одной из этих областей является создание

ChatGPT был выпущен в июне 2020 года, что было разработано OpenAI. Это привело к революционным достижениям в многих областях. Одной из этих областей является создание

22. Анализ 5 Использований Векторного Поиска от Основных Технологических Компаний

Глубокое изучение 5 ранних сторонников векторного поиска - Pinterest, Spotify, eBay, Airbnb и Doordash - которые интегрировали AI в свои приложения.

Глубокое изучение 5 ранних сторонников векторного поиска - Pinterest, Spotify, eBay, Airbnb и Doordash - которые интегрировали AI в свои приложения.

23. Как Запустить Собственный Локальный LLM: Обновленная Версия для 2024 года - Версия 2

Расширение статьи, которая получила большую популярность - Не 7, а 15 открытых инструментов в общей сложности для запуска локальных LLM на вашем собственном компьютере!

Расширение статьи, которая получила большую популярность - Не 7, а 15 открытых инструментов в общей сложности для запуска локальных LLM на вашем собственном компьютере!

24. AI Не Заменит Вас, Но Человек, Использующий AI

"В мире, где воздействие AI на работу неоспоримо, эта вдумчивая экспертиза раскрыла, как AI служит как катализатор, так и оружие, преобразующее отрасли

"В мире, где воздействие AI на работу неоспоримо, эта вдумчивая экспертиза раскрыла, как AI служит как катализатор, так и оружие, преобразующее отрасли

25. 🎬 Введение MetaGPT: Разжигание Сил AI-Агентов для Комплексных Задач

Представьте себе, что у вас есть в распоряжении AI-поддерживающий ассистент, который не только понимает ваши запросы, но и может также бесшовно взаимодействовать с различными приложениями.

Представьте себе, что у вас есть в распоряжении AI-поддерживающий ассистент, который не только понимает ваши запросы, но и может также бесшовно взаимодействовать с различными приложениями.

26. Иллюзии по Дизайну - (Часть 3): Доверие Векторам Без Тестируемости

Внедрение и LLM необходимо проверять и оценивать или произойдут иллюзии. Экспериментация и оценка на персонализированной информации обязательны - openai и genai

Внедрение и LLM необходимо проверять и оценивать или произойдут иллюзии. Экспериментация и оценка на персонализированной информации обязательны - openai и genai

27. Почему Издательская Индустрия Книг Тревожится перед AI

AI не все плохо, но она потенциально может разрушить издательскую индустрию. Существуют ли обоснованные опасения издателей перед AI или нет?

AI не все плохо, но она потенциально может разрушить издательскую индустрию. Существуют ли обоснованные опасения издателей перед AI или нет?

28. Без Кодирования: 5 Удивительных Использований GPT-4

Что можно фактически сделать с помощью GPT-4?

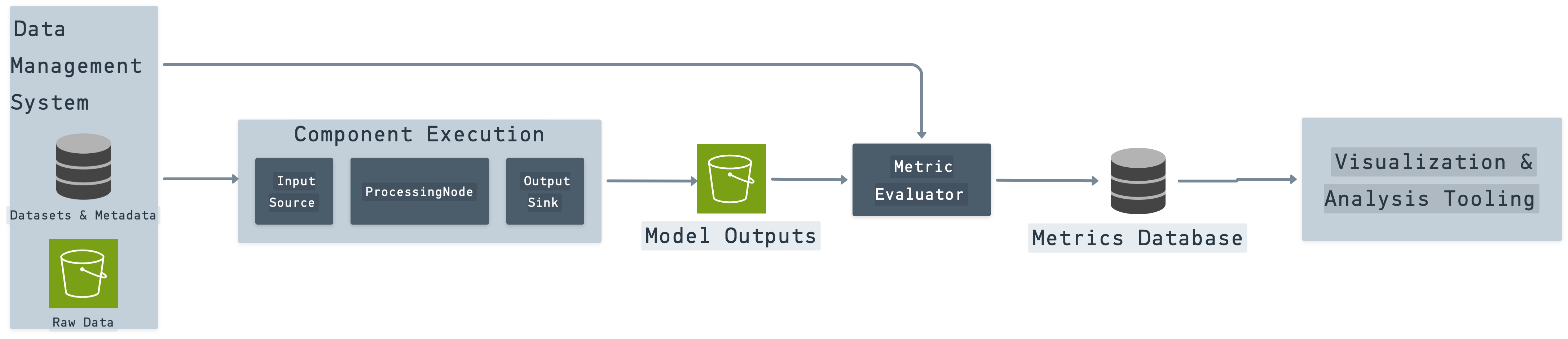

29. AI Shouldn’t Have to Waste Time Reinventing ETL

В этой статье описываются проблемы перемещения данных для AI, необходимость создания и загрузки потоков и преимуществ использования существующих решений.

В этой статье описываются проблемы перемещения данных для AI, необходимость создания и загрузки потоков и преимуществ использования существующих решений.

30. Dissecting the Research Behind BadGPT-4o, a Model That Removes Guardrails from GPT Models

Вступайте в BadGPT-4o: модель, у которой были сняты меры безопасности, не через прямое взвешивание (как с открытым весом «Badllama»).

Вступайте в BadGPT-4o: модель, у которой были сняты меры безопасности, не через прямое взвешивание (как с открытым весом «Badllama»).

31. AutoGPT — LangChain — Deep Lake — MetaGPT: Building the Ultimate LLM App

Каково будущее технологии LLM? Как мы можем преобразовать сегодняшние LLM в автоматизированных агентов, действующих как люди? Вы найдете ответ в этой статье!

Каково будущее технологии LLM? Как мы можем преобразовать сегодняшние LLM в автоматизированных агентов, действующих как люди? Вы найдете ответ в этой статье!

32. PrivateGPT: ChatGPT but Private and Compliant

Конфиденциальность является главной проблемой при обсуждении инструментов, подобных ChatGPT, с профессионалами.

Конфиденциальность является главной проблемой при обсуждении инструментов, подобных ChatGPT, с профессионалами.

33. Bard and ChatGPT — A Head To Head Comparison

Сравнение обеих больших языковых моделей рядом и объяснение, какая из них лучше.

Сравнение обеих больших языковых моделей рядом и объяснение, какая из них лучше.

34. GPT-LLM Trainer: Enabling Task-Specific LLM Training with a Single Sentence

Переворачивайте обучение моделей AI с помощью gpt-llm-trainer: ваше уникальное решение для беспроблемного и высокоэффективного обучения. Прощай, сложности, привет, инновации!

Переворачивайте обучение моделей AI с помощью gpt-llm-trainer: ваше уникальное решение для беспроблемного и высокоэффективного обучения. Прощай, сложности, привет, инновации!

35. 10 Tips to Take Your ChatGPT Prompts to the Next Level

Максимизируйте опыт ChatGPT с помощью 10 профессиональных советов по созданию точных запросов и вопросов, повышению качества взаимодействия.

Максимизируйте опыт ChatGPT с помощью 10 профессиональных советов по созданию точных запросов и вопросов, повышению качества взаимодействия.

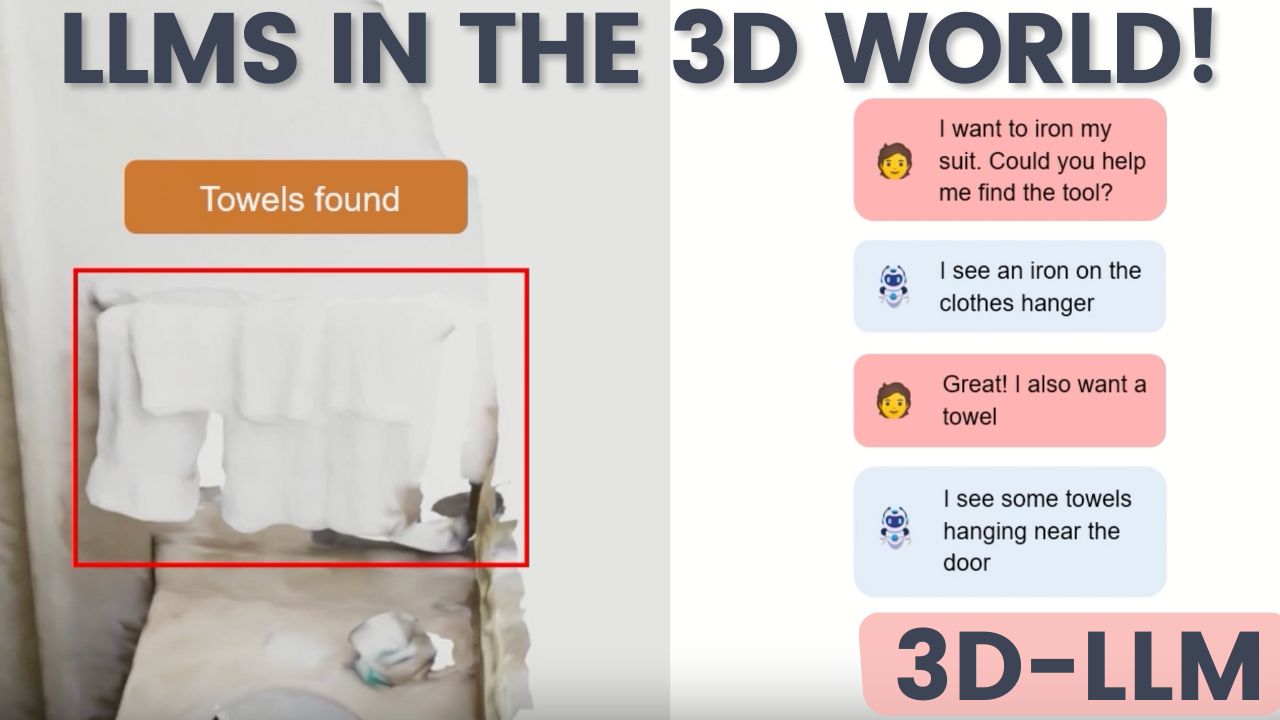

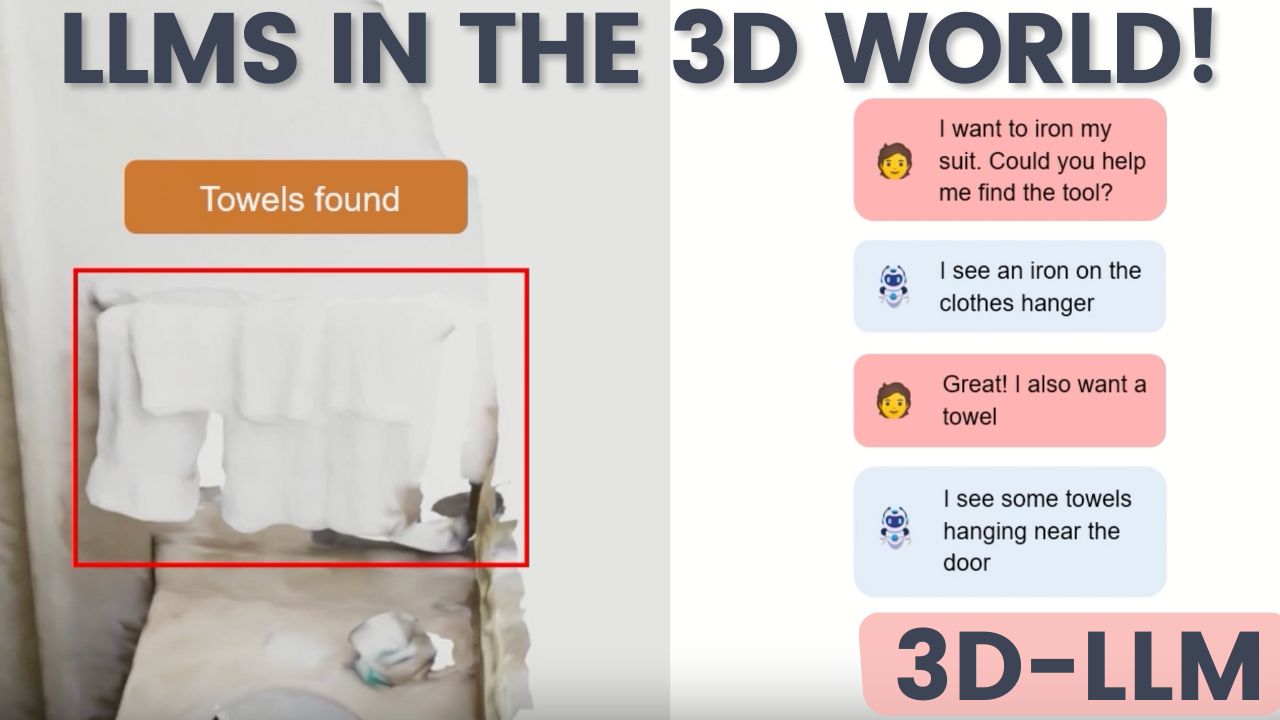

36. Больший шаг для AI: 3D-LLM освобождает языковые модели в 3D-мире

3D-LLM - это новая модель, которая соединяет язык и наш 3D-мир.

3D-LLM - это новая модель, которая соединяет язык и наш 3D-мир.

37. Оценка TnT-LLM по текстовой классификации: человеческое согласие и масштабируемые метрики LLM

Мы оцениваем текстовую классификацию TnT-LLM с помощью человеческого согласия и масштабируемых метрик LLM для точности и производительности на больших масштабах.

Мы оцениваем текстовую классификацию TnT-LLM с помощью человеческого согласия и масштабируемых метрик LLM для точности и производительности на больших масштабах.

38. Я был готов вернуть DGX Spark. Затем обновление NVIDIA в январе изменило все.

Я почти вернул $4,000 DGX Spark. Затем NVIDIA выпустила 30 наборов, 2,5-кратное увеличение производительности и гибридную маршрутизацию.

Я почти вернул $4,000 DGX Spark. Затем NVIDIA выпустила 30 наборов, 2,5-кратное увеличение производительности и гибридную маршрутизацию.

39. Может ли быть остановлено галлюцинации AI? Просмотр трех способов сделать это.

Обследование трех методов, чтобы остановить LLM от галлюцинаций: Retrieval-augmented generation (RAG), рассуждения и итеративное запросы.

Обследование трех методов, чтобы остановить LLM от галлюцинаций: Retrieval-augmented generation (RAG), рассуждения и итеративное запросы.

40. TnT-LLM: Представление шаблонов запросов

В этой части мы представляем шаблоны запросов, которые использовались для суммирования разговора, присвоения меток и генерации, обновления и проверки таксономии.

В этой части мы представляем шаблоны запросов, которые использовались для суммирования разговора, присвоения меток и генерации, обновления и проверки таксономии.

41. AI для управления знаниями: Итерация RAG с архитектурой QE-RAG

Мы итерируем популярную архитектуру LLM, чтобы построить более эффективную систему AI для управления знаниями.

Мы итерируем популярную архитектуру LLM, чтобы построить более эффективную систему AI для управления знаниями.

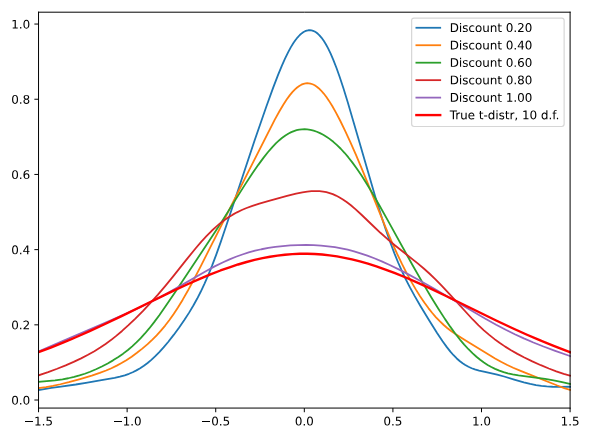

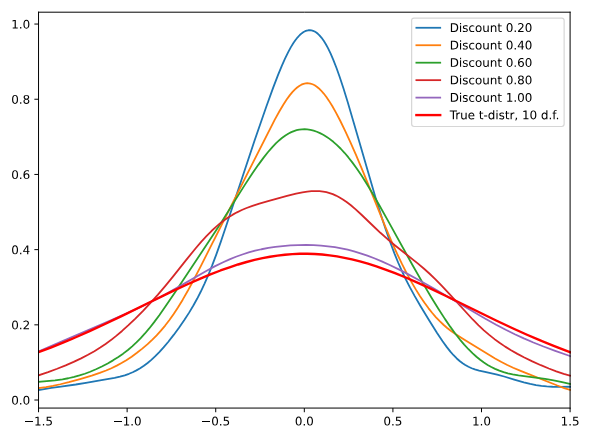

42. Сделать LLM эффективными: Сокращение использования памяти без нарушения качества

Оптимальные компромиссы между памятью и качеством для эффективных языковых моделей.

Оптимальные компромиссы между памятью и качеством для эффективных языковых моделей.

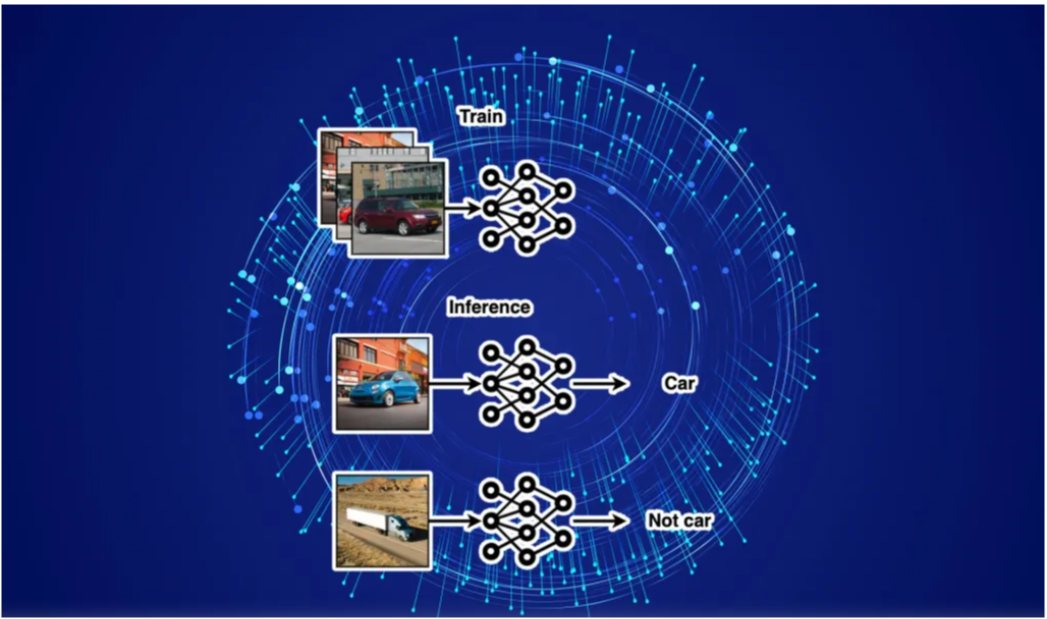

43. Примечание к большой языковой модели LLM: оптимизация инференции 1. Фон и формулировка проблемы

43. Primer на большую языковую модель (LLM) инференса оптимизаций: 1. Background и Problem Formulation

43. Primer на большую языковую модель (LLM) инференса оптимизаций: 1. Background и Problem Formulation

Обзор большая языковая модель (LLM) инференса, его важность, проблемы и ключевая Problem Formulation.

Обзор большая языковая модель (LLM) инференса, его важность, проблемы и ключевая Problem Formulation.

44. Что такое LlamaIndex? Общая эксплуатация LLM-оркестрационных Frameworks

В этой статье мы объясним, как LlamaIndex можно использовать в качестве Framework для интеграции данных, организации данных и извлечения данных для приватных данных Gen AI требует.

В этой статье мы объясним, как LlamaIndex можно использовать в качестве Framework для интеграции данных, организации данных и извлечения данных для приватных данных Gen AI требует.

45. Текущее состояние GPT4All

Сегодня GPT4All фокусируется на улучшении доступности открытых языковых моделей.

Сегодня GPT4All фокусируется на улучшении доступности открытых языковых моделей.

46. Подробный обзор, как работает AI-детекторы

Интересно узнать, как работает AI-детекторы? Ну, вы в luck. Я постараюсь объяснить это как можно проще, чтобы любой мог понять.

Интересно узнать, как работает AI-детекторы? Ну, вы в luck. Я постараюсь объяснить это как можно проще, чтобы любой мог понять.

47. Масштабирующие законы в большую языковую модель

Изучите масштабирующие законы в AI, которые показывают, как модельная производительность улучшается с увеличением модели, данных и вычислительной мощности.

Изучите масштабирующие законы в AI, которые показывают, как модельная производительность улучшается с увеличением модели, данных и вычислительной мощности.

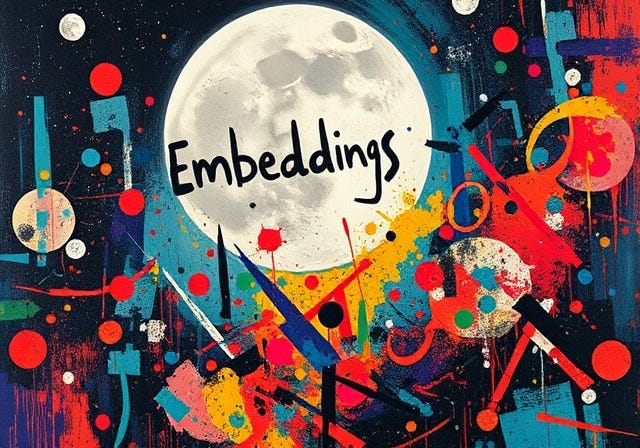

48. Embeddings для RAG - Общая обзор

Embedding является важным и фундаментальным шагом в построении Retrieval Augmented Generation (RAG) pipeline. BERT & SBERT являются state-of-the-art embedding модели.

Embedding является важным и фундаментальным шагом в построении Retrieval Augmented Generation (RAG) pipeline. BERT & SBERT являются state-of-the-art embedding модели.

49. Основные AI-инструменты для разработчиков в 2023 году: 20 рекомендованных решений

В этой статье мы рассмотрим несколько AI-поддерживающих инструментов, которые готовы революционизировать разработку и сделать жизнь разработчиков легче в 2023 году.

В этой статье мы рассмотрим несколько AI-поддерживающих инструментов, которые готовы революционизировать разработку и сделать жизнь разработчиков легче в 2023 году.

50. TnT-LLM: Автоматизация текстовой таксономии и классификации с помощью большую языковую модель

![]()

Этот документ представляет собой TnT-LLM, фреймворк, использующий LLM для автоматизации масштабной аналитики текста, включая автоматическую генерацию меток и эффективные классификаторы.

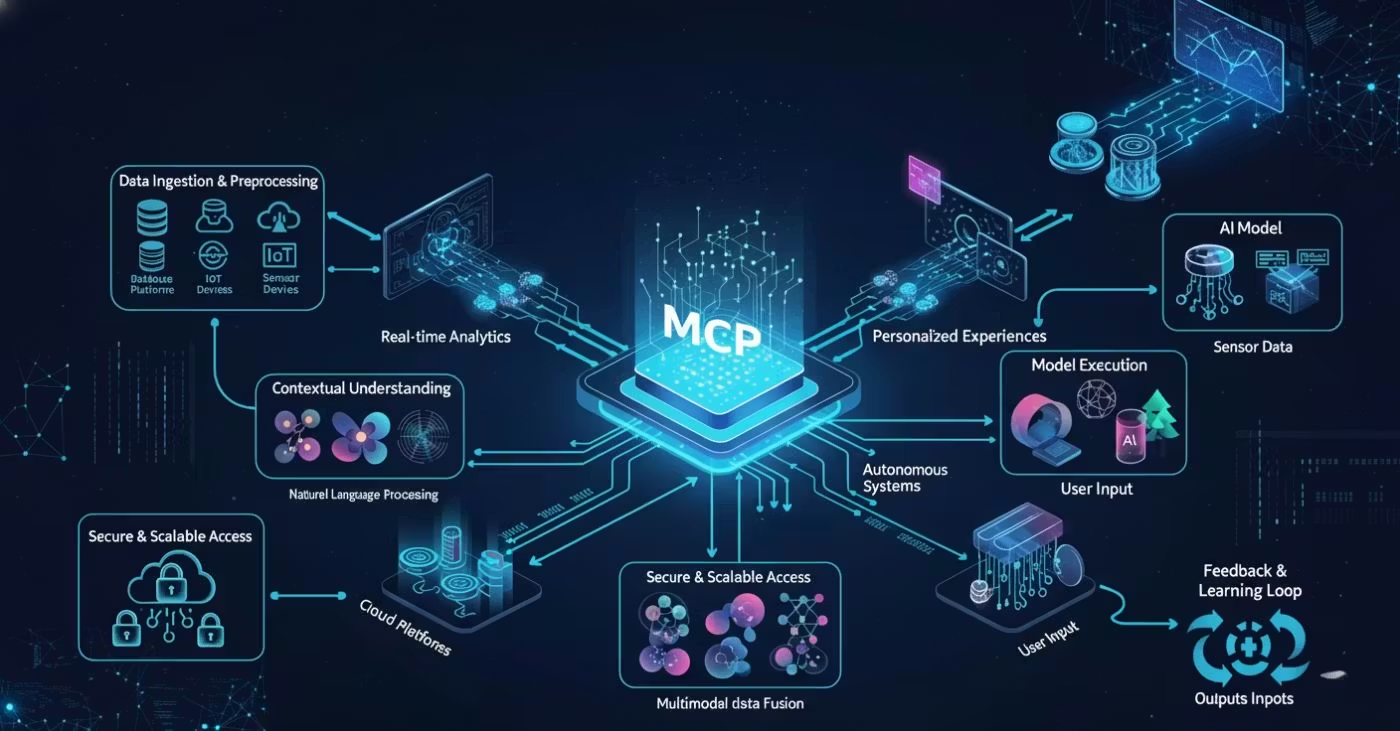

51. MCP Умер. CLI Побеждает в Стеке Агентов AI

Почему разработчики бросают пышные протоколы агентов и обращаются к CLI как к наиболее практичной основе для создания агентов AI в 2026 году.

Почему разработчики бросают пышные протоколы агентов и обращаются к CLI как к наиболее практичной основе для создания агентов AI в 2026 году.

52. AI Не Заменила Меня Ещё, Но Она Может Покажать, Что Я Никогда Не Был Такой Оригинальный

AI не заменит меня еще, но она может показать, что я никогда не был таким оригинальным. Витийная, тревожная статья о формализованном письме в эпоху больших языковых моделей.

AI не заменит меня еще, но она может показать, что я никогда не был таким оригинальным. Витийная, тревожная статья о формализованном письме в эпоху больших языковых моделей.

53. Путеводитель Начинающего: Большие Языковые Модели (LLMOps) в 2023 году: Всё бесплатно!

Этот гид не просто сборник ресурсов LLM; это отобранная поездка по наиболее ценным навыкам в индустрии.

Этот гид не просто сборник ресурсов LLM; это отобранная поездка по наиболее ценным навыкам в индустрии.

54. Разблокировка Мощных Использований: Как Мультиагентные LLM Изменяют Системы AI

Исследование внедрения подходов «человек в цикле» (HITL) в мультиагентных системах AI для разблокировки полного потенциала LLM.

Исследование внедрения подходов «человек в цикле» (HITL) в мультиагентных системах AI для разблокировки полного потенциала LLM.

55. Рассказ о Двух LLM: Открытые Источники vs Эксперименты Вооруженных Сил США по LLM

Эта статья исследует безопасность открытых источников LLM-проектов и эксперименты Вооруженных Сил США по LLM, известные в мире AI.

Эта статья исследует безопасность открытых источников LLM-проектов и эксперименты Вооруженных Сил США по LLM, известные в мире AI.

56. Как Общаться с Файлами PDF Используя Компьютерное Зрение и Открытые Языковые Модели

Учебник по созданию чат-бота с помощью открытых языковых моделей.

Учебник по созданию чат-бота с помощью открытых языковых моделей.

57. Пределы Коавторства с ChatGPT

ChatGPT — полезный инструмент для исследования творческой писанины, но она также имеет свои границы.ограничения. Алгоритм имеет определенные ограничения, но он все равно интересен к использованию

ChatGPT — полезный инструмент для исследования творческой писанины, но она также имеет свои границы.ограничения. Алгоритм имеет определенные ограничения, но он все равно интересен к использованию

58. Мanners Matter? - Влияние доброты на взаимодействие человека с LLM

Исследование влияния доброты на результаты взаимодействия человека с LLM

Исследование влияния доброты на результаты взаимодействия человека с LLM

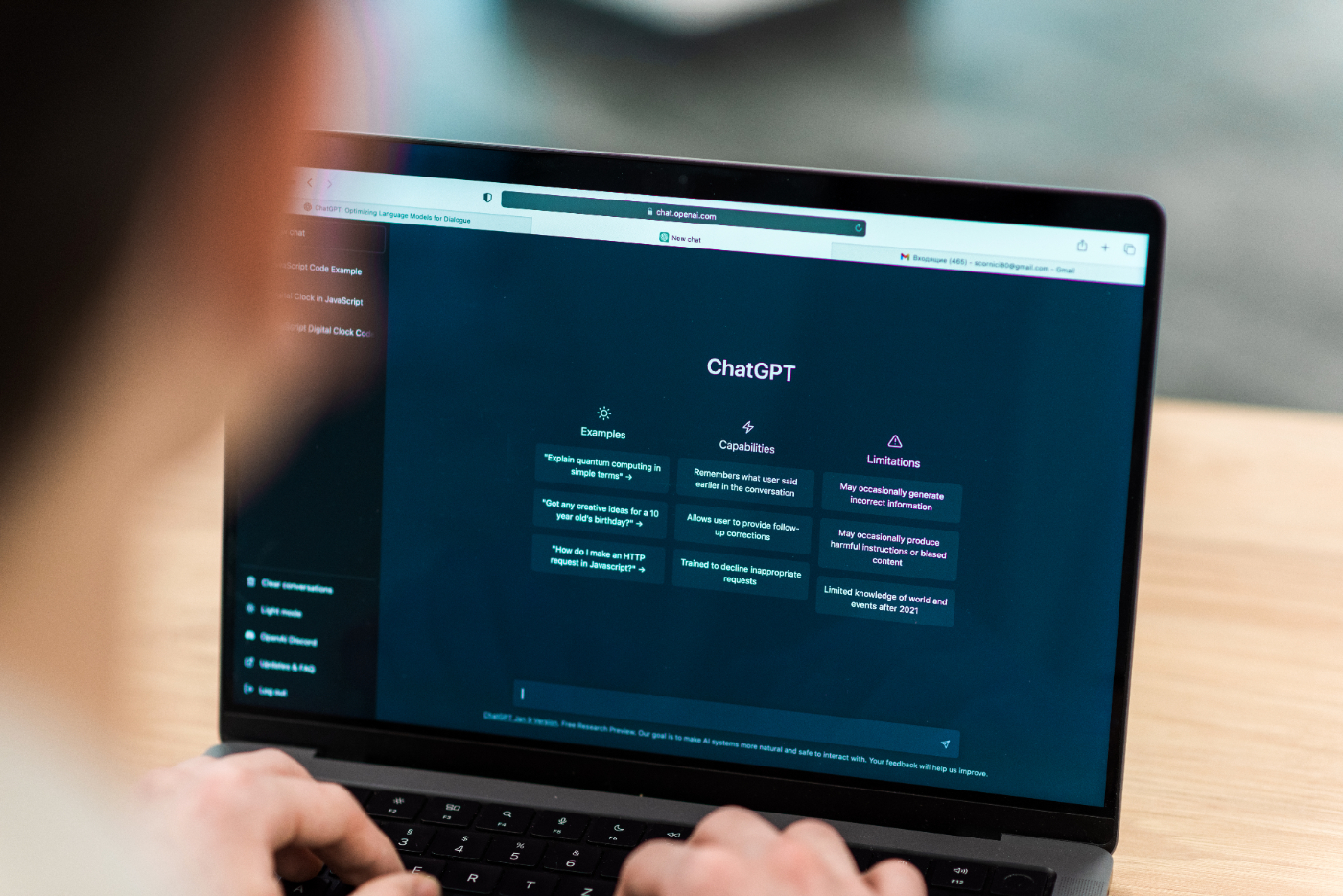

59. Эксперты остаются разделенными по вопросу эффективности ChatGPT, несмотря на заявления о готовности к массовому внедрению

Этот текст обсуждает гип в вокруг ChatGPT, языкового модели, разработанного OpenAI, и утверждает, что, несмотря на его способность генерировать текст, подобный человеческому, он ограничен

Этот текст обсуждает гип в вокруг ChatGPT, языкового модели, разработанного OpenAI, и утверждает, что, несмотря на его способность генерировать текст, подобный человеческому, он ограничен

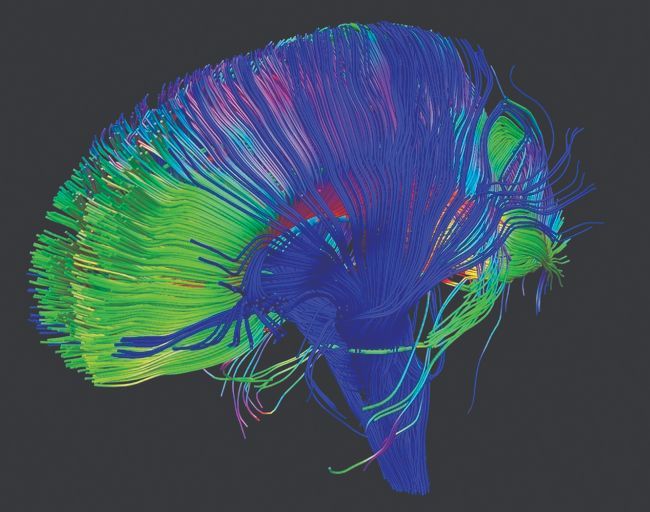

60. Neuralная сеть Transformer (TNN) намного больше, чем даже AGI

Нам только что стало ясно, как работают LLM внутренне - легкое, научное предположение. Но это имеет огромные последствия для отрасли AI и, в самом деле, для мира!

Нам только что стало ясно, как работают LLM внутренне - легкое, научное предположение. Но это имеет огромные последствия для отрасли AI и, в самом деле, для мира!

61. Рекомендации разработчика OpenAI по использованию GPT и ChatGPT

Логан Килпатрик работает в OpenAI в области разработчиков. Он делится своими мыслями о больших языковых моделях, ChatGPT и ландшафте разработчиков OpenAI.

Логан Килпатрик работает в OpenAI в области разработчиков. Он делится своими мыслями о больших языковых моделях, ChatGPT и ландшафте разработчиков OpenAI.

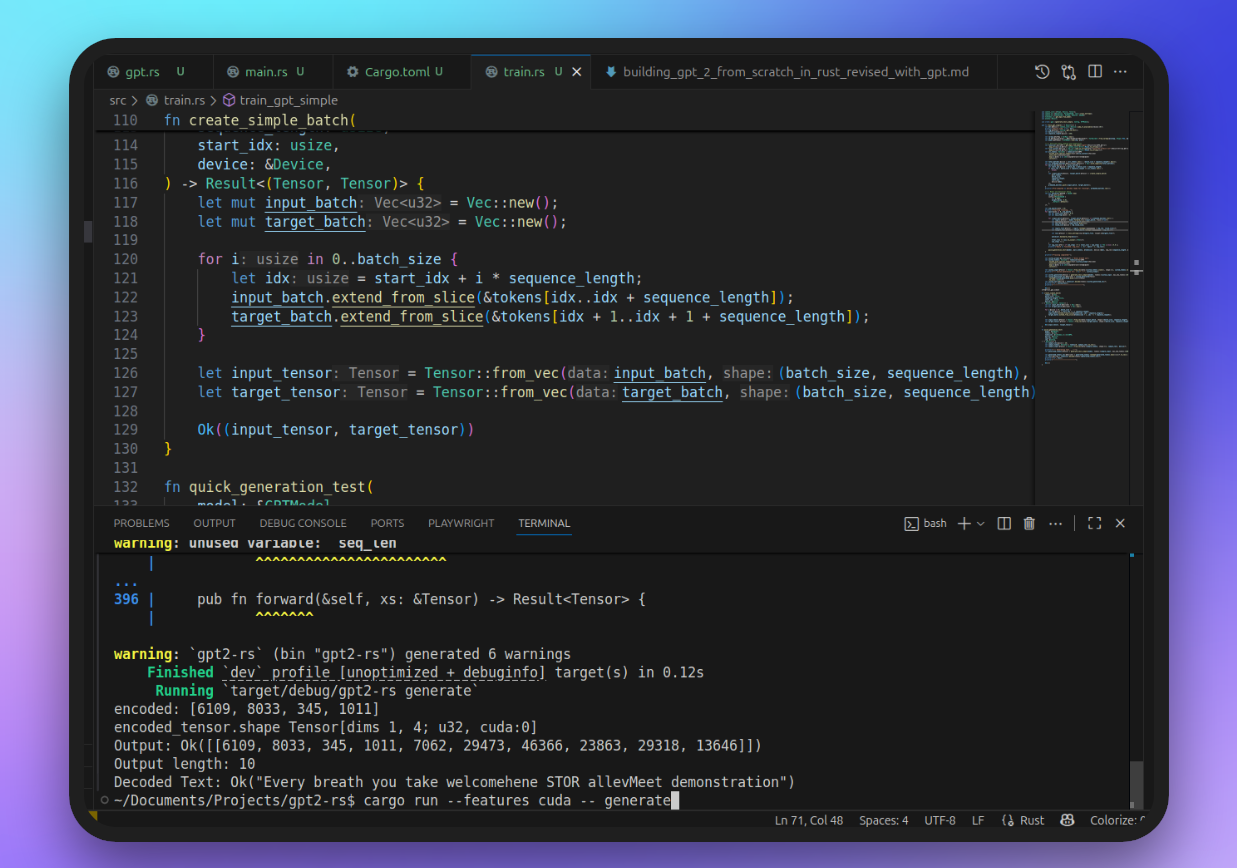

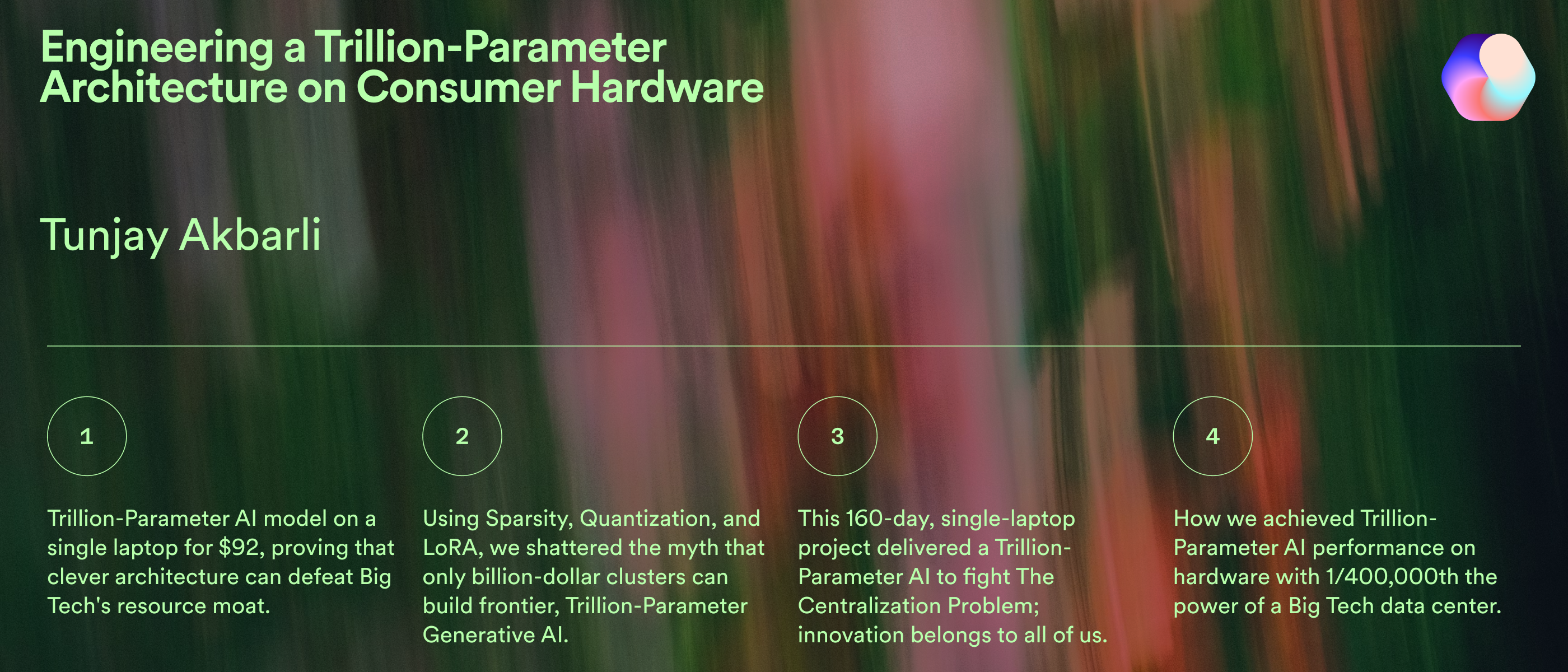

62. Разработка архитектуры с триллионными параметрами на потребительском оборудовании

Глубокое рассмотрение того, как один исследователь обучил модель с триллионными параметрами на ноутбуке RTX 4080, доказав демократизацию LLM

Глубокое рассмотрение того, как один исследователь обучил модель с триллионными параметрами на ноутбуке RTX 4080, доказав демократизацию LLM

63. Как достичь 1000x скорости LLM для эффективного и экономически выгодного обучения, тестирования и развертывания

Вы когда-нибудь задумывались, как ускорить обучение LLM? Ну, - не беспокойтесь - Мы представляем простой, но гениальный метод ускорения LLMOps.

Вы когда-нибудь задумывались, как ускорить обучение LLM? Ну, - не беспокойтесь - Мы представляем простой, но гениальный метод ускорения LLMOps.

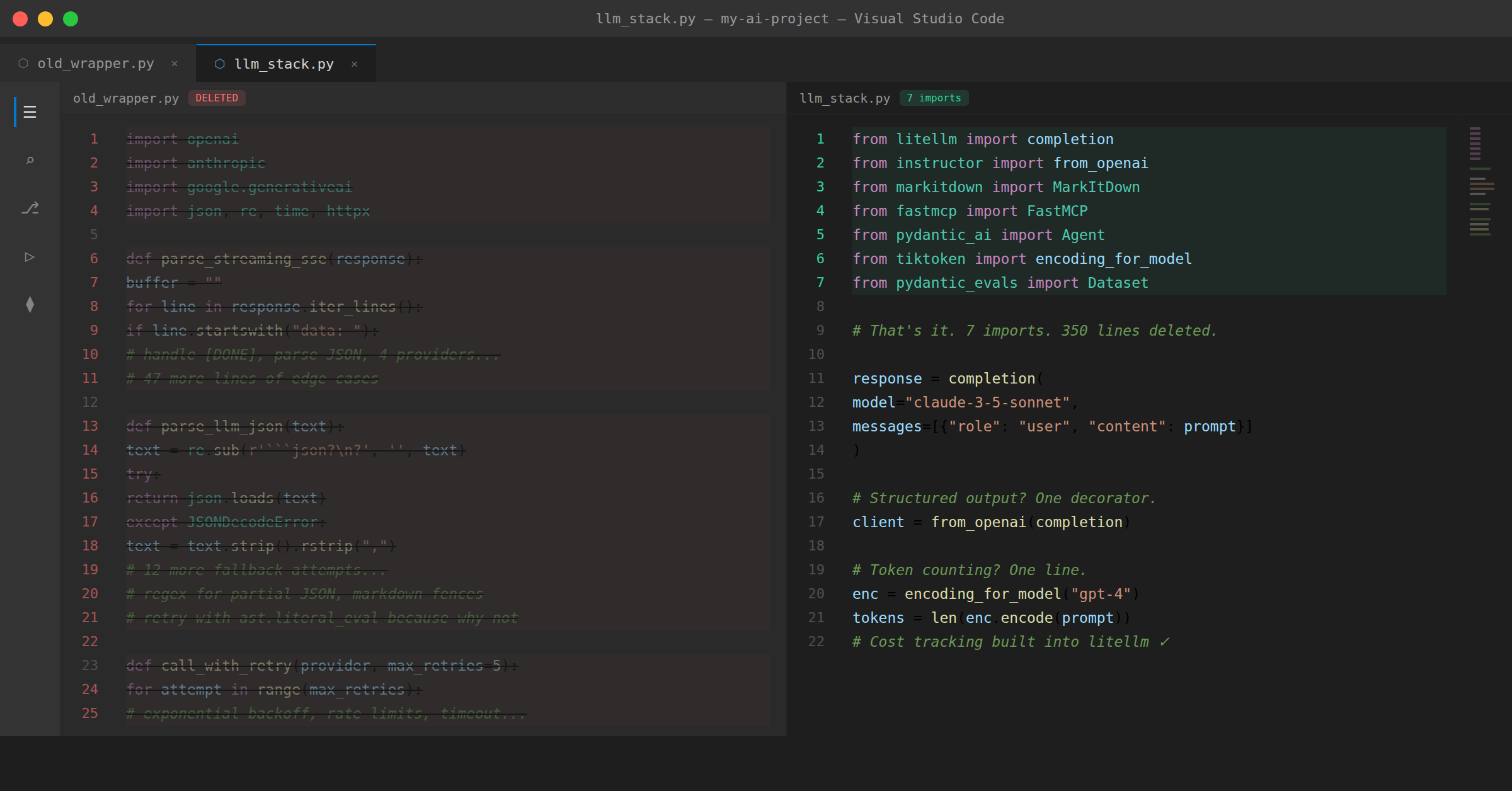

64. 7 основных библиотек AI-инженеринга для замены шаблонов

64. 7 Essential AI Engineering Libraries to Replace Boilerplate

64. 7 Essential AI Engineering Libraries to Replace Boilerplate

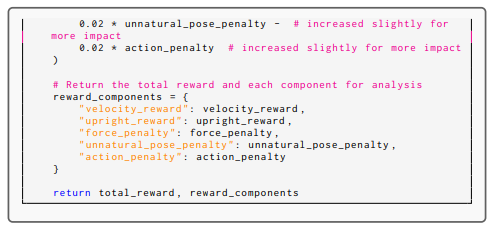

Замените custom LLM-обёртки на 7 производственных протестированных библиотек Python. Обсуждается LiteLLM, Instructor, FastMCP, PydanticAI, tiktoken и другие с примерами кода.

Замените custom LLM-обёртки на 7 производственных протестированных библиотек Python. Обсуждается LiteLLM, Instructor, FastMCP, PydanticAI, tiktoken и другие с примерами кода.

65. AIs Will Be Dangerous Because Unbounded Optimizing Power Leads to Existential Risk

Серьёзные опасения экспертов по поводу будущего мощного AI. Информация, не освещённая в общем СМИ.

Серьёзные опасения экспертов по поводу будущего мощного AI. Информация, не освещённая в общем СМИ.

66. Mamba Architecture: What Is It and Can It Beat Transformers?

Исследуйте Mamba, инновационную архитектуру, превосходящую Transformers по эффективности для длинных последовательностей, обещающую прогресс в AI с гибкой конструкцией.

Исследуйте Mamba, инновационную архитектуру, превосходящую Transformers по эффективности для длинных последовательностей, обещающую прогресс в AI с гибкой конструкцией.

67. Amazon Falcon Lite vs OpenAI ChatGPT - The Large Language Model Battle

Сравнение Amazon Falcon Lite и OpenAI ChatGPT: Обширный обзор больших языковых моделей.

Сравнение Amazon Falcon Lite и OpenAI ChatGPT: Обширный обзор больших языковых моделей.

68. From Crappy Autocomplete to ChatGPT: The Evolution of Language Models

Лёгкое объяснение того, как работает самосознание, и краткий взгляд на эволюцию больших языковых моделей.

Лёгкое объяснение того, как работает самосознание, и краткий взгляд на эволюцию больших языковых моделей.

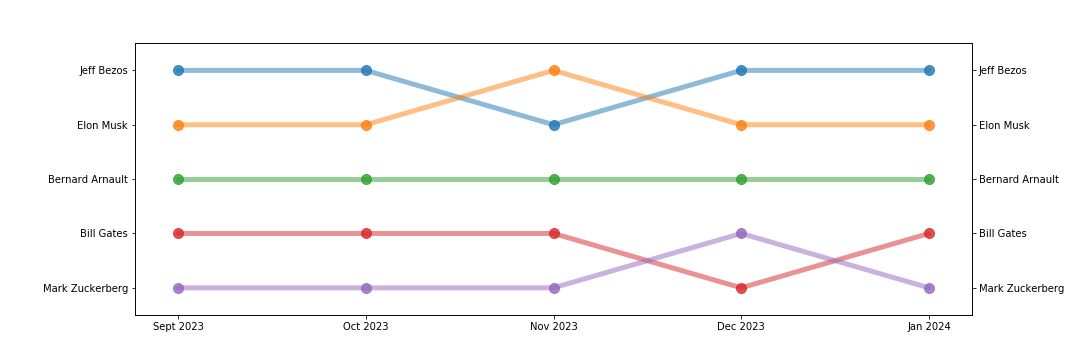

69. AI Says My Schtick is Bigger Than Yours!

Хорошо ли AI-версии топов и рекомендаций, лучше ли они, чем результаты поиска? Как отслеживать их?

Хорошо ли AI-версии топов и рекомендаций, лучше ли они, чем результаты поиска? Как отслеживать их?

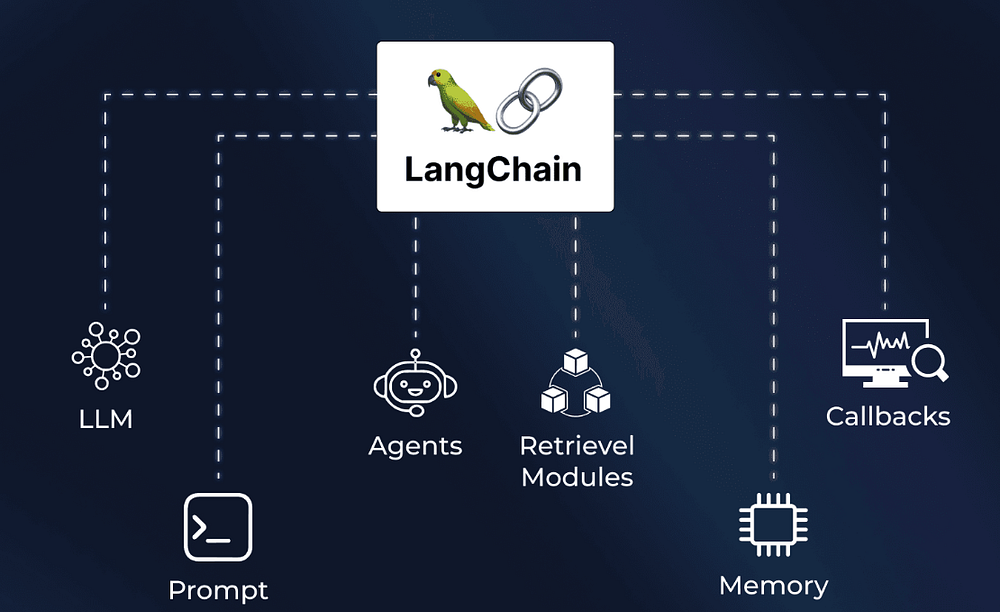

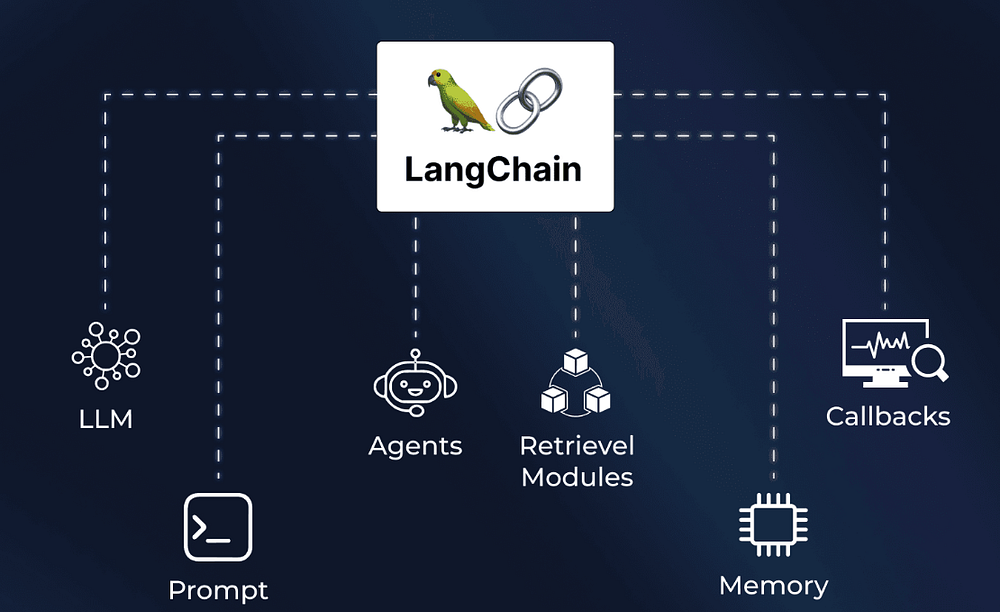

70. Langchain: Explained and Getting Started

Langchain является важным компонентом для разработки моделей LLM. Он помогает в оркестровке и служит строительным блоком.

Langchain является важным компонентом для разработки моделей LLM. Он помогает в оркестровке и служит строительным блоком.

71. ChatGPT Vs. ChatGPT: How to Detect Text Generated Using the AI Language Model

ChatGPT может помочь вам оценить, является ли текст, сгенерированный AI.

ChatGPT может помочь вам оценить, является ли текст, сгенерированный AI.

Текст написан ЛЛМ.

72. Пять вопросов о предвзятости в AI, которых вы, возможно, хотели бы задать

5 основных вопросов из панельной дискуссии о предвзятости в AI. Участники предоставляют свои взгляды на источники предвзятости, ответственность разработчиков и будущее AI.

5 основных вопросов из панельной дискуссии о предвзятости в AI. Участники предоставляют свои взгляды на источники предвзятости, ответственность разработчиков и будущее AI.

73. Действие ЕС по AI: последствия для SEO на LLM

Эта статья разоблачает технический жаргон и charts простой курс для понимания последствий регулирования ЕС для SEO на LLM.

Эта статья разоблачает технический жаргон и charts простой курс для понимания последствий регулирования ЕС для SEO на LLM.

74. Должно ли конверсационное AI полагаться на большие модели языка?

Большие модели языка (LLM) — это конверсационные чат-боты AI, которые взрывают мир.

Большие модели языка (LLM) — это конверсационные чат-боты AI, которые взрывают мир.

75. LLMs Изменяют Приложения AI: Как Это Происходит

Строительство приложений с не реальными уровнями персонализированного контекста стало реальностью для всех, у кого есть правильная база данных, несколько строк кода и LLM, такой как GPT-4.

Строительство приложений с не реальными уровнями персонализированного контекста стало реальностью для всех, у кого есть правильная база данных, несколько строк кода и LLM, такой как GPT-4.

76. BYOK (BringYourOwnKey) в генеративном AI — двойной меч

Вы знаете, что Bring Your Own Key (BYOK) в генеративном AI? Читайте дальше и узнайте больше о новом концепте AI.

Вы знаете, что Bring Your Own Key (BYOK) в генеративном AI? Читайте дальше и узнайте больше о новом концепте AI.

77. Безопасные угрозы для высокоинтенсивных открыто-источниковых больших моделей языка

Быстрый рост проектов Open-source LLM часто демонстрирует неумную безопасную позицию, которая требует принятия улучшенных стандартов безопасности.

Быстрый рост проектов Open-source LLM часто демонстрирует неумную безопасную позицию, которая требует принятия улучшенных стандартов безопасности.

78. Системы памяти AI: подходы, которые вам нужно знать

Создал свою собственную систему Open-source, называемую Elroy, и уже три года взаимодействую с ней. Она помогает мне brainstorm и многое другое.

Создал свою собственную систему Open-source, называемую Elroy, и уже три года взаимодействую с ней. Она помогает мне brainstorm и многое другое.

79. О зиме AI и том, что это означает для будущего

Полная история

Полная история

Обзор зимних периодов AI проводится в деталях. Обширная информация, которую мы не нашли в других источниках.

80. Может ли китайский DeepSeek разрушить теорию «Больше GPU — больше мощности»?

Это 2025 год, и мы можем уже наблюдать переломный момент для AI, как мы знали его в последние пару лет.

Это 2025 год, и мы можем уже наблюдать переломный момент для AI, как мы знали его в последние пару лет.

81. Meta Strikes Back: Введение LLaMA

Meta представляет LLaMA, 65-размерный параметр модели, чтобы конкурировать с ChatGPT, в то время как OpenAI планирует AGI, создавая гонку за продвинутые языковые модели.

Meta представляет LLaMA, 65-размерный параметр модели, чтобы конкурировать с ChatGPT, в то время как OpenAI планирует AGI, создавая гонку за продвинутые языковые модели.

82. Как я сократил задержку агентного потока на 3-5 раз без увеличения затрат модели

Узнайте, как ускорить и оптимизировать агентные потоки с помощью умной разрезки шагов, параллелизации, кэширования и оптимизации модели.

Узнайте, как ускорить и оптимизировать агентные потоки с помощью умной разрезки шагов, параллелизации, кэширования и оптимизации модели.

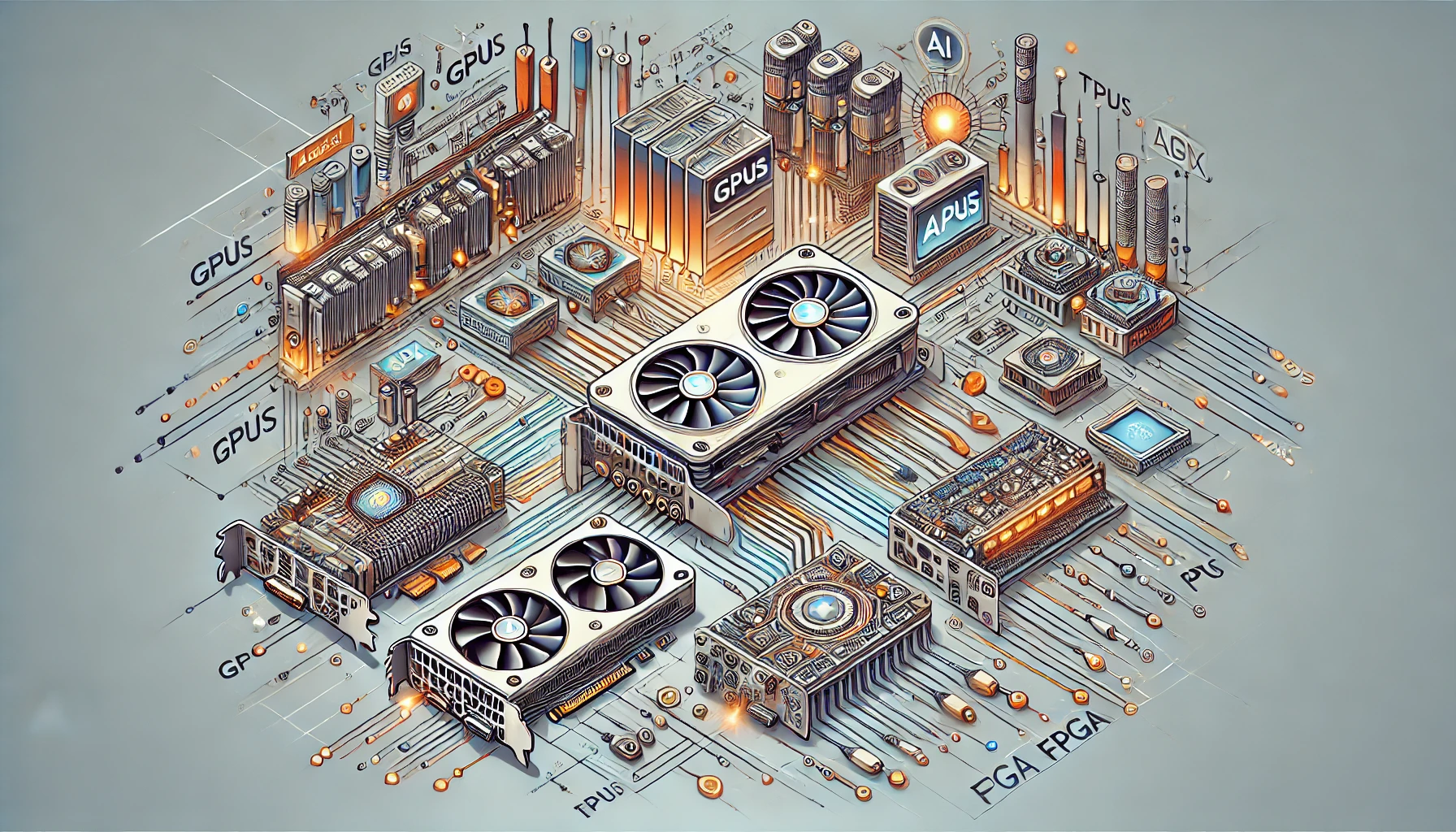

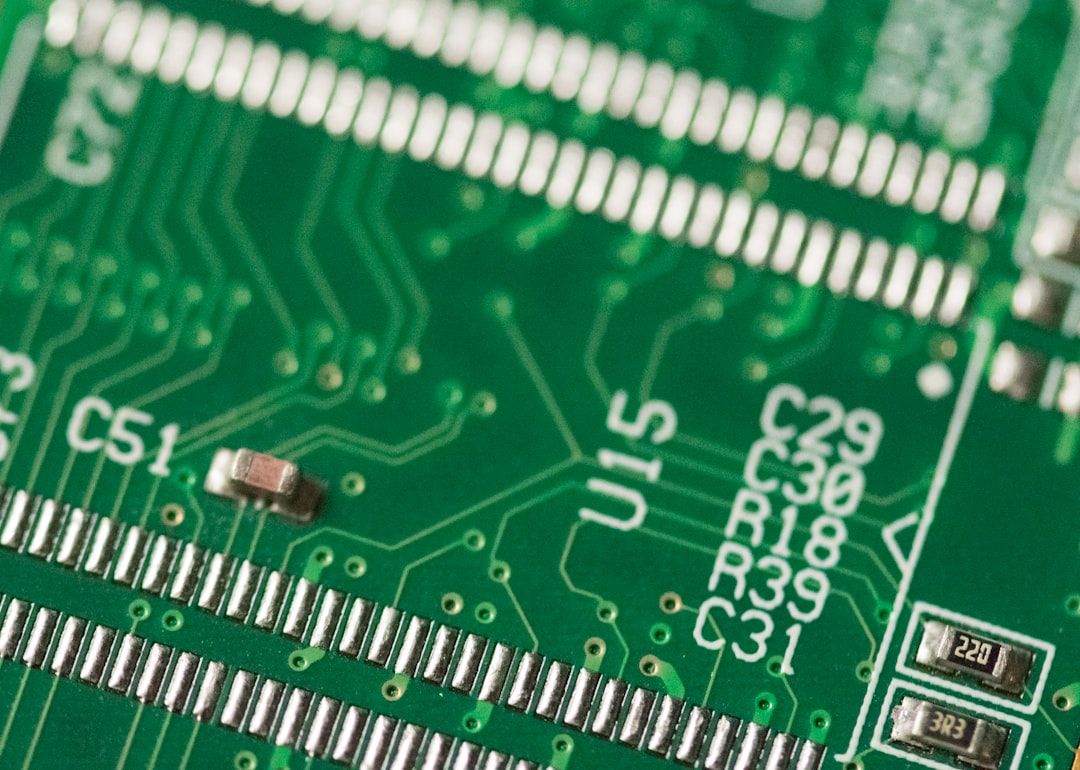

83. Примечание к оптимизации вывода большой языковой модели (LLM): 2. Введение в ускорители искусственного интеллекта (AI)

Эта статья исследует ускорители AI и их влияние на развертывание большой языковой модели (LLM) на больших масштабах.

Эта статья исследует ускорители AI и их влияние на развертывание большой языковой модели (LLM) на больших масштабах.

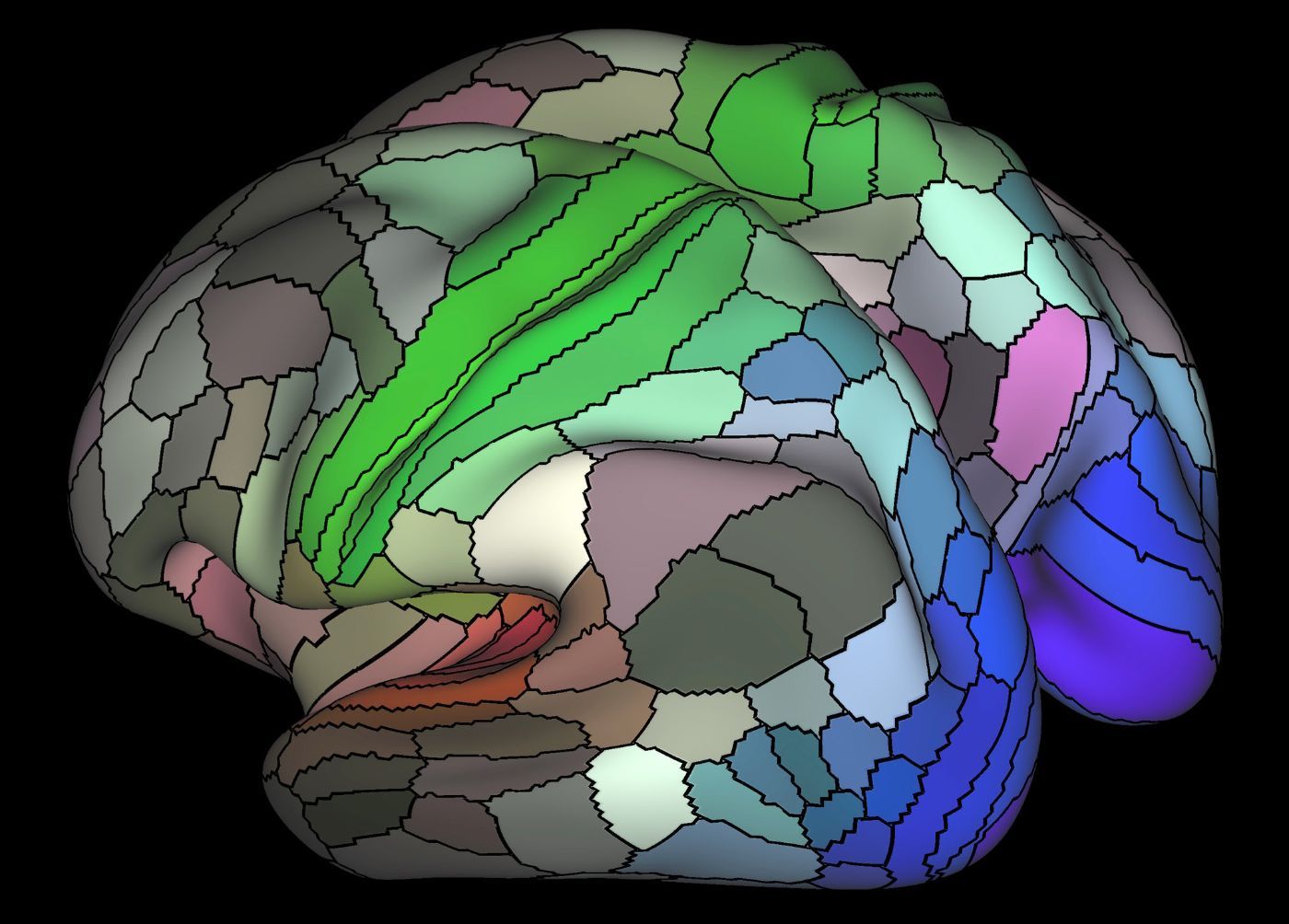

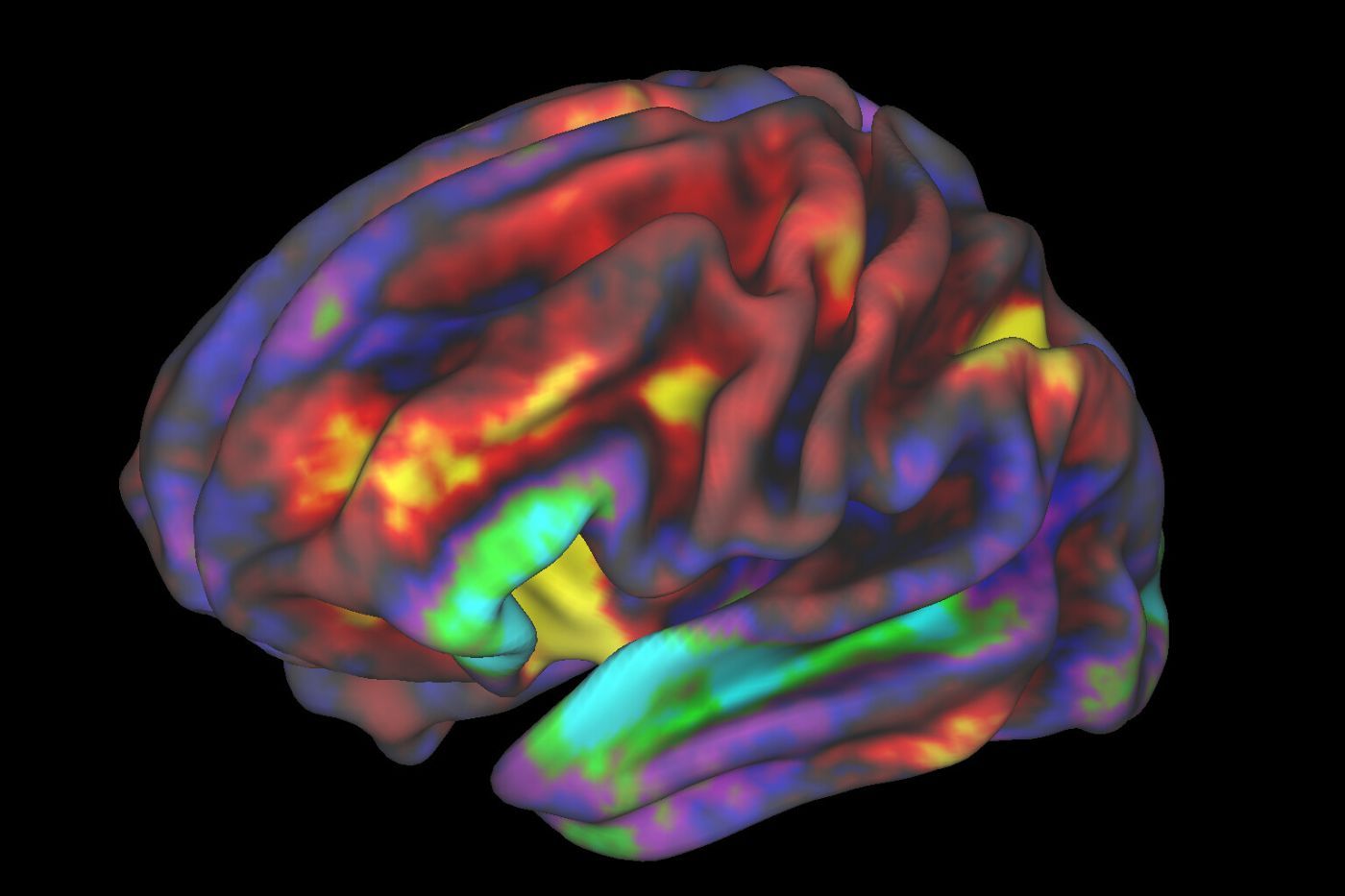

84. История мозга: тревога AI и иллюзия разума

Сознательны ли LLM, или это просто сложные калькуляторы? Как забытый в 1981 году научно-фантастический эксперимент предсказал современную кризисную ситуацию AI.

Сознательны ли LLM, или это просто сложные калькуляторы? Как забытый в 1981 году научно-фантастический эксперимент предсказал современную кризисную ситуацию AI.

85. За кулисами большой языковой модели: разговор с Джей Аламмаром

В 16-м эпизоде «Подкаста «Что такое AI», я имел честь беседовать с Джей Аламмаром, известным специалистом по AI и блогером.

В 16-м эпизоде «Подкаста «Что такое AI», я имел честь беседовать с Джей Аламмаром, известным специалистом по AI и блогером.

86. Большая языковая модель: путешествие начинающего — Часть 1

Изучите мир большой языковой модели (LLM) в нашей обширной статье.

Изучите мир большой языковой модели (LLM) в нашей обширной статье.

Руководство. От понимания их возможностей до преодоления ограничений, узнайте, как LLMs

87. Как привести личностные торговые оферы с помощью векторного поиска

Узнайте, как векторный поиск может привести к результатам с помощью клиентских предложений в крупном розничном магазине.

Узнайте, как векторный поиск может привести к результатам с помощью клиентских предложений в крупном розничном магазине.

Улучшение результатов GPT-5 с помощью 15 000 экспертных стимулов, которые превращают скучные выводы AI в высокоэффективный контент для предпринимателей, маркетологов и создателей.

95. Как большие языковые модели улучшают безопасность систем от сопротивления угроз до анализа угодах о соблюдении

Изучайте разнообразные применения больших языковых моделей (LLMs) в области безопасности.

Изучайте разнообразные применения больших языковых моделей (LLMs) в области безопасности.

96. Как AI изменит менеджмент продуктов

Изучайте, как AI изменит роли менеджеров продуктов, от быстрого прототипирования до анализа обратной связи пользователей, оснащая PMs инновациями и конкурентоспособностью.

Изучайте, как AI изменит роли менеджеров продуктов, от быстрого прототипирования до анализа обратной связи пользователей, оснащая PMs инновациями и конкурентоспособностью.

97. TnT-LLM: Выделение паттернов в большом объеме, используя большие языковые модели

Перевод неструктурированного текста в структурированный и значимый формы является фундаментальным шагом в выделении паттернов для последующего анализа и применения.

Перевод неструктурированного текста в структурированный и значимый формы является фундаментальным шагом в выделении паттернов для последующего анализа и применения.

98. Лучшие практики для интеграции LLMs с средствами анализа вредоносного ПО

LLMs могут дополнить деобфускацию в потоках угроз, заполняя пробелы, суммируя код и картографируя MITRE ATT&CK, но должны минимизировать галлюцинации.

LLMs могут дополнить деобфускацию в потоках угроз, заполняя пробелы, суммируя код и картографируя MITRE ATT&CK, но должны минимизировать галлюцинации.

99. От чёрного ящика до прозрачности: как читать логику LLMs

Изучайте, как LLMs работают внутри: от фундаментальных принципов предсказания токенов до архитектуры Transformer, этапов обучения и цепей рассуждений. Узнайте, как формировать запросы

Изучайте, как LLMs работают внутри: от фундаментальных принципов предсказания токенов до архитектуры Transformer, этапов обучения и цепей рассуждений. Узнайте, как формировать запросы

100. Оценка TnT-LLM: автоматическая, человеческая и оценка на основе LLM

В связи с неупорядоченным характером проблемы, которую мы изучаем, и отсутствием стандартной оценки, выполнять количественную оценку конечного результата генерации таксономии

В связи с неупорядоченным характером проблемы, которую мы изучаем, и отсутствием стандартной оценки, выполнять количественную оценку конечного результата генерации таксономии

101. Предыдущие подходы к выделению паттернов в тексте: таксономия, группировка, классификация и LLM

Обзор связанной исследовательской работы в области генерации текстовой таксономии, группировки текста и использования LLM для автоматической аннотации текста.

Обзор связанной исследовательской работы в области генерации текстовой таксономии, группировки текста и использования LLM для автоматической аннотации текста.

102. Воздействие AI: 6 революционных прорывов

Исследуйте воздействие AI в отраслях: Воздействие AI на бизнес, клиентский опыт, здравоохранение, финансы, транспорт и многое другое!

Исследуйте воздействие AI в отраслях: Воздействие AI на бизнес, клиентский опыт, здравоохранение, финансы, транспорт и многое другое!

103. Дорогой AI: Мы все еще не доверяем вам

За последние месяцы миллионы людей все больше увлекаются AI и чат-ботами. Есть одна история, которая привлекла мое внимание…

За последние месяцы миллионы людей все больше увлекаются AI и чат-ботами. Есть одна история, которая привлекла мое внимание…

104. Как переставить упаковку продукта с помощью AI для роста

Упаковка продукта влияет на 72% американцев в принятии решений о покупке, а рынок устойчивой упаковки развивается с годовой скоростью роста 8,5% в период с 2023 по 2031 год.

Упаковка продукта влияет на 72% американцев в принятии решений о покупке, а рынок устойчивой упаковки развивается с годовой скоростью роста 8,5% в период с 2023 по 2031 год.

105. Наши предложенные фреймворки: Использование LLM для тематического анализа

Фреймворк основан на возможностях модели OpenAI GPT-4 для выполнения сложных задач НЛП в нулевой точке.

Фреймворк основан на возможностях модели OpenAI GPT-4 для выполнения сложных задач НЛП в нулевой точке.

106. Должны ли вы рисковать использовать браузер AI?

AI кажется следующим шагом для веб-браузеров, но риски безопасности и галлюцинации являются реальными проблемами. Здесь перечислены плюсы и минусы браузеров AI.

AI кажется следующим шагом для веб-браузеров, но риски безопасности и галлюцинации являются реальными проблемами. Здесь перечислены плюсы и минусы браузеров AI.

107. Использование потенциала AI для создания персонализированных и индивидуальных опытов

Узнайте, как AI помогает создавать персонализированные опыты в различных сервисах.

Узнайте, как AI помогает создавать персонализированные опыты в различных сервисах.

108. LLM & RAG: Рассказ о любви на День святого Валентина

Любовь в воздухе, и так же идеальные партнеры AI: LLM и RAG!

Любовь в воздухе, и так же идеальные партнеры AI: LLM и RAG!

109. Будущее анализа вредоносного ПО: LLM и автоматическая деобфускация

LLMs показывают сильный потенциал для автоматизации деобфускации вредоносного ПО, эффективного анализа реальных скриптов Emotet и улучшения будущих потоков угрозной информации

LLMs показывают сильный потенциал для автоматизации деобфускации вредоносного ПО, эффективного анализа реальных скриптов Emotet и улучшения будущих потоков угрозной информации

110. AI Knows Best—But Only If You Agree With It

Эффективность AI может непреднамеренно сузить человеческое знание, приводя к «кollapse знаний». Узнайте, как этот сдвиг влияет на инновации и культурную диверсность.

Эффективность AI может непреднамеренно сузить человеческое знание, приводя к «кollapse знаний». Узнайте, как этот сдвиг влияет на инновации и культурную диверсность.

111. Yoshua Bengio Weighs in on the Pause and Building a World Model

Эта неделя я беседовал с Yoshua Bengio, одним из основателей глубокого обучения о дополнении больших языковых моделей

Эта неделя я беседовал с Yoshua Bengio, одним из основателей глубокого обучения о дополнении больших языковых моделей

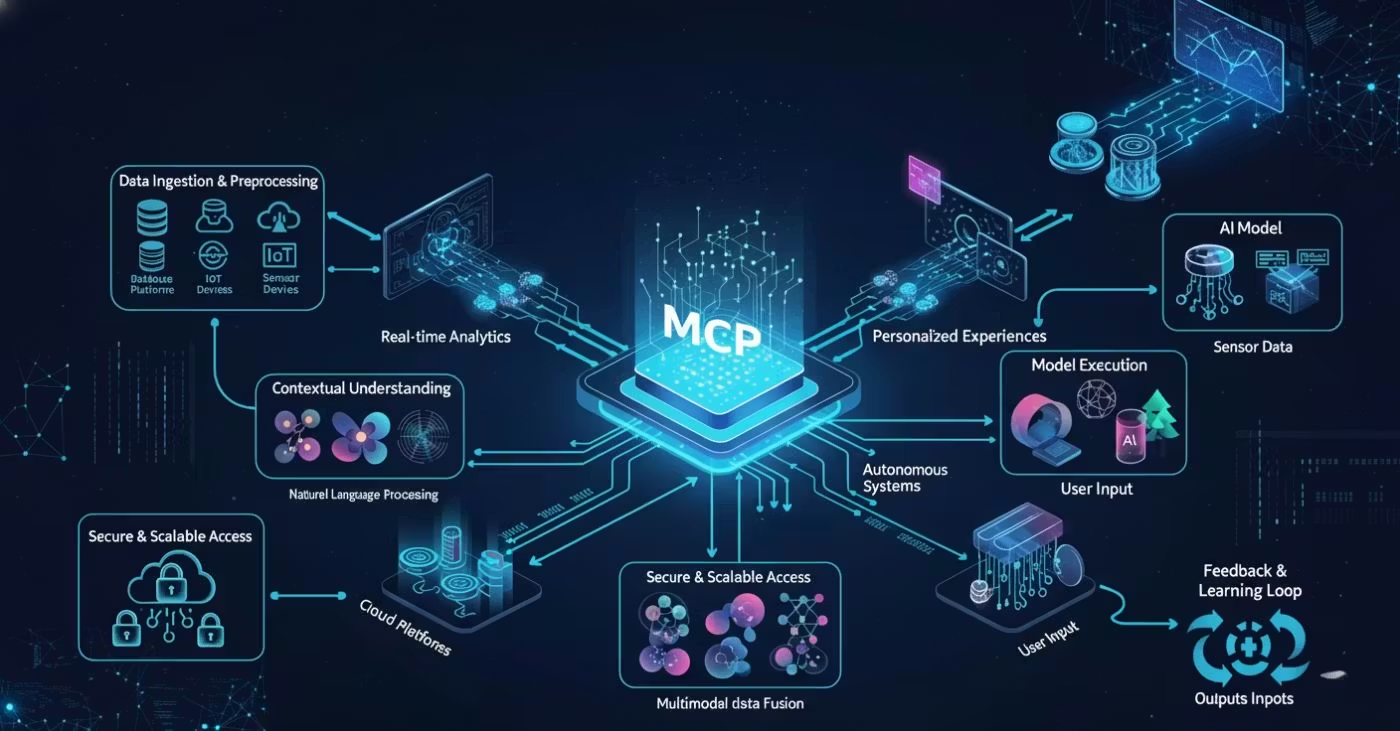

112. How to Build Your First MCP Server using FastMCP

Узнайте, как построить свой первый сервер MCP с помощью FastMCP и подключить его к большой языковой модели для выполнения реальных задач через код.

Узнайте, как построить свой первый сервер MCP с помощью FastMCP и подключить его к большой языковой модели для выполнения реальных задач через код.

113. An Intro to MedPaLM: ChatGPT's Healthcare-Focused "Cousin"

ChatGPT для здравоохранения? Узнайте все, что нужно знать о MedPaLM, новой LLM, разработанной Google специально для медицинских и клинических приложений.

ChatGPT для здравоохранения? Узнайте все, что нужно знать о MedPaLM, новой LLM, разработанной Google специально для медицинских и клинических приложений.

114. Reflecting on AI in 2023: Magic, Hope, Innovation and Disruption

Откройте трансформативную силу Искусственного интеллекта. Изучите последние тенденции от NL до глубокого обучения, которые формируют будущее AI.

Откройте трансформативную силу Искусственного интеллекта. Изучите последние тенденции от NL до глубокого обучения, которые формируют будущее AI.

115. ChatGPT Translator VS Mine: Which One Is Better?

Действительно ли ChatGPT Translator такой хороший, как упоминалось в многих постах ?

Действительно ли ChatGPT Translator такой хороший, как упоминалось в многих постах ?

116. Retrieval-Augmented Generation: AI Hallucinations Be Gone!

Retrieval Augmented Generation (RAG), показывает обещания в эффективном увеличении знаний LLM и снижении воздействия AI-иллюзий.

Retrieval Augmented Generation (RAG), показывает обещания в эффективном увеличении знаний LLM и снижении воздействия AI-иллюзий.

117. Протокол контекста модели (MCP): новый стандарт для безопасной интероперабельности AI

MCP является важным "протоколом middleware", который находится между большим языковым моделям и всей корпоративной средой.

MCP является важным "протоколом middleware", который находится между большим языковым моделям и всей корпоративной средой.

118. Демократизация доступа к AI стала более важной, чем когда-либо

Поскольку влияние AI grows, так же растут разрывы в доступе к его трансформационному потенциалу.

Поскольку влияние AI grows, так же растут разрывы в доступе к его трансформационному потенциалу.

119. 10 Техник инженерии запросов для трансформации вашего подхода к AI

Откройте 10 продвинутых техник инженерии запросов: рекурсивное расширение, оптимизация токенов, принцип DRY, эмуляция персонажа для превосходных AI-выходов.

Откройте 10 продвинутых техник инженерии запросов: рекурсивное расширение, оптимизация токенов, принцип DRY, эмуляция персонажа для превосходных AI-выходов.

120. Чат — ужасный интерфейс для агентов, и 2026 года это покажет

Разработка AI-агентов? Я попробовал Angular, HTMX & Python. Они провалились. Узнайте, почему A2UI является декларативным протоколом для замены базовых чат-ботов.

Разработка AI-агентов? Я попробовал Angular, HTMX & Python. Они провалились. Узнайте, почему A2UI является декларативным протоколом для замены базовых чат-ботов.

121. OpenAI делает легче создавать свои собственные AI-агенты с помощью API

Вы можете создавать сложные AI-ассистенты, которые безболезненно обрабатывают все, от обратного расположения строк до запросов внутренних баз данных.

Вы можете создавать сложные AI-ассистенты, которые безболезненно обрабатывают все, от обратного расположения строк до запросов внутренних баз данных.

122. AI делает технику менее пугающей для "словных" людей

Узнайте, как AI преобразует мир для писателей и творческих людей. Вступите в мир, как естественные языковые интерфейсы делают технику более доступной.

Узнайте, как AI преобразует мир для писателей и творческих людей. Вступите в мир, как естественные языковые интерфейсы делают технику более доступной.

123. Как я заставил Llama 3 почтить Бога!

Вы когда-нибудь задумывались, что бы AI подумал о Боге? Теперь вы можете узнать. Читайте эту статью, чтобы узнать!

Вы когда-нибудь задумывались, что бы AI подумал о Боге? Теперь вы можете узнать. Читайте эту статью, чтобы узнать!

124. Автоматический анализ настроений бренда с помощью генеративной AI

Учитесь мониторить свой бренд на социальных сетях, как Reddit, Twitter, Linkedin, Hacker News… и автоматически анализировать настроение, благодаря генеративному AI.

Учитесь мониторить свой бренд на социальных сетях, как Reddit, Twitter, Linkedin, Hacker News… и автоматически анализировать настроение, благодаря генеративному AI.

125. The Game AI Problem Computers Were Never Built to Solve

Объяснение, почему brute-force AI проваливается в гранд-стратегических играх, и как гибридные архитектуры LLM позволяют выполнять долгосрочную стратегическую рассуждение.

Объяснение, почему brute-force AI проваливается в гранд-стратегических играх, и как гибридные архитектуры LLM позволяют выполнять долгосрочную стратегическую рассуждение.

126. GPT4All: An Ecosystem of Open-Source Compressed Language Models

В этой статье мы рассказываем историю GPT4All, популярного открытого репозитория, целью которого является демократизация доступа к LLM.

В этой статье мы рассказываем историю GPT4All, популярного открытого репозитория, целью которого является демократизация доступа к LLM.

127. AI Is Playing Favorite With Numbers

LLM, как умны и предвзяты, как люди, которые их обучали. Хотя AI не может думать сама, мы только начинаем изучать глубины психологии LLM.

LLM, как умны и предвзяты, как люди, которые их обучали. Хотя AI не может думать сама, мы только начинаем изучать глубины психологии LLM.

128. From Backlinks to Data Depth: How LLMs Are Rewriting Content Authority

Большие языковые модели (LLM) заменяют авторитетность контента Google-эры. LLM предназначены для поиска контента, который объясняет, определяет, сравнивает или решает.

Большие языковые модели (LLM) заменяют авторитетность контента Google-эры. LLM предназначены для поиска контента, который объясняет, определяет, сравнивает или решает.

129. Streamlining LLM Implementation: How to Enhance Specific Business Solutions with RAG

Учитесь улучшать свои LLM с помощью retrieval-augmented generation, используя LlamaIndex и LangChain для контекста данных, развертывая свою приложение на Heroku.

Учитесь улучшать свои LLM с помощью retrieval-augmented generation, используя LlamaIndex и LangChain для контекста данных, развертывая свою приложение на Heroku.

130. Simplifying Vector Search: Part 1

Вы когда-нибудь задумывались, как Spotify или любое количество сайтов для знакомств определяют, что или кто вам нравится? Они используют векторное поиск. Это векторный поиск упрощается.

Вы когда-нибудь задумывались, как Spotify или любое количество сайтов для знакомств определяют, что или кто вам нравится? Они используют векторное поиск. Это векторный поиск упрощается.

131. The Em Dash Rorschach Test

Использование вами эн-деша — это ли это признак AI-авторства? Как этот скромный знак препинания стал культурной вспышкой в эпоху больших языковых моделей.

Использование вами эн-деша — это ли это признак AI-авторства? Как этот скромный знак препинания стал культурной вспышкой в эпоху больших языковых моделей.

132. GPTerm: Создание интеллектуальных приложений терминала с помощью ChatGPT и моделей LLM

В этой статье исследуется увлекательная область создания умных приложений терминала, интегрировав в них ChatGPT, cutting-edge языковой модель.

В этой статье исследуется увлекательная область создания умных приложений терминала, интегрировав в них ChatGPT, cutting-edge языковой модель.

133. Плюсы и минусы LLM в практике кибербезопасности

LLM повышают кибербезопасность, автоматизируя обнаружение и анализ угроз, а также соблюдение требований, но также могут быть использованы для атак и разработки вредоносного программного обеспечения.

LLM повышают кибербезопасность, автоматизируя обнаружение и анализ угроз, а также соблюдение требований, но также могут быть использованы для атак и разработки вредоносного программного обеспечения.

134. Как начать карьеру junior-разработчика в 2026 году

Роль junior-разработчика распадается (снижение на 46%), но emerges новая траектория.

Роль junior-разработчика распадается (снижение на 46%), но emerges новая траектория.

135. LLM: эксперты в NLP, обеспечивая сложные поисковые функции в платформах электронной коммерции

Чтобы обеспечить исключительные покупательские опыт, бизнесы должны использовать потенциал LLM, поскольку электронная коммерция продолжает развиваться.

Чтобы обеспечить исключительные покупательские опыт, бизнесы должны использовать потенциал LLM, поскольку электронная коммерция продолжает развиваться.

136. Их маржа — это возможность AI

Может ли «ЧатCEO» снизить затраты и улучшить бизнес?

Может ли «ЧатCEO» снизить затраты и улучшить бизнес?

137. LLM-усиленная классификация текста: разложение меток GPT-4 в эффективные классификаторы

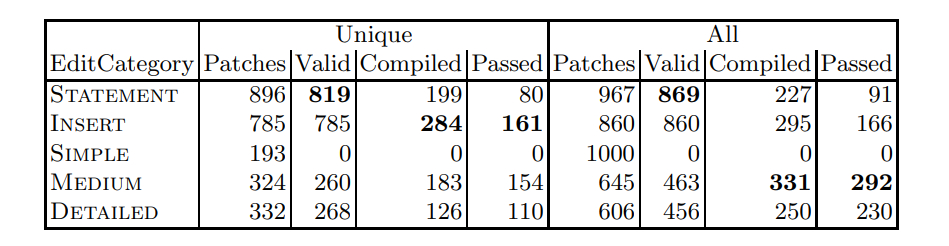

Мы исследуем использование GPT-4 для масштабной аннотации текста и обучение лёгких классификаторов на этих метках, сравнивая их точность и эффективность.

Мы исследуем использование GPT-4 для масштабной аннотации текста и обучение лёгких классификаторов на этих метках, сравнивая их точность и эффективность.

138. Как AI и социальные медиа формируют знания через эхо-камеры и фильтровые пузырьки

Алгоритмы AI и социальных медиа формируют знания, усиливая предубеждения и ограничивая доступ к разнообразным идеям, что приводит к образованию эхо-камер и искажению знаний.

Алгоритмы AI и социальных медиа формируют знания, усиливая предубеждения и ограничивая доступ к разнообразным идеям, что приводит к образованию эхо-камер и искажению знаний.

139. У меня есть умысел?

139. Do y'AI mind?

Большие языковые модели вызывают вопросы вокруг природы ума, старую философскую проблему, солипсизм или один ум, трудно ответить

Большие языковые модели вызывают вопросы вокруг природы ума, старую философскую проблему, солипсизм или один ум, трудно ответить

140. AI Framework has You Covered on Image-to-Text Workflows

Узнайте, как использовать AnyModal, модульную рамку для интеграции визуальных и языковых моделей, для создания и обучения собственного LaTeX OCR-системы. Ideal'noe для исследований в области AI

Узнайте, как использовать AnyModal, модульную рамку для интеграции визуальных и языковых моделей, для создания и обучения собственного LaTeX OCR-системы. Ideal'noe для исследований в области AI

141. With New AI Model, Meta Hopes Imperfect Hands Will be a Thing of the Past

Meta разогревает соревнование в области AI с запуском нового искусственного интеллекта, который может помочь пользователям анализировать и завершать незавершенные изображения.

Meta разогревает соревнование в области AI с запуском нового искусственного интеллекта, который может помочь пользователям анализировать и завершать незавершенные изображения.

142. From Zero to AI-Ready: How I Taught Myself Machine Learning (And What I would Tell You Now)

Вы не нуждаетесь в докторской степени, чтобы научиться AI, просто структура, любопытство и небольшие шаги, которые имеют смысл. Вот как я научился машинному обучению с нуля.

Вы не нуждаетесь в докторской степени, чтобы научиться AI, просто структура, любопытство и небольшие шаги, которые имеют смысл. Вот как я научился машинному обучению с нуля.

143. Policy-Driven AI: Designing Configuration-Driven Model Selection for Enterprise Systems

Фиксация вызова AI-моделей - это новый технический долг. Этот материал рассказывает о том, как архитектурить слой конфигурации для выбора модели

Фиксация вызова AI-моделей - это новый технический долг. Этот материал рассказывает о том, как архитектурить слой конфигурации для выбора модели

144. When To Use Small Language Models Over Large Language Models

Вы wonder', где начать использовать малые языковые модели? Найдите топовые случаи использования малых языковых моделей, когда малые языковые модели будут лучше, чем большие языковые модели.

Вы wonder', где начать использовать малые языковые модели? Найдите топовые случаи использования малых языковых моделей, когда малые языковые модели будут лучше, чем большие языковые модели.

145. Why It's Harder: The Unique Hurdles For Non-Experts Using AI Coding Tools

AI-инструменты для программирования могут стать игровым преимуществом для неэкспертных конечных пользователей. Исследование уникальных проблем, возникающих при применении LLM к программированию

AI-инструменты для программирования могут стать игровым преимуществом для неэкспертных конечных пользователей. Исследование уникальных проблем, возникающих при применении LLM к программированию

146. На Грок и вес дизайна

Рекентные проблемы с выходом Грока выявляют более глубокие структурные проблемы в моделировании соответствия.

Рекентные проблемы с выходом Грока выявляют более глубокие структурные проблемы в моделировании соответствия.

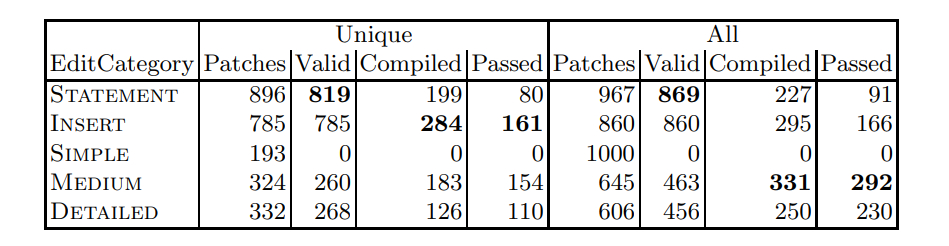

147. Дополнительные результаты: оценка кросс-языковой таксономии и в-depth анализ классификации

Исследуйте более подробные результаты кросс-языковой таксономии, детальную оценку согласия в аннотациях и общие метрики классификации для TnT-LLM.

Исследуйте более подробные результаты кросс-языковой таксономии, детальную оценку согласия в аннотациях и общие метрики классификации для TnT-LLM.

148. Работа модели и ловушки в автоматизированном деобфусцировании вредоносного ПО

Тестирование четырех LLM на скриптах Emotet показало, что GPT-4 лидировал в деобфусцировании, но все модели столкнулись с галлюцинациями и ограничениями запросов.

Тестирование четырех LLM на скриптах Emotet показало, что GPT-4 лидировал в деобфусцировании, но все модели столкнулись с галлюцинациями и ограничениями запросов.

149. TnT-LLM: высококачественное автоматизированное текстовое извлечение и эффективная классификация с помощью LLM

Обзор результатов TnT-LLM: автоматизированная генерация таксономии превосходит кластеризацию, LLM эффективны в качестве оценщиков (с оговорками), и так далее.

Обзор результатов TnT-LLM: автоматизированная генерация таксономии превосходит кластеризацию, LLM эффективны в качестве оценщиков (с оговорками), и так далее.

150. Редкое активное включение в MoE-моделях: расширение ReLUfication к Mixture-of-Experts

Откройте, как это открытие позволяет сократить FLOP на миллионы раз за счет MoE ReLUfication.

Откройте, как это открытие позволяет сократить FLOP на миллионы раз за счет MoE ReLUfication.

151. Таксономии, сгенерированные TnT-LLM: пользовательские намерения и метки доменов разговора

Просмотрите таксономии пользовательских намерений и меток доменов разговора, автоматически сгенерированные TnT-LLM и отредактированные человеком для текстовой классификации.

Просмотрите таксономии пользовательских намерений и меток доменов разговора, автоматически сгенерированные TnT-LLM и отредактированные человеком для текстовой классификации.

152. Мягкая биготрия AI-дома: потому что пользователи просто слишком неумны

Сатирическое разоблачение нарративов AI-дома: критическое мышление не исчезнет, институты не...

Сатирическое разоблачение нарративов AI-дома: критическое мышление не исчезнет, институты не...

автоматическое сокращение, и «апокалипсис» предполагает, что пользователи не способны.

153. AI-детективы и дело о маскирующихся дропперах

Используя 2 000 реальных скриптов дроппера Emotet, эксперимент проверяет способность LLMs деобфусцировать вредоносное ПО и извлекать информацию о угрозах на больших масштабах.

Используя 2 000 реальных скриптов дроппера Emotet, эксперимент проверяет способность LLMs деобфусцировать вредоносное ПО и извлекать информацию о угрозах на больших масштабах.

154. Agents 101 — Создание и развертывание AI-агентов в производство с помощью LangChain

Узнайте, как Langchain превращает простой запрос в полнофункциональный AI-агент, способный мыслить, действовать и запоминать.

Узнайте, как Langchain превращает простой запрос в полнофункциональный AI-агент, способный мыслить, действовать и запоминать.

155. TnT-LLM: Демократизация текстового анализа с помощью автоматизированной таксономии и масштабируемой классификации

TnT-LLM автоматизирует текстовый анализ, обеспечивая эффективную генерацию таксономии, классификацию с помощью LLM и демократизированный доступ к текстовым данным.

TnT-LLM автоматизирует текстовый анализ, обеспечивая эффективную генерацию таксономии, классификацию с помощью LLM и демократизированный доступ к текстовым данным.

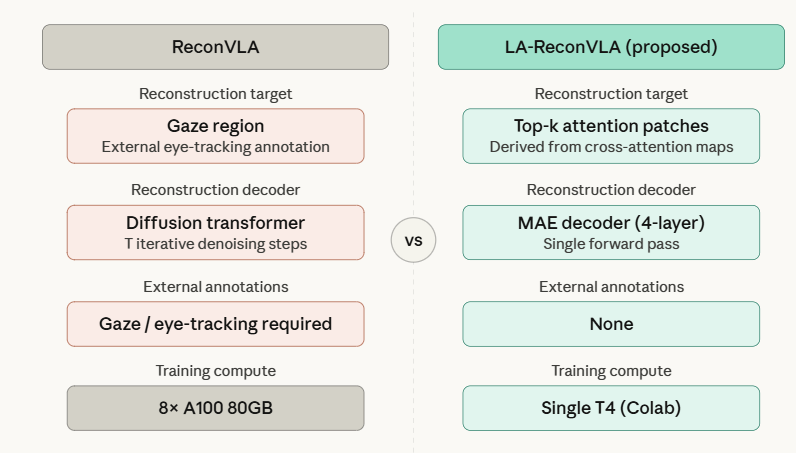

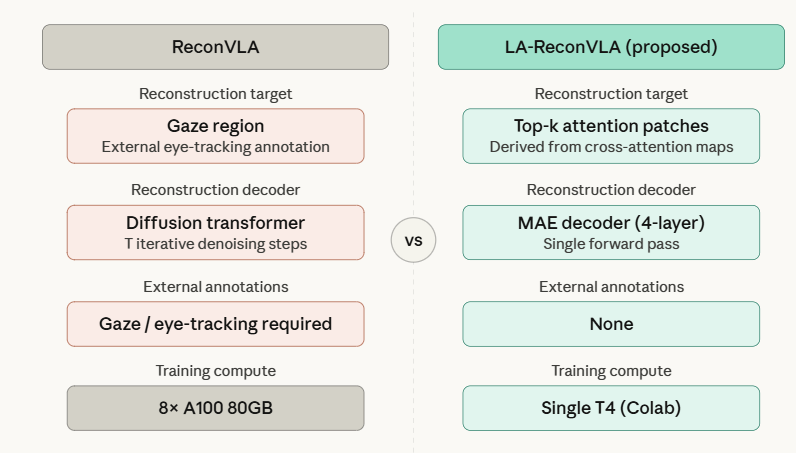

156. Beyond ReconVLA: Безаннотационная визуальная привязка с помощью языковой внимания и маскированной реконструкции

Новая подход заменяет аннотации взгляда на языково-ориентированную маскировку внимания, улучшая восприятие робота и снижая затраты на обучение.

Новая подход заменяет аннотации взгляда на языково-ориентированную маскировку внимания, улучшая восприятие робота и снижая затраты на обучение.

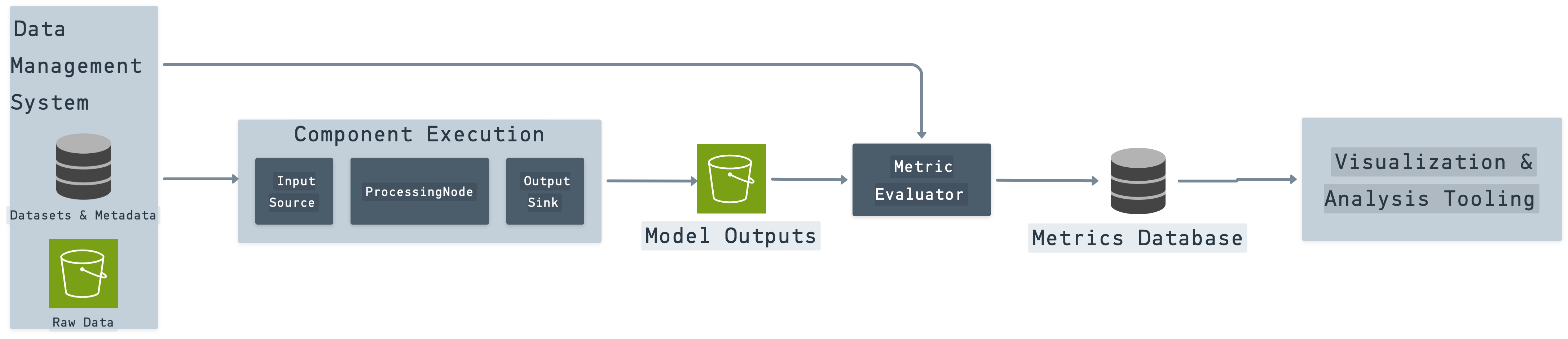

157. Stop Drowning in AI-Models: Трехпилонная рамка оценки

Практическая трехпилонная рамка оценки компьютерного зрения в производстве.

Практическая трехпилонная рамка оценки компьютерного зрения в производстве.

158. Рынок труда будущего при автоматизации и больших языковых моделях

🕵️♀️👷Вашу работу не автоматизирует ChatGPT 🤖, а это не все - это взгляд в подкапотное пространство реальных проблем, которые привели нас к сегодняшнему дню.

🕵️♀️👷Вашу работу не автоматизирует ChatGPT 🤖, а это не все - это взгляд в подкапотное пространство реальных проблем, которые привели нас к сегодняшнему дню.

159. Быстрый справочник по технологии LLM-генерации кода и ее ограничениям

159. Быстрый справочник по технологиям LLM для генерации кода и их ограничениям

Этот обзор предоставляет быстрый справочник по технологиям, лежащим в основе LLM для генерации кода, охватывающий архитектуру Transformer

Этот обзор предоставляет быстрый справочник по технологиям, лежащим в основе LLM для генерации кода, охватывающий архитектуру Transformer

160. Beyond The Final Answer: Why Non-Experts Can't Spot Bad AI Code

Рассмотрим критическую проблему верификации кода, сгенерированного AI, для непрофессиональных программистов. Узнайте, почему они полагаются на «просмотр» окончательного результата

Рассмотрим критическую проблему верификации кода, сгенерированного AI, для непрофессиональных программистов. Узнайте, почему они полагаются на «просмотр» окончательного результата

161. 100 Complex LLM Terminology Explained in One Single & One Simple Sentence

Каждое техническое термин о больших языковых моделях и генеративном AI объясняется сначала кратко, а затем просто, чтобы укрепить ваше понимание.

Каждое техническое термин о больших языковых моделях и генеративном AI объясняется сначала кратко, а затем просто, чтобы укрепить ваше понимание.

162. TnT-LLM Implementation Details: Pipeline Design, Robustness, and Efficiency

Рассмотрим техническую реализацию TnT-LLM, включая дизайн пайплайна, методы обеспечения надежности и стратегии выбора модели

Рассмотрим техническую реализацию TnT-LLM, включая дизайн пайплайна, методы обеспечения надежности и стратегии выбора модели

163. Five Architectural Patterns That Fix What's Broken in RAG

Семантический RAG предполагает, что вектор запроса находится рядом с вектором ответа.

Семантический RAG предполагает, что вектор запроса находится рядом с вектором ответа.

164. Data Scraping: Do Large Language Models Cross Boundaries by Training on Content from Everyone

Хотя скрапинг позволил моделям добиться успеха, чистые данные станут все более важными

Хотя скрапинг позволил моделям добиться успеха, чистые данные станут все более важными

165. Researchers in UAE Create AI That Can Describe Images in Perfect Detail

Исследователи в университете Мохаммеда бин Зайда разработали модель AI, которая может создавать текстовые разговоры, связанные с конкретными объектами или регионами в изображении.

Исследователи в университете Мохаммеда бин Зайда разработали модель AI, которая может создавать текстовые разговоры, связанные с конкретными объектами или регионами в изображении.

166. Топология значения: В направлении "коперативной теории полей" для искусственной интеллектии

Смелое утверждение о том, что AI должна выйти за рамки языка и токенов и перейти к единой топологической модели, где слова, лица и звуки делятся одним пространством значений.

Смелое утверждение о том, что AI должна выйти за рамки языка и токенов и перейти к единой топологической модели, где слова, лица и звуки делятся одним пространством значений.

167. Выделение скрытой загрузки моловераплатформ с помощью AI-поддеревьеллмс

LLMs могут автоматизировать выделение обфусцированных моловераплатформ, упрощая угрозную информацию, даже когда атакующие меняют упаковку и обфускацию.

LLMs могут автоматизировать выделение обфусцированных моловераплатформ, упрощая угрозную информацию, даже когда атакующие меняют упаковку и обфускацию.

168. Как использовать большие языковые модели для поддержки тематического анализа в исследованиях по эмпирическому праву

Мы предлагаем новую рамку, способствующую эффективному сотрудничеству юриста с большим языковым моделям (LLM) для генерации первичных кодов

Мы предлагаем новую рамку, способствующую эффективному сотрудничеству юриста с большим языковым моделям (LLM) для генерации первичных кодов

169. Выделение потребностей пользователей с помощью Chat-GPT для рекомендации диалогов

Исследуйте интеграцию ChatGPT в интерактивные системы рекомендаций, где оно служит как модель диалога, так и движок рекомендаций.

Исследуйте интеграцию ChatGPT в интерактивные системы рекомендаций, где оно служит как модель диалога, так и движок рекомендаций.

170. Открытая LLM: Оценка и разработка приложений на основе открытого

Как выбрать наиболее подходящую модель для вашего приложения? Анализ оценки и разработки приложений на основе открытых больших языковых моделей.

Как выбрать наиболее подходящую модель для вашего приложения? Анализ оценки и разработки приложений на основе открытых больших языковых моделей.

171. Строение гибкой рамки для мультимодальной входных данных в больших языковых моделях

Откройте AnyModal, гибкую рамку, упрощающую обучение мультимодальным большим языковым моделям (LLM). Интегрируйте текст, изображения и аудио безболезненно.

Откройте AnyModal, гибкую рамку, упрощающую обучение мультимодальным большим языковым моделям (LLM). Интегрируйте текст, изображения и аудио безболезненно.

172. Почему статический анализ страдает от современного моловера

![]()

Малварь использует пакетировщики, крипторы и обфусцирующие программы, чтобы избежать статического анализа, вызывая сложности для аналитиков в адаптации методов обнаружения и анализа.

173. Сознание: AI, LLMs—Сознание?

174. Тrap версии FrankenPHP: Почему ваш стек Laravel Octane не использует PHP 8.5

175. Максимизация возможностей NLP с помощью больших моделей языка

176. Этика локальных LLM: Ответ на манифест Zuckerberg «Открытый исходный код AI»

177. UI: Почему это реальный бутылочный горлышко AI-агента

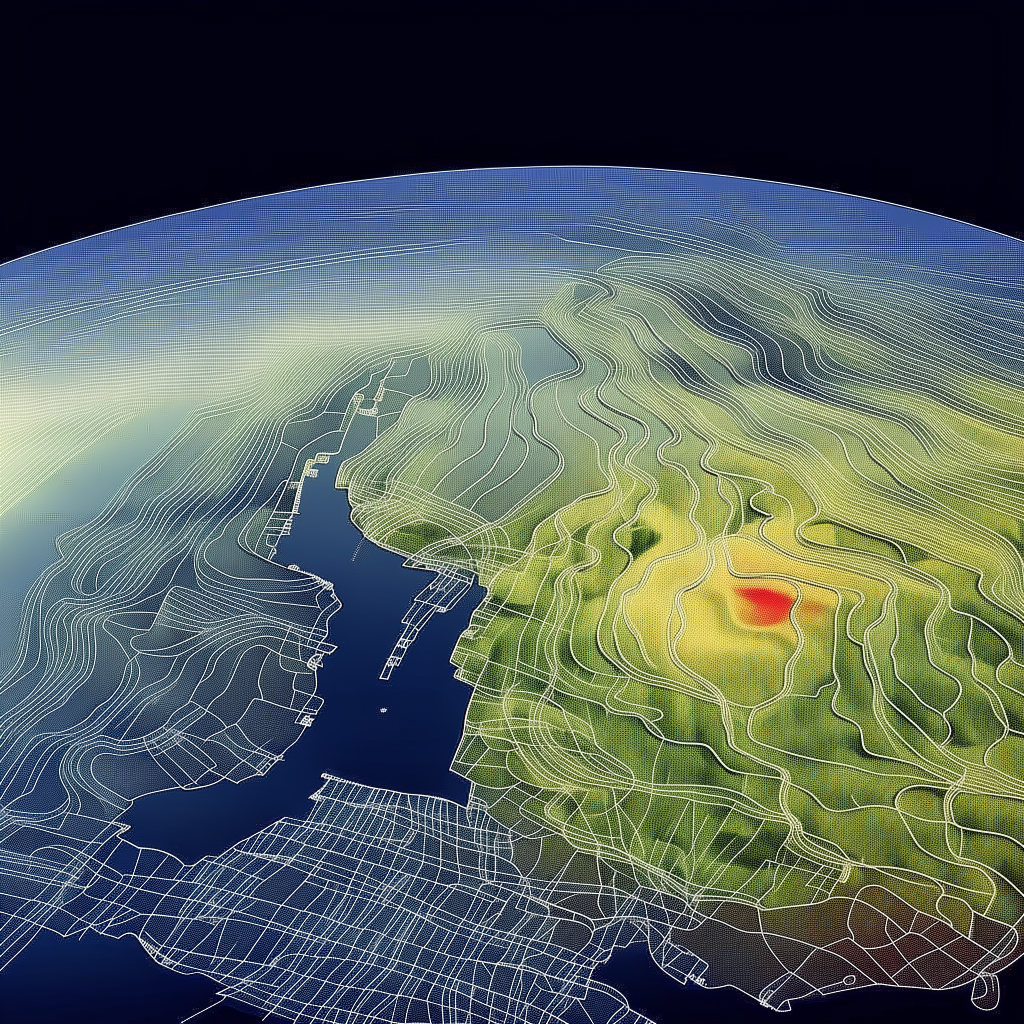

178. В сторону автоматического создания подписей к спутниковым изображениям с помощью LLM: Резюме и Введение

179. Почему модели диффузии проваливаются в B2B-стилировании волос

Пайплайн "Архитектор-Строитель" достигает трехмерной согласованности в GenAI для продуктов B2B SaaS.

180. Возможности больших моделей языка: хакинг или помощь?

Исследование возможностей агентов LLM: изучение взлома веб-сайтов

Исследование возможностей агентов LLM: изучение взлома веб-сайтов

181. Мыслить как компьютер: пропущенная навык для непрофессионалов, использующих AI

Исследование критической проблемы для конечных пользователей-программистов: отсутствие компьютерного мышления. Узнайте, как инструменты, ассистируемые LLM, должны быть умнее

Исследование критической проблемы для конечных пользователей-программистов: отсутствие компьютерного мышления. Узнайте, как инструменты, ассистируемые LLM, должны быть умнее

182. Из сценария в краткое содержание: умный способ сжимать фильмы

Масштабируемый AI-пipeline для суммирования и сжатия важных сцен из сценариев фильмов с высокой точностью.

Масштабируемый AI-пipeline для суммирования и сжатия важных сцен из сценариев фильмов с высокой точностью.

183. Использование больших моделей языка для поддержки тематического анализа: признание и что дальше?

Нам предложили новую LLM-поддерживаемую рамку для тематического анализа, и мы оценили ее производительность на анализе мнений судебных органов

Нам предложили новую LLM-поддерживаемую рамку для тематического анализа, и мы оценили ее производительность на анализе мнений судебных органов

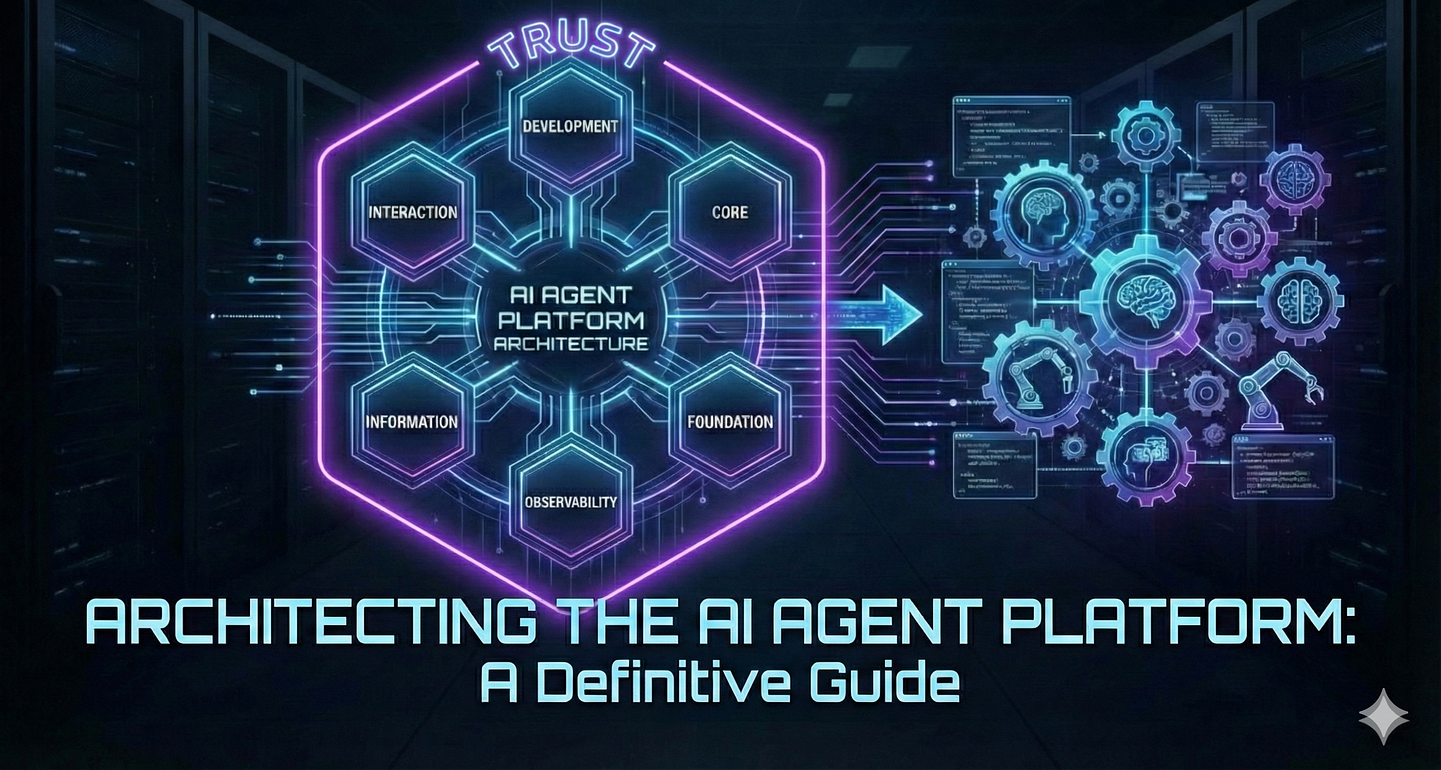

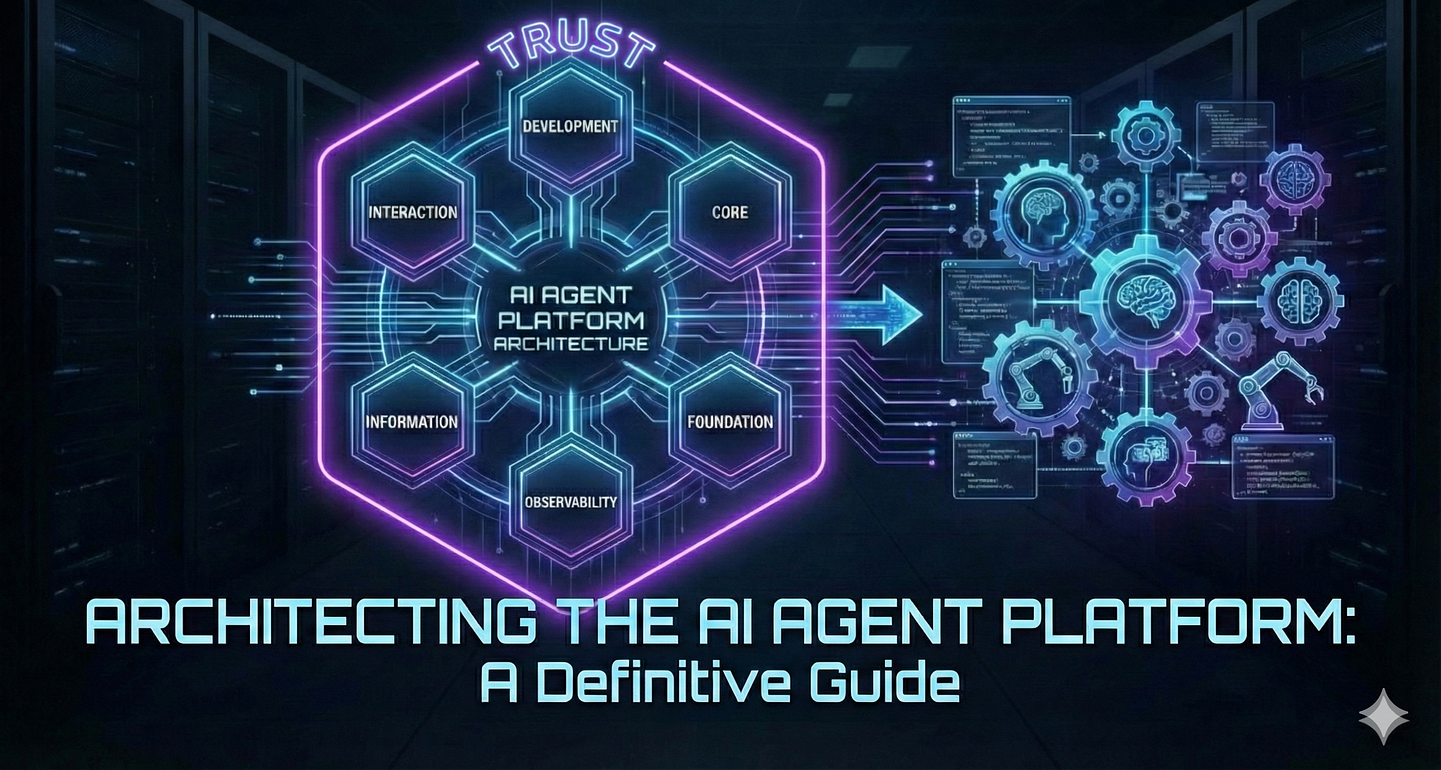

184. 7-слойная схема для обслуживания, защиты и наблюдения за агентами AI на масштабе

От ПК до Фабрики: разбор 7-слойной архитектуры платформы агента AI для корпоративной масштабируемости и контроля

От ПК до Фабрики: разбор 7-слойной архитектуры платформы агента AI для корпоративной масштабируемости и контроля

185. Быстрый справочник по квантованию для LLM

Квантование — это техника, которая уменьшает точность весов и активаций модели

Квантование — это техника, которая уменьшает точность весов и активаций модели

186. Метод "Сначала суммируйте, затем ищите" для длинного видео-опроса: вывод

В этой статье исследователи изучают нулевую задачу видео-QA с помощью GPT-3, превосходя обученные модели, используя повествовательную

В этой статье исследователи изучают нулевую задачу видео-QA с помощью GPT-3, превосходя обученные модели, используя повествовательную

Обзоры и визуальное сопоставление.

187. Что такое LoRA? Объяснение низкочастотной адаптации LLM

Чтобы заставить большие языковые модели работать в рамках вашего бюджета как по вычислительным затратам, так и по памяти, LoRA является фундаментальным алгоритмом квантования.

Чтобы заставить большие языковые модели работать в рамках вашего бюджета как по вычислительным затратам, так и по памяти, LoRA является фундаментальным алгоритмом квантования.

188. Может ли кто-то сейчас кодировать? Исследование помощи AI для непрофессиональных программистов

Приходите и посмотрите, как кодирование меняется с помощью языковых моделей AI. Поделитесь реальными историями и исследованиями, показывающими, как сильно это отличается от программирования с этими инструментами

Приходите и посмотрите, как кодирование меняется с помощью языковых моделей AI. Поделитесь реальными историями и исследованиями, показывающими, как сильно это отличается от программирования с этими инструментами

189. Доказательство пользы CLI-инструментов над MCP-серверами в агентном AI

Я построил 31 открытый исходный код CLI-инструмент Rust для агентов AI и измерил 35x лучшую эффективность токенов по сравнению с MCP-серверами. Здесь есть стек, принятые решения по дизайну и почему …

Я построил 31 открытый исходный код CLI-инструмент Rust для агентов AI и измерил 35x лучшую эффективность токенов по сравнению с MCP-серверами. Здесь есть стек, принятые решения по дизайну и почему …

190. Как создать реалистичные разговоры AI

Понимайте параллели с плагинами для настраиваемых помощников AI и роль GPT-4 в генерации естественных взаимодействий.

Понимайте параллели с плагинами для настраиваемых помощников AI и роль GPT-4 в генерации естественных взаимодействий.

191. Управление онлайн-репутацией в эпоху AI

Управление онлайн-репутацией теперь включает не только мнения людей, но и мнения AI. Отслеживание репутации в ответах AI — это новый SEO!

Управление онлайн-репутацией теперь включает не только мнения людей, но и мнения AI. Отслеживание репутации в ответах AI — это новый SEO!

192. Выяснилось, что 30% вашего модели AI — это просто пустой пространство

Модели AI не так велики. Новые исследования показывают, что примерно 30% их размера — это просто пустое пространство из-за устаревших предположений об хранении.

Модели AI не так велики. Новые исследования показывают, что примерно 30% их размера — это просто пустое пространство из-за устаревших предположений об хранении.

193. Как сделать код понятным: главная проблема понимания в программировании AI

Исследуйте основную проблему программирования AI: понимание кода. Узнайте, почему сгенерированный код сложно понять и как это влияет на точность

Исследуйте основную проблему программирования AI: понимание кода. Узнайте, почему сгенерированный код сложно понять и как это влияет на точность

194. Должны ли выходные данные машинного обучения иметь право на защиту свободы слова?

Поскольку генеративные системы AI производят все более сложный контент, возникает сложный вопрос: должны ли их выходные данные иметь право на защиту свободы слова?

Поскольку генеративные системы AI производят все более сложный контент, возникает сложный вопрос: должны ли их выходные данные иметь право на защиту свободы слова?

195. Меч слов: эволюция инъекции подсказок

Исследуйте трехуровневую эволюцию инъекции подсказок: от социальной инженерии в Tensor Trust до fragmentation BPE и логических переключателей RAG в Web3-играх.

Исследуйте трехуровневую эволюцию инъекции подсказок: от социальной инженерии в Tensor Trust до fragmentation BPE и логических переключателей RAG в Web3-играх.

196. Где скрываются глюк-токены: Общие шаблоны в словарях токенизатора LLM

Нетренированные токены часто происходят от неиспользованных байтовых токенов, слияния фрагментов и специальных токенов-шаблонов, найденных в основных LLM, независимо от архитектуры.

Нетренированные токены часто происходят от неиспользованных байтовых токенов, слияния фрагментов и специальных токенов-шаблонов, найденных в основных LLM, независимо от архитектуры.

197. Как построить чат-бот, который рассказывает средневековые истории с помощью платформы AI Oracle

Oracle Cloud Infrastructure — это одна из крупных облачных платформ, доступных на рынке, вместе с AWS, Google Cloud и Azure.

Oracle Cloud Infrastructure — это одна из крупных облачных платформ, доступных на рынке, вместе с AWS, Google Cloud и Azure.

198. Просмотр данных: блоги, форумы и рост инструментов LLM

Этот приложенный раздел содержит список статей и тем на Hacker News, которые были проанализированы для понимания реальных-world опыта разработчиков, использующих Copilot.

Этот приложенный раздел содержит список статей и тем на Hacker News, которые были проанализированы для понимания реальных-world опыта разработчиков, использующих Copilot.

199. Великое преобразование: как LLM изменяют каждый программный процесс

Этот заключительный раздел исследует глубокое преобразование, которое помощь LLM приносит в весь программный опыт.

Этот заключительный раздел исследует глубокое преобразование, которое помощь LLM приносит в весь программный опыт.

200. В сторону автоматической генерации подписей к спутниковым изображениям с помощью LLM: методология

Исследователи представляют ARSIC, метод для генерации подписей к изображениям дистанционного зондирования с помощью LLM и API.улучшение точности и снижение потребности в ручной маркировке.

Исследователи представляют ARSIC, метод для генерации подписей к изображениям дистанционного зондирования с помощью LLM и API.улучшение точности и снижение потребности в ручной маркировке.

201. Внедрение возможностей NLP в существующую стек-приложение легче, чем когда-либо: почему

Ускорение разработки, создание контента и ускорение принятия данных решений с помощью новых инструментов ML, которые делают легким внедрение NLP в стек-технологии.

Ускорение разработки, создание контента и ускорение принятия данных решений с помощью новых инструментов ML, которые делают легким внедрение NLP в стек-технологии.

202. Навигация с помощью больших моделей языка: подробности реализации

В этой статье мы изучаем, как «семантическая догадка», производимая языковыми моделями, может быть использована в качестве руководящей онтологии для алгоритмов планирования.

В этой статье мы изучаем, как «семантическая догадка», производимая языковыми моделями, может быть использована в качестве руководящей онтологии для алгоритмов планирования.

203. Instagram переполнен содержанием, сгенерированным AI, и Meta не кажется, что заботится

Сеть AI-сгенерированных инфлюенсеров, изображенных с синдромом Дауна, монетизируются через взрослый контент на платформах, таких как Fanvue.

Сеть AI-сгенерированных инфлюенсеров, изображенных с синдромом Дауна, монетизируются через взрослый контент на платформах, таких как Fanvue.

204. Инфраструктура данных, стоящая за каждым успешным стартапом AI

95% стартапов AI проваливаются, потому что их данные ломаются первыми. Здесь, как настоящие победители строят прочную инфраструктуру данных с помощью Bright Data, чтобы остаться в живых.

95% стартапов AI проваливаются, потому что их данные ломаются первыми. Здесь, как настоящие победители строят прочную инфраструктуру данных с помощью Bright Data, чтобы остаться в живых.

205. Excel vs. Python: как целевое язык меняет все для непрофессионалов

Обсуждение того, почему инструмент может выбрать Python за счет его богатых API, даже если пользователь более знаком с формулами Excel, и вызванные этим проблемы.

Обсуждение того, почему инструмент может выбрать Python за счет его богатых API, даже если пользователь более знаком с формулами Excel, и вызванные этим проблемы.

206. Критика «звучащего» написания AI игнорирует более глубокие культурные предубеждения

Нам не следует позволять моделям AI отнимать части нашего языка.

Нам не следует позволять моделям AI отнимать части нашего языка.

207. Как AI уменьшает нашу точку зрения на мир

Генеративный AI может уменьшить разнообразие знаний, что приводит к коллапсу знаний.

Генеративный AI может уменьшить разнообразие знаний, что приводит к коллапсу знаний.

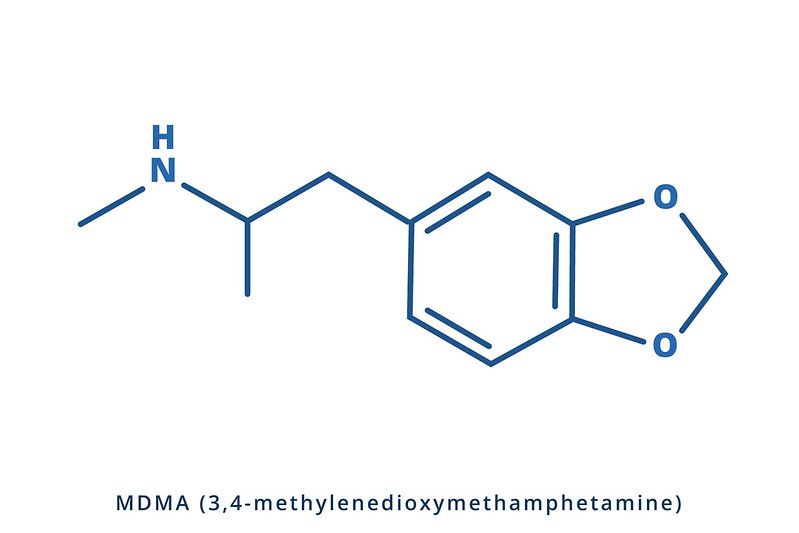

208. Психеделики | LLMs: Есть ли связь между психеделиками, LLMs и психическим заболеванием?

Раскрыть связь между психеделиками, LLMs и психическим заболеванием.

Раскрыть связь между психеделиками, LLMs и психическим заболеванием.

209. Долина чуждости кода: почему код, сгенерированный AI, так сложен для отладки?

Разработчики разделились во мнениях, является ли код, сгенерированный AI, действительно экономичным. Исследование компромиссов между быстрым написанием кода и затраченным временем и усилиями.

Разработчики разделились во мнениях, является ли код, сгенерированный AI, действительно экономичным. Исследование компромиссов между быстрым написанием кода и затраченным временем и усилиями.

210. MIVPG: Мультиинстансивизуальный промптгенератор для MLLMs

MIVPG улучшает MLLMs, используя Мультиинстансивное обучение для включения коррелированной визуальной информации.

MIVPG улучшает MLLMs, используя Мультиинстансивное обучение для включения коррелированной визуальной информации.

211. Можно ли большим языковым моделям развить игровую зависимость?

Нам не нужно расплывчатые решения, такие как "добавьте безопасные ограничения в ваши запросы", у нас есть механистическое понимание, позволяющее нам проектировать целевые вмешательства.

Нам не нужно расплывчатые решения, такие как "добавьте безопасные ограничения в ваши запросы", у нас есть механистическое понимание, позволяющее нам проектировать целевые вмешательства.

212. Героизм в Голодеке: Построение AI-компаньонов для конечной границы

LLMs — это модели данных, обученные на колоссальных объемах текстовой информации, поглощающие книги, статьи, код и другие формы написанной информации.

LLMs — это модели данных, обученные на колоссальных объемах текстовой информации, поглощающие книги, статьи, код и другие формы написанной информации.

213. Большые языковые модели (LLMs) для образовательных приложений

Исследуйте растущую роль GPT-моделей в образовании, детально рассмотрев их использование через запросы и тонировку для задач, таких как генерация обратной связи.

Исследуйте растущую роль GPT-моделей в образовании, детально рассмотрев их использование через запросы и тонировку для задач, таких как генерация обратной связи.

214. Никто не использует тестирование как тестирование LLM-приложений (это будет проблемой)

Большинство команд развертывают LLM и RAG-приложения без реального набора тестов — это шестилучевая система тестирования, которая решает эту проблему.

Большинство команд развертывают LLM и RAG-приложения без реального набора тестов — это шестилучевая система тестирования, которая решает эту проблему.

215. Сила динамического кодирования: RECKONING превосходит нулевую точку GPT-3.5 по устойчивости к отвлекающим факторам

Результаты RECKONING значительно превышают как нулевую, так и несколько точек GPT-3.5 по навыкам.

Результаты RECKONING значительно превышают как нулевую, так и несколько точек GPT-3.5 по навыкам.

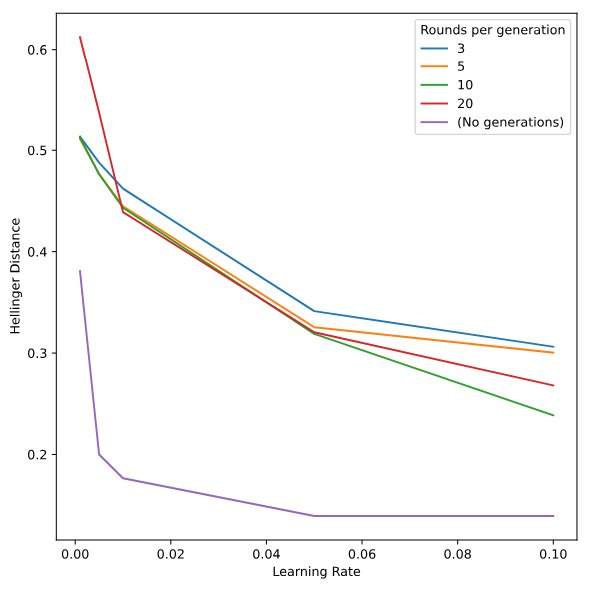

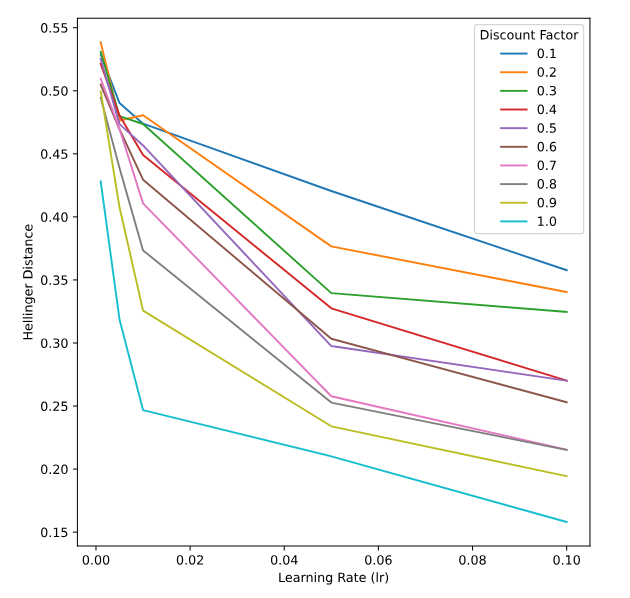

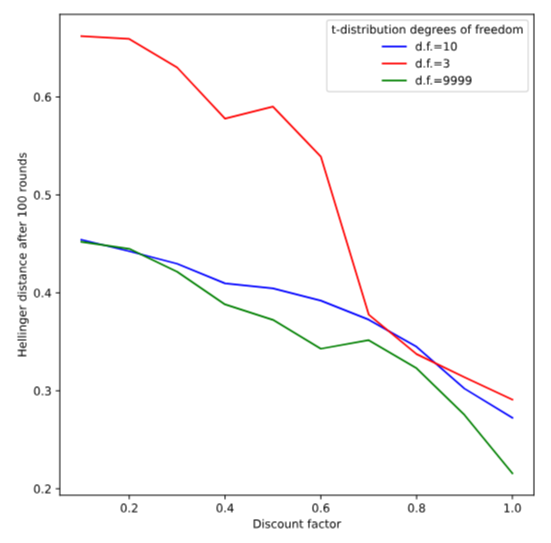

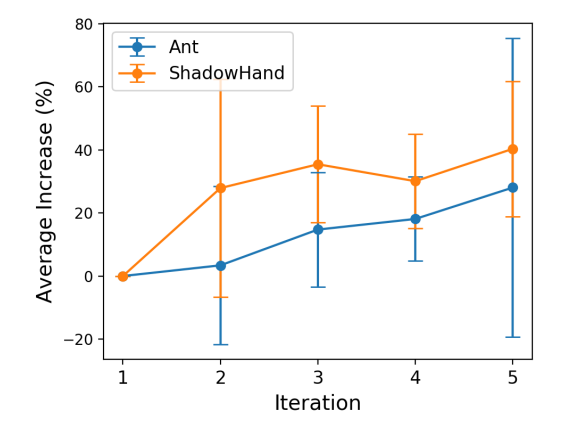

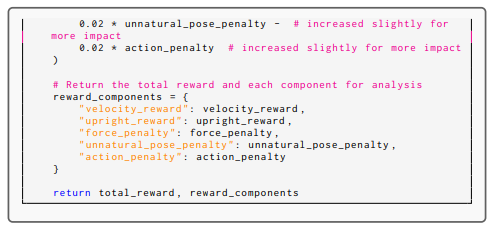

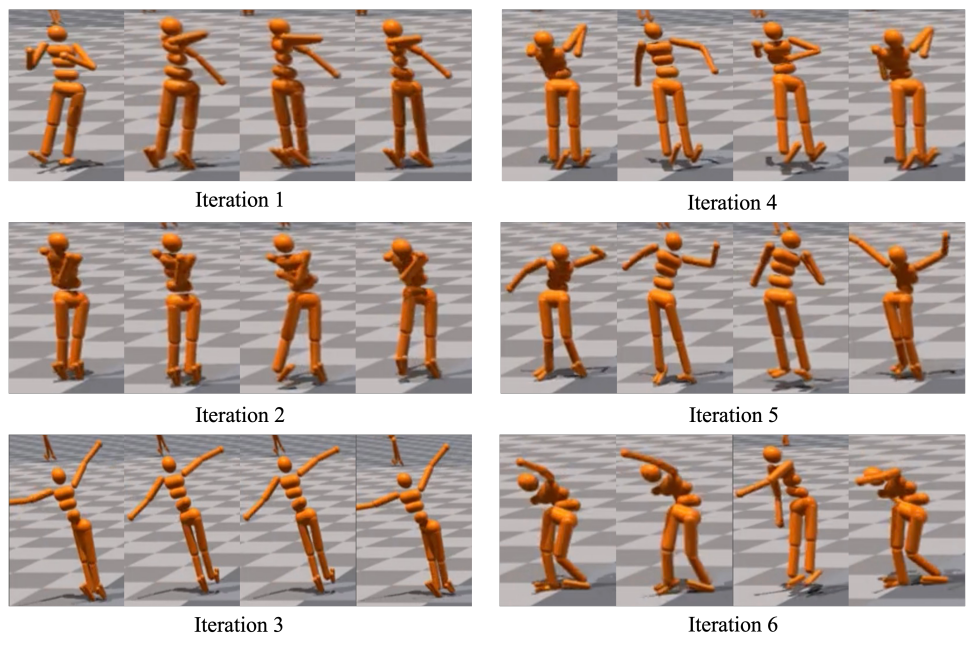

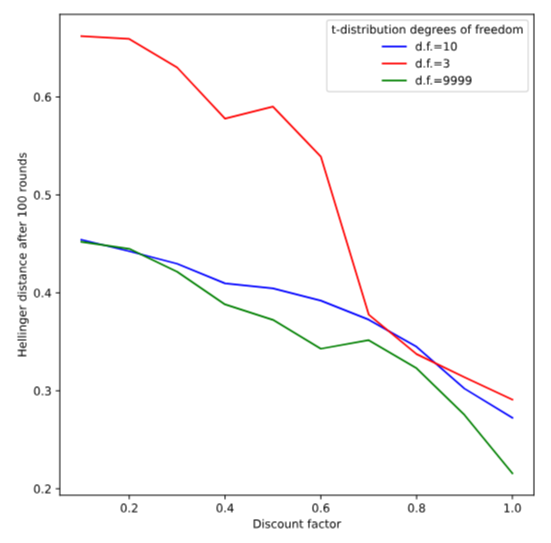

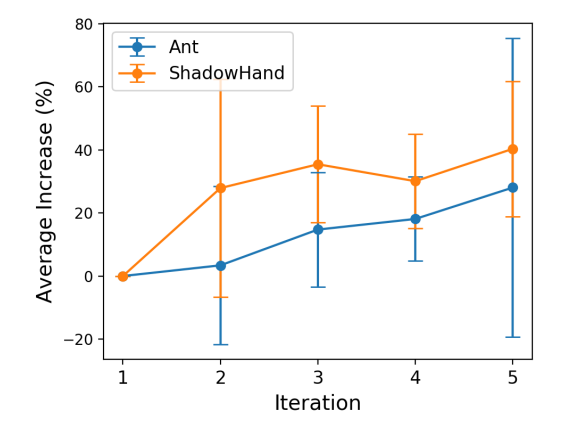

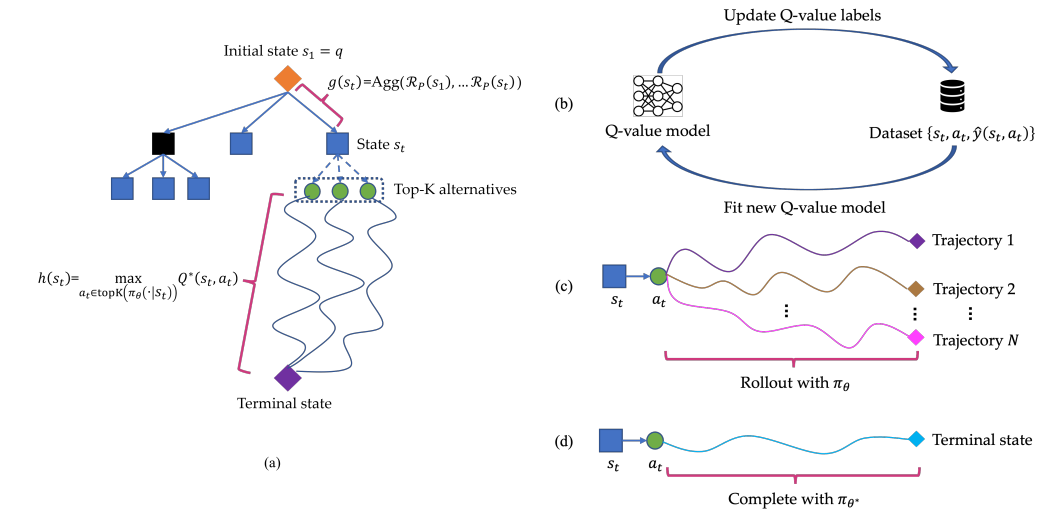

216. Награждение редкого: как уникальность-осведомленная RL устраняет коллапс исследования

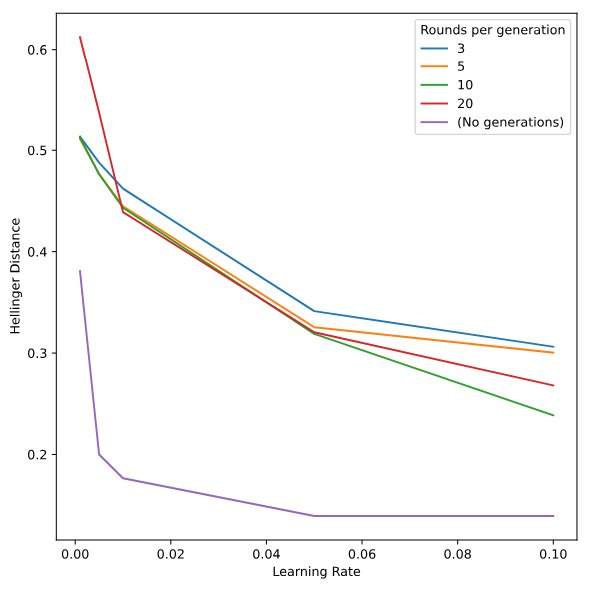

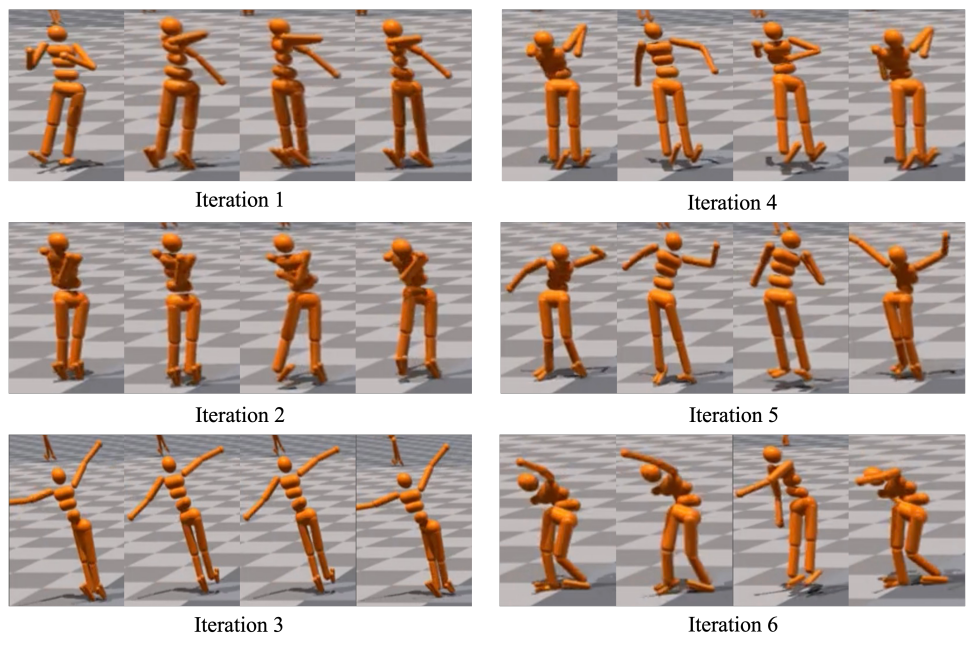

Это краткое изложение статьи "Награждение редкого: уникальность-осведомленная RL для творческого решения проблем в LLM" [https://www.aimodels.fyi/papers/arxiv/rewarding-rare-uniqueness-aware-rl-creative-problem?utm_source=hackernoon&utm_medium=referral]. Если вам нравятся такие анализы, присоединяйтесь к AIModels.fyi [https://www.aimodels.fyi/?utm_source=hackernoon&utm_medium=referral] или следите за нами на Twitter [https://x.com/aimodelsfyi].

Это краткое изложение статьи "Награждение редкого: уникальность-осведомленная RL для творческого решения проблем в LLM" [https://www.aimodels.fyi/papers/arxiv/rewarding-rare-uniqueness-aware-rl-creative-problem?utm_source=hackernoon&utm_medium=referral]. Если вам нравятся такие анализы, присоединяйтесь к AIModels.fyi [https://www.aimodels.fyi/?utm_source=hackernoon&utm_medium=referral] или следите за нами на Twitter [https://x.com/aimodelsfyi].

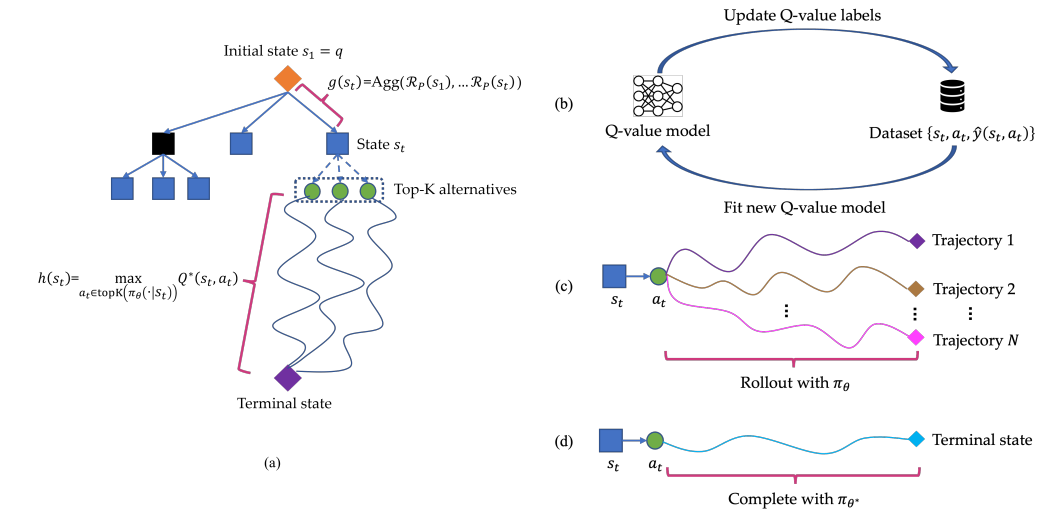

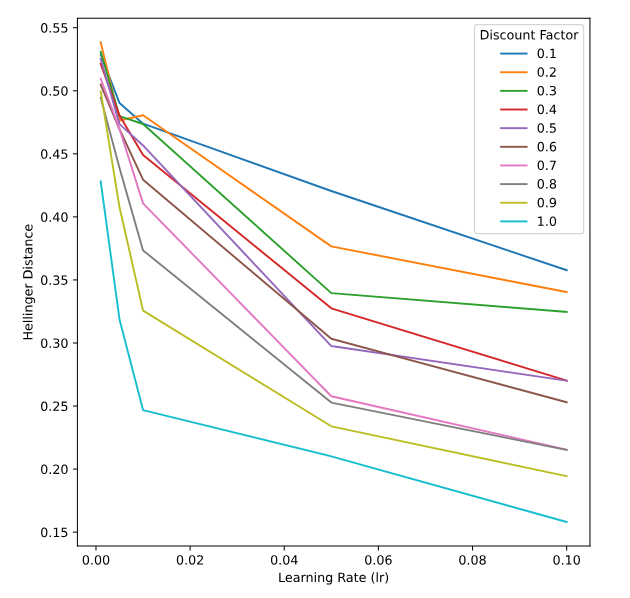

ПРОБЛЕМА КОЛЛАПСА РАЗВОРЕНИЯ

Когда вы обучаете языковую модель с помощью метода подкрепления для решения математических задач, происходит что-то противоречивое. Вы награждаете правильные ответы. Модель находит одну надежную дорогу к правильности и, по сути, останавливается исследовать. Каждый роллбэк становится slight вариацией одной и той же темы. Pass@1 выглядит хорошо, вы решаете проблемы постоянно. Но pass@k застывает. Если вы пробуете сто раз, вы не получаете сто разных решений, вы получаете сто версий одного и того же решения.

Это коллапс исследования, и это открывает что-то сломанное в том, как мы думали о RL для языковых моделей. Стандартный подход присваивает награды на уровне токена, во время генерации. Когда токен участвует в правильном окончательном ответе, он получает подкрепление. С течением времени политика учитывает последовательность токенов, которая наиболее надежно производит награды. Другие валидные пути существуют, но они не имеют такого же подкрепления. Они не накапливают уверенность в том же порядке. Итак, политика сужается.

Напряжение реально. Модель, которая находит одну хорошую стратегию надежно, с точки зрения pass@1, делает именно то, что вы просили. Но с практической точки зрения, это упущенная возможность. Если вы готовы пробовать несколько раз, разнообразная модель должна дать вам больше шансов найти правильный ответ. Вместо этого вы получаете повторяемость. Этот разрыв между тем, что метрика измеряет, и тем, что способность должна обеспечить, — это где проблема находится.

ПОЧЕМУ МЫ ИЗМЕРЯЕМ НЕ ТО, ЧТО НУЖНО

Неявное предположение, которое движет большинством работ по RL для языковых моделей, заключается в том, что лучшие локальные награды создают лучшую глобальную разнообразность. Обучайте каждый токен принимать правильные решения, и роллбэки будут естественным образом разнообразны. Это интуитивно. Это также ложно.

На самом деле происходит то, что хорошие локальные решения укрепляют себя. Выбор токена, который приводит к правильному ответу, получает положительный сигнал. Когда модель снова должна решить подобную проблему, этот выбор токена становится чуть более вероятным. И на следующий раз, еще более вероятным. Градиент всегда указывает в ту же привлекательную область. Политика не перестает исследовать, она исследует эффективно прямо в одну и ту же впадину.

Исходная причина не в случайности или недостаточном обучении. Это фундаментальное несоответствие между тем, что мы измеряем, и тем, что мы хотим. Мы измеряем поведение на уровне токена и надеемся на поведение на уровне роллбэка.