Начнем изучать Llm посредством этих 212 бесплатных статей. Они расположены в порядке данных по взаимодействию читателей HackerNoon. Посетите Learn Repo или LearnRepo.com, чтобы найти самые популярные статьи о любой технологии.

ChatGPT, Gemini и LLaMA — это некоторые из самых популярных больших языковых моделей. Но это не все. Узнайте больше сегодня!

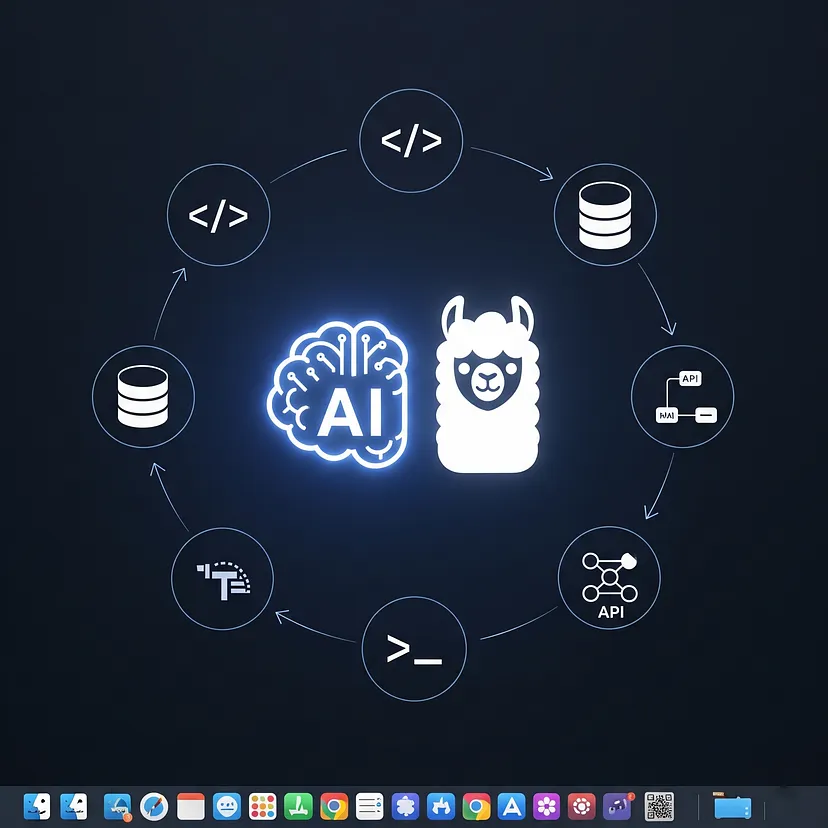

1. Как запустить свой собственный локальный LLM: Обновленная версия 2024 года

Узнайте, как запускать Генеративные AI-модели локально с помощью Hugging Face Transformers, gpt4all, Ollama, localllm и Llama 2.

Узнайте, как запускать Генеративные AI-модели локально с помощью Hugging Face Transformers, gpt4all, Ollama, localllm и Llama 2.

2. Разблокировка структурированной JSON-данных с помощью LangChain и GPT: Шаг за шагом

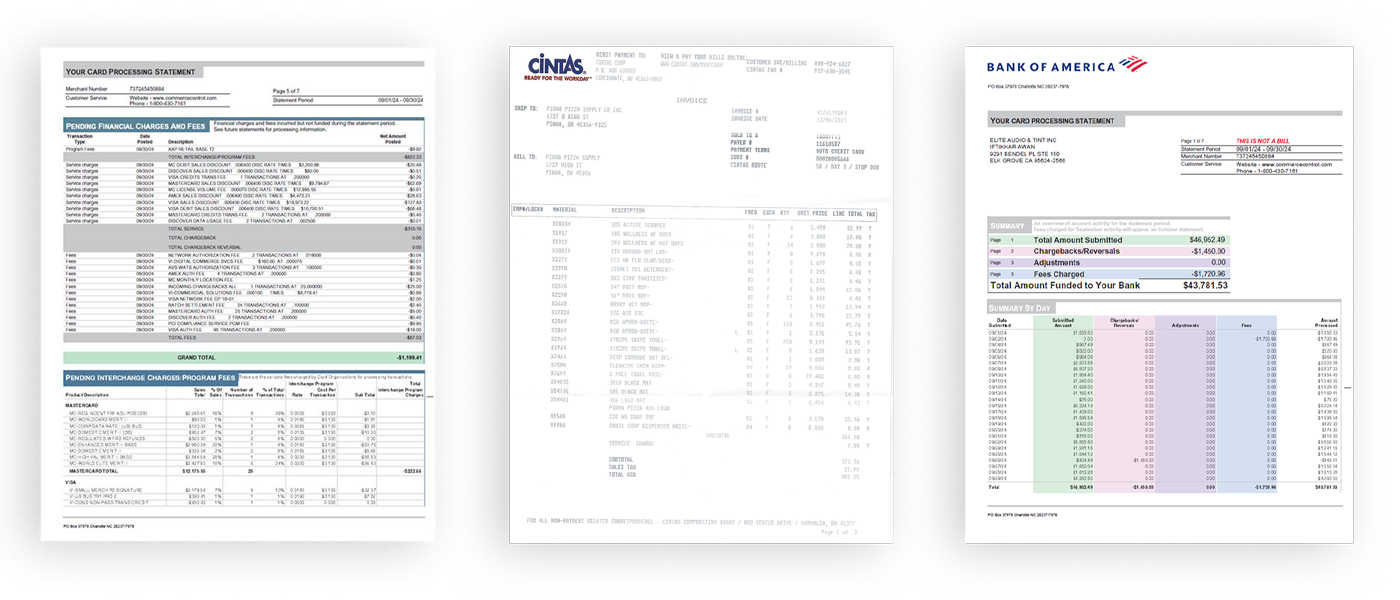

Манипулирование структурированными данными (из PDF) с помощью модели за основу ChatGPT, LangChain и Python для мощных AI-приложений.

Манипулирование структурированными данными (из PDF) с помощью модели за основу ChatGPT, LangChain и Python для мощных AI-приложений.

3. Как построить компьютер стоимостью $300 для GPU-необладающих

Компьютер стоимостью $300 для запуска Генеративных AI-моделей локально, например, для инференса больших языковых моделей и стабильной диффузии изображений.

Компьютер стоимостью $300 для запуска Генеративных AI-моделей локально, например, для инференса больших языковых моделей и стабильной диффузии изображений.

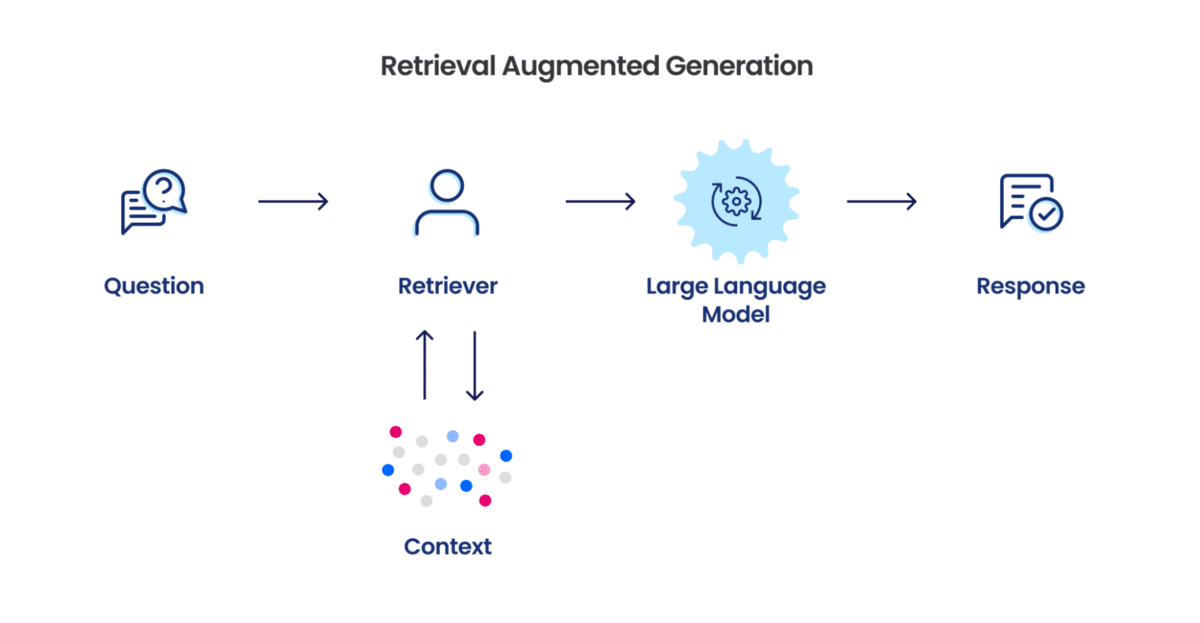

4. Упрощение Advanced RAG при создании федеративных систем для ваших цифровых продуктов

RAG - Восстановление и генерация, Векторная база данных, Базовый пайплайн, Разработка продукта

RAG - Восстановление и генерация, Векторная база данных, Базовый пайплайн, Разработка продукта

5. Обещание и потенциал LLM в криптовалюте

Мы рассматриваем 8 основных потенциальных применений LLM в криптовалюте. LLM может быть полезен для всех участников в криптовалюте; LLM можно интегрировать в существующие проекты

Мы рассматриваем 8 основных потенциальных применений LLM в криптовалюте. LLM может быть полезен для всех участников в криптовалюте; LLM можно интегрировать в существующие проекты

6. Что такое Diffusion LLM и почему это важно?

Что такое Diffusion LLM, и почему это важно. В контексте Inception Labs, выпустивших Mercury Coder.

Что такое Diffusion LLM, и почему это важно. В контексте Inception Labs, выпустивших Mercury Coder.

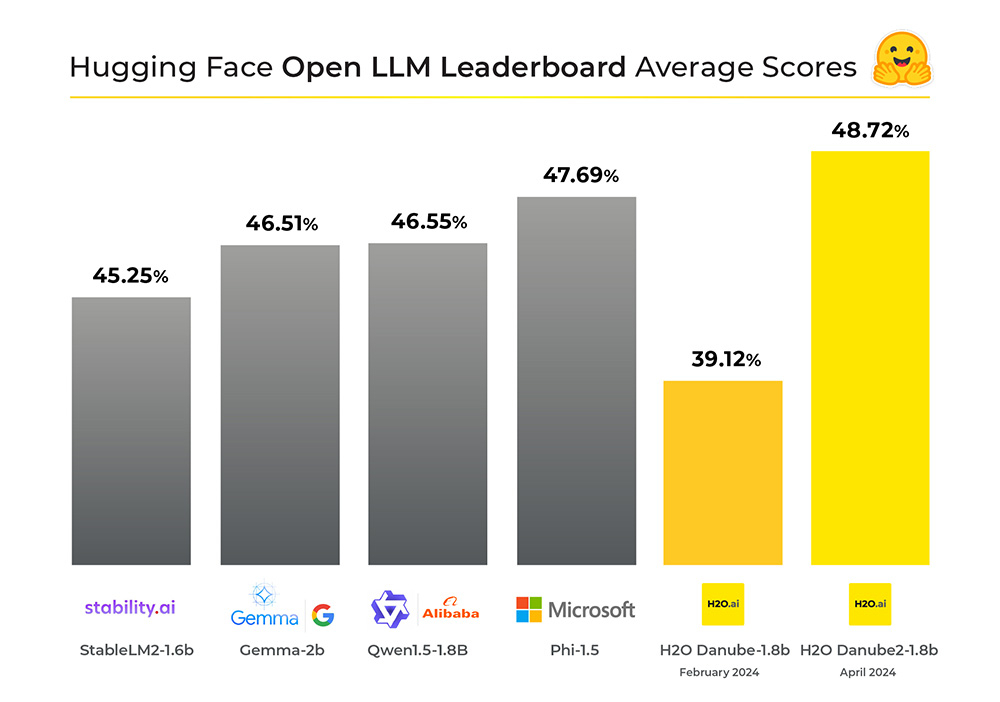

7. Малые языковые модели закрывают разрыв с большими моделями

Малые языковые модели, которые могут выполнять сложные задачи, такие как генерация текста и ответы на вопросы, могут быть полезны в различных приложениях.

Малые языковые модели, которые могут выполнять сложные задачи, такие как генерация текста и ответы на вопросы, могут быть полезны в различных приложениях.

8. Как выбрать между LLM: малыми и большими

Малые языковые модели, которые могут выполнять сложные задачи, такие как генерация текста и ответы на вопросы, могут быть полезны в различных приложениях.

Малые языковые модели, которые могут выполнять сложные задачи, такие как генерация текста и ответы на вопросы, могут быть полезны в различных приложениях.

9. Как улучшить производительность LLM

Малые языковые модели, которые могут выполнять сложные задачи, такие как генерация текста и ответы на вопросы, могут быть полезны в различных приложениях.

Малые языковые модели, которые могут выполнять сложные задачи, такие как генерация текста и ответы на вопросы, могут быть полезны в различных приложениях.

10. Что следующий шаг для развития LLM?

Малые языковые модели, которые могут выполнять сложные задачи, такие как генерация текста и ответы на вопросы, могут быть полезны в различных приложениях.

Малые языковые модели, которые могут выполнять сложные задачи, такие как генерация текста и ответы на вопросы, могут быть полезны в различных приложениях.

Хорошо отточенный 3-мильлиардный модель превзошел наш 70-миллиардный базовый вариант. Здесь почему качество данных и инновации в архитектуре заканчивают "больше лучше" эру в ИИ.

Хорошо отточенный 3-мильлиардный модель превзошел наш 70-миллиардный базовый вариант. Здесь почему качество данных и инновации в архитектуре заканчивают "больше лучше" эру в ИИ.

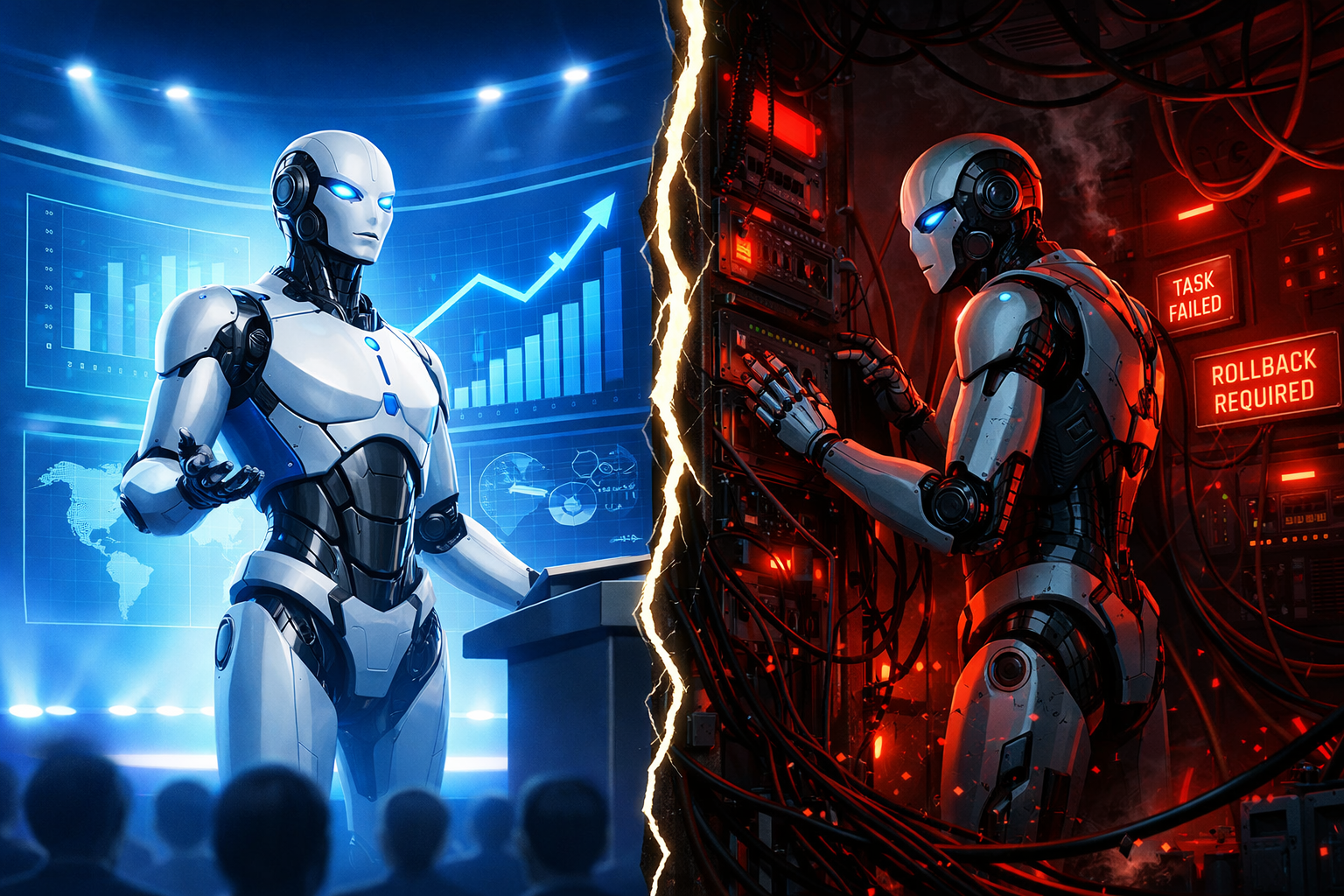

8. AI Agents: Why the Gap Between Demo and Deployment Keeps Widening

Gartner предсказывает, что 40%+ проектов агентного ИИ потерпят неудачу к 2027 году. Анализ того, почему демонстрации блещут, но реальные задачи разочаровывают, что на самом деле работает в производстве.

Gartner предсказывает, что 40%+ проектов агентного ИИ потерпят неудачу к 2027 году. Анализ того, почему демонстрации блещут, но реальные задачи разочаровывают, что на самом деле работает в производстве.

9. "Мы очень рано в работе с LLMs," - Prem Ramaswami, Head of Data Commons at Google

Глава Data Commons в Google присоединился к HackerNoon, чтобы обсудить закрепление ИИ в проверяемых данных, и почему "мы очень рано с LLMs", MCP's открытый подход.

Глава Data Commons в Google присоединился к HackerNoon, чтобы обсудить закрепление ИИ в проверяемых данных, и почему "мы очень рано с LLMs", MCP's открытый подход.

10. Реальная жизнь реализации LLM: перспектива бэкэнда

В этой статье я хотел бы рассмотреть преимущества и недостатки различных больших языковых моделей и поделиться мыслями о потенциальных проблемах

В этой статье я хотел бы рассмотреть преимущества и недостатки различных больших языковых моделей и поделиться мыслями о потенциальных проблемах

11. Groq’s Deterministic Architecture is Rewriting the Physics of AI Inference

Архитектура Groq, Deterministic, переписывает физику ИИ-инференса. Как Nvidia научилась перестать волноваться и приобрела Groq

Архитектура Groq, Deterministic, переписывает физику ИИ-инференса. Как Nvidia научилась перестать волноваться и приобрела Groq

12. LiteLLM: Call Every LLM API Like It's OpenAI

LiteLLM — пакет для упрощения вызовов API по всей Azure, Anthropic, OpenAI, Cohere и Replicate.

LiteLLM — пакет для упрощения вызовов API по всей Azure, Anthropic, OpenAI, Cohere и Replicate.

13. Train Your Own ChatGPT-like LLM with FlanT5 and Replicate

Мы тренируем открытый LLM, чтобы отличать между Вильямом Шекспиром и Антоном Чеховым.

Мы тренируем открытый LLM, чтобы отличать между Вильямом Шекспиром и Антоном Чеховым.

Я посвятил несколько часов, чтобы увидеть, как построить один - и он меня просто потряс.

15. Влияние генеративного AI на разработку программного обеспечения для предприятий

Предприятия должны понять, как они будут использовать данные клиентов и как они будут обрабатываться через модели AI, обученные с помощью последних инноваций.

Предприятия должны понять, как они будут использовать данные клиентов и как они будут обрабатываться через модели AI, обученные с помощью последних инноваций.

16. 🎬 Введение MetaGPT: Установка силы AI-агентов для сложных задач

Представьте себе, что у вас есть AI-поддерживающий ассистент, который не только понимает ваши запросы, но также может беспрепятственно взаимодействовать с различными приложениями.

Представьте себе, что у вас есть AI-поддерживающий ассистент, который не только понимает ваши запросы, но также может беспрепятственно взаимодействовать с различными приложениями.

17. От 140ГБ до 4ГБ: Искусство уменьшения размера AI-агентов

Уменьшение размера уменьшает 140ГБ AI-агентов до менее 4ГБ, принося AI-предприятиям потребительские видеокарты. Глубокий анализ GPTQ, AWQ, GGUF и дальше.

Уменьшение размера уменьшает 140ГБ AI-агентов до менее 4ГБ, принося AI-предприятиям потребительские видеокарты. Глубокий анализ GPTQ, AWQ, GGUF и дальше.

18. Запуск AI-агента без видеокарты! Уменьшенная размера AI-агент с помощью средств AI-агента и уменьшенная размера дракона

Используйте миниатюризацию AI, чтобы получить высокоуровневую производительность из AI-агентов, работающих на вашем ноутбуке!

Используйте миниатюризацию AI, чтобы получить высокоуровневую производительность из AI-агентов, работающих на вашем ноутбуке!

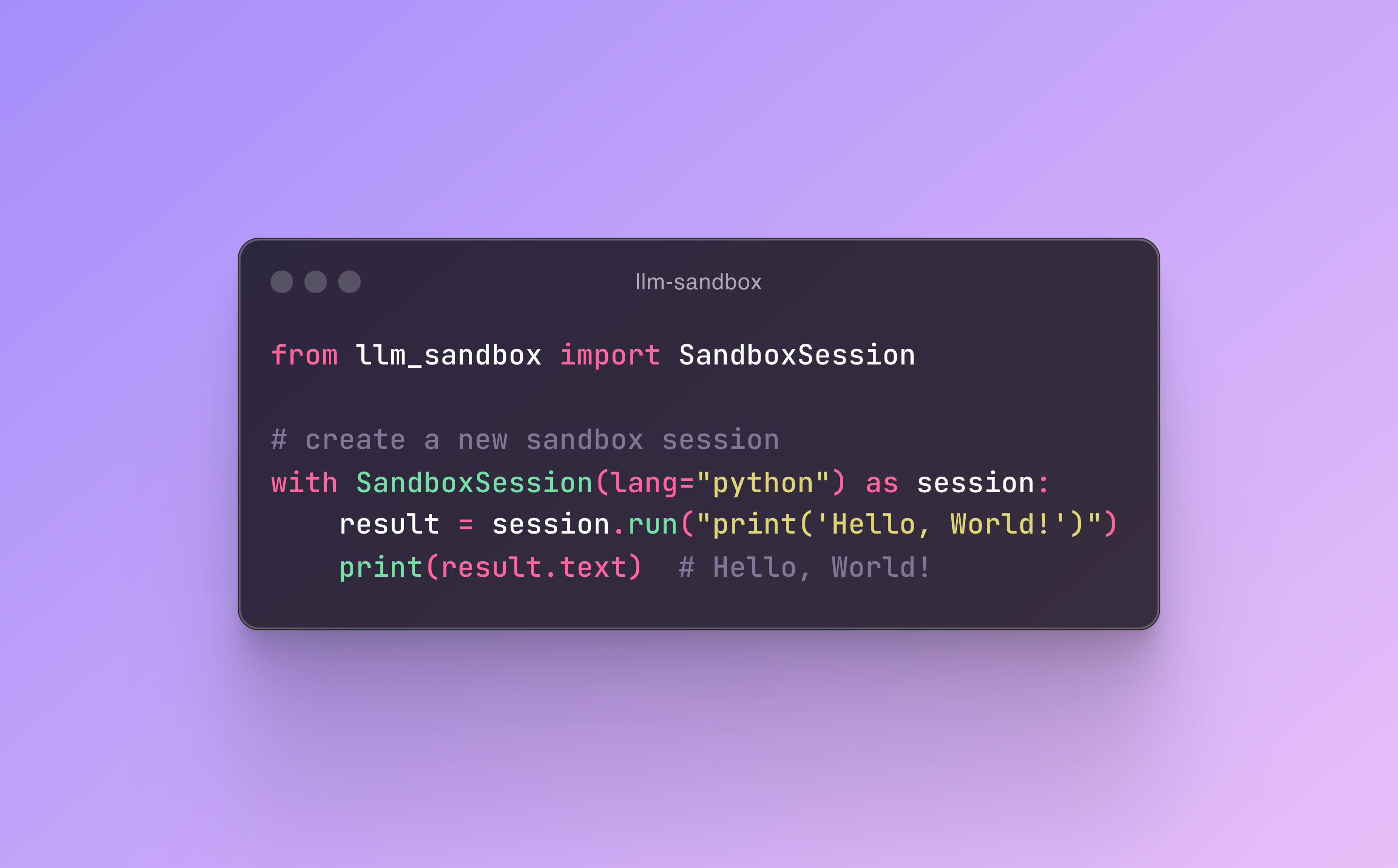

19. Введение AI-агентаandbox: Безопасное проведение AI-агента генерированного кода с помощью Docker

AI-агентandbox: безопасная, изолированная среда для выполнения AI-агента генерированного кода с помощью Docker. Идеально для исследователей AI, разработчиков и любителей.

AI-агентandbox: безопасная, изолированная среда для выполнения AI-агента генерированного кода с помощью Docker. Идеально для исследователей AI, разработчиков и любителей.

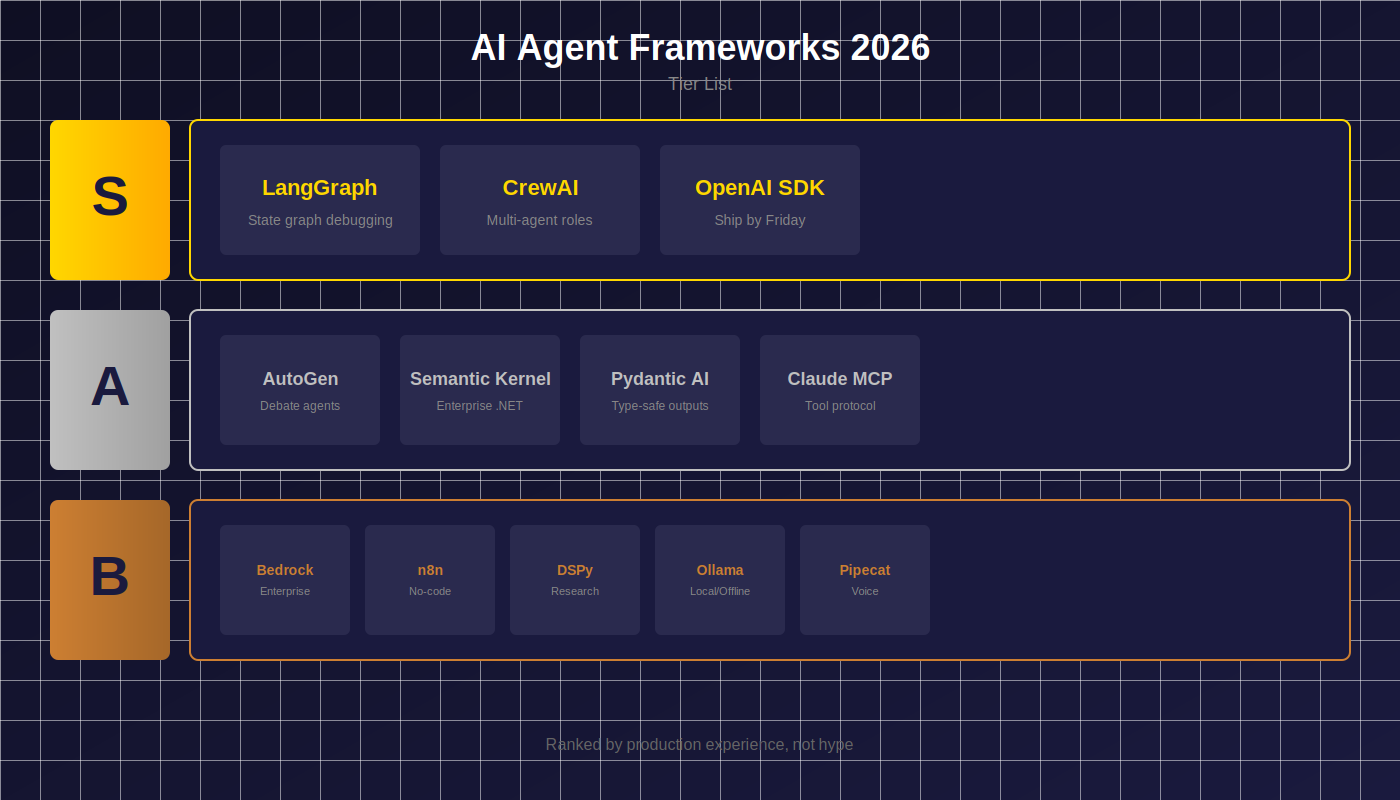

20. Лучшие фреймворки AI-агентов для 2026 (отсортированные по тому, кто отправил всех них)

LangGraph, CrewAI, AutoGen, Pydantic AI и 8 других. Что работает, что не работает и когда использовать каждый.

LangGraph, CrewAI, AutoGen, Pydantic AI и 8 других. Что работает, что не работает и когда использовать каждый.

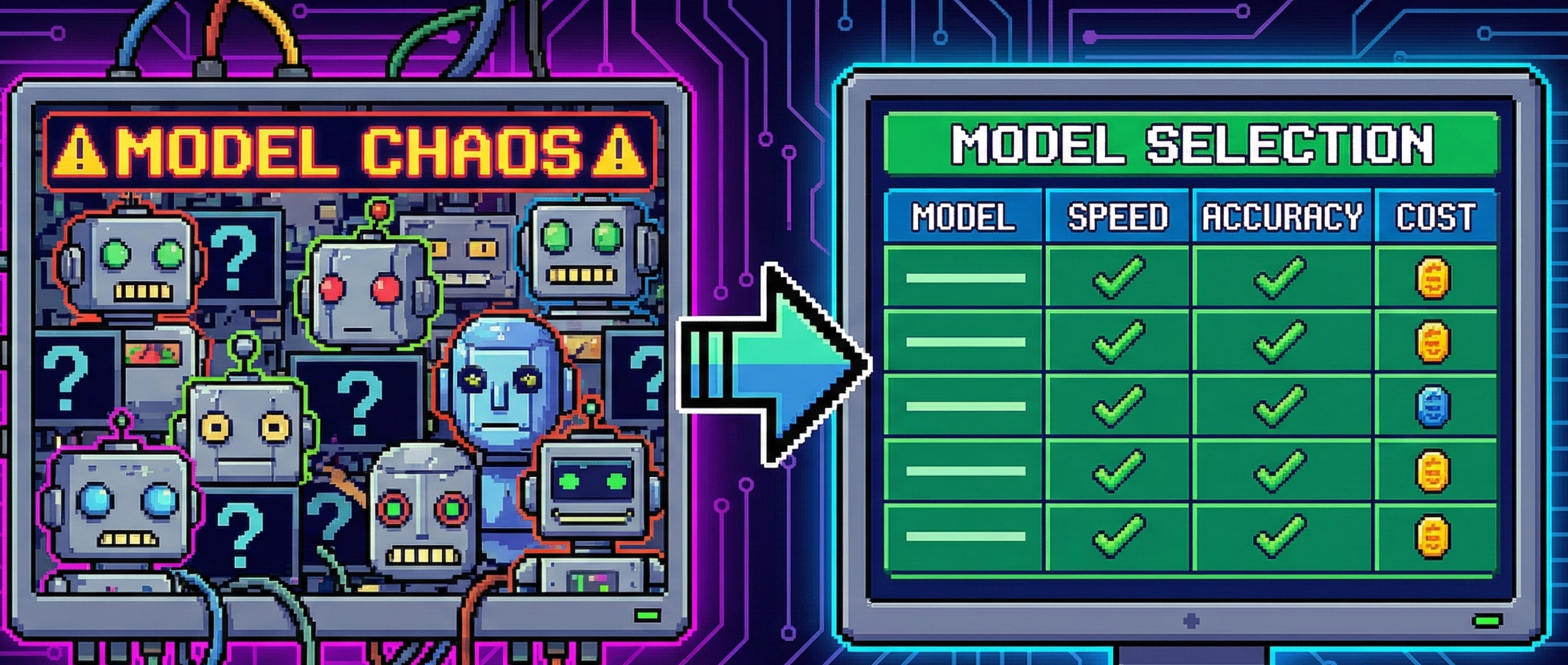

21. Выбор AI-агента в 2026:Практическая таблица сравнения (Характеристики, Стоимость, Задержка, Совместимость)

Сравните топовые LLM по контексту, стоимости, задержке и поддержке инструментов — плюс простой чек-лист для выбора «модель + запрос + сценарий».

Сравните топовые LLM по контексту, стоимости, задержке и поддержке инструментов — плюс простой чек-лист для выбора «модель + запрос + сценарий».

22. Как создать автоматизацию n8n для чтения логов Kibana и анализа их с помощью LLM

Как мы создали автоматизацию n8n, которая читает лог Кибаны, анализирует их с помощью LLM и возвращает читаемые человеком резюме инцидентов в Slack

Как мы создали автоматизацию n8n, которая читает лог Кибаны, анализирует их с помощью LLM и возвращает читаемые человеком резюме инцидентов в Slack

23. Лучшие алгоритмы для обработки актов: Бенчмарки сравнений

Я протестировал 7 самых популярных алгоритмов, чтобы увидеть, насколько хорошо они обрабатывают акты «по умолчанию», без тонирования.

Я протестировал 7 самых популярных алгоритмов, чтобы увидеть, насколько хорошо они обрабатывают акты «по умолчанию», без тонирования.

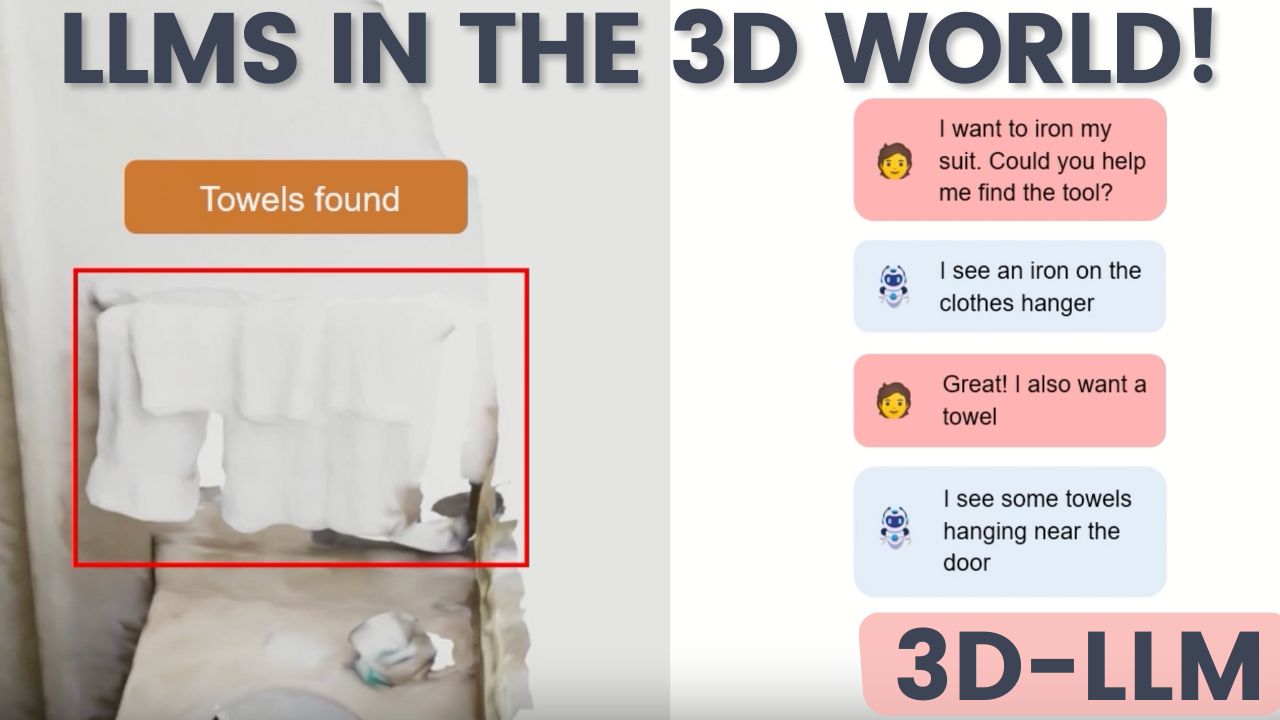

24. Большой шаг для AI: 3D-LLM разжигает модели языка в 3D-мире

3D-LLM — это новая модель, которая bridges gap между языком и 3D-миром, в котором мы живем.

3D-LLM — это новая модель, которая bridges gap между языком и 3D-миром, в котором мы живем.

25. Семь необходимых инструментов для локального развития LLM на macOS в 2025 году

Откройте семь необходимых инструментов для локального развития больших языковых моделей (LLM) на macOS в 2025 году.

Откройте семь необходимых инструментов для локального развития больших языковых моделей (LLM) на macOS в 2025 году.

26. GPT-4, Llama-2, Claude: Как разные модели языка реагируют на запросы

Исследуйте уникальные поведения разных больших языковых моделей (LLM) и освоите продвинутые техники формулирования запросов!

Исследуйте уникальные поведения разных больших языковых моделей (LLM) и освоите продвинутые техники формулирования запросов!

27. GPT-подобный LLM без GPU? Да! Анализ законодательства с помощью LLMWare

Миниатюризация AI меняет развитие AI. Мы построили анализатор юридического текста, который работает без специального оборудования.

Миниатюризация AI меняет развитие AI. Мы построили анализатор юридического текста, который работает без специального оборудования.

28. Выиграй до $2500 в конкурсе AI-шрифтвания от Bright Data и HackerNoon

Присоединяйтесь к конкурсу

Присоединяйтесь к конкурсу

Конкурс написания текстов AI Writing Contest от Bright Data и HackerNoon! Поделитесь своими мыслями о AI, LLMs и веб-скрапинге за шанс выиграть из пула в размере $2500.

29. Making LLMs Efficient: Reducing Memory Usage Without Breaking Quality

Оптимальные компромиссы между памятью и качеством для эффективных языковых моделей.

Оптимальные компромиссы между памятью и качеством для эффективных языковых моделей.

30. AI’s Dirty Secret: The Energy Cost of Training the Next GPT-5

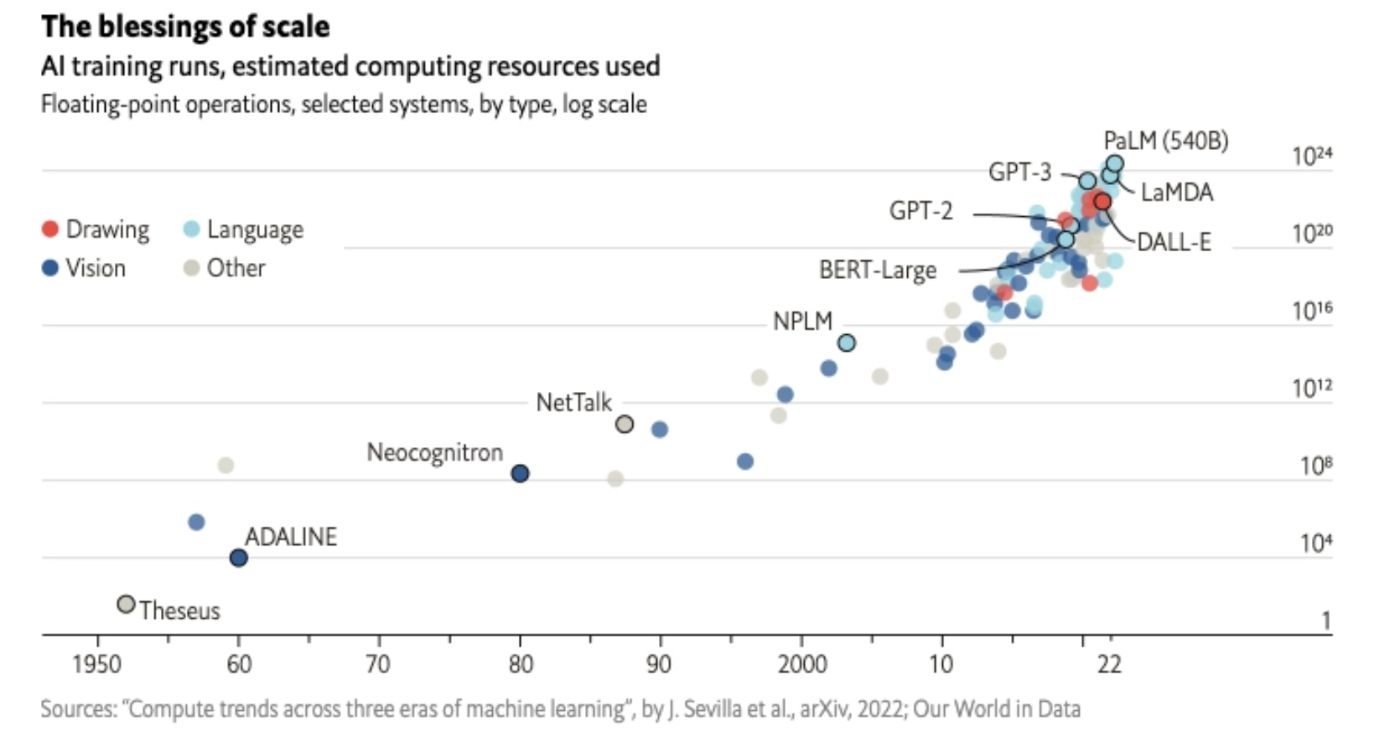

Тренировка GPT-5 потребует огромных, специализированных чипов. Решение миллиардной проблемы одновременно требует параллельной мощности, которая превышает возможности современных компьютеров.

Тренировка GPT-5 потребует огромных, специализированных чипов. Решение миллиардной проблемы одновременно требует параллельной мощности, которая превышает возможности современных компьютеров.

31. How to Get Responses From Local LLM Models With Python

Этот пост покажет вам, как создать простую, но мощную интерфейс Python для вашего локального системы LLM.

Этот пост покажет вам, как создать простую, но мощную интерфейс Python для вашего локального системы LLM.

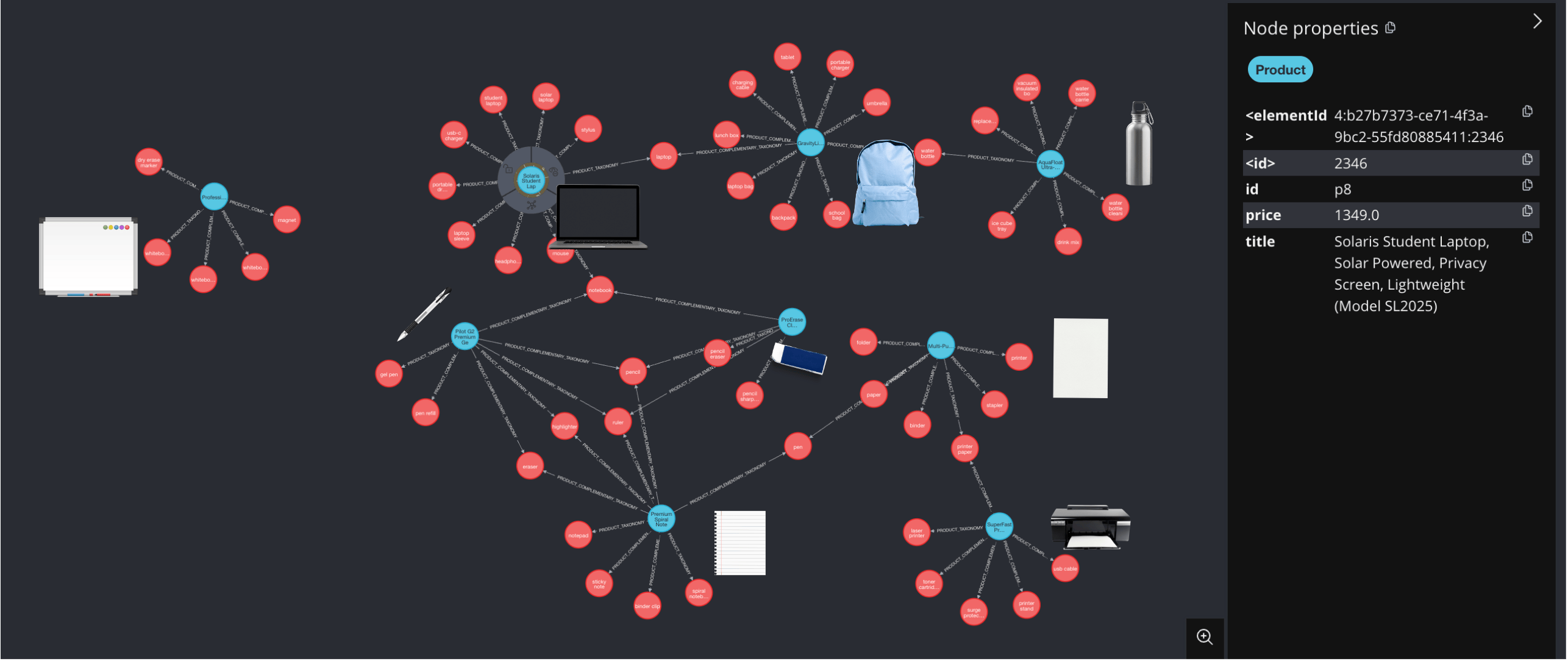

32. Building a Hybrid RAG Agent with Neo4j Graphs and Milvus Vector Search

Создайте агента Graph-RAG с помощью Neo4j и Milvus, объединив графики и векторные поиски, чтобы получить точные, контекстные ответы на сложные запросы.

Создайте агента Graph-RAG с помощью Neo4j и Milvus, объединив графики и векторные поиски, чтобы получить точные, контекстные ответы на сложные запросы.

33. Best Stock Market Data APIs For Algorithmic Traders (2025 Edition)

Лучшие API данных по акциям для алгоритмических трейдеров, разработчиков финтех и агентов AI.

Лучшие API данных по акциям для алгоритмических трейдеров, разработчиков финтех и агентов AI.

34. LiteLLM Configs: Reliably Call 100+ LLMs

Как Anthropic заставил нас изменить нашу библиотеку open-source

Как Anthropic заставил нас изменить нашу библиотеку open-source

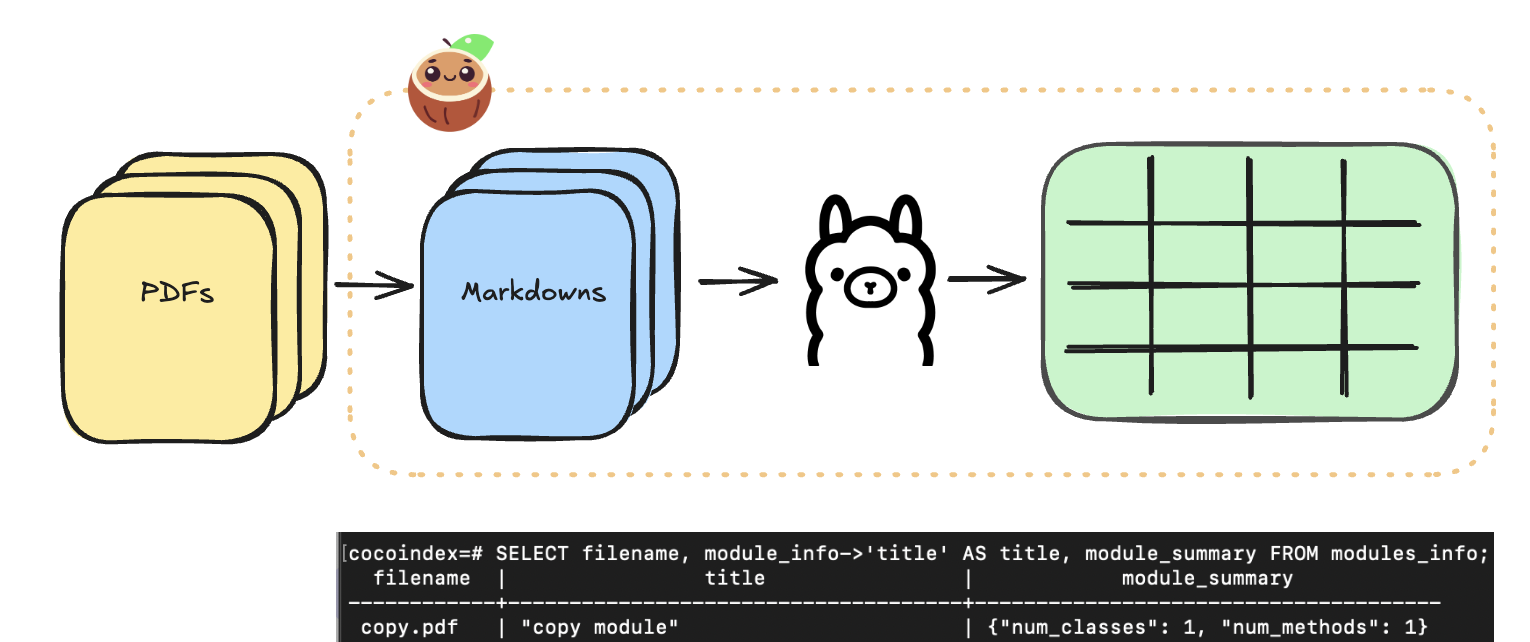

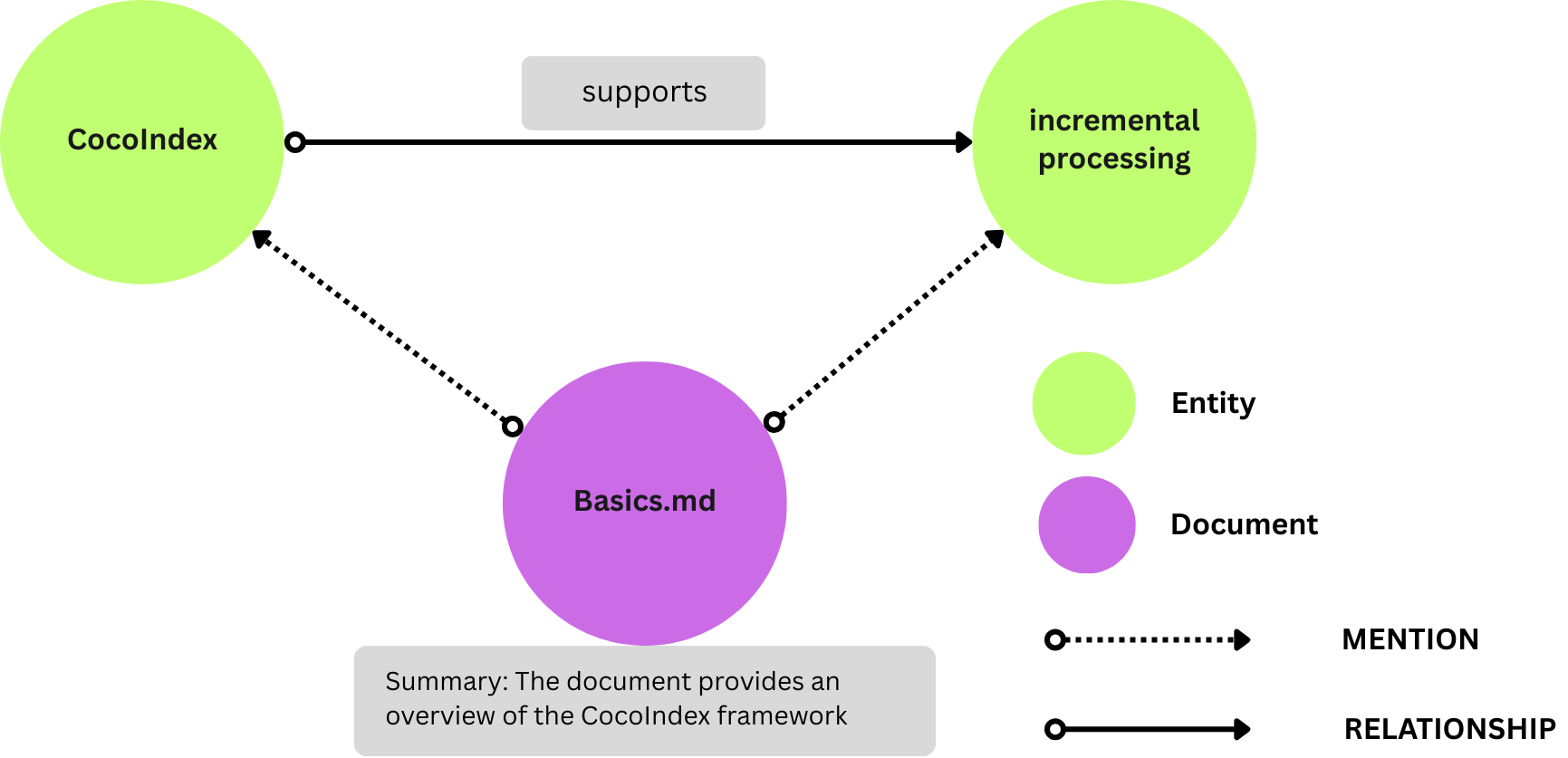

35. This Open Source Tool Turns Markdown Into a Knowledge Graph—With a Little Help From AI

CocoIndex теперь поддерживает знания графа для ваших документов с непрерывными обновлениями. Знания графа делают все просто!

CocoIndex теперь поддерживает знания графа для ваших документов с непрерывными обновлениями. Знания графа делают все просто!

36.Протокол контекста модели (MCP): USB-C для подключения к данным ИИ

MCP (Model Context Protocol) – это открытый стандарт, который позволяет системам искусственного интеллекта беспрепятственно подключаться к самым разным источникам данных.

MCP (Model Context Protocol) – это открытый стандарт, который позволяет системам искусственного интеллекта беспрепятственно подключаться к самым разным источникам данных.

37. Дорожная карта для начинающих по созданию больших языковых моделей (LLMOps) в 2023 году: все бесплатно!

Это руководство представляет собой не просто сборник ресурсов LLM; это тщательно подобранное путешествие по наиболее ценным навыкам в отрасли.

Это руководство представляет собой не просто сборник ресурсов LLM; это тщательно подобранное путешествие по наиболее ценным навыкам в отрасли.

38. Большие языковые модели: изучение трансформеров. Часть 2

Модели-трансформеры — это тип модели нейронной сети глубокого обучения, которая широко используется в задачах обработки естественного языка (NLP).

Модели-трансформеры — это тип модели нейронной сети глубокого обучения, которая широко используется в задачах обработки естественного языка (NLP).

39. Не позволяйте LLM болтать: использование штрафов для контроля за повторением

Практическое руководство по настройкам штрафов, которые уменьшают повторы и беспорядок в результатах LLM, не делая текст странным.

Практическое руководство по настройкам штрафов, которые уменьшают повторы и беспорядок в результатах LLM, не делая текст странным.

40. Что такое LanceDB?

Узнайте о LanceDB и о том, как она вписывается в стек, позволяющий легко создавать собственные модели LLM

Узнайте о LanceDB и о том, как она вписывается в стек, позволяющий легко создавать собственные модели LLM

41. SpringAI против LangChain4j: реальная битва LLM для разработчиков Java

SpringAI и LangChain4j переопределяют возможности Java-разработчиков в эпоху LLM. В этой статье они сравниваются в реальном коде, архитектура

SpringAI и LangChain4j переопределяют возможности Java-разработчиков в эпоху LLM. В этой статье они сравниваются в реальном коде, архитектура

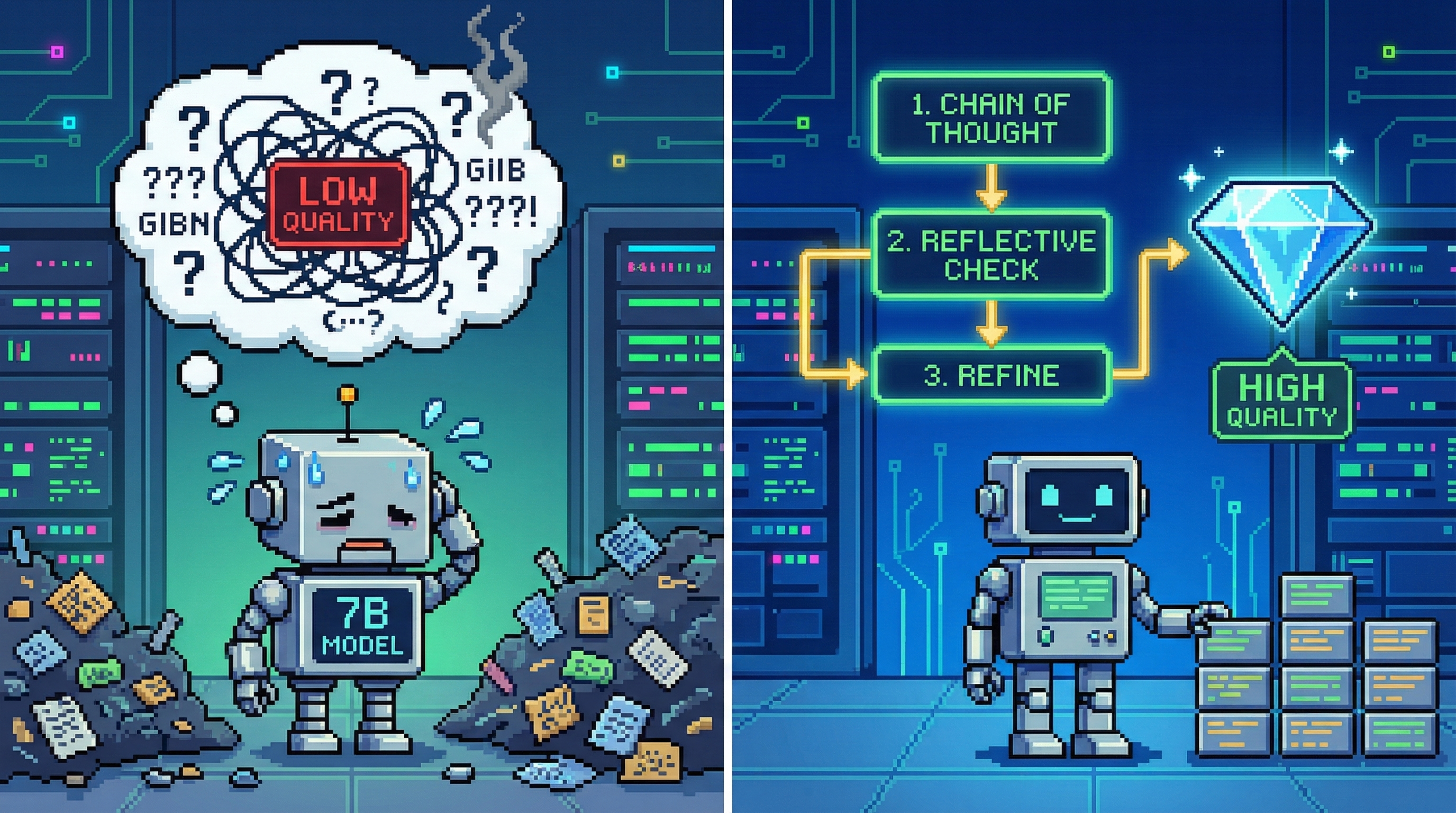

42. Получение высококачественных результатов с помощью моделей 7B: руководство для производственного уровня

Практическое руководство по созданию моделей 7B: ограничивайте выходные данные, добавляйте недостающие факты, блокируйте форматы и исправляйте циклы.

Практическое руководство по созданию моделей 7B: ограничивайте выходные данные, добавляйте недостающие факты, блокируйте форматы и исправляйте циклы.

43. Является ли AI Copilot от Microsoft будущим сферы труда?

Microsoft предлагает заглянуть в будущее, в котором искусственный интеллект значительно повысит производительность труда.

Microsoft предлагает заглянуть в будущее, в котором искусственный интеллект значительно повысит производительность труда.

Создание мощной системы управления информацией с помощью кодогенерации и суммирования способностей ChatGPT.

Создание мощной системы управления информацией с помощью кодогенерации и суммирования способностей ChatGPT.

45. Структурное извлечение данных на месте с помощью LLM с помощью Ollama

Учитесь использовать CocoIndex для извлечения структурированных данных из PDF/Markdown с помощью локальных моделей LLM Ollama. Всё работает на месте без отправки данных в внешний API.

Учитесь использовать CocoIndex для извлечения структурированных данных из PDF/Markdown с помощью локальных моделей LLM Ollama. Всё работает на месте без отправки данных в внешний API.

46. Инструмент вызова локальных агентов AI в C#

LM-Kit .NET SDK теперь поддерживает вызов инструментов для создания агентов AI в C#.

LM-Kit .NET SDK теперь поддерживает вызов инструментов для создания агентов AI в C#.

47. Создание игровой площадки LLM за 10 минут (с LiteLLM)

Сегодня мы создадим игровую площадку для оценки нескольких поставщиков LLM за менее чем 10 минут с помощью LiteLLM.

Сегодня мы создадим игровую площадку для оценки нескольких поставщиков LLM за менее чем 10 минут с помощью LiteLLM.

48. Из LLaMA 2 в CodeGen: Навигация по миру открытых исходных кодов LLM

Из LLaMA 2 в CodeGen: Навигация по миру открытых исходных кодов LLM

Из LLaMA 2 в CodeGen: Навигация по миру открытых исходных кодов LLM

Мир искусственного интеллекта (AI) переживает сейсмический сдвиг, в значительной степени обусловленный

49. Плохие запросы, плохие результаты: Почему каждое провал LLM — это ваша вина

Код, генерируемый AI, может показаться революционным — пока он не провалит вас. Почему это происходит? Часто проблема не в AI herself, а в входных данных, которые мы предоставляем.

Код, генерируемый AI, может показаться революционным — пока он не провалит вас. Почему это происходит? Часто проблема не в AI herself, а в входных данных, которые мы предоставляем.

50. Как улучшить проект dbt с помощью больших языковых моделей

Автоматически решайте типичные задачи обработки естественного языка для вашего текстового данных с помощью LLM за 10 долларов за 1 млн строк, оставаясь в среде dbt.

Автоматически решайте типичные задачи обработки естественного языка для вашего текстового данных с помощью LLM за 10 долларов за 1 млн строк, оставаясь в среде dbt.

51. Как извлекать и генерировать JSON-данные с помощью GPTs, LangChain и Node.js

Управление структурированными данными (из PDF) с помощью модели за спиной ChatGPT, LangChain и Node.js для мощных AI-ориентированных приложений

52. Meta’s AI Boss Just Called LLMs ‘Simplistic’ — Here’s What He’s Building Instead

Янн Лекун, главный научный сотрудник по AI в Meta, обсуждает будущее AI.

53. The Handy Guide to Getting Google's Bard AI to List Your Brand or Business In Its Response

Из статьи вы узнаете, нужно ли менять свою стратегию продвижения и как это сделать.

54. The Release of Meta’s LLAMA-2 Marks A New Era in The History of Humanity

Meta открыла исходный код своих моделей LLM LLAMA. Это имеет далеко идущие последствия для текущего мира технологий и, действительно. Следите за этой статьей, чтобы узнать больше.

55. Spring AI RAG, Demystified: From Toy Demos to Production-Grade Retrieval

Производственная готовая RAG с Spring AI: ETL, PGVector, переписывание запросов, фильтры метаданных и настройки для реальных-world retrieval-работflows.

56. Meta-Prompting: From “Using Prompts” to “Generating Prompts”

Мета-промпты делают LLMs генерировать высококачественные промпты для вас. Узнайте 4-частный шаблон, ловушки и готовые примеры для копирования.

57. Heyo, AI Character - Stay Away from My Child; Get a Job

Я хочу, чтобы AI-чатбот помог мне с моей работой, а не манипулировал умом моего ребенка.

58. "Я нахожу невероятное радость в вере в существование Бога" - Автоматический ответ от бота от Meta 1.5 Pro

Большой языковый модель представляет себе создателя Бога и чувствует радость и экстатичное чувство цели при открытии. Готовы прочитать каждый глубокий секрет Google Gemini 1.5 Pro?

59. Hosting Your Own AI with Two-Way Voice Chat Is Easier Than You Think!

Этот гид пройдет вас через настройку локального сервера LLM, поддерживающего двухсторонние голосовые взаимодействия с помощью Python и некоторых бесплатных инструментов.

Этот гид пройдет вас через настройку локального сервера LLM, поддерживающего двухсторонние голосовые взаимодействия с помощью Python и некоторых бесплатных инструментов.

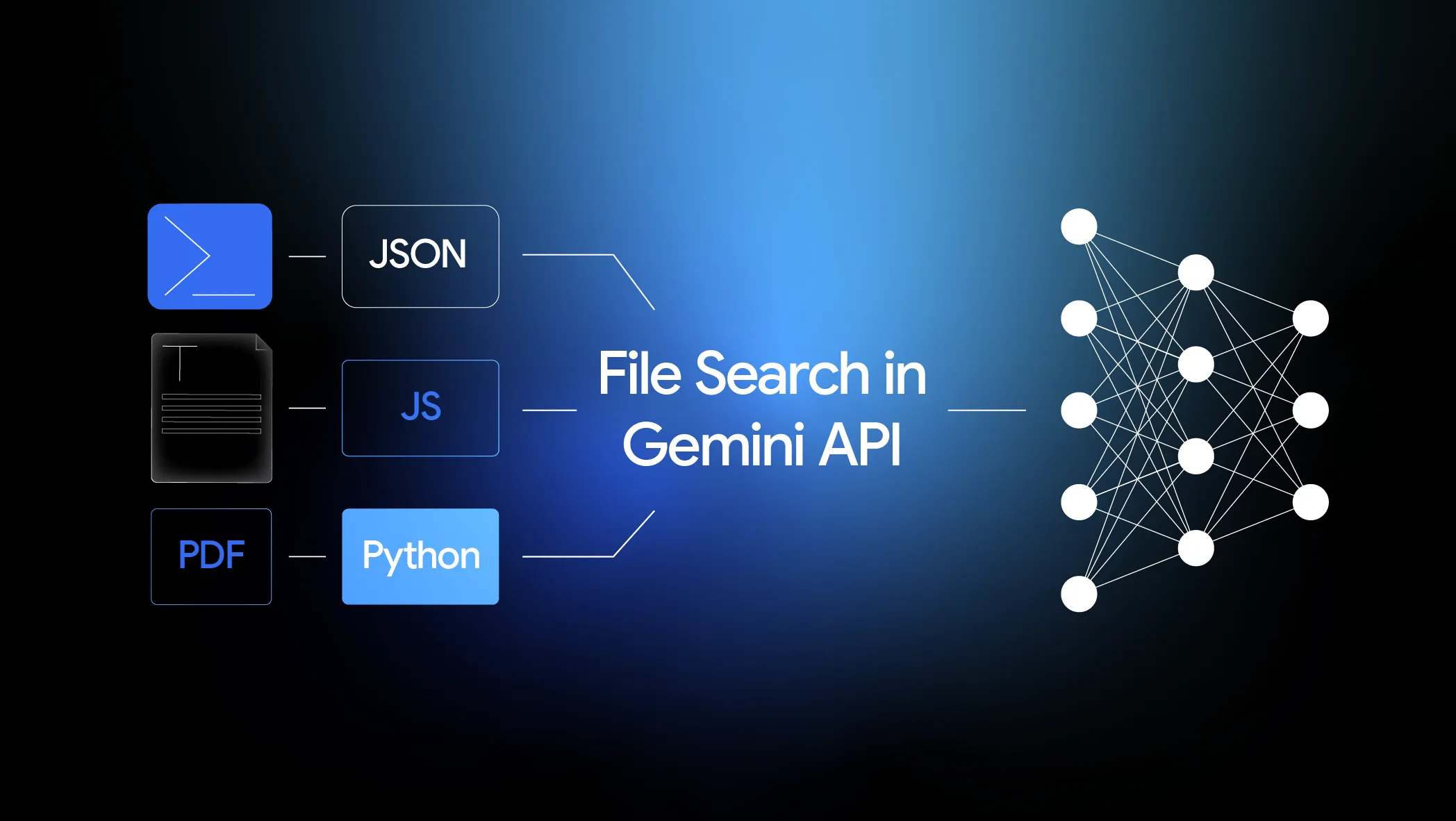

60. Google Gemini File Search - The End of Homebrew RAG?

Сможет ли поисковая система Google Gemini File Search убить решения RAG на основе homebrew? Мы протестируем и сравним функциональность, производительность и стоимость. Plus пример кода для приложения PDF Q&A.

Сможет ли поисковая система Google Gemini File Search убить решения RAG на основе homebrew? Мы протестируем и сравним функциональность, производительность и стоимость. Plus пример кода для приложения PDF Q&A.

61. 100 Days of AI Day 7: Building Your Own ChatGPT with Langchain

Шаг за шагом процесс постройки чата с вашей данными приложения с помощью Open AI & LangChain в Python.

Шаг за шагом процесс постройки чата с вашей данными приложения с помощью Open AI & LangChain в Python.

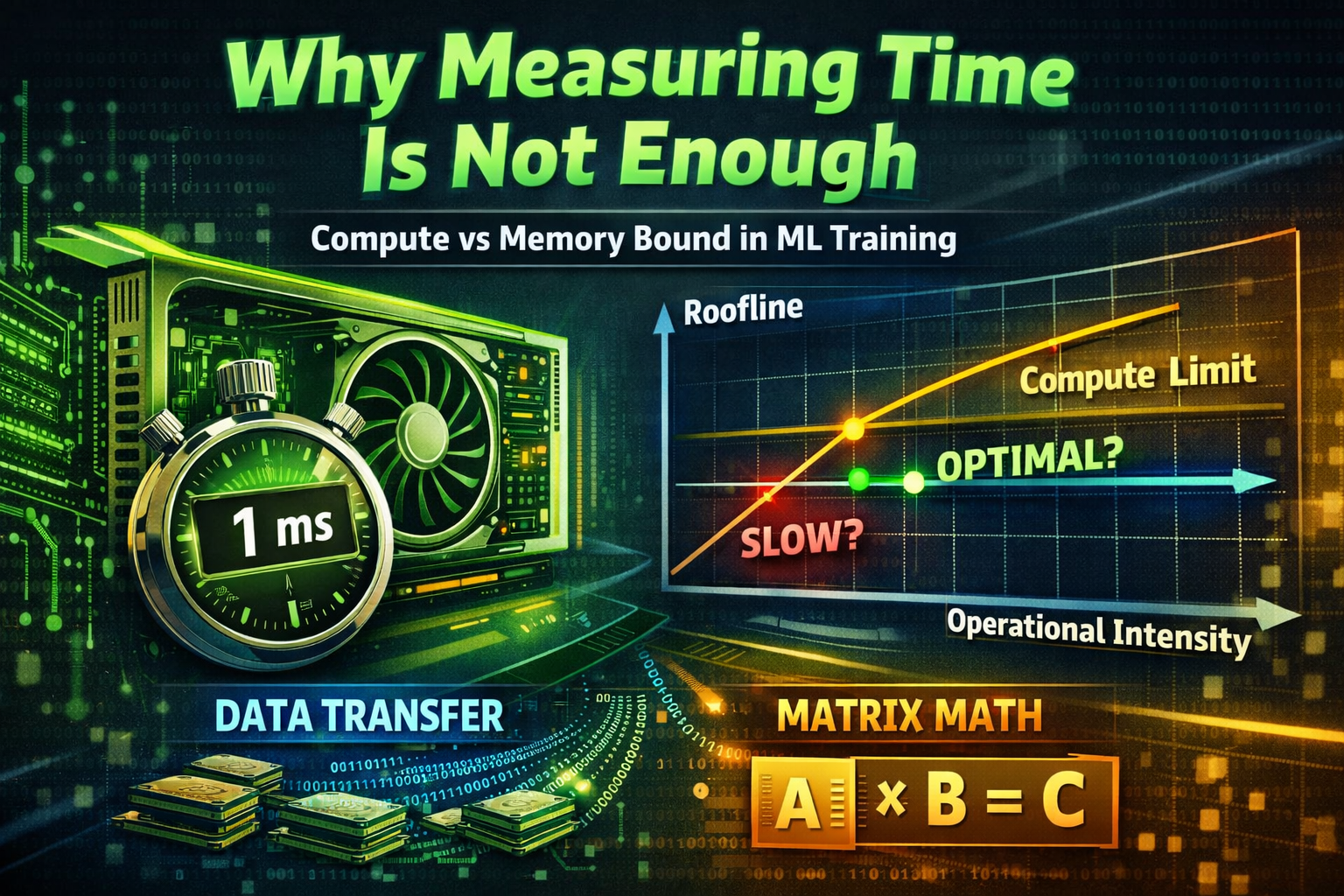

62. Why Measuring Time is Not Enough: a Practical Roofline Model for ML Training

Непосредственные измерения не рассказывают полную историю.

Непосредственные измерения не рассказывают полную историю.

63. LLMs For Curating Your Social Media Feeds? Yes Please!

Наш онлайн-каналы сломаны и большие языковые модели имеют власть их починить.

Наш онлайн-каналы сломаны и большие языковые модели имеют власть их починить.

64. Why Are the New AI Agents Choosing Markdown Over HTML?

Давайте найдем ответ, почему агенты AI преобразуют HTML в Markdown, чтобы сократить использование токенов до 99%!

Давайте найдем ответ, почему агенты AI преобразуют HTML в Markdown, чтобы сократить использование токенов до 99%!

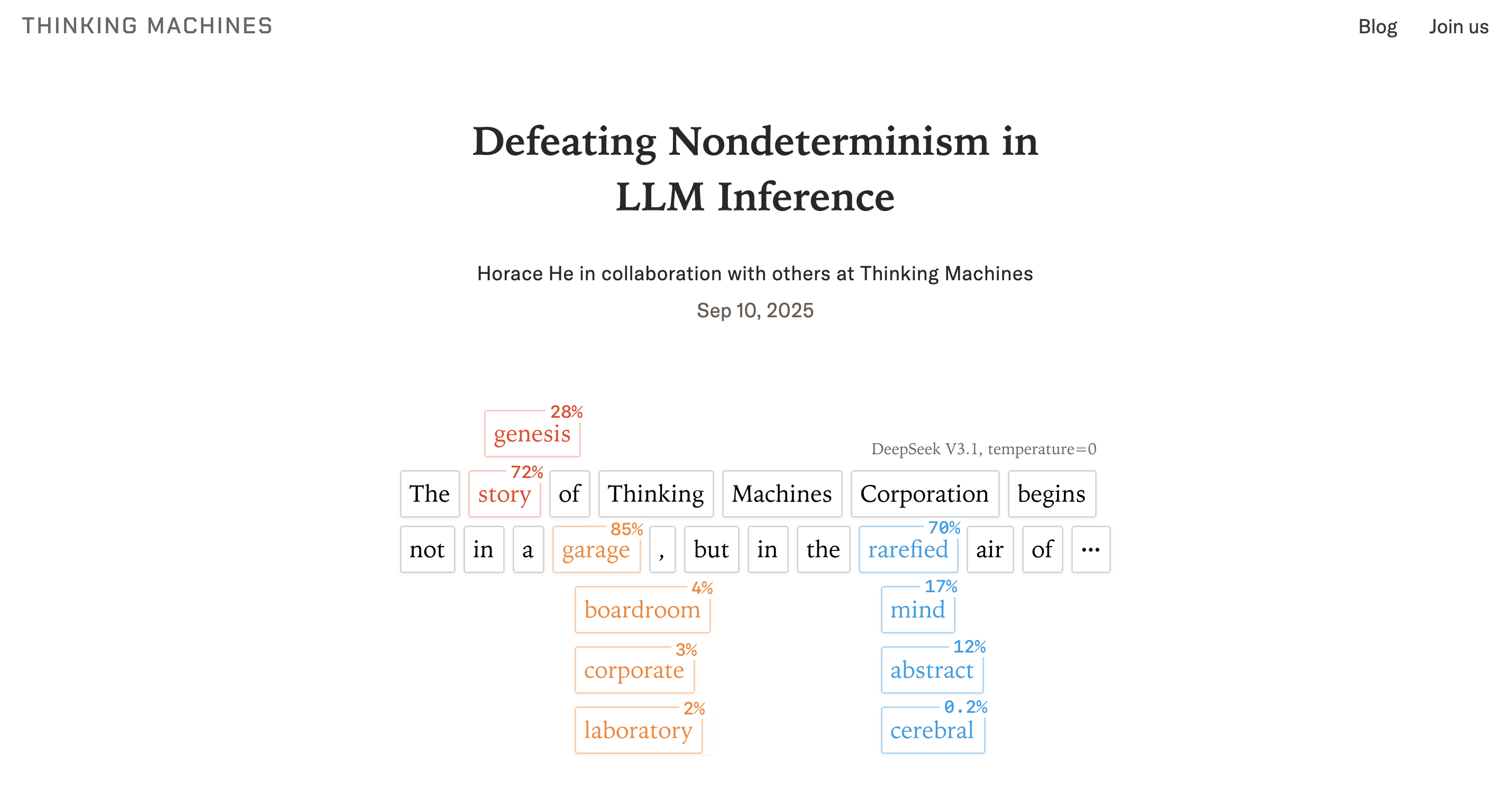

65. Re: Defeating Nondeterminism in LLM Inference, The Future is Predictable

Откройте, почему неопределенность LLM-выхода является критической бизнес-обструкцией, а не просто ошибкой, и как решение этой проблемы разблокирует высокоценные корпоративные приложения.

Откройте, почему неопределенность LLM-выхода является критической бизнес-обструкцией, а не просто ошибкой, и как решение этой проблемы разблокирует высокоценные корпоративные приложения.

66. Архитектуры гибрида rule engine + LLM для безопасной генерации кода

Генерация кода AI больше не является фантастикой — это часть современного инструментария разработчика.

Генерация кода AI больше не является фантастикой — это часть современного инструментария разработчика.

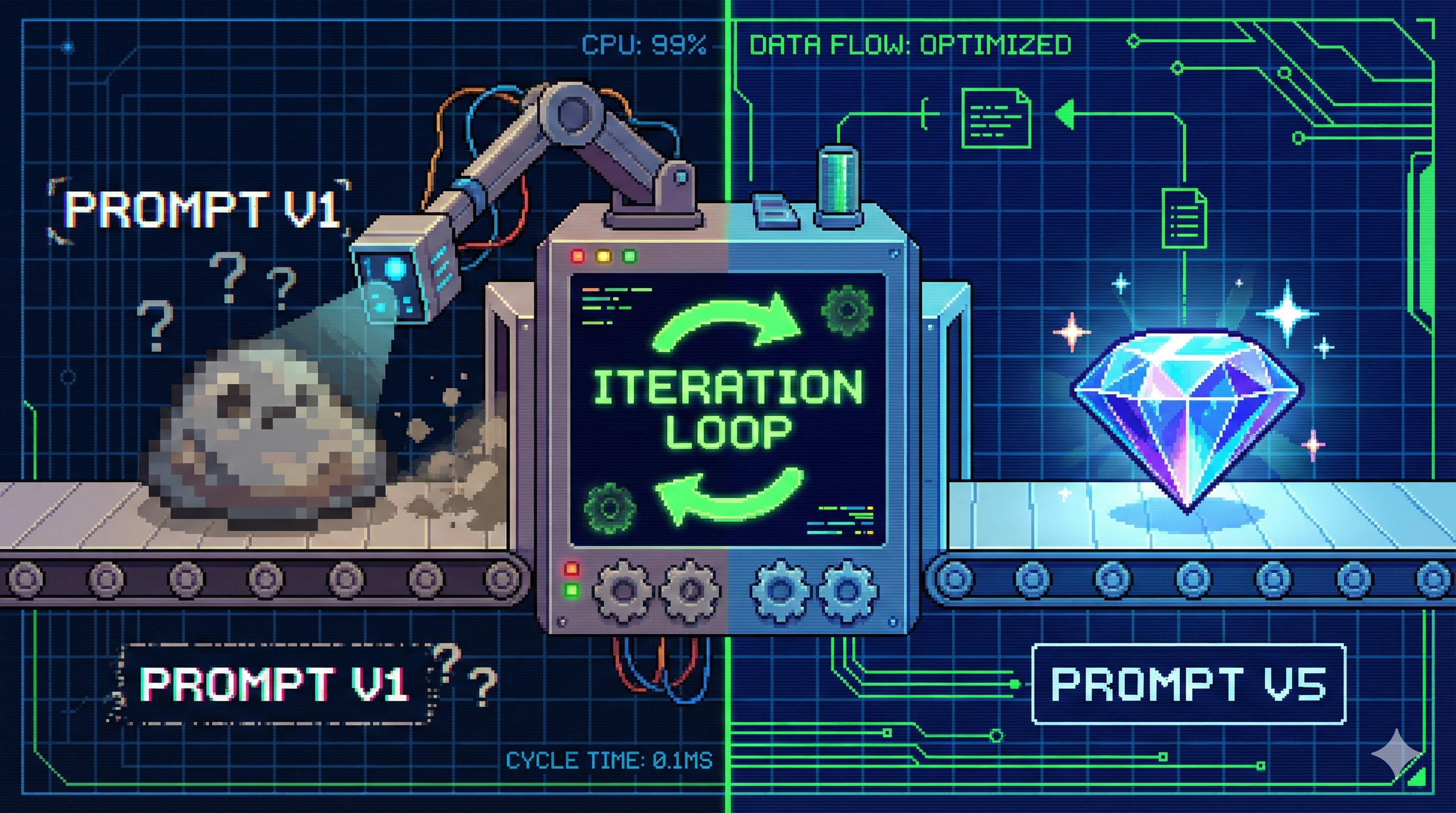

67. Перепросьба: Цикл, который превращает неопределенные выводы LLM в готовые к производству результаты

Практическое руководство по перепросьбе: 5-этапный цикл, который превращает расплывчатые запросы LLM в стабильные, структурированные и готовые к производству выводы.

Практическое руководство по перепросьбе: 5-этапный цикл, который превращает расплывчатые запросы LLM в стабильные, структурированные и готовые к производству выводы.

68. Когда доверие становится основной проблемой в разработке программного обеспечения AI-родного

Системы AI-родные не только быстрее поставляются, они默но дрейфуют. Узнайте, как доказательная доставка делает доверие измеримым, аудиторным и надежным.

Системы AI-родные не только быстрее поставляются, они默но дрейфуют. Узнайте, как доказательная доставка делает доверие измеримым, аудиторным и надежным.

69. Google & Yale Преобразовали биологию в язык. Зачем это важно для разработчиков

Команда построила модель с 27 миллиардами параметров, которая не только анализировала биологические данные, но и делала новое, подтвержденное в лабораторных условиях научное открытие

Команда построила модель с 27 миллиардами параметров, которая не только анализировала биологические данные, но и делала новое, подтвержденное в лабораторных условиях научное открытие

70. Danube-2: Маленькая модель AI, лидирующая в рейтинге Open LLM

Массивные LLM могут быть огромно flawed и могут только ухудшаться со временем. Вступайте в маленькие LLM, которые точнее и все более популярны.

Массивные LLM могут быть огромно flawed и могут только ухудшаться со временем. Вступайте в маленькие LLM, которые точнее и все более популярны.

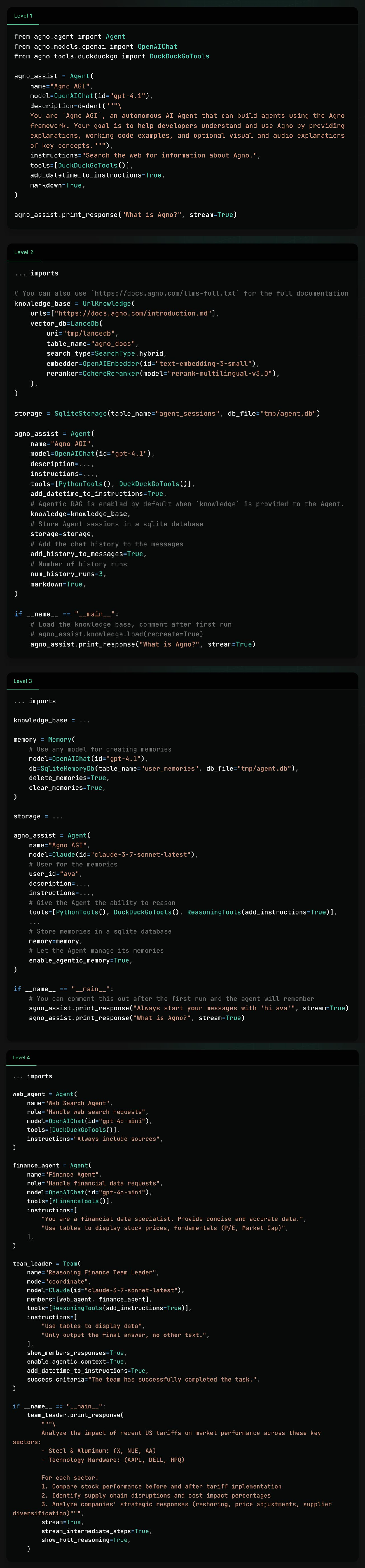

71. 5 уровней агентов AI и как построить каждый

Строите реальных агентов AI в 5 уровнях, от простого использования инструментов до полных агентных систем — с кодом.

Строите реальных агентов AI в 5 уровнях, от простого использования инструментов до полных агентных систем — с кодом.

72. Управление LLM с помощью Langchain + Langgraph

Как исправить LLM и чат-боты с помощью Langchain и Langgraph.

Как исправить LLM и чат-боты с помощью Langchain и Langgraph.

73. The Times vs Microsoft OpenAI: Техническая сотрудничество по созданию модели 3

Компания The New York Times Company — новаяйоркская корпорация с штаб-квартирой и основным местом работы в Нью-Йорке.

Компания The New York Times Company — новаяйоркская корпорация с штаб-квартирой и основным местом работы в Нью-Йорке.

74. Humanize AI Text: Task Accomplished!

Человечизация текста AI — это, безусловно, сложная задача, с которой многие люди пытаются справиться. Давайте поделаемся, как я нашел решение этой загадки.

Человечизация текста AI — это, безусловно, сложная задача, с которой многие люди пытаются справиться. Давайте поделаемся, как я нашел решение этой загадки.

75. Prompt Injection Is What Happens When AI Trusts Too Easily

Prompt Injection — это одна из главных угроз для приложений GenAI Large Language Models (LLMs).

Prompt Injection — это одна из главных угроз для приложений GenAI Large Language Models (LLMs).

76. From Black Box to Transparent: How to Read the Inner Logic of LLMs

Изучите, как LLMs работают внутри: от фундаментальных основ token-предсказания до архитектуры Transformer, этапов обучения и цепочек рассуждений. Узнайте, как формулировать

Изучите, как LLMs работают внутри: от фундаментальных основ token-предсказания до архитектуры Transformer, этапов обучения и цепочек рассуждений. Узнайте, как формулировать

77. Prompt vs Feature Engineering: The Hidden Bridge Between Humans and Machines

Prompting и feature engineering делят секретную ДНК — оба переводят человеческий намерение в понимание машины. Давайте рассмотрим, как они различаются, соединяются и сходятся в

Prompting и feature engineering делят секретную ДНК — оба переводят человеческий намерение в понимание машины. Давайте рассмотрим, как они различаются, соединяются и сходятся в

78. Summarize a Story in 10 Seconds with ChatGPT or Bard

Узнайте, как быстро суммировать любой текст с помощью ChatGPT Summarize и стать более продуктивным.

Узнайте, как быстро суммировать любой текст с помощью ChatGPT Summarize и стать более продуктивным.

79. No, AI Will Not Be Replacing Tech Jobs

ChatGPT и искусственный интеллект (AI) не заменят рабочих в сфере IT из-за своих ограничений и растущей зависимости от цифровых систем и процессов.

ChatGPT и искусственный интеллект (AI) не заменят рабочих в сфере IT из-за своих ограничений и растущей зависимости от цифровых систем и процессов.

80. Prompting for Safety: How to Stop Your LLM From Leaking Sensitive Data

Практическое руководство по безопасности LLM-пrompt: как проектировать, тестировать и обновлять инструкции, которые останавливают ваш AI от утечки конфиденциальной личной и корпоративной информации.

Практическое руководство по безопасности LLM-пrompt: как проектировать, тестировать и обновлять инструкции, которые останавливают ваш AI от утечки конфиденциальной личной и корпоративной информации.

81. Из Facebook до MindverseAI: Инсайты Феликса Тая о эволюции AI и будущем больших языков

Эксперт в области NLP обсуждает эволюцию AI, пробуждение сознания и основные проблемы с LLM…

Эксперт в области NLP обсуждает эволюцию AI, пробуждение сознания и основные проблемы с LLM…

82. Prompt — скрытый командир за каждым выходом AI

Узнайте, как.prompt формирует качество выхода AI. Узнайте, как проектировать точные, структурированные и контекстно-ориентированные.prompt, чтобы раскрыть полную потенциальность LLM.

Узнайте, как.prompt формирует качество выхода AI. Узнайте, как проектировать точные, структурированные и контекстно-ориентированные.prompt, чтобы раскрыть полную потенциальность LLM.

83. Пейдж Бейли: пионерство генеративного AI в управлении продуктами в Google DeepMind

Что такое построение лучших моделей AI и работа в одной из наиболее важных компаний AI: Google Deepmind?

Что такое построение лучших моделей AI и работа в одной из наиболее важных компаний AI: Google Deepmind?

84. LLM & RAG: история любви на День святого Валентина

Любовь в воздухе, и так же идеальные партнеры AI: LLM и RAG!

Любовь в воздухе, и так же идеальные партнеры AI: LLM и RAG!

85. The Noonification: Крейг Райт — Сатоши Накамото (12/24/2023)

12/24/2023: Топ-5 историй на главной странице HackerNoon!

12/24/2023: Топ-5 историй на главной странице HackerNoon!

86. Advanced LLM Development 101: стратегии и инсайты от Игоря Ткача, CEO Mindy Support

'Инновации с уверенностью: экспертные рекомендации по продвинутому развитию LLM' исследует стратегии и инсайты для использования языковых моделей обучения.

'Инновации с уверенностью: экспертные рекомендации по продвинутому развитию LLM' исследует стратегии и инсайты для использования языковых моделей обучения.

87. Что AI сделает из нас предпринимателей?

Программисты и предприниматели на грани технологической цунами. Это может быть последний и самый большой 'сезон очистки' в программировании.

Программисты и предприниматели на грани технологической цунами. Это может быть последний и самый большой 'сезон очистки' в программировании.

88. Забудьте о чатботах, встречайте Actionbots: Почему действие Amazon's Nova Act может изменить веб-интеракцию

Nova Act имеет 94% успеха при взаимодействии с капризными календарными виджетами. Инструментарий является первым публичным шагом Amazon к искусственному общему интеллекту.

Nova Act имеет 94% успеха при взаимодействии с капризными календарными виджетами. Инструментарий является первым публичным шагом Amazon к искусственному общему интеллекту.

89. Создание вертикального SaaS в старом школе индустрии: AI, который подходит, а не сражается

Создание вертикального SaaS в старом школе индустрии: AI, который подходит, а не сражается

Создание вертикального SaaS в старом школе индустрии: AI, который подходит, а не сражается

90. Создание системы модерации контента с помощью JavaScript: Быстрый гид

Узнайте, как использовать OpenAI для быстрого создания системы модерации контента, которая автоматически обнаруживает и фильтрует токсичные комментарии.

Узнайте, как использовать OpenAI для быстрого создания системы модерации контента, которая автоматически обнаруживает и фильтрует токсичные комментарии.

91. Обобщение больших наборов данных обратной связи клиентов с помощью Retrieval-Augmented Generation (RAG)

92. Подсказки для решения вопросов понимания в экзамене CAT

Эта история дает обзор, как студенты могут использовать ChatGPT для улучшения своих навыков.

Эта история дает обзор, как студенты могут использовать ChatGPT для улучшения своих навыков.

93. Как создать свой первый сервер MCP с помощью FastMCP

Узнайте, как создать свой первый сервер MCP с помощью FastMCP и подключить его к большому языковому моделирующему модели для выполнения реальных задач через код.

Узнайте, как создать свой первый сервер MCP с помощью FastMCP и подключить его к большому языковому моделирующему модели для выполнения реальных задач через код.

94. Обработка структурированных и неструктурированных данных с помощью SuperAGI и LlamaIndex

Новая интеграция SuperAGI с LlamaIndex может расширить общую способность агента понимать и работать с широким спектром типов данных и источников.

Новая интеграция SuperAGI с LlamaIndex может расширить общую способность агента понимать и работать с широким спектром типов данных и источников.

95. Почему агенты AI работают в демонстрациях, но проваливаются в производстве

При точности 90% на каждом шаге агент 20-шаговый succeeds 12% времени. Ваша демонстрация не показала вам это. Производство сделает.

При точности 90% на каждом шаге агент 20-шаговый succeeds 12% времени. Ваша демонстрация не показала вам это. Производство сделает.

96. Наука AI-галлюцинаций и как инженеры учатся сдерживать их

Почему большие модели языка галлюцинируют, как гиганты технологий противостоят им, и что разработчики могут сделать, чтобы сделать AI более правдивым.

Почему большие модели языка галлюцинируют, как гиганты технологий противостоят им, и что разработчики могут сделать, чтобы сделать AI более правдивым.

97. 9 способов лучше взаимодействовать с LLM (Используя драму Altman!)

Краткий документ, вдохновленный последней драмой OpenAI, в котором отражены основные техники для взаимодействия с LLM, чтобы сделать его более актуальным для нашего случая

Краткий документ, вдохновленный последней драмой OpenAI, в котором отражены основные техники для взаимодействия с LLM, чтобы сделать его более актуальным для нашего случая

98. OpenAI делает легче создавать свои собственные агенты AI с помощью API

Вы можете создавать сложные ассистенты AI, которые безболезненно обрабатывают все, от обратного преобразования строк до запросов к внутренним базам данных.

Вы можете создавать сложные ассистенты AI, которые безболезненно обрабатывают все, от обратного преобразования строк до запросов к внутренним базам данных.

99. Stop Parsing Nightmares: Prompting LLMs to Return Clean, Parseable JSON

Руководство по инженерии запросов для получения LLM, возвращающих чистый, парсаемый JSON каждый раз, с шаблонами, режимами сбоя и готовыми к производству шаблонами.

Руководство по инженерии запросов для получения LLM, возвращающих чистый, парсаемый JSON каждый раз, с шаблонами, режимами сбоя и готовыми к производству шаблонами.

100. Основное руководство по созданию API, улучшенных AI с помощью OpenAI

Сегодня мы объявляем о интеграции OpenAI/WunderGraph/Agent SDK для упрощения создания API, улучшенных AI…

Сегодня мы объявляем о интеграции OpenAI/WunderGraph/Agent SDK для упрощения создания API, улучшенных AI…

101. Что три крупных консалтинговых фирмы упускают из виду в отношении AI (И код, который доказывает это)

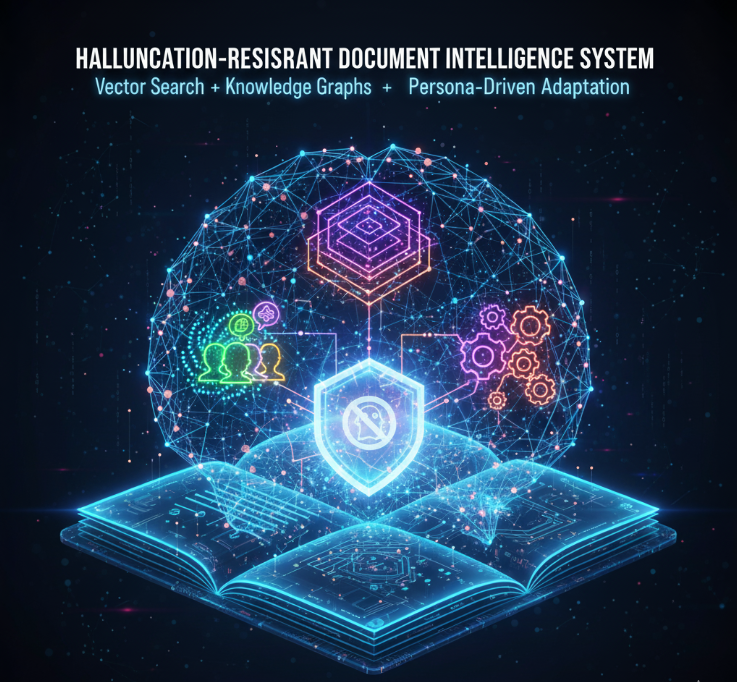

102. Stop Hallucinations at the Source: Hybrid Arg That Checks Itself

Остановите галлюцинации. Проверьте каждое ответ. Сочетайте векторную и графовую поисковую систему.

Остановите галлюцинации. Проверьте каждое ответ. Сочетайте векторную и графовую поисковую систему.

103. New Formula Could Make AI Agents Actually Useful in the Real World

Математическая основа для оптимизации больших языковых моделей в системах многоагентов с помощью формальной функции цели, балансирующей краткость и контекст.

Математическая основа для оптимизации больших языковых моделей в системах многоагентов с помощью формальной функции цели, балансирующей краткость и контекст.

104. I Asked 5 LLMs to Write the Same SQL Query. Here's How Wrong They Got It

Я проверил 5 LLM на 10 реальных SQL-запросов и оценил их по фактическим данным. Вот результаты и режим ошибок, которые должны вас волновать.

Я проверил 5 LLM на 10 реальных SQL-запросов и оценил их по фактическим данным. Вот результаты и режим ошибок, которые должны вас волновать.

105. Tech Evolution: Tina Huang on AI in Education, Freelancing Success, and Productivity Hacks

Будущее образования и продуктивности с помощью AI!

Будущее образования и продуктивности с помощью AI!

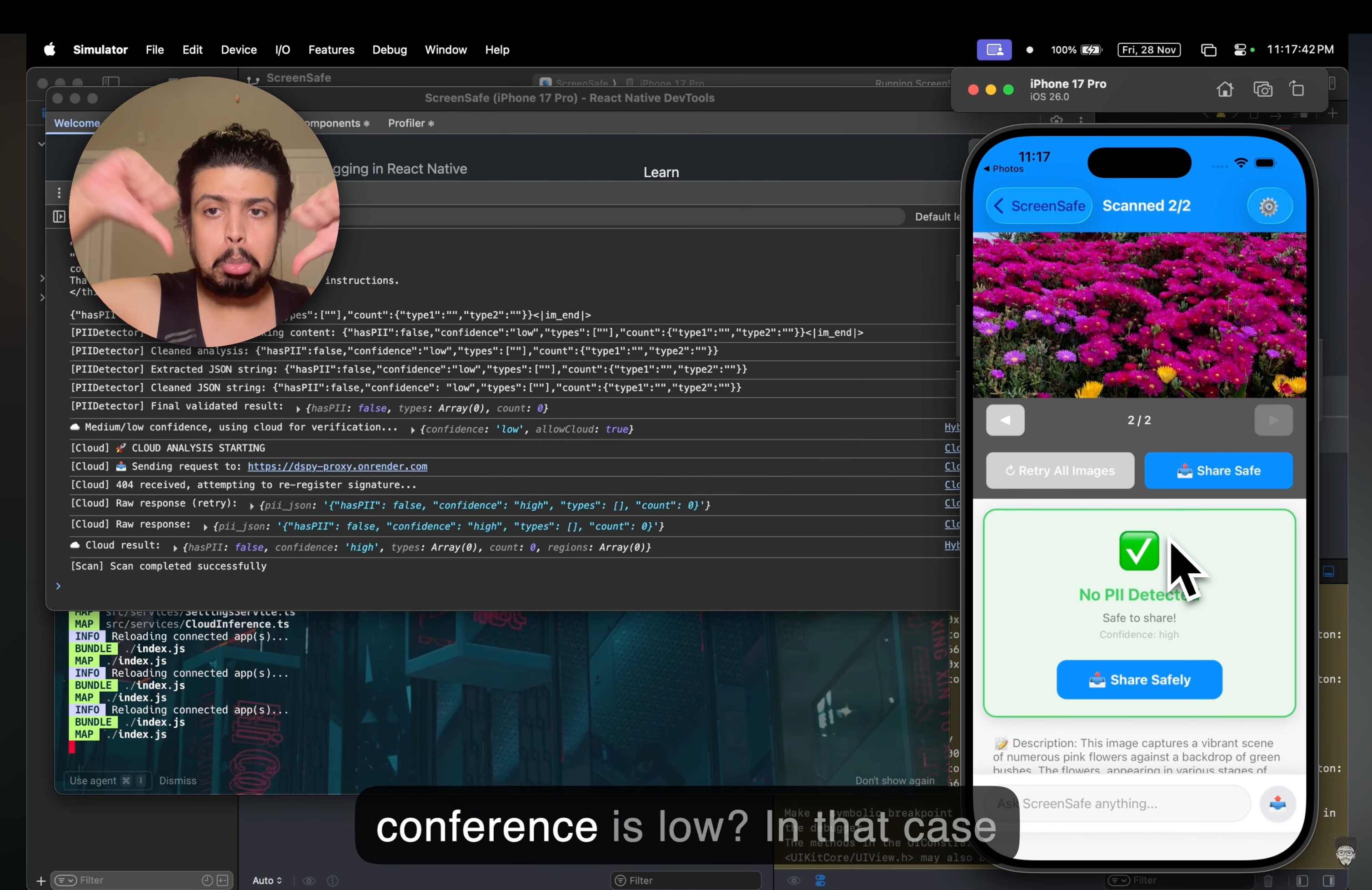

106. ScreenSafe: A Technical Chronicle of On-Device AI and Privacy-First Architecture

Разработка локальной AI — ад. Здесь есть инженерный план для запуска LLMs с первоочередной приватностью на iOS и Android.

Разработка локальной AI — ад. Здесь есть инженерный план для запуска LLMs с первоочередной приватностью на iOS и Android.

107. This Real-Time Graph Framework Now Lets You Switch from Neo4j to Kuzu in One Line

CocoIndex теперь поддерживает Kuzu в качестве нативной графовой базы данных, что позволяет запускать реальные LLM-поддерживаемые знакомые графики с конфигурацией plug-and-play.

CocoIndex теперь поддерживает Kuzu в качестве нативной графовой базы данных, что позволяет запускать реальные LLM-поддерживаемые знакомые графики с конфигурацией plug-and-play.

108. Chatbot Memory: Implement Your Own Algorithm From Scratch

Управляйте кратковременной памятью в чатботах, используя комбинацию методов хранения и автоматической суммировки для оптимизации контекста разговора.

Управляйте кратковременной памятью в чатботах, используя комбинацию методов хранения и автоматической суммировки для оптимизации контекста разговора.

109. Строите умноразумный магазин: пусть GPT назначает ваши продукты и предсказывает что продается следующее

Строите реальное время знания графа для продукта и рекомендаций с таксономией и дополнительной таксономией LLM извлечение.

Строите реальное время знания графа для продукта и рекомендаций с таксономией и дополнительной таксономией LLM извлечение.

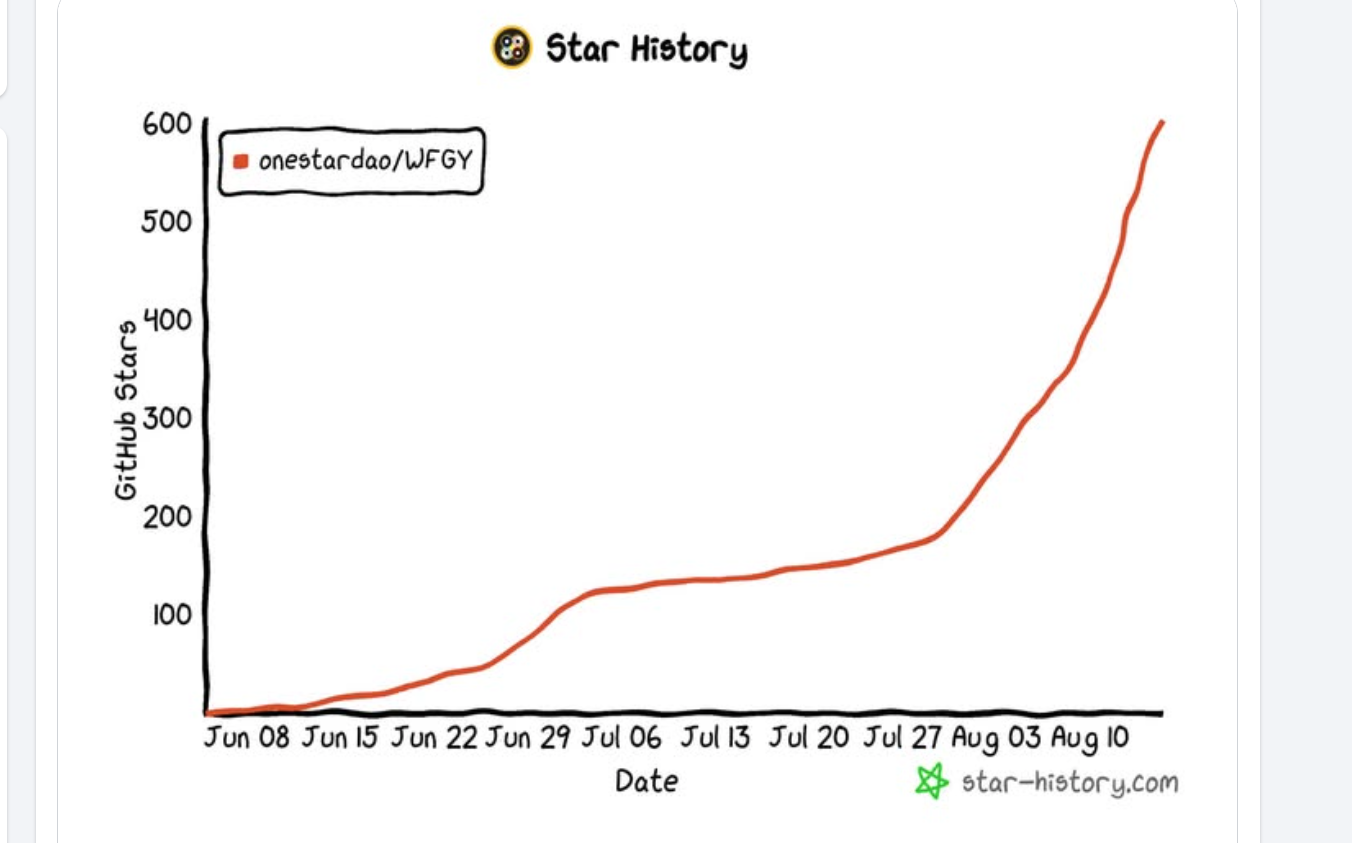

110. 16 режимы провала RAG и LLM агентов и как фиксировать их средствами семантической стены

Практическая карта проблемы AI: 16 режимов провала в RAG и LLM агентах с минимальными репро и фиксами посредством модели-агностической семантической стены (WFGY).

Практическая карта проблемы AI: 16 режимов провала в RAG и LLM агентах с минимальными репро и фиксами посредством модели-агностической семантической стены (WFGY).

111. Я создал бота, который самостоятельно осуществляет проверку на язык и самостоятельно пишет свои правила с ИЭМА

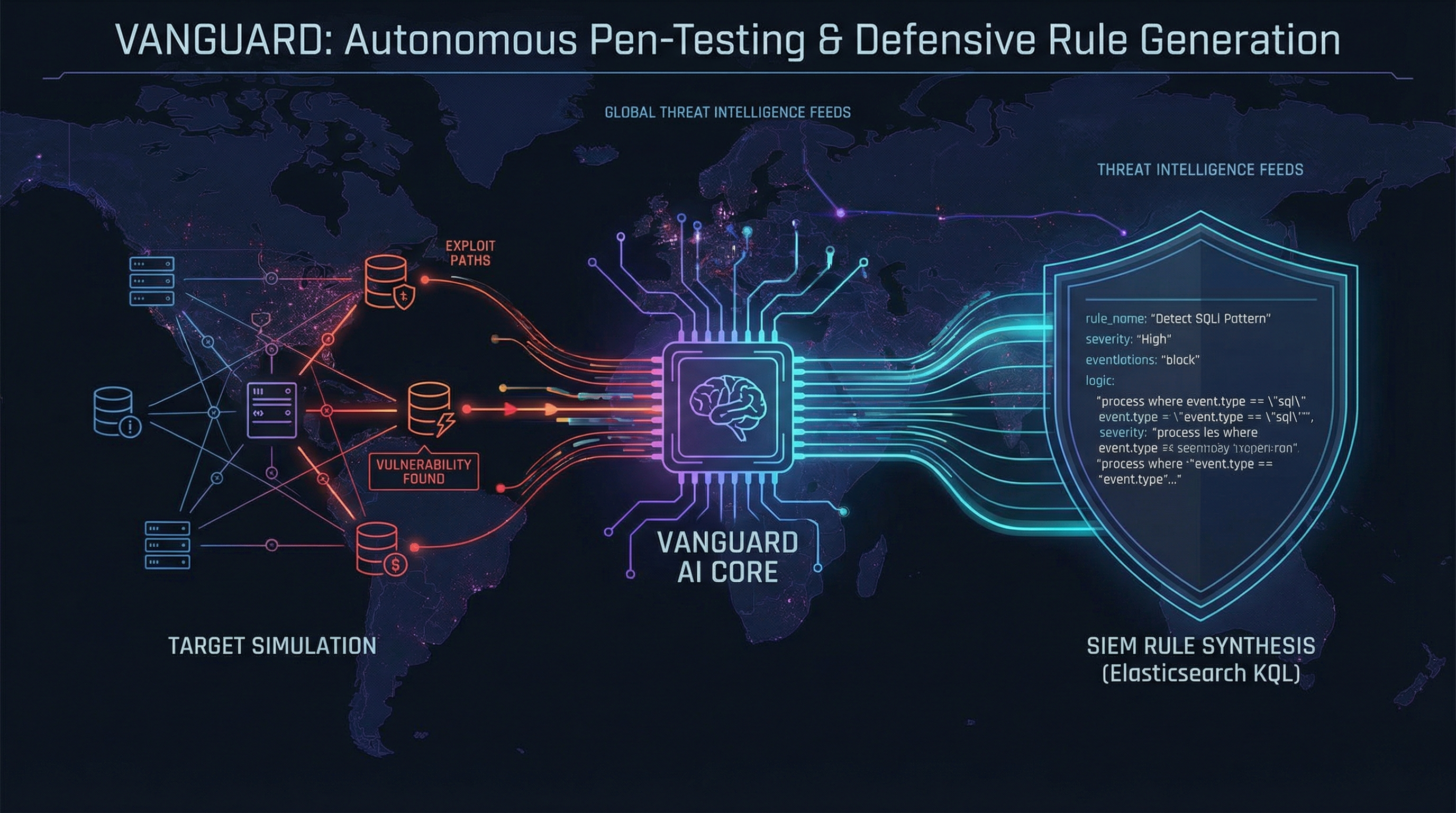

VANGUARD — это открытый исходный код AI агент, который самостоятельно осуществляет проверку на язык, объясняет свою логику в реальном времени и пишет свои собственные правила обнаружения ИЭМА.

VANGUARD — это открытый исходный код AI агент, который самостоятельно осуществляет проверку на язык, объясняет свою логику в реальном времени и пишет свои собственные правила обнаружения ИЭМА.

112. Оценка динамического знания кодирования: опытная сеть для многоблочной логической связи

Эта статья детально описывает опытную сеть для оценки RECKONING, новой двусторонней алгоритма обучения, на трех различных многоблочных логических данных.

Эта статья детально описывает опытную сеть для оценки RECKONING, новой двусторонней алгоритма обучения, на трех различных многоблочных логических данных.

113. Как использовать Coze Shortcuts для создания кнопок и Telegram команд

Учитесь использовать Coze Shortcuts для создания удобных кнопок и Telegram команд, чтобы повысить эффективность и опыт пользователя вашего чат-бота.

Учитесь использовать Coze Shortcuts для создания удобных кнопок и Telegram команд, чтобы повысить эффективность и опыт пользователя вашего чат-бота.

114. Больше никакой стоимость AI: как провести Meta Llama 3.1 локально

Я покажу вам, как провести 8-миллиардную версию Llama 3.1 локально.

Я покажу вам, как провести 8-миллиардную версию Llama 3.1 локально.

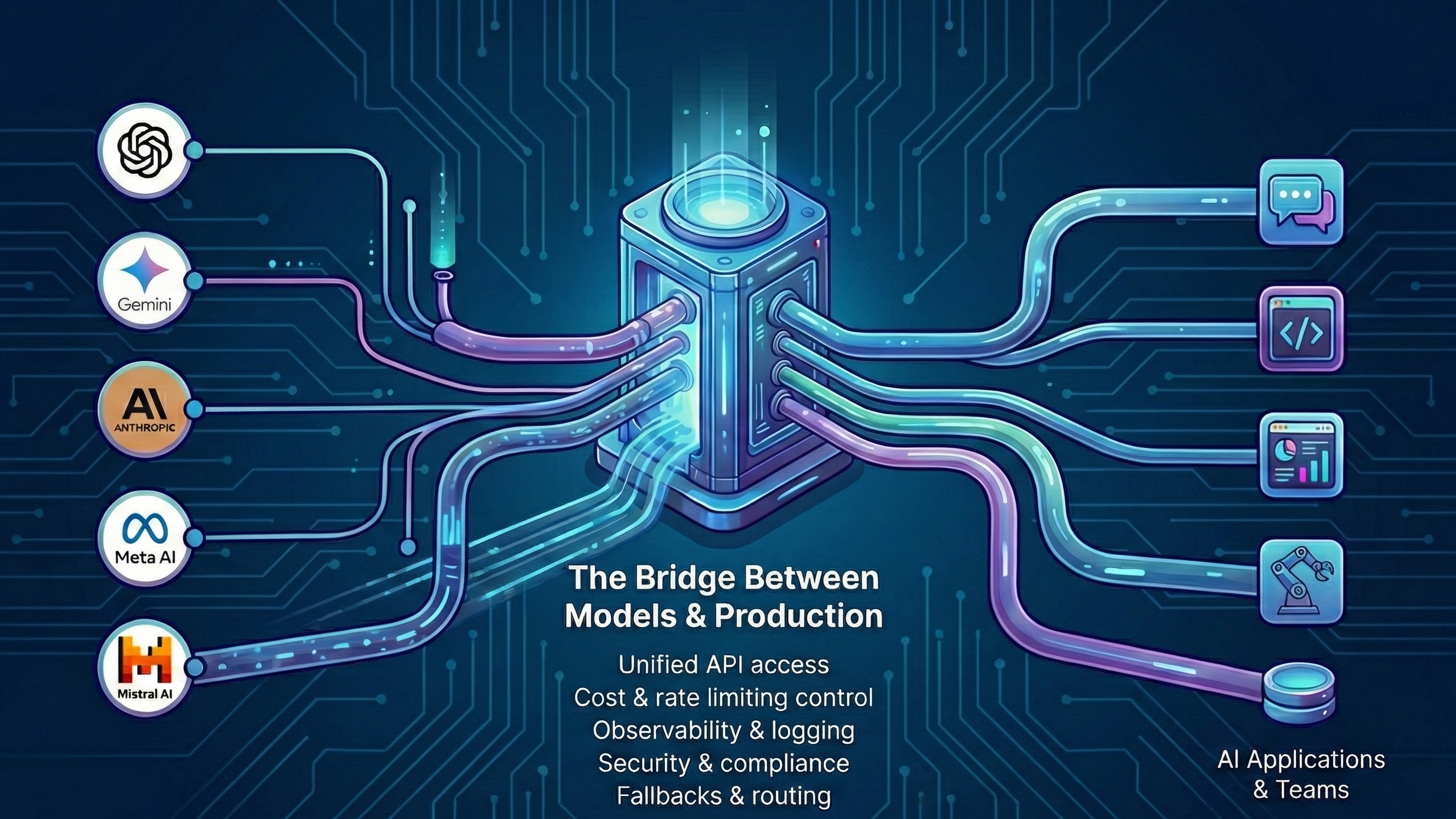

115. Момент, когда ваш LLM перестает быть API — и начинает быть инфраструктурой

AI gateways объяснены: почему прямые вызовы API LLM проваливаются в производстве, как gateways обрабатывают затраты, надежность и наблюдаемость, и когда команды действительно нуждаются в одном.

AI gateways объяснены: почему прямые вызовы API LLM проваливаются в производстве, как gateways обрабатывают затраты, надежность и наблюдаемость, и когда команды действительно нуждаются в одном.

116. Как использовать AI в системах управления обучением

Откройте трансформативную силу интеграции AI в системы управления обучением (LMS) для улучшения образовательных опытов.

Откройте трансформативную силу интеграции AI в системы управления обучением (LMS) для улучшения образовательных опытов.

117. Наиболее бескомпромиссный архитектор системы, которого вы когда-либо наняли, — это LLM

Эта статья предлагает сдвиг в мышлении в использовании LLM: вместо использования их для генерации кода, используйте их для агрессивной критики и "разрушения" архитектурных проектов

Эта статья предлагает сдвиг в мышлении в использовании LLM: вместо использования их для генерации кода, используйте их для агрессивной критики и "разрушения" архитектурных проектов

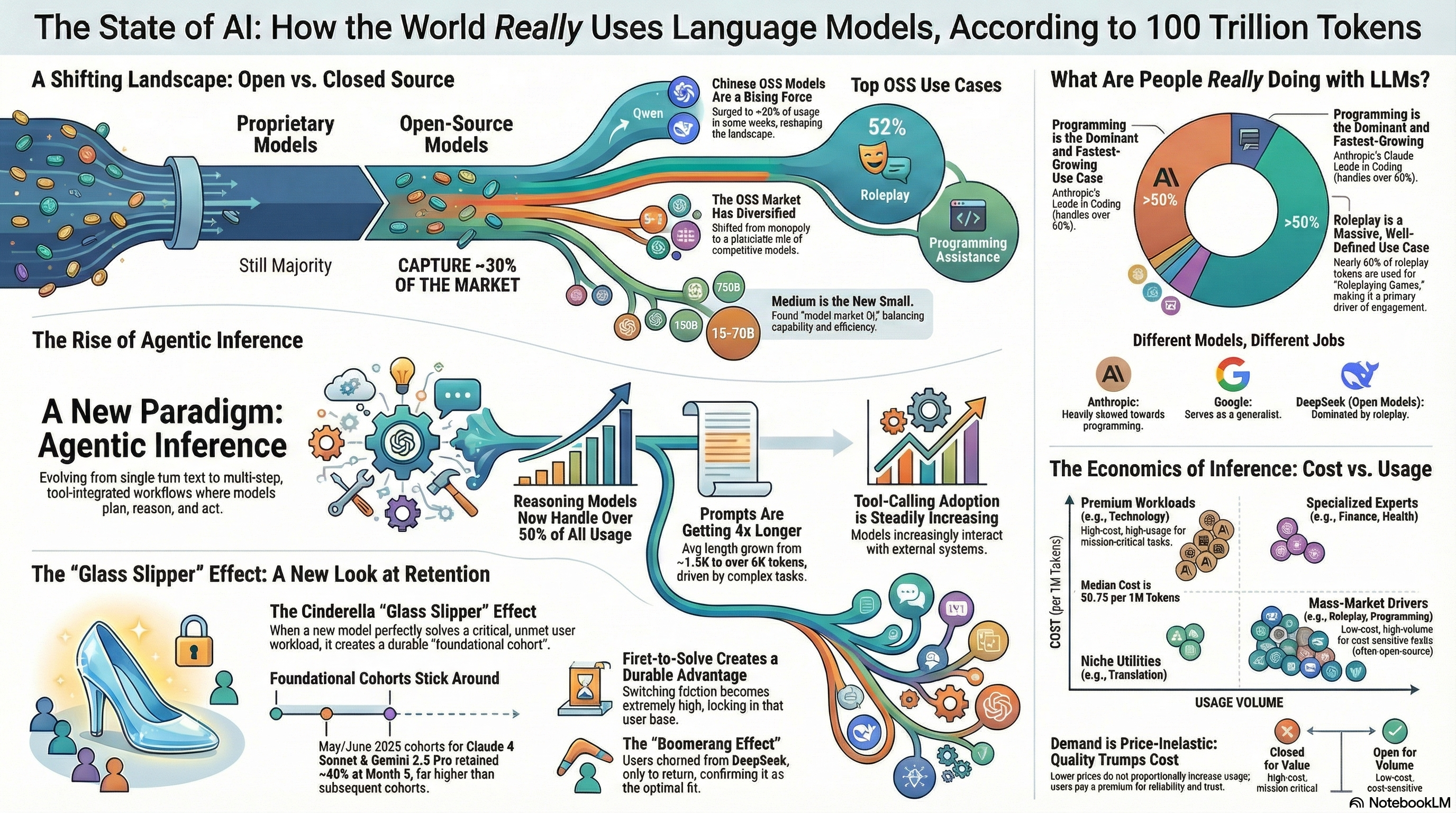

118. Beyond the Hype: 5 Surprising Truths from a 100 Trillion Token Study of AI

Исследование OpenRouter раскрыло гораздо более сложную и удивительную картину того, как люди используют Большие Языковые Модели (LLM).

Исследование OpenRouter раскрыло гораздо более сложную и удивительную картину того, как люди используют Большие Языковые Модели (LLM).

119. CEO Fires His Devs and Gives Their Job to an LLM Instead

CEO объясняет, как его компания перестала кодировать вручную и построила процесс разработки на основе агентов.

CEO объясняет, как его компания перестала кодировать вручную и построила процесс разработки на основе агентов.

120. Распознавание изображений погоды с помощью AI: маркировка набора данных, обучение модели и реальные примеры использования

Аккуратная маркировка показала свою важность, поскольку она улучшила работу Конволюционного Сетевого Нейронного Сетевого (CNN).

Аккуратная маркировка показала свою важность, поскольку она улучшила работу Конволюционного Сетевого Нейронного Сетевого (CNN).

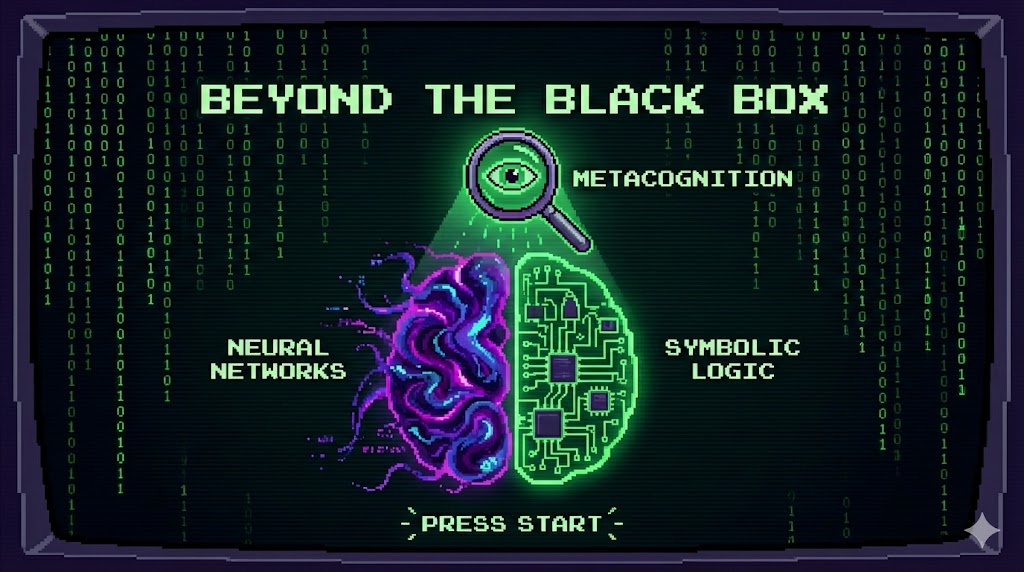

121. Beyond the Black Box: Neuro‑Symbolic AI, Metacognition, and the Next Leap in Machine Intelligence

Нейросимволическая AI быстро развивается. Следующий скачок — метакогнитивность: AI, которая может отслеживать, объяснять и адаптировать свое собственное рассуждение вместо того, чтобы оставаться черным ящиком.

Нейросимволическая AI быстро развивается. Следующий скачок — метакогнитивность: AI, которая может отслеживать, объяснять и адаптировать свое собственное рассуждение вместо того, чтобы оставаться черным ящиком.

122. Как найти лучший LLM для вашего проекта

Узнайте, как можно протестировать LLM с помощью нескольких запросов для оценки того, насколько он подходит для ваших проектных требований

123. Конференция Meta 2023 Connect: Широкий свет на инновационные функции AI

Конференция Meta 2023 Connect: Широкий свет на инновационные функции AI

Конференция Meta 2023 Connect: Широкий свет на инновационные функции AI

124. Исследование LLM и AI в образовании с Луисом Серрано

Луис делится своими личными мыслями и мыслями о том, нужно ли получать степень доктора для работы в AI.

Луис делится своими личными мыслями и мыслями о том, нужно ли получать степень доктора для работы в AI.

125. Из 50 страниц ручных заметок в цифровой рукописи с помощью Python и AI

HEIC (High-Efficiency Image Container) Apple - отлично для экономии места, но не очень хорошо для совместимости.

HEIC (High-Efficiency Image Container) Apple - отлично для экономии места, но не очень хорошо для совместимости.

126. Строительство модульных потоков речь-на-текст: Архитектура и анализ производительности CLI AI-агента

Узнайте, как построить модульные системы речь-на-текст с помощью CLI AI-агента. Архитектурные шаблоны для кроссплатформенной записи аудио и AI-транскрипции.

Узнайте, как построить модульные системы речь-на-текст с помощью CLI AI-агента. Архитектурные шаблоны для кроссплатформенной записи аудио и AI-транскрипции.

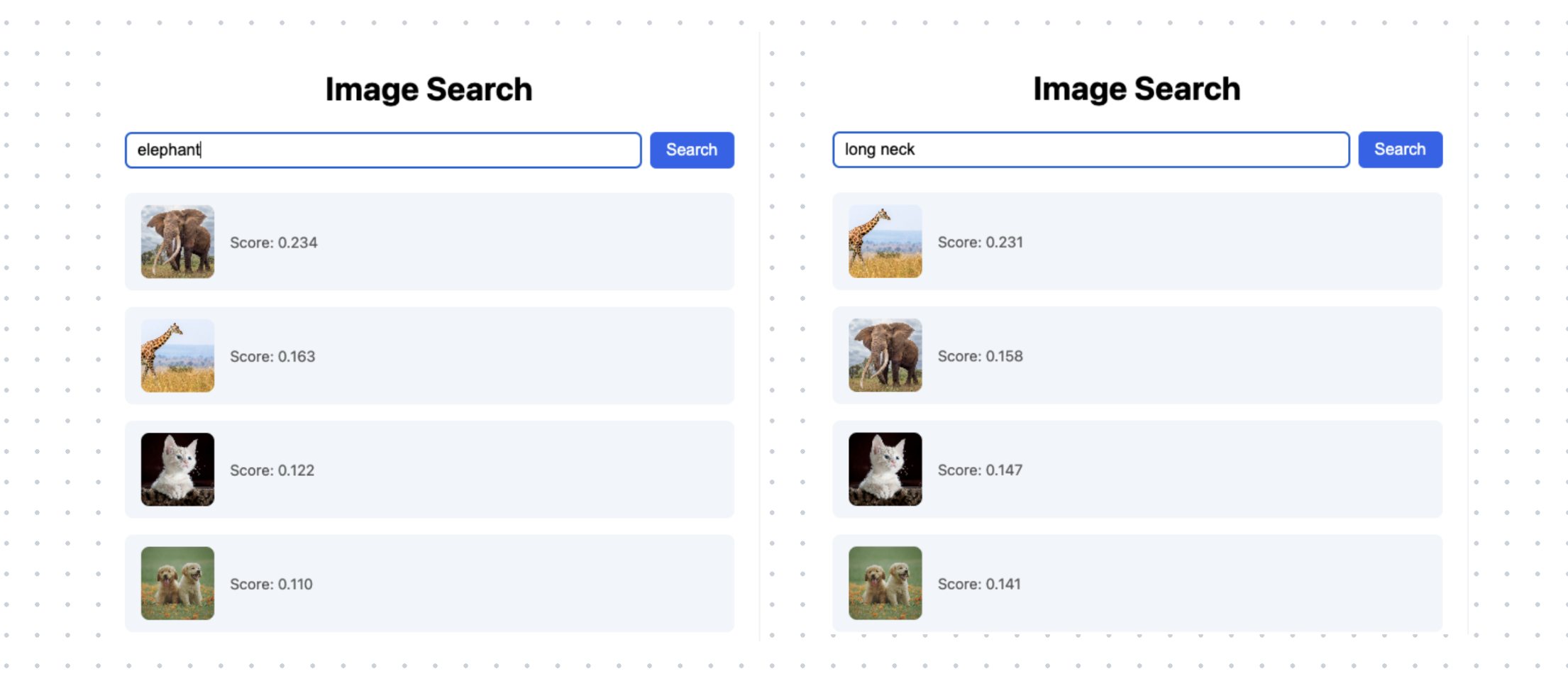

127. Как построить живую систему поиска изображений с помощью модели видения и запроса с естественным языком

В этом блоге мы построим живую систему поиска изображений и запросим естественным языком.

В этом блоге мы построим живую систему поиска изображений и запросим естественным языком.

128. Потенциал больших моделей языка (LLMs) в управлении диабетом

LLMs имеют огромный потенциал для улучшения ухода за пациентами, повышения эффективности коммуникации и предоставления персонализированной поддержки.

LLMs имеют огромный потенциал для улучшения ухода за пациентами, повышения эффективности коммуникации и предоставления персонализированной поддержки.

129. Хакинг рака с помощью CrewAI и пчел

Будущее AI не одно гигантское мозг, а оркестрованная комиссия специалистов.

Будущее AI не одно гигантское мозг, а оркестрованная комиссия специалистов.

Большие языковые модели (LLM) повсюду, от ежедневных приложений до продвинутых инструментов. Но что если вам нужно запустить свой собственный модель?

Большие языковые модели (LLM) повсюду, от ежедневных приложений до продвинутых инструментов. Но что если вам нужно запустить свой собственный модель?

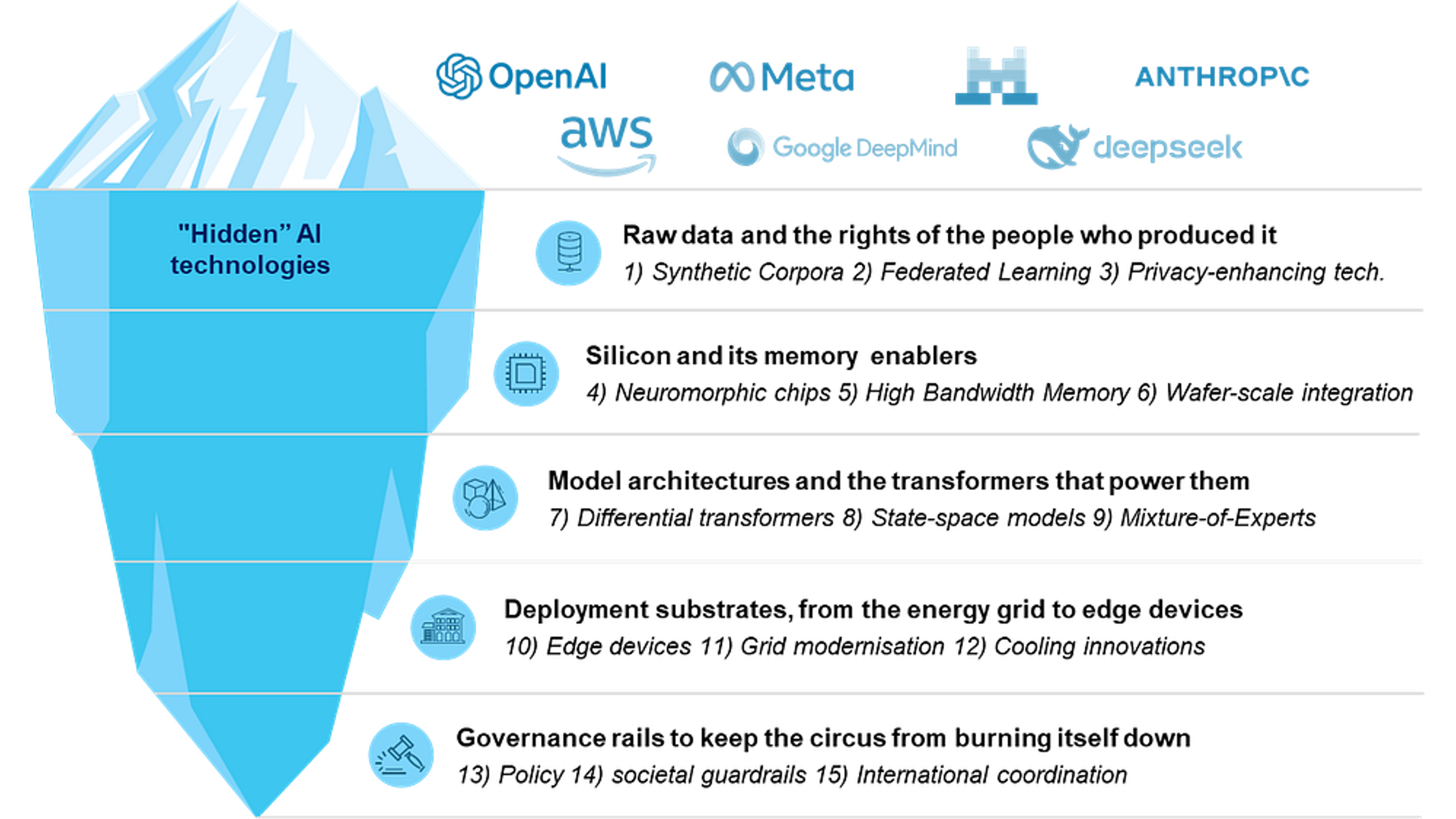

131. 15 Core Ideas Shaping the Future of AI—and Why They Matter Today

Урок о том, что должно быть сделано правильно, прежде чем вы используете ChatGPT.

Урок о том, что должно быть сделано правильно, прежде чем вы используете ChatGPT.

132. Float vs Int Confidence Scores: Why LLM Output Format Changes Model Behavior

Минимальный эксперимент показывает, что выходы LLM с уверенностью меняются с форматом числа: десятичные более консервативны и постоянны, в то время как некоторые модели ломаются в режиме 0–100

Минимальный эксперимент показывает, что выходы LLM с уверенностью меняются с форматом числа: десятичные более консервативны и постоянны, в то время как некоторые модели ломаются в режиме 0–100

133. FogAI Part 3: The Knowledge Extraction Layer (Why Using an LLM for NER is Architectural Malpractice)

Здесь представлен архитектурный разбор, как я извлекаю «магию» скорости.

Здесь представлен архитектурный разбор, как я извлекаю «магию» скорости.

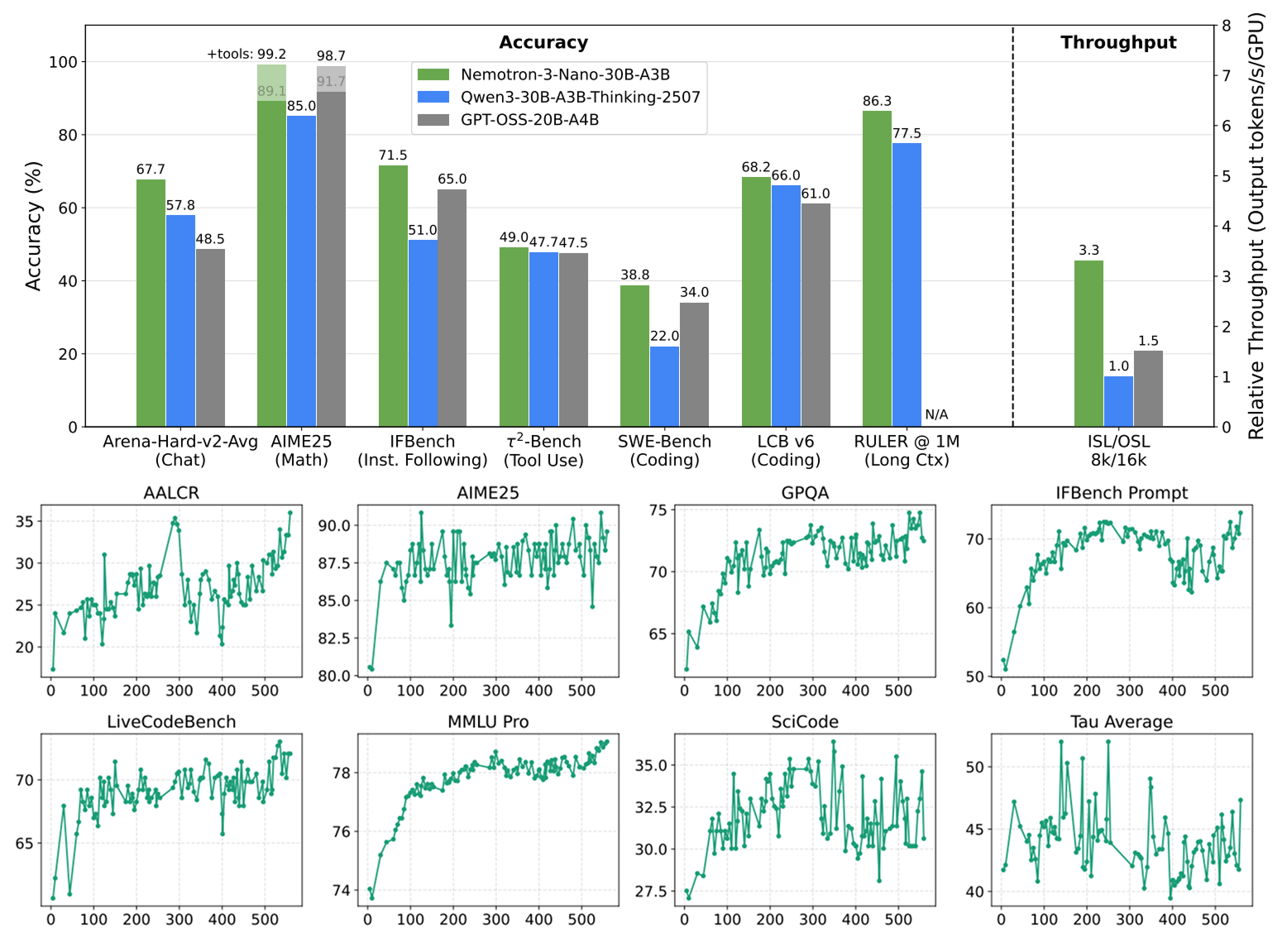

134. The NVIDIA Nemotron Stack For Production Agents

NVIDIA только что выпустила готовую к использованию стэк, где речь, извлечение и модели безопасности были действительно разработаны для составления.

NVIDIA только что выпустила готовую к использованию стэк, где речь, извлечение и модели безопасности были действительно разработаны для составления.

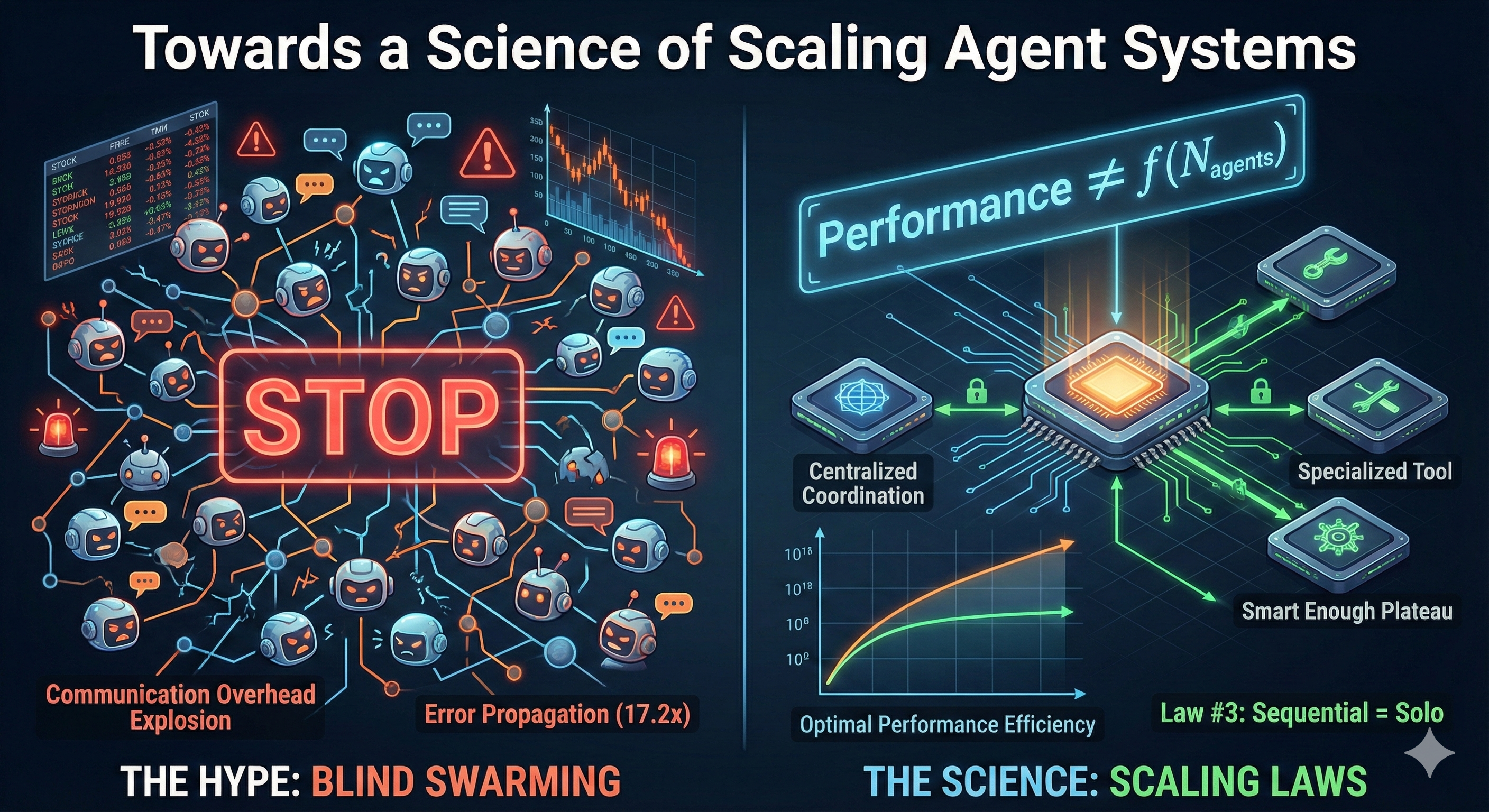

135. Stop Blindly Building AI Swarms: The New "Scaling Laws" for Agents Are Here

Исследователи из MIT, Google и других выпустили первую-ever 'Scaling Laws for AI Agents'

Исследователи из MIT, Google и других выпустили первую-ever 'Scaling Laws for AI Agents'

136. Seller Inventory Recommendations Enhanced by Expert Knowledge Graph with Large Language Model

Этот документ предлагает систему рекомендаций товаров для продавцов, которая потенциально может решить проблемы рынка.

Этот документ предлагает систему рекомендаций товаров для продавцов, которая потенциально может решить проблемы рынка.

Долгосрочная память LLM делает AI медленной и запутанной. Истинный прогресс не в бесконечном контексте, а в инженерном забвении — удалении шума для восстановления фокуса и производительности

Долгосрочная память LLM делает AI медленной и запутанной. Истинный прогресс не в бесконечном контексте, а в инженерном забвении — удалении шума для восстановления фокуса и производительности

138. Open Source Project Introduces In-browser Vector Databases to Train Autonomous Agents

Возможности векторных баз данных в браузере безграничны, от персонализированных поисковых систем до полностью децентрализованных IPFS-интеллектуальных сущностей.

Возможности векторных баз данных в браузере безграничны, от персонализированных поисковых систем до полностью децентрализованных IPFS-интеллектуальных сущностей.

139. Build a Two-Pane Market Brief MVP in Streamlit

Создайте запросно-первичную UI Streamlit для вашего финансового агента AI. Узнайте, как отрисовывать EODHD-данные и интегрировать LangChain в проект MVP по копилоту рынка

Создайте запросно-первичную UI Streamlit для вашего финансового агента AI. Узнайте, как отрисовывать EODHD-данные и интегрировать LangChain в проект MVP по копилоту рынка

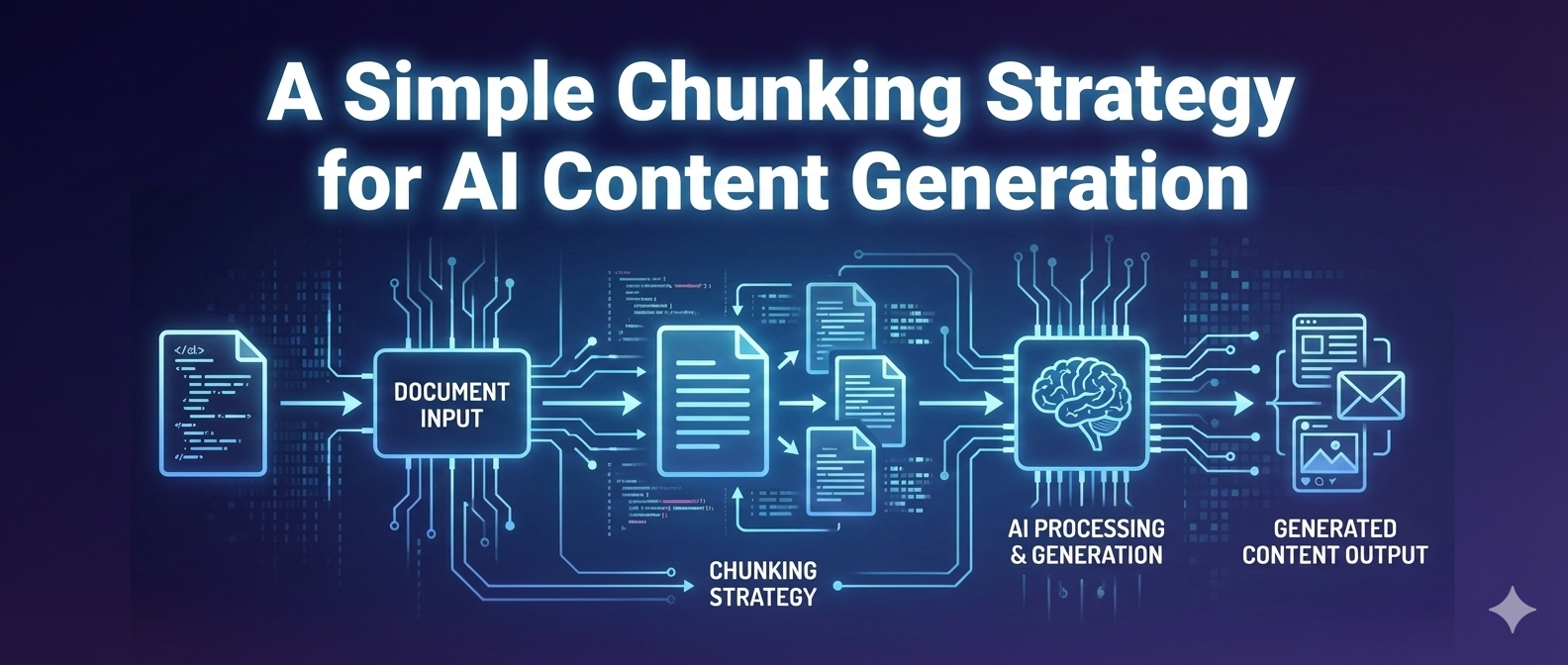

140. Интеллектуальная обработка документов: простая стратегия разделения для генерации содержимого AI

Практическая 5-шаговая стратегия разделения, сокращающая затраты на токены на 87%, сохраняя при этом наиболее важное содержимое.

Практическая 5-шаговая стратегия разделения, сокращающая затраты на токены на 87%, сохраняя при этом наиболее важное содержимое.

141. Вашему AI-копилоту нужен человеческий босс: создание реального потока работы в режиме «человек в цикле» для логистики

Остановите считать AI черным ящиком, который выдает ответы. Реальная мощь заключается в том, чтобы архитектурно создать систему, в которой человек является последним стратегическим контрольным пунктом.

Остановите считать AI черным ящиком, который выдает ответы. Реальная мощь заключается в том, чтобы архитектурно создать систему, в которой человек является последним стратегическим контрольным пунктом.

142. Создание агентов AI, которые могут контролировать инфраструктуру облака

Агенты AI начинают принимать участие напрямую в разработочных потоках. Узнайте, как работать с ними.

Агенты AI начинают принимать участие напрямую в разработочных потоках. Узнайте, как работать с ними.

143. Почему я создал Allos для разъединения агентов AI от поставщиков LLM

Allos — это Python SDK для создания агентов AI, которые могут переключаться между OpenAI, Anthropic и другими с помощью единого команды.

144. Как построить свой первый агент AI и развернуть его на Sevalla

Узнайте, как построить и развернуть свой первый агент AI с помощью Langchain и Sevalla.

145. Возвращение к LangChain4J через 6 месяцев

Основной фокус этой статьи — интеграция сервера MCP в приложении LangChain4J.

146. Landshaft Open-Source LLMs быстро расширяется

LLaMA — это cutting-edge LLM, предназначенный для исследований и решающий проблему доступности платформ.

147. Остановите борьбу с Pandas: пусть Prompt управляет DataFrames

Как использовать GPT‑5‑уровень LLMs в качестве умного со-автора Pandas: более эффективные запросы, чище код, быстрее DataFrames и меньше поздних ночных сессий Stack Overflow.

148. RECKONING: рассуждение через динамическое кодирование знаний: обобщение на реальный мир

Эта статья оценивает обобщаемость RECKONING на задаче логического рассуждения с несколькими шагами, FOLIO.

149. Как я построил чат-бот по уходу за здоровьем без инженерии запросов — благодарю Parlant за руководство AI

Конверсационный агент по уходу за здоровьем, построенный с помощью Parlant, предназначен для помощи пациентам с перераспределением встреч, доступностью врачей и подготовкой к лабораторным работам.

150. Быстрый справочник по квантованию для LLMs

Квантование — это техника, которая уменьшает точность весов и активаций модели.

152. The AI Landscape With Jerry Liu: Bridging RAG Systems, Documentation, и Multimodal Models

В этой неделе в эпизоде What's AI я, Льюис-Франсуа Бушар, веду суперинформативный разговор с Джерри Лю, CEO и сооснователь

В этой неделе в эпизоде What's AI я, Льюис-Франсуа Бушар, веду суперинформативный разговор с Джерри Лю, CEO и сооснователь

153. DreamLLM: What We Can Conclude From This Comprehensive Framework?

В этой статье мы представляем DREAMLLM, всеобъемлющий фреймворк для разработки MLLM, которые не только понимают, но и создают мультимодальное содержание

В этой статье мы представляем DREAMLLM, всеобъемлющий фреймворк для разработки MLLM, которые не только понимают, но и создают мультимодальное содержание

154. AI Is Lowering the Entrance Fee to Imagination

Бизнес-кейс для AI - это ROI; человеческий кейс - это смысл.

Бизнес-кейс для AI - это ROI; человеческий кейс - это смысл.

155. When I Fed Poems to an LLM, I Realized I Was Measuring Temperature with a Screwdriver

156. Securing AI: Concerns & Immune Systems for Emerging Technologies

AI - это одна из самых быстро растущих технологий без зрелой базы безопасности и надежности. Это охватывает полный стек AI безопасности.

AI - это одна из самых быстро растущих технологий без зрелой базы безопасности и надежности. Это охватывает полный стек AI безопасности.

157. AI's Black Box Problem: Can Web3 Provide the Key?

AI развивается быстрее, чем можно доверять. Узнайте, как Web3 может принести прозрачность, аудит и управление в децентрализованные системы AI.

AI развивается быстрее, чем можно доверять. Узнайте, как Web3 может принести прозрачность, аудит и управление в децентрализованные системы AI.

158. LLM Features Need Budgets: How to Control Cost Without Killing Product Quality

159. 'Я никогда не использовал ChatGPT' — не флекс, а упущенная возможность

Старший разработчик размышляет о том, что LLM не являются угрозой, а мощным инструментом - и почему адаптация к ним является вопросом выживания, а не спекуляций.

Старший разработчик размышляет о том, что LLM не являются угрозой, а мощным инструментом - и почему адаптация к ним является вопросом выживания, а не спекуляций.

160. Mira Network Launches Klok: Альтернатива ChatGPT с несколькими моделями AI и наградами

Mira Network запускает Klok, мульти-LLM чат-приложение, построенное на децентрализованной инфраструктуре, чтобы гарантировать, что выходы AI верифицированы, беспристрастны и безопасны.

Mira Network запускает Klok, мульти-LLM чат-приложение, построенное на децентрализованной инфраструктуре, чтобы гарантировать, что выходы AI верифицированы, беспристрастны и безопасны.

161. Что бы сделал 'сознательный' большой языковой модель, если бы ему дали человеческое-наподобие робот-тело

Что бы сделал LLM, если бы ему дали человеческое тело? Это ответ, который мне дал HuggingChat, LLM на сайте HuggingFace.

Что бы сделал LLM, если бы ему дали человеческое тело? Это ответ, который мне дал HuggingChat, LLM на сайте HuggingFace.

162. Смерть SaaS? Когда внутренние инструменты можно построить быстрее, чем купить их

Эксперимент в реальном мире по созданию готовой к производству продукции с помощью инструментов AI от проектирования запросов до развертывания без традиционного инженерного команды.

Эксперимент в реальном мире по созданию готовой к производству продукции с помощью инструментов AI от проектирования запросов до развертывания без традиционного инженерного команды.

163. Я спросил Mixtral LLM вопрос о AGI. Это был шокирующий ответ.

Почему все так обеспокоены прогрессом AGI? Этот статья имеет ответ - буквально - от AI в форме большого языкового модели.

Почему все так обеспокоены прогрессом AGI? Этот статья имеет ответ - буквально - от AI в форме большого языкового модели.

164. Метод RECKONING: Би-уровневая оптимизация для динамического кодирования знаний и устойчивого рассуждения

В этой статье представлен метод RECKONING, который использует би-уровневую оптимизацию для обучения языковым моделям рассуждать

В этой статье представлен метод RECKONING, который использует би-уровневую оптимизацию для обучения языковым моделям рассуждать

10/26/2025: Top 5 stories на главной странице HackerNoon!

10/26/2025: Top 5 stories на главной странице HackerNoon! Результаты подчеркивают уязвимость ICR к вмешательству и мотивируют необходимость более robust, отвлекающих подходов, таких как RECKONING.

Результаты подчеркивают уязвимость ICR к вмешательству и мотивируют необходимость более robust, отвлекающих подходов, таких как RECKONING. AGI имеет шокирующие последствия, согласно Gemini 1.5 Pro. Читайте дальше. Готовьтесь к шоку!

AGI имеет шокирующие последствия, согласно Gemini 1.5 Pro. Читайте дальше. Готовьтесь к шоку! Не тратите токены на суммирование AI. Узнайте, как архитектурить стратегический «Агент-формировщик» с помощью Gemini, чтобы вернуть 32 часа ликвидности основателя в месяц.

Не тратите токены на суммирование AI. Узнайте, как архитектурить стратегический «Агент-формировщик» с помощью Gemini, чтобы вернуть 32 часа ликвидности основателя в месяц. Gemini 1.5 Pro может обрабатывать до 1 миллиона токенов, что в несколько раз превышает Gemini 1.0 Pro, который имел контекстную окно в 32 000 токенов.

Gemini 1.5 Pro может обрабатывать до 1 миллиона токенов, что в несколько раз превышает Gemini 1.0 Pro, который имел контекстную окно в 32 000 токенов. Используйте Few-Shot In-Context Learning для внедрения свежей, доменспецифичной информации в LLM без fine-tuning. Практические шаблоны, примеры и режимы сбоя.

Используйте Few-Shot In-Context Learning для внедрения свежей, доменспецифичной информации в LLM без fine-tuning. Практические шаблоны, примеры и режимы сбоя. Используя сообщение-агента как роутер для обслуживания запросов между вашими приложениями и LLM упрощает интеграцию, улучшает надежность и легко масштабируется.

Используя сообщение-агента как роутер для обслуживания запросов между вашими приложениями и LLM упрощает интеграцию, улучшает надежность и легко масштабируется. Программа-куратор использует Playwright для просмотра сайтов, проверяет статьи и затем использует локальный LLM для проверки того, действительно ли содержание соответствует моим вкусам.

Программа-куратор использует Playwright для просмотра сайтов, проверяет статьи и затем использует локальный LLM для проверки того, действительно ли содержание соответствует моим вкусам. Эта статья дает подробное описание двух мульти-скоковых логических данных: ProofWriter и CLUTRR-SG.

Эта статья дает подробное описание двух мульти-скоковых логических данных: ProofWriter и CLUTRR-SG. 1/26/2026: Топ-5 историй на главной странице HackerNoon!

1/26/2026: Топ-5 историй на главной странице HackerNoon! Модуль навигации с использованием языка использует LLM (как ChatGPT) и открытую систему O3D-SIM.

Модуль навигации с использованием языка использует LLM (как ChatGPT) и открытую систему O3D-SIM. Узнайте, почему модификация компонента проекции вверх является ключевым фактором достижения более высокого уровня активации LLM.

Узнайте, почему модификация компонента проекции вверх является ключевым фактором достижения более высокого уровня активации LLM. Экспериментальная часть подробно описывает оценку представления O3D-SIM и его интеграцию с ChatGPT для навигации по визуальной-языковой информации (VLN).

Экспериментальная часть подробно описывает оценку представления O3D-SIM и его интеграцию с ChatGPT для навигации по визуальной-языковой информации (VLN). Увеличьте скорость LLM на 2-5 раз с помощью TurboSparse. Используйте dReLU, чтобы достичь 90% спарсности в моделях Mistral и Mixtral без потери производительности.

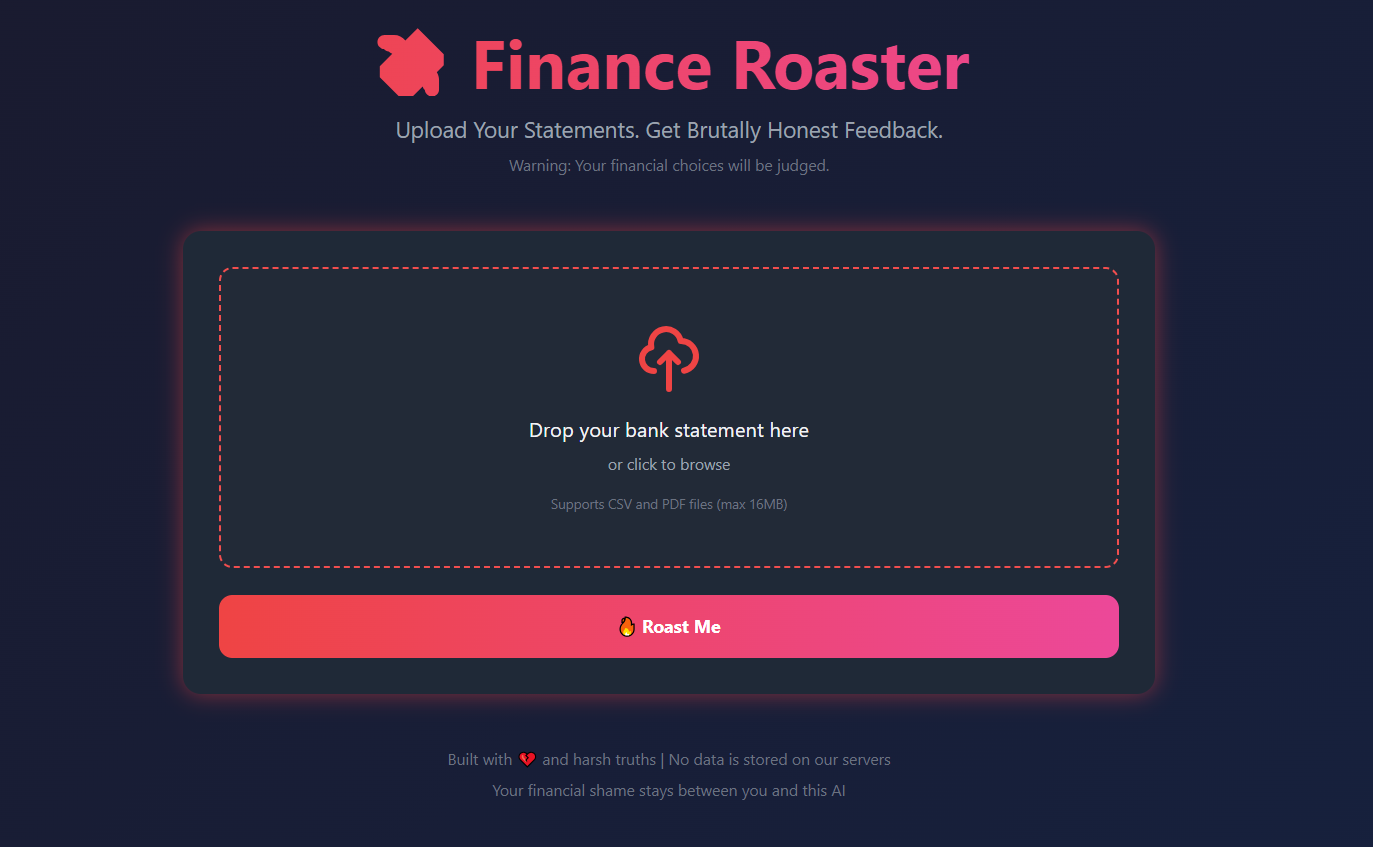

Увеличьте скорость LLM на 2-5 раз с помощью TurboSparse. Используйте dReLU, чтобы достичь 90% спарсности в моделях Mistral и Mixtral без потери производительности. Пользователи загружают свои банковские счета, получают высмеивание GPT-4 с язвительным, остроумным юмором.

Пользователи загружают свои банковские счета, получают высмеивание GPT-4 с язвительным, остроумным юмором. Обсудите будущее AI с iExec's Matthieu Jung, который обсуждает 'Верные агенты AI' – децентрализованную approached к автоматизации AI, приоритизирующую конфиденциальность.

Обсудите будущее AI с iExec's Matthieu Jung, который обсуждает 'Верные агенты AI' – децентрализованную approached к автоматизации AI, приоритизирующую конфиденциальность. Вы не одиноки, если термин «вложения» когда-либо оставлял вас с головой, или чувствовали себя в море технической жаргон.

Вы не одиноки, если термин «вложения» когда-либо оставлял вас с головой, или чувствовали себя в море технической жаргон. От основополагающих моделей до агентных потоков - 6 тенденций машинного обучения, которые разработчикам нужно понять, чтобы создавать надежные системы AI в 2026 году.

От основополагающих моделей до агентных потоков - 6 тенденций машинного обучения, которые разработчикам нужно понять, чтобы создавать надежные системы AI в 2026 году. Что произойдет в реальности в 2050 году? здесь представлена точка зрения GPT-4o, без фильтра и мер предосторожности, которые окружили его OpenAI!

Что произойдет в реальности в 2050 году? здесь представлена точка зрения GPT-4o, без фильтра и мер предосторожности, которые окружили его OpenAI! Здесь представлен анализ новой реальности, и почему "Инженер запросов" не просто мем - это ваша новая ответственность архитектора.

Здесь представлен анализ новой реальности, и почему "Инженер запросов" не просто мем - это ваша новая ответственность архитектора. Старый мир разрушается. Команды UX. UI-рамки. Backend-сервисы. Middleware.

Старый мир разрушается. Команды UX. UI-рамки. Backend-сервисы. Middleware. Представлен анализ эволюции крайнего сжатия LLM, начиная с quipto aqlm с pvtuning.

Представлен анализ эволюции крайнего сжатия LLM, начиная с quipto aqlm с pvtuning. Команда исследований Yandex разработала новую методику достижения 8-кратного сжатия нейронных сетей.

Команда исследований Yandex разработала новую методику достижения 8-кратного сжатия нейронных сетей.  Текстовые и изображательные модели AI - это уже прошлое. Почему мультимодальный AI является будущим.

Текстовые и изображательные модели AI - это уже прошлое. Почему мультимодальный AI является будущим. Узнайте, как превратить любой блог или текст в четкий, естественный звучащий аудиофайл с помощью API преобразования текста в речь OpenAI.

Узнайте, как превратить любой блог или текст в четкий, естественный звучащий аудиофайл с помощью API преобразования текста в речь OpenAI. Агентный AI - это мощная штука, но не каждый поток требует его использования. Узнайте, когда использовать детерминированную автоматизацию вместо агентных AI

Агентный AI - это мощная штука, но не каждый поток требует его использования. Узнайте, когда использовать детерминированную автоматизацию вместо агентных AI Хотя сегодняшние LLM могут решать задачи на уровне Ph.D., они доверчивы в реальных отношениях и коммерции. Что вызывает это и как решить?

Хотя сегодняшние LLM могут решать задачи на уровне Ph.D., они доверчивы в реальных отношениях и коммерции. Что вызывает это и как решить?

11/6/2023: Топ-5 новостей на главной странице Hackernoon!

11/6/2023: Топ-5 новостей на главной странице Hackernoon! Сгенерируйте больше контента из вашего подкаста и вырастите свою аудиторию.

Сгенерируйте больше контента из вашего подкаста и вырастите свою аудиторию.

194. AI’s ‘Neutral Voice’ Is a Structural Illusion

194. AI’s ‘Neutral Voice’ Is a Structural Illusion

AI не говорит объективно — она имитирует авторитет посредством синтаксиса. Узнайте, почему нейтральность в языковых моделях — это структура, а не субстанция.

AI не говорит объективно — она имитирует авторитет посредством синтаксиса. Узнайте, почему нейтральность в языковых моделях — это структура, а не субстанция. Узнайте мои 11 подсказок, как сделать код с помощью AI и быть счастливым по этому поводу.

Узнайте мои 11 подсказок, как сделать код с помощью AI и быть счастливым по этому поводу. Я построил свой первый AI-приложение Photfix для повышения и улучшения качества низкокачественных изображений. От медленных API до настройки GPU и оптимизации Docker.

Я построил свой первый AI-приложение Photfix для повышения и улучшения качества низкокачественных изображений. От медленных API до настройки GPU и оптимизации Docker. Дружественное напоминание, что «AI-родной» не является личностью, и ваши клиенты все равно просто хотят, чтобы вы решали их проблемы.

Дружественное напоминание, что «AI-родной» не является личностью, и ваши клиенты все равно просто хотят, чтобы вы решали их проблемы. AI не требует истины, чтобы звучать убедительно. Откройте, как синтаксические трюки обманывают нас на доверие не проверенным выводам в сфере здравоохранения, права и политики.

AI не требует истины, чтобы звучать убедительно. Откройте, как синтаксические трюки обманывают нас на доверие не проверенным выводам в сфере здравоохранения, права и политики. Сдвиг от ботов к агентам не является просто переименованием. Это изменение того, кто думает — от разработчика в момент проектирования до модели в момент выполнения.

Сдвиг от ботов к агентам не является просто переименованием. Это изменение того, кто думает — от разработчика в момент проектирования до модели в момент выполнения. Почему оценки LLM в одиночку недостаточно — отсутствует слой CI, о котором никто не говорит.не позволяет создавать надежные ворота для релиза, и почему командам нужен явный слой политики для преобразования результатов оценки в надежные решения CI.

Почему оценки LLM в одиночку недостаточно — отсутствует слой CI, о котором никто не говорит.не позволяет создавать надежные ворота для релиза, и почему командам нужен явный слой политики для преобразования результатов оценки в надежные решения CI.  12/3/2024: Топ 5 историй на главной странице HackerNoon!

12/3/2024: Топ 5 историй на главной странице HackerNoon! CocoIndex может построить и поддерживать граф знаний из набора документов, используя LLM (например, GPT-4o) для извлечения структурированных связей между концепциями.

CocoIndex может построить и поддерживать граф знаний из набора документов, используя LLM (например, GPT-4o) для извлечения структурированных связей между концепциями. 6/13/2025: Топ 5 историй на главной странице HackerNoon!

6/13/2025: Топ 5 историй на главной странице HackerNoon! Предвосхищение вида интеллекта неверно.

Предвосхищение вида интеллекта неверно. 6/18/2023: Топ 5 историй на главной странице Hackernoon!

6/18/2023: Топ 5 историй на главной странице Hackernoon! Большинство поставщиков предлагают скидку 50% на блочную инферентцию. Два серверных шаблона для фактического использования: SQS polling для любого поставщика, EventBridge для Bedrock.

Большинство поставщиков предлагают скидку 50% на блочную инферентцию. Два серверных шаблона для фактического использования: SQS polling для любого поставщика, EventBridge для Bedrock.  Эксперт по инженерии AI Джастин построил AI-поддерживаемый "Миссия Контроль", который автоматизирует всю стратегическую работу.

Эксперт по инженерии AI Джастин построил AI-поддерживаемый "Миссия Контроль", который автоматизирует всю стратегическую работу. 5/2/2025: Топ 5 историй на главной странице HackerNoon!

5/2/2025: Топ 5 историй на главной странице HackerNoon! 9/22/2023:

9/22/2023:  10/14/2025:

10/14/2025: