Facebook и Instagram будут маркировать поддельные изображения, созданные искусственным интеллектом, чтобы остановить распространение дезинформации

7 февраля 2024 г.Meta начнет помечать изображения, созданные ИИ, на Facebook, Instagram и Темы, чтобы поддержать онлайн-прозрачность.

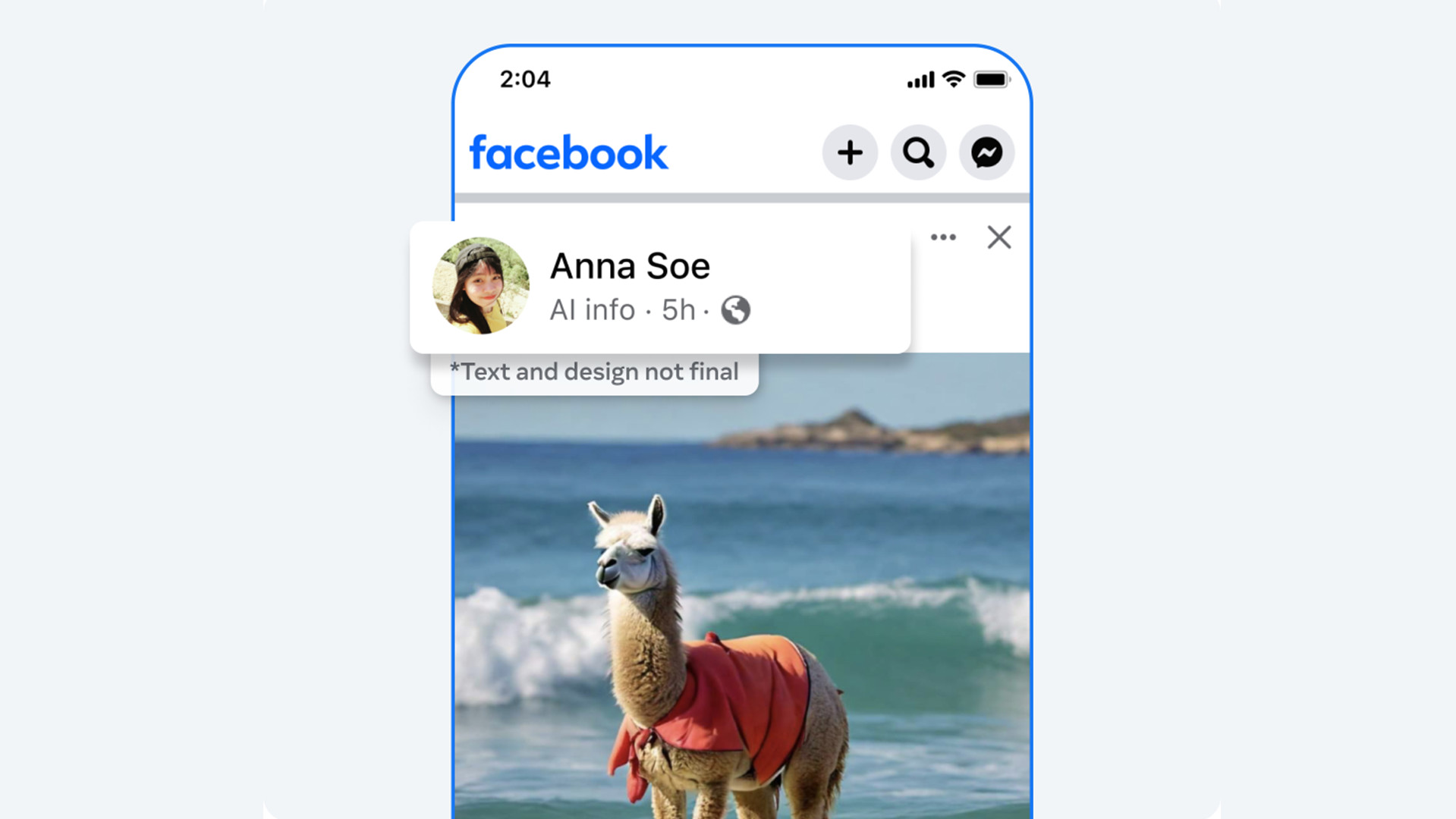

Технический гигант уже маркирует контент, созданный его Представьте себе механизм искусственного интеллекта с видимым водяным знаком. В дальнейшем он собирается сделать нечто подобное для изображений, поступающих из сторонних источников, таких как OpenAI, Google и Midjourney, и это лишь некоторые из них. Пока неизвестно, как именно будут выглядеть эти ярлыки, глядя на пост с объявлением, он может просто состоять из слов «Информация AI» рядом с сгенерированным контентом. Meta заявляет, что этот дизайн не является окончательным, намекая, что он может измениться после официального запуска обновления.

Помимо видимых меток, компания заявляет, что также работает над инструментами для «идентификации невидимых маркеров» на изображениях от сторонних генераторов. Представьте, что ИИ тоже делает то же самое, встраивая водяные знаки в метаданные своего контента. Его цель — включить уникальный тег, которым нельзя манипулировать с помощью инструментов редактирования. Мета заявляет, что другие платформы планируют сделать то же самое и хотят иметь систему для обнаружения метаданных с тегами.

Маркировка аудио и видео

До сих пор все было сосредоточено на брендинговых изображениях, но как насчет аудио и видео, генерируемых ИИ? Google Lumiere способен создавать невероятно реалистичные клипы, а OpenAI работает над реализацией создание видео в ChatGPT . Есть ли что-то для обнаружения более сложных форм ИИ-контента? Ну, типа того.

Meta признает, что в настоящее время у нее нет возможности обнаруживать аудио и видео, сгенерированные ИИ, на том же уровне, что и изображения. Технологии просто еще нет. Однако отрасль работает «в направлении этой возможности». До тех пор компания будет полагаться на систему чести. От пользователей потребуется сообщить, был ли видеоклип или аудиофайл, который они хотят загрузить, создан или отредактирован искусственным интеллектом. Невыполнение этого требования влечет за собой «штраф». Более того, если СМИ настолько реалистичны, что рискуют обмануть публику, Meta прикрепит к ним «более заметный ярлык», предлагающий важные детали.

Будущие обновления

Что касается собственных платформ, Meta также работает над улучшением сторонних инструментов.

Лаборатория исследований искусственного интеллекта FAIR компании разрабатывает новый тип технологии водяных знаков под названием Stable Signature. Судя по всему, можно удалить невидимые маркеры из метаданных контента, созданного ИИ. Предполагается, что Stable Signature остановит это, сделав водяные знаки неотъемлемой частью «процесса создания изображения». Вдобавок ко всему, Meta начала обучение нескольких LLM (больших языковых моделей) стандартам сообщества, чтобы ИИ могли определять, нарушают ли определенные фрагменты контента политику.

Ожидайте появления ярлыков социальных сетей в ближайшие месяцы. Время публикации не должно вызывать удивления: 2024 год станет важным годом выборов для многих стран, в первую очередь для Соединенных Штатов. Meta стремится максимально предотвратить распространение дезинформации на своих платформах.

Мы обратились к компании за дополнительной информацией о том, с какими штрафами может столкнуться пользователь, если он не пометит должным образом свою публикацию и планирует ли она помечать изображения из стороннего источника видимым водяным знаком. Эта история будет обновлена позже.

А пока ознакомьтесь со списком лучшие генераторы изображений AI на 2024 год.

Вам также может понравиться

- О, отлично! Теперь Facebook и Instagram хотят, чтобы ваши личные данные использовались для обучения последней несбыточной мечте Meta об искусственном интеллекте

- Новый редактор изображений с искусственным интеллектом в Instagram сделает вашу жизнь более захватывающей, чем она есть на самом деле< /li>

- Мета повышает безопасность Instagram и, наконец, по умолчанию запрещает незнакомцам отправлять сообщения несовершеннолетним

Оригинал