Deloitte: многие организации не знают, есть ли у них этические стандарты использования генеративного ИИ

11 октября 2023 г.Согласно новому отчету Deloitte, хотя многие компании уже окунаются в пилотные проекты генеративного искусственного интеллекта, 56% из них не знают, существуют ли у них этические стандарты, регулирующие его использование.

Согласно докладу «Состояние этики и доверия к технологиям» за 2023 год, почти три четверти (74%) заявили, что их компании начали тестирование генеративного ИИ, при этом 65% уже используют его внутри своего бизнеса, а 31% начали использовать эту технологию для внешних целей. отчет.

«Мы наблюдаем, как внедрение (генеративного искусственного интеллекта) опережает развитие этических принципов», — сказала TechRepublic Бина Амманат, управляющий директор Deloitte Consulting и руководитель практики этики Technology Trust.

Помимо генеративного искусственного интеллекта, в отчете также рассказывается, какие технологии могут представлять серьезный этический риск и сколько этические ошибки могут стоить американскому бизнесу.

Перейти к:

- Необходимость этики при внедрении новых технологий

Технологии с наибольшим потенциалом этического риска

Новые технологии, которые могут быть использованы не по назначению

Этические ошибки могут стоить американскому бизнесу миллионы долларов

Что организации должны делать, чтобы безопасно использовать новые технологии

Методика опроса

Необходимость этики при внедрении новых технологий

Учитывая, что так много компаний тестируют и используют генеративный искусственный интеллект, «в идеале мы хотим, чтобы внедрение новых технологий и разработка этических принципов происходили рука об руку, чтобы способствовать росту доверия к этим новым технологиям», — сказал Амманат, соавтор проекта. автор отчета.

Примерно половина (49%) респондентов заявили, что в их организации есть этические принципы, определенные для ИИ, а 11% респондентов заявили, что у их организации есть конкретные этические принципы для других новых технологий, таких как цифровая реальность, технология распределенного реестра, автономные транспортные средства, квантовые вычисления, робототехника и т. д. окружающие переживания, отметила она.

СКАЧАТЬ: Политика этики искусственного интеллекта TechRepublic Premium

Исследование Deloitte показало, что потенциальный вред увеличивается по мере того, как технологии становятся более мощными. «Поскольку использование новых технологий ускоряется, это подчеркивает настоятельную необходимость для организаций, работающих с различными типами новых технологических решений, учитывать конкретные риски и этические проблемы, уникальные для их сценариев использования», — говорится в отчете.

Технологии с наибольшим потенциалом этического риска

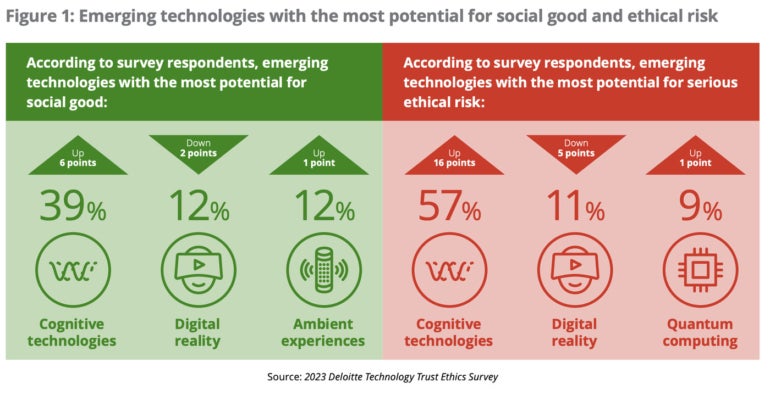

Согласно отчету Deloitte, когнитивные технологии, в том числе генеративный искусственный интеллект, обладают наибольшим потенциалом этического риска, но при этом обладают потенциалом для социального блага. Опрос этого года показал, что 39% респондентов указали, что когнитивные технологии обладают наибольшим потенциалом добра среди всех новых технологий, по сравнению с 33% в прошлом году.

Тем не менее, когнитивные технологии также были оценены как наиболее вероятно представляющие серьезный этический риск среди 57% респондентов по сравнению с 41% в 2022 году. Другими новыми технологиями с потенциалом серьезного этического риска являются цифровая реальность (11%) и квантовые вычисления ( 9%), говорится в отчете (рис. А).

Рисунок А

«Эти технологии только зарождаются и далеки от полной зрелости, и многие из их возможностей проходят тестирование до того, как управление и регулирование будут полностью установлены», — пояснил Амманат.

Данные являются важнейшим компонентом когнитивных технологий, использующих большие языковые модели, добавила она. «Небезопасные, незащищенные технологии могут потенциально угрожать конфиденциальности пользователей и субъектов данных. Злоумышленники также могут использовать когнитивные технологии с помощью таких методов, как отравление данных, в результате чего технологии выдают неточные и потенциально опасные результаты».

Кроме того, «эти технологии также могут быть печально непрозрачными по своей конструкции, что затрудняет оценку их точности, надежности, объяснимости и других факторов», — сказал Амманат.

Новые технологии, которые могут быть использованы не по назначению

Конфиденциальность данных была названа предметом беспокойства респондентов номер один в отношении генеративного ИИ. Несмотря на это, процент респондентов, которые выбрали конфиденциальность данных в качестве одного из наиболее важных этических принципов для новых технологий в своей организации, упал с 19% в прошлогоднем опросе до 7% в этом году.

Одним из примеров того, как новые технологии могут использоваться не по назначению, являются распространенные технологии наблюдения, такие как камеры дверных звонков, которые «внушают ценность права видеть все, что происходит внутри или вокруг своей собственности, но они также могут нарушать конфиденциальность пользователей», — заявил в отчете отмечено.

Тем не менее, зачастую такие технологии используются не в гнусных целях, поэтому в докладе отмечается, что «новые технологии имеют целый ряд потенциальных последствий, как полезных, так и вредных». Преимущества включают качество, скорость, безопасность и/или цену.

Этические ошибки могут стоить американскому бизнесу миллионы долларов

Ущерб от этических ошибок может стоить американскому бизнесу существенно; В отчете Deloitte цитируется исследование, согласно которому в 2021 году неправомерные действия на рабочем месте обошлись американскому бизнесу в 20 миллиардов долларов. Этические ошибки могут иметь самые разные последствия.

Например, компании несут ответственность за безопасность личной информации, сказала она. «Большая часть информации, проходящей через модель GenAI, может быть конфиденциальной или позволяющей идентифицировать личность. Подумайте о медицинских записях. Финансовые операции. Дизайн продукта. Контрактные условия. Подумайте обо всем, что вы считаете личным, по каким бы то ни было причинам. Средства контроля, обеспечивающие конфиденциальность личных данных, должны исходить от организации, а не от технологии».

«Любая этическая ошибка, связанная с технологиями, допущенная организациями, доверие, на создание которого ушли годы, может мгновенно разрушиться», — сказал Амманат. Это усугубляется появлением генеративного искусственного интеллекта.

Она подчеркнула, что игнорирование или преуменьшение этических проблем, связанных с новыми технологиями, обходится дорого. «Потенциальные последствия могут включать репутационный ущерб», например, подорванное доверие к бренду, «или человеческий ущерб, включая нарушение конфиденциальности, дискриминацию с помощью технологий и увольнение с работы».

Что организации должны делать, чтобы безопасно использовать новые технологии

По словам Амманата, лидерам всех бизнес-функций необходимо пересмотреть свои навыки и интегрировать новые способности, чтобы идти в ногу с быстрыми темпами развития новых технологий.

«Свободно владейте технологиями — не всем лидерам обязательно быть технологами, но им необходимо стать более технически грамотными, чтобы они могли реализовывать бизнес-стратегии, соответствующие конкретным бизнес-ценностям», — посоветовала она.

Кроме того, им следует поддерживать темпы переквалификации своих сотрудников. Если профессионалы проявляют интерес к развитию своей технической хватки, лидеры должны предоставить им соответствующую подготовку и возможности для обучения на рабочем месте, сказал Амманат.

«Возможности для обмена сообщениями и обучения могут исходить из централизованного подразделения вашей организации, например, от главного искусственного интеллекта или директора по этике», — отметила она. «Их офис должен быть поддержан для долгосрочного успеха со стороны организации. Другими словами, это не может быть временным приоритетом».

Методика опроса

Deloitte сообщила, что в июне 2023 года опросила более 1700 деловых и технических специалистов из разных секторов промышленности.

Оригинал