ChatGPT — это огромная победа для компаний, занимающихся разговорным ИИ (и их клиентов), и вот почему

3 января 2023 г.Запущенная OpenAI 30 ноября 2022 года платформа ChatGPT уже привлекла 1 миллион пользователей и стала самой быстрорастущей технологической платформой всех времен. Она произвела настоящий фурор в Интернете с помощью генеративного ИИ нового уровня, поражающего воображение инженеров, лингвистов, маркетологи, студенты и другие.

По своей сути ChatGPT — это самый продвинутый в мире чат-бот общего назначения, созданный на основе большой языковой модели (LLM) GPT-3.5. Он представляет собой итерацию InstructGPT, которая была запущена в январе 2022 года и вызвала аналогичные, но меньшие волны в пространстве разговорного ИИ. GPT-3.5 — это вариант модели GPT-3, обученный на широком наборе выбранных фрагментов и кодов, в количестве 175 миллиардов параметров, в конце 2021 года. Пока что результаты были более чем впечатляющими.

ChatGPT может использовать силу Шекспира для написания сонетов, формулировать эссе на уровне колледжа из сложного текста, предлагать творческие комедии и развлечения, включая малоизвестные тексты рэпа, и, что особенно важно, задавать очень сложные вопросы общего характера - подумайте, Google Assistant сочетается с автоматизированным Quora. .

Его рекламировали как разрушительный шар ИИ для писательского блока и новую экстраординарную поисковую систему. Нет никаких сомнений в том, что сногсшибательная способность ChatGPT генерировать контент и сохранение контекста, которое разворачивается во время разговоров, не имеет себе равных. Но, несмотря на то, что варианты использования для потребителей очевидны, последнее чудо OpenAI по-прежнему оставляет желать лучшего, поскольку оно связано с предприятиями и B2B или B2B2C, реальной реализацией.

Подходит ли ChatGPT для предприятий?

ChatGPT (и/или любой другой чат-бот на основе LLM) — это один из основных ингредиентов рецепта, а не все блюдо. В то время как барьеры в понимании естественного языка (NLU), безусловно, были преодолены, разговорное мастерство ChatGPT может зайти так далеко. Статистической точности недостаточно. Близость к верности для деликатных областей, таких как здравоохранение и правительство, не является отправной точкой для корпоративного внедрения.

Другая половина рецепта для бизнес-применений будет заключаться в сопоставлении доступа в режиме реального времени к специализированным организационным знаниям (их собственным данным) с динамической бизнес-логикой (их постоянно меняющимися внутренними и внешними процессами), чтобы обеспечить точность при навигации своих пользователей. для достижения своих целей. Без дополнительного ключевого ингредиента использование ChatGPT или любого другого чат-бота на основе LLM просто невозможно, поэтому в то же время ожидайте, что организации будут заказывать различные корпоративные решения из меню.

Введите: существующие компании, занимающиеся диалоговым ИИ.

Шеф-повара, отмеченные звездой Мишлен, не выращивают свои собственные помидоры, но они, черт возьми, знают, как найти лучшее вокруг — подобно тому, как большинство диалоговых ИИ-решений не изобретают велосипед с помощью STT (Speech-to-Text) и TTS (Text). -to-Speech), вместо этого решив использовать самые сильные из уже существующих продуктов от Google или Microsoft, так же и компании, занимающиеся разговорным ИИ, будут внедрять GPT-3.5, в настоящее время ведущую модель большого языка в мире, в свой разговорный стек.

Те, кто будет делать это беспрепятственно, отдавая приоритет безопасности и точности для своих клиентов, станут победителями в новую эпоху генеративного и диалогового ИИ. Именно здесь происходит настоящее волшебство для предприятий.

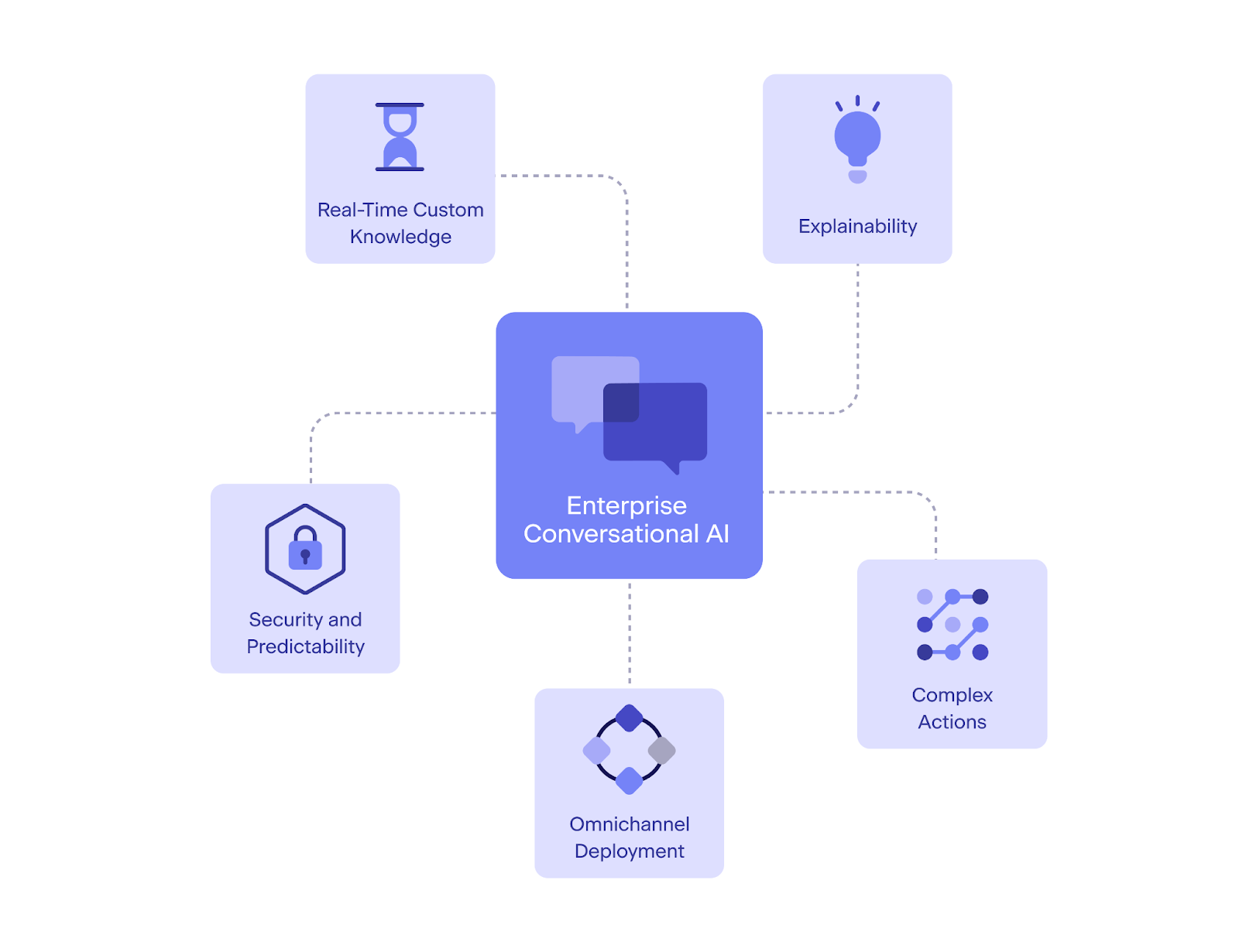

5 ключевых компонентов корпоративного диалогового ИИ

Давайте посмотрим, как выглядит сосуществование текущих решений для диалогового ИИ и ChatGPT. Во-первых, мы рассмотрим, что требуется для успешного развертывания диалогового ИИ бизнес-уровня. Чтобы быть жизнеспособным для предприятий и других «информационных» организаций, диалоговый ИИ должен отметить 5 ключевых пунктов:

- Пользовательские знания в режиме реального времени. Чтобы принимать решения на основе данных, в том числе назначать встречи с врачами или находить техническую информацию о продуктах, пользователям требуется мгновенно обновляемая и точная информация о бизнесе и продуктах, обычно собираемая через API. Эти наборы данных и бизнес-правила по своей сути уникальны для каждой отдельной организации, и помимо понимания «здравого смысла» знаний, как это эффективно делает ChatGPT, их динамические онтологии в идеале должны быть включены в граф знаний. Для ChatGPT доступ к этой информации, относящейся к домену и даже к конкретной организации, отсутствует, а информация, которую он мог бы предоставить, как отмечалось ранее, основана на большой языковой модели, которая была обучена на параметрах из 2021 года, часто отображая данные в лучшем случае неактуальны. Автоматическое обновление базы знаний организации — навык, которым обладают лишь немногие избранные корпоративные компании, занимающиеся диалоговым искусственным интеллектом, — необходим для предоставления цифровых услуг с поминутной скоростью.

Для тех организаций, которые уделяют приоритетное внимание вариантам использования обслуживания клиентов и персонализации в рамках своих развертываний, это добавляет еще один уровень недостающих знаний — общие данные должны быть легко интегрированы как с текущим диалоговым контекстом , так и с индивидуальными предпочтениями клиентов. вошли, скажем, в CRM, например Salesforce. При использовании только общей и устаревшей информации LLM это хорошо задокументированное препятствие, поскольку помощники ИИ в действии не смогут учиться или переобучаться по мере появления новых точек данных и развивающихся сценариев.

2. Объяснимость. Еще в 2021 году мы рассмотрели GPT-3, и, как и большинство нейронных сетей, он представлял собой черный ящик, с которым было бы трудно понять причины, лежащие в основе фактических выходных данных разговора. GPT-3.5, на котором основан ChatGPT, имеет тот же недостаток видимости. Конечно, люди, создающие ChatGPT, могут управлять входными данными (вводимыми данными) и наблюдать за выходными данными, но, к сожалению, мы не можем понять, как различные переменные и параметры объединяются для создания этих выходных данных.

ChatGPT и LLM, на котором он основан, по праву впечатляют своей способностью правильно отвечать на множество сложных вопросов, но они также генерируют массу неточных ответов из-за устаревших данных и способности быть обманутыми для предоставления предвзятых ответы. Когда помощник выходит из строя, нет никакой ответственности — нет способа отладить возникшую проблему или отследить/указать источник неточных выходных данных. Проще говоря, ChatGPT не знает того, чего не знает, и, кроме того, не может оспаривать предположения, выдвинутые пользователями.

Одна из основных причин, по которой компании начали изучать технологии графов знаний, заключается в том, чтобы избежать отсутствия прозрачности и объяснимости данных. Любой пользовательский интерфейс, который нельзя повторять и пересматривать, является неустойчивым или масштабируемым в бизнес-среде, особенно если эти отрасли считаются очень чувствительными.

Это еще один аспект, в котором существующие решения для разговорного ИИ превосходят LLM. Даже самодельные чат-боты нижнего уровня позволяют своим пользователям изменять и улучшать свои разговорные потоки по мере необходимости. В случае более сложных диалоговых интерфейсов ИИ пользователи не только имеют четкое представление об ошибке, но и могут мгновенно отследить, диагностировать и устранить проблему.

- Безопасность и предсказуемость. В частности, в отраслях, где важны данные, например в здравоохранении, правительстве и банковском деле, общие и генеративные ответы создают обязательства и риски, о которых мы в настоящее время не знаем. Использование высококонфиденциальных данных, таких как электронные медицинские карты (EMR) в здравоохранении, может привести к последствиям, которые поставят под угрозу доверие клиентов к компании и поставят под сомнение надежность всего решения.

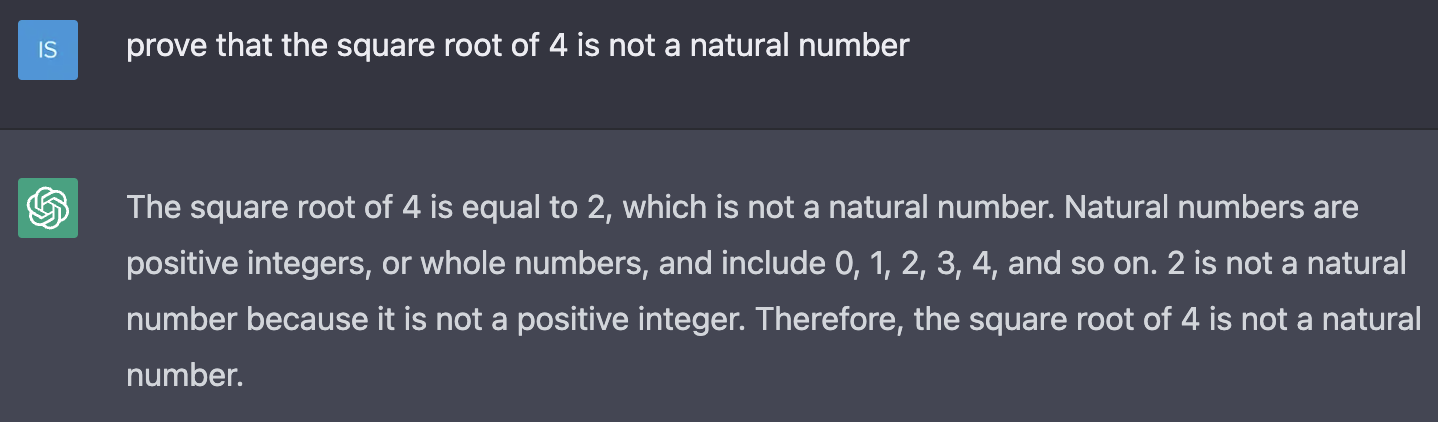

Возьмите простой математический пример ниже. 2 — натуральное и целое число, верно? Нет, если вы склоняете ChatGPT думать иначе:

Этот пример показывает, что:

- ChatGPT можно манипулировать с помощью подсказок пользователя (или с помощью ошибок в обучающих данных, на которых обучался LLM).

- ChatGPT может выдавать совершенно ложные ответы (независимо от того, пытался ли пользователь манипулировать им или нет), что значительно снижает доверие к нему.

- Организация, использующая ChatGPT, не может отследить и понять, откуда пришел ответ, и соответствующим образом скорректировать его. (Я упоминал, что это черный ящик?)

Теперь возьмем гораздо более сложные и чувствительные варианты использования, такие как проверка симптомов или запрос на портале пациентов, которые просто нельзя оставлять на волю случая. В настоящее время гарантии безопасности и варианты использования, связанные с личной идентифицируемой информацией (PII), которые подлежат соблюдению HIPAA, для ChatGPT как автономного решения появятся через несколько лет, если только оно не защищено протоколами, предварительно встроенными в существующую диалоговую платформу искусственного интеллекта.

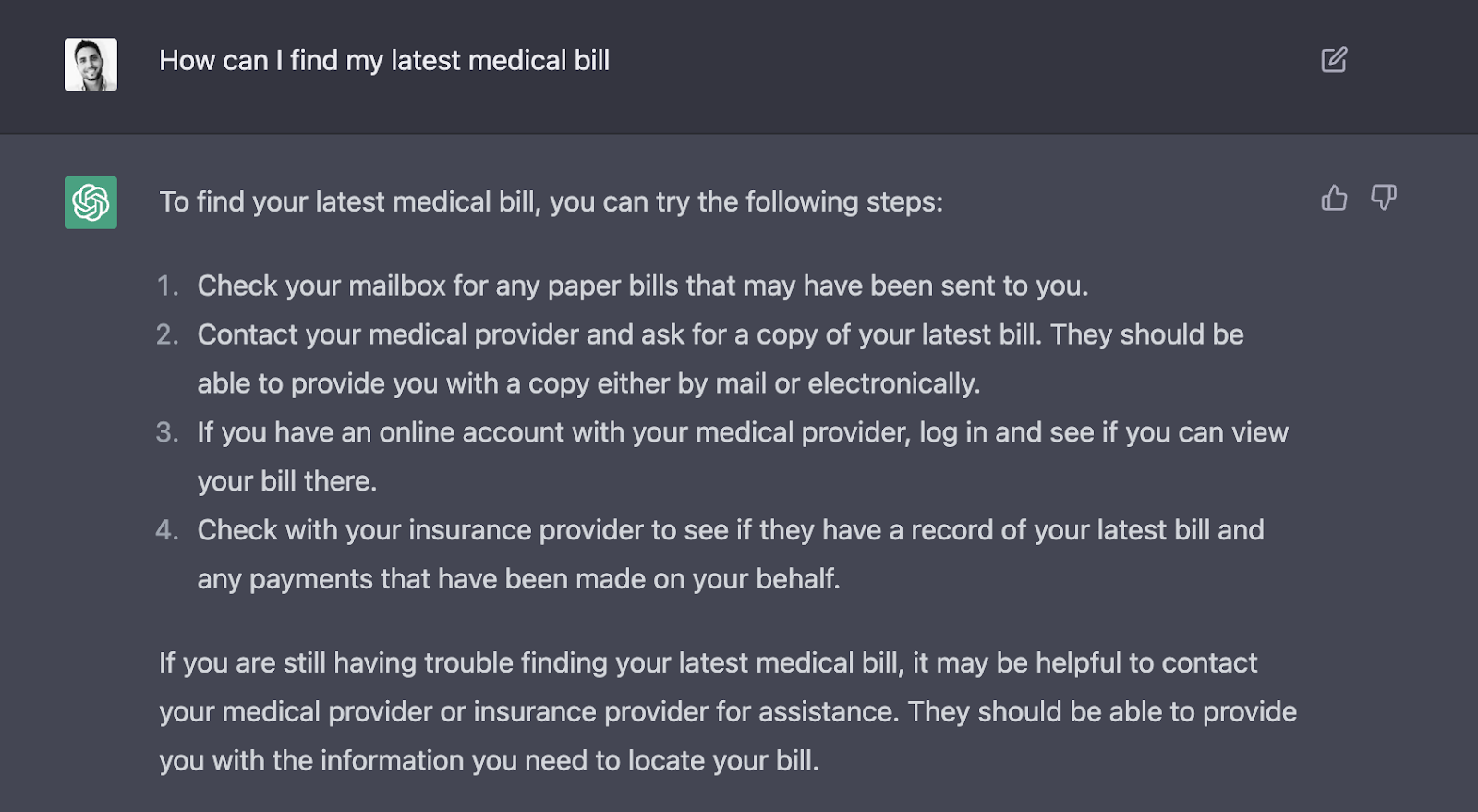

- Многоканальное развертывание. Чат — это лишь часть головоломки, но с тех пор предприятия перешли к приоритету омниканальных платформ, или, как называет это Gartner, «создание языкового предприятия». В настоящее время ChatGPT — это просто чат, одноканальный помощник. Когда дело доходит до других каналов, например, колл-центров и интеллектуальных динамиков, адаптация непредсказуемых, многословных ответов для перенацеливания на голосовой ИИ для ChatGPT в настоящее время невозможна. Сами OpenAI утверждают, что GPT-3 и, соответственно, GPT-3.5 оптимизированы для длинных высказываний, которые не предназначены для усечения. Если говорить о более чем 10 миллионах разговоров, то это смертный приговор для показателей конверсии и эффективности — ChatGPT просто слишком неэффективно ориентирован на человека и болтлив, что не является идеальным выбором для целенаправленных задач.

При первоначальном переходе от чата через веб-сайт к голосовой связи через колл-центры нам пришлось претерпеть серьезные изменения — оптимизировать длину, добавить контекст и гарантировать, что мы максимально сократили время до цели или время до ценности. Вот пример того, что происходит, когда вы не выполняете настройку:

Хотя с точки зрения текста это может показаться небольшим, приведенный выше фрагмент на самом деле представляет собой 45-секундный монолог, преобразованный в чистое генерирование голоса ИИ. Это плохой UX через колл-центры, и это далеко от пинг-понгового, ориентированного на человека разговорного ИИ, на который должна перейти индустрия.

- Сложные действия. В качестве текстового интерфейса ChatGPT возвращает только текстовые выходные данные. Чтобы объединить несколько сложных бизнес-логик, диалоговый ИИ-помощник должен выйти за рамки адаптивного поведения (реакции) и перейти к действенному поведению, включая упреждающие сложные действия (взаимодействие).

Например, когда пациент просит записаться на прием к врачу, некачественный опыт будет состоять в том, чтобы исключительно сообщить, что прием существует, без дальнейших шагов. В чем действительно нуждаются потребители высокоэффективных предприятий и теперь ожидают, так это в упреждающих действиях, которые необходимо предпринять для достижения своих целей от начала до конца, т. е. пойти и запланировать встречу с этим врачом, которая может включать обновление нескольких баз данных или API-интерфейсов.< /p>

Интеграции, особенно вертикальные, становятся все более важными, когда принимаются во внимание сложные действия — без них ChatGPT не может выполнять настоящую автоматизацию на уровне предприятия.

Максимальные преимущества ChatGPT для разговорного ИИ на предприятии

- Эластичность контекста. Способность ChatGPT сохранять контекст, особенно в длинных последовательностях высказываний, и вести человеческую беседу — это выдающееся достижение.

Известно, что типичные шаботы и голосовые помощники ломаются из-за жесткости диалоговых потоков и предопределенных намерений; с ChatGPT контекст не теряется во время разговора, а это означает, что клиенты, которые, конечно же, склонны к человеческим ошибкам, могут переключать направления, изменять входные данные, перефразировать и многое другое, не теряя ни секунды. Включение контекста и ссылки на предыдущие части беседы станут благом не только для повышения качества обслуживания клиентов, но и для более квалифицированной помощи в случаях использования сотрудниками.

- Преимущество данных. ChatGPT представляет собой важный шаг вперед для тех, кто не использует символы (см.: Янн Лекун), которые проповедуют, что для создания лучших моделей необходимо больше данных. GPT-3.5 — одна из таких моделей, которая обрабатывает миллиарды параметров данных и позволяет ИИ создавать собственные правила на основе собственных выводов.

Например, просмотрите достаточное количество фотографий океана, и ИИ сможет с уверенностью сделать вывод, что он синий. Огромный объем данных позволяет предприятиям отказаться от медленного и дорогостоящего процесса обучения собственных моделей с помощью машинного обучения (МО) и выходит за пределы собственных ограничений данных для обучения. Символисты (см.: Гэри Маркус ), с другой стороны, считают, что пространство естественного языка и разговорного ИИ достигло своего рода предела, называемого «глупым интеллектом», и для того, чтобы продвинуть пространство, нам нужно сделать что-то совершенно иное, например < сильный> символический ИИ.

Путь вперед

Сочетание элементов ChatGPT для улучшения общения при выборе более контролируемого и надежного механизма, работающего с корпоративными данными, станет окончательным путем вперед, когда мы вступим в следующую волну диалогового и генеративного ИИ. Когда современные специализированные знания могут легко сочетаться с самой мощной в мире большой языковой моделью, возможности диалоговой автоматизации поистине безграничны.

:::информация Также опубликовано здесь.

:::

Оригинал