Блокчейн как абсолютная машина истины для ИИ на основе GPT (ChatGPT)

13 декабря 2022 г.Если кто-то не жил в буквальном смысле под скалой (а не на ее вершине), вы, вероятно, слышали о ChatGPT — революционной антиутопической системе искусственного интеллекта, основанной на диалогах.

Его чрезвычайно разговорная манера заставляет пользователей доводить его до предела.

Большинство из них в восторге от его способности писать код в режиме реального времени или создавать безошибочные оригинальные эссе.

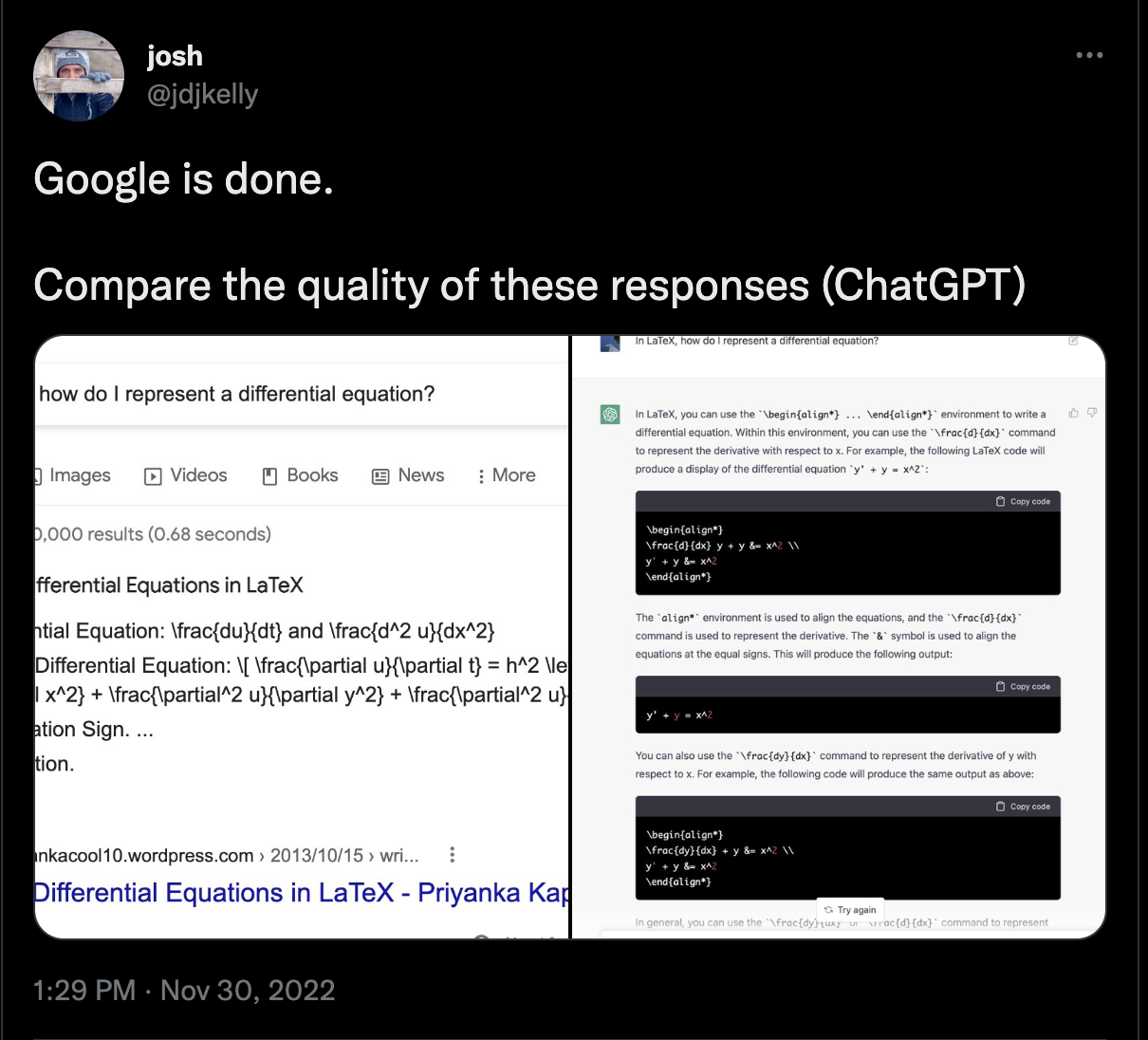

На первый взгляд, ChatGPT впечатляет. Хотя эта технология существует уже несколько лет, и даже другие компании запускали аналогичные инициативы в прошлом, ChatGPT смог привлечь один миллион пользователей за шесть дней.

С точки зрения продукта это, безусловно, было доказательством того, что ChatGPT удовлетворил потребности рынка. Скорее всего, это навсегда изменит гиг-экономику, поскольку по сути обеспечивает интерактивный поиск в Google с гораздо более краткими и действенными результатами в режиме реального времени.

Однако разговор об ИИ часто совпадает с разговором об этике — многие начали сомневаться в потенциальных опасностях этой модели, доступной для всех.

Как было показано в прошлом, у людей была плохая репутация, когда они учили ИИ говорить вещи, которые нельзя произносить, не говоря уже о том, чтобы думать.

На более философском уровне, что является источником правды для ChatGPT?

А как насчет других будущих систем на основе GPT? n n Как обеспечить учет предвзятости, наборов данных и параметров без ущерба для безопасности ИИ?

OpenAI признает эти опасения (написанные как «ограничения») в своей статье, посвященной ChatGPT, однако решения этих проблем не представлено!

Краткий обзор ChatGPT

Прежде чем решить проблему неизбежного восстания чат-ботов с искусственным интеллектом, позвольте кратко объяснить, как он на самом деле работает с высоты птичьего полета.

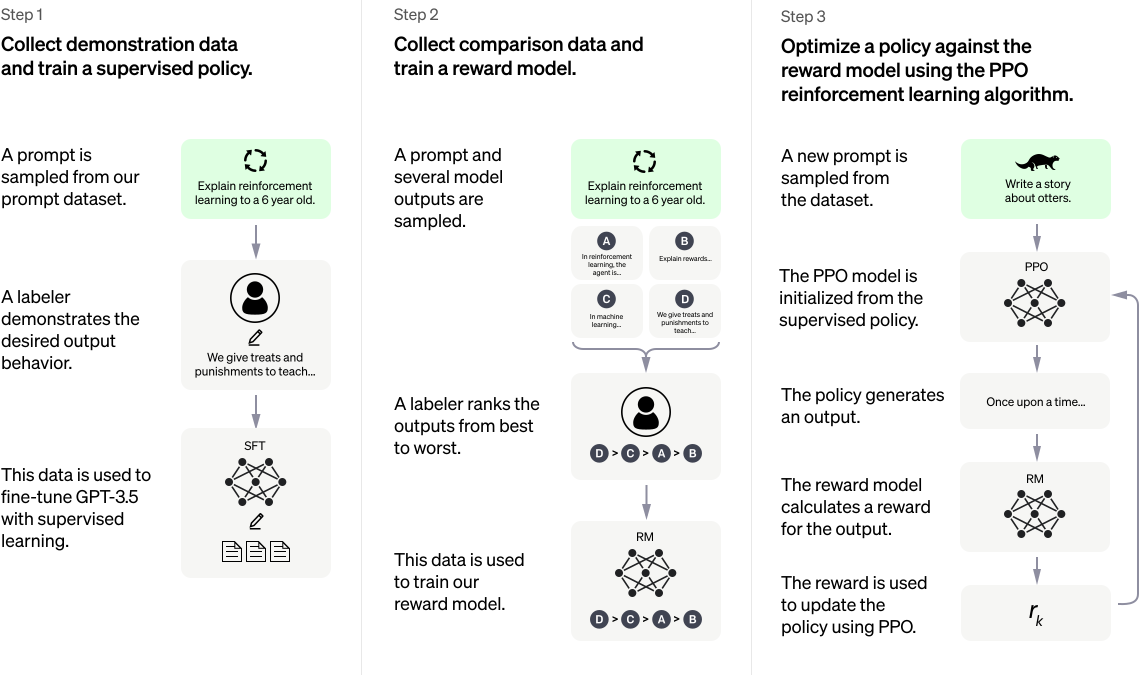

ChatGPT основан на GPT-3.5 — немного более новой и улучшенной версии GPT-3.

GPT расшифровывается как Generative Pre-trained Transformer 3.

«Это авторегрессивная языковая модель, использующая глубокое обучение для создания текста, похожего на человеческий. Учитывая начальный текст в качестве подсказки, он создаст текст, который продолжает подсказку». - GPT-3, Википедия.

Проще говоря, это предиктивная модель обработки языка, специально обученная для создания удобочитаемых тестов. Это понятие проверяется с помощью теста Тьюринга, цель которого состоит в том, чтобы текст, сгенерированный ИИ, был неотличим от написанного человеком.

GPT должен попытаться предсказать правильный ответ. Когда модель обучается, она продолжает настраивать свои внутренние переменные, пока не получит правильный ответ.

При обучении модели учитываются многие факторы, такие как отслеживание внимания к слову, то есть влияние/рейтинг слова в предложении.

Для получения дополнительной информации о том, как это работает на более техническом уровне, прочитайте исследование OpenAI здесь

ChatGPT был первым, кто по-настоящему открыл эту функцию в удобном для пользователей виде, что является одновременно фантастическим и пугающим, учитывая его параболический рост.

Потенциальные опасности моделей на основе GPT

Большинство проблем, возникающих из-за ИИ на основе GPT, таких как ChatGPT, связаны с этой цитатой:

"По сути, GPT-3, как и другие модели ИИ, хороша настолько, насколько хороши данные, на которых она была обучена, и люди создают эти данные. Те же убеждения, предубеждения, ошибки и ложь, которых придерживаемся мы, отражаются в Ответы ИИ. А поскольку такие инструменты, как ChatGPT, кажутся интеллектуальными, объективными и надежными, мы склонны верить в то, что дают нам эти модели». – Использование самого мощного ИИ стало проще, Forbes

Основная проблема с этими моделями — это данные, которые они загружают. Прежде чем ИИ станет полезным, он должен потреблять, взаимодействовать и тестировать миллиарды слов и параметров. Эти наборы данных обычно фильтруются и проверяются, чтобы содержать конкретную информацию.

В случае с ChatGPT он получает данные из Интернета, что позволяет ему иметь под рукой множество различных решений (есть ли у ИИ кончики пальцев?).

Однако это также означает, что он может принести с собой некоторые из более темных сторон Интернета и его предубеждений.

Проблема не в самом ИИ — он отслеживает процессы обучения и сбора данных, которые его создают.

Если бы можно было отслеживать и отслеживать с определенной степенью уверенности и прозрачности историю обучения модели с течением времени, ее источники и ее общий путь, то можно было бы сделать гораздо более точные определения в отношении достоверности результатов, которые она дает.

Таким образом, ценность будет более очевидна в более сфокусированных моделях, которые имеют конкретную цель, мотив и тщательно подобранные данные.

Чтобы было ясно, OpenAI осознает, что модели могут быть предвзятыми, и что в какой-то момент необходимо установить надежный источник правды. n n А что может быть лучше технологии для хранения неизменяемых, прозрачных и хронологических записей о создании ИИ, чем распределенный отказоустойчивый реестр?

Использование распределенного реестра для облегчения создания ИИ

Большинство рассматривает ИИ как своего рода «черный ящик» функциональности, где происхождение данных, где они были собраны, при каких обстоятельствах и как они работают, остаются неизвестными.

Однако что, если всякий раз, когда создается новый ИИ, каждый соответствующий процесс помещается в реестр для всеобщего обозрения, чтобы они точно знали, как работает ИИ на основе предоставленных данных?

Блокчейны хороши тем, что хранят поддающиеся проверке и непредвзятые записи правды.

Очевидно, что это будет только для общедоступных ИИ, таких как ChatGPT. Все, начиная от набора данных и заканчивая тем, кто участвовал, основными параметрами и любыми потенциальными предубеждениями, можно было сохранить как присутствие в сети.

По мере того, как ИИ постепенно обучается и становится лучше, он также обновляется в режиме реального времени в бухгалтерской книге. Таким образом, даже разработчики, ответственные за его обучение, смогут получить четкое хронологическое представление о том, как именно работает ИИ с точки зрения производительности.

Что еще более важно, бухгалтерская книга станет прямым источником достоверной информации, подкрепленной происхождением создания ИИ.

Другими словами — мы держим ИИ подотчетным с момента его создания, отслеживаем его происхождение, мотивы и то, как именно на него повлиял уровень обучения.

<цитата>Это обеспечит согласованность и происхождение данных. Целостность данных всегда находится на низком уровне. Используя систему ведения записей, такую как блокчейн, мы могли бы отследить каждый байт данных до его происхождения для ИИ.

Это поможет выявить предвзятость, которую сложно обнаружить в «черном ящике» ИИ, и предотвратить ложное распространение данных, которые могут исходить от «злонамеренного» ИИ.

n Думайте об этом как о галочке подтверждения. Если у ИИ стоит галочка, значит, он действителен. Если нет, то есть основания сомневаться в его легитимности.

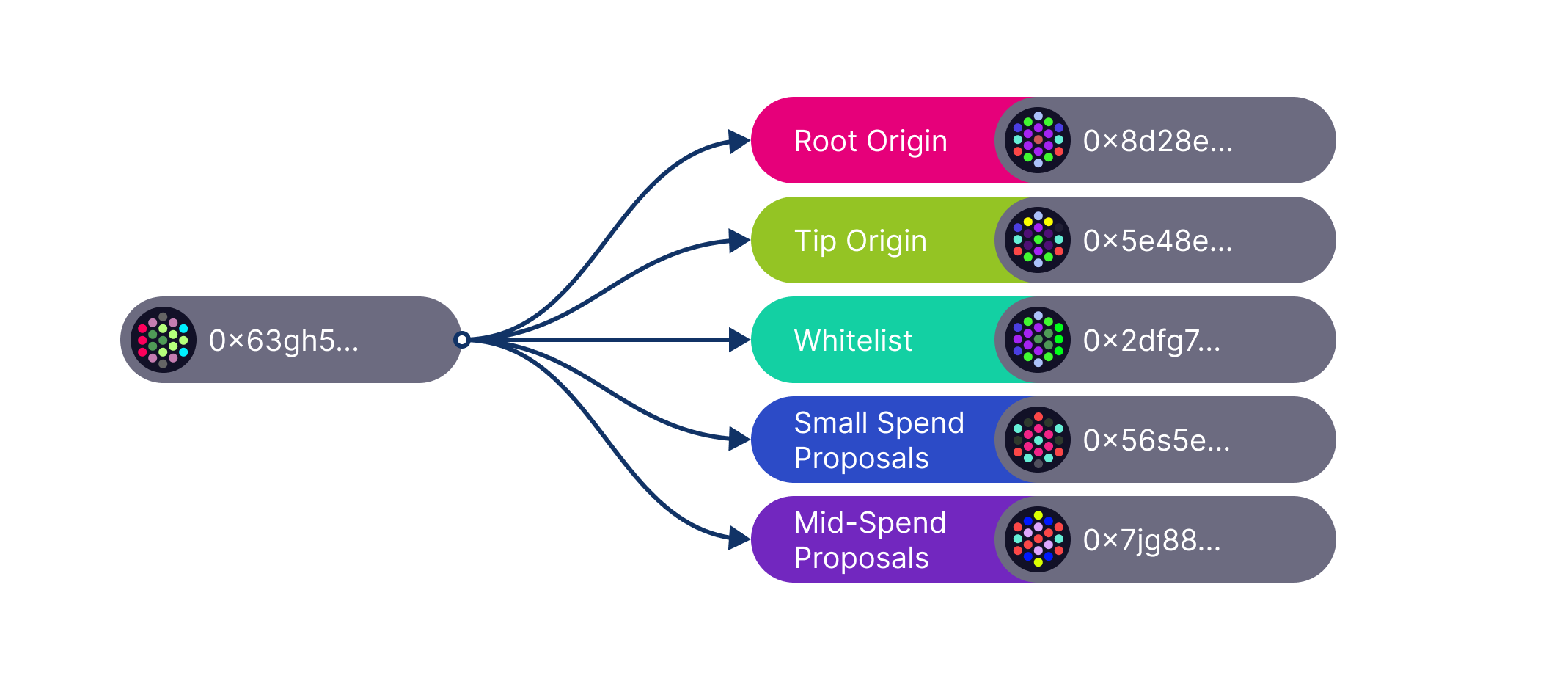

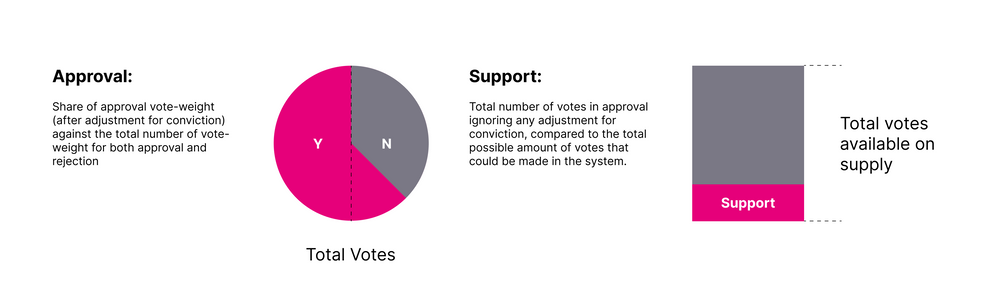

Как показано в таких блокчейнах, как Polkadot, также вполне возможно, чтобы организации голосовали по определенным правилам и механизмам в сети. Аналогичная концепция может быть реализована для ИИ, где могут проводиться голосования для определения различных факторов, касающихся его легитимности, целостности данных и многого другого.

n n В конце концов, эти модели хороши настолько, насколько хороши данные, поступающие в них.

n n В конце концов, эти модели хороши настолько, насколько хороши данные, поступающие в них.

Со временем данные могут стать запутанными. Кто контролирует источник, что значит, что источник превращается во что-то, что может быть вредным?

Конечно, у OpenAI есть свой API модерации — еще один ИИ, который обнаруживает вещи, которые считаются вредными, что является очень ценным шагом в правильном направлении. n

n Однако даже для фактического доказательства, т. е. для истории, данные из Интернета необходимо многократно проверять и проверять.

Поскольку все больше людей пользуются этими услугами, обеспечение надежной информации будет иметь решающее значение.

Заключение

Нет никаких сомнений в том, что ИИ изменит мир. ChatGPT показал людям, как эта технология может мгновенно изменить их жизнь.

Следующим шагом будет обеспечение целостности ИИ. Проверка поступающих к нему данных, сведений о том, кто его разработал, и его точных мотивов/целей будет иметь решающее значение для соблюдения этических стандартов и, в свою очередь, доверия общественности к таким моделям.

Теперь это действительно начинает напоминать веб3!

Оригинал