8 тенденций в сфере искусственного интеллекта в 2024 году, по мнению исследователей из Стэнфорда

24 апреля 2024 г.Согласно новому исследованию, ИИ делает работников более продуктивными, но нам все еще не хватает правил регулирования. Отчет об индексе искусственного интеллекта за 2024 год, опубликованный Институтом человекоориентированного искусственного интеллекта Стэнфордского университета, выявил восемь основных тенденций искусственного интеллекта для бизнеса, в том числе то, что технология до сих пор не превосходит человеческий мозг при выполнении каждой задачи.

TechRepublic анализирует последствия этих выводов для бизнеса, опираясь на идеи соавторов отчета Роби Рахмана и Анки Руэл.

СМОТРЕТЬ: 5 главных тенденций в области искусственного интеллекта, за которыми стоит следить в 2024 году

1. Люди по-прежнему превосходят ИИ во многих задачах

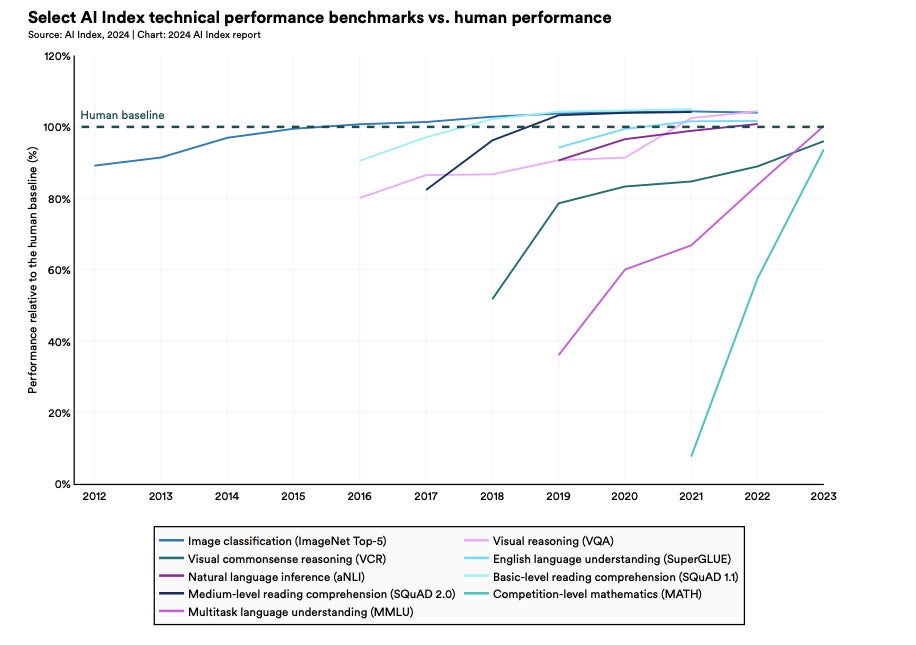

Согласно исследованию, ИИ все еще не так хорош, как люди, в сложных задачах решения математических задач высокого уровня, визуального рассуждения и планирования (рис. A). Чтобы сделать этот вывод, модели сравнивались с человеческими показателями во многих различных бизнес-функциях, включая кодирование, поведение агентов, рассуждение и обучение с подкреплением.

Рисунок А

Хотя ИИ действительно превзошел человеческие способности в классификации изображений, визуальном мышлении и понимании английского языка, результат показывает, что у компаний есть потенциал использовать ИИ для задач, где человеческий персонал действительно будет работать лучше. Многие предприятия уже обеспокоены последствиями чрезмерной зависимости от продуктов искусственного интеллекта.

2. Современные модели искусственного интеллекта становятся все дороже

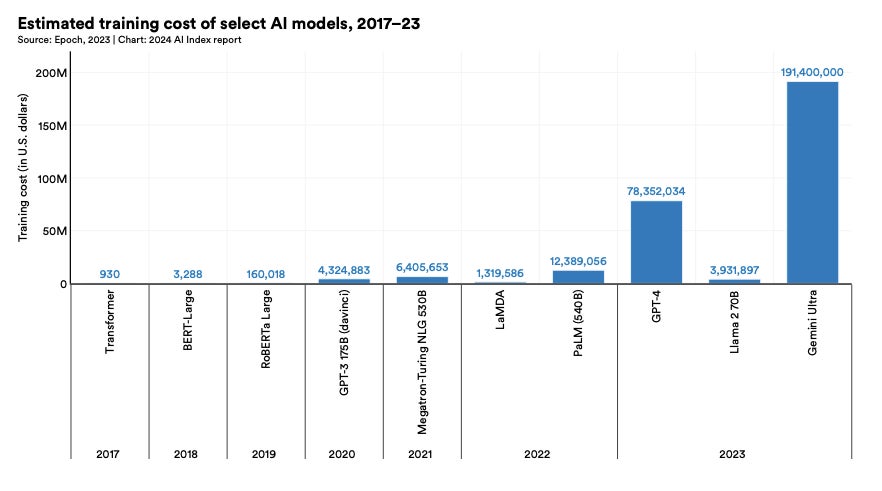

По данным AI Index, обучение OpenAI GPT-4 и Gemini Ultra от Google в 2023 году будет стоить примерно 78 миллионов долларов и 191 миллион долларов соответственно (рис. B). Специалист по данным Рахман сообщил TechRepublic по электронной почте: «При нынешних темпах роста передовые модели искусственного интеллекта будут стоить от 5 до 10 миллиардов долларов в 2026 году, и тогда очень немногие компании смогут позволить себе такое обучение».

Рисунок Б

В октябре 2023 года Wall Street Journal опубликовал, что Google, Microsoft и другие крупные технологические игроки изо всех сил пытаются монетизировать свои продукты генеративного ИИ из-за огромных затрат, связанных с их эксплуатацией. Существует риск того, что, если лучшие технологии станут настолько дорогими, что будут доступны исключительно крупным корпорациям, их преимущество перед малыми и средними предприятиями может непропорционально возрасти. Это было отмечено Всемирным экономическим форумом еще в 2018 году.

Однако Рахман подчеркнул, что многие из лучших моделей ИИ имеют открытый исходный код и, следовательно, доступны предприятиям с любым бюджетом, поэтому технология не должна увеличивать какой-либо разрыв. Он рассказал TechRepublic: «Модели ИИ с открытым и закрытым исходным кодом растут с одинаковой скоростью. Одна из крупнейших технологических компаний Meta открывает исходный код всех своих моделей, поэтому люди, которые не могут позволить себе обучать самые большие модели самостоятельно, могут просто скачать свои».

3. ИИ повышает производительность и качество работы

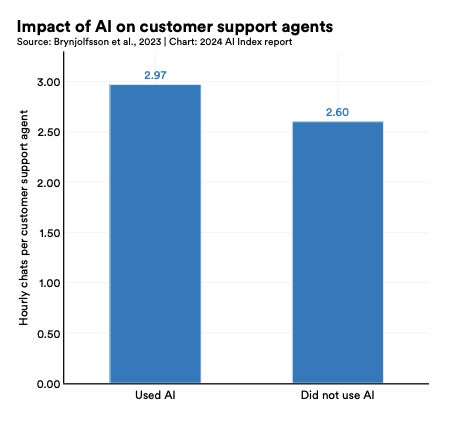

Оценив ряд существующих исследований, исследователи из Стэнфорда пришли к выводу, что ИИ позволяет работникам быстрее выполнять задачи и повышает качество их результатов. Профессии, в которых это наблюдалось, включают программистов, где 32,8% сообщили о повышении производительности, консультантов, агентов поддержки (рис. C) и рекрутеров.

Рисунок С

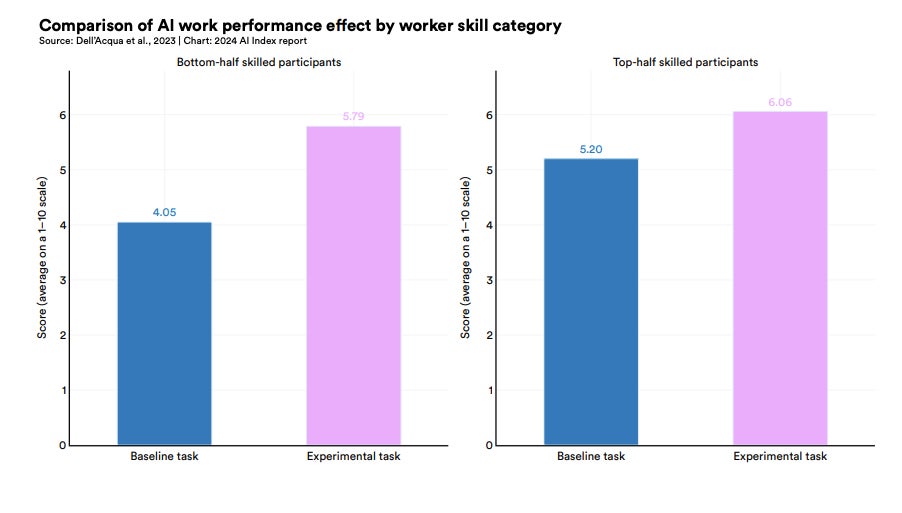

В случае с консультантами использование GPT-4 сократило разрыв между низкоквалифицированными и высококвалифицированными профессионалами, при этом группа с низкой квалификацией добилась большего повышения производительности (рис. D). Другие исследования также показали, что генеративный ИИ, в частности, может действовать как уравнитель, поскольку менее опытные и менее квалифицированные работники получают от него больше пользы.

Рисунок D

Однако другие исследования показали, что «использование ИИ без надлежащего надзора может привести к снижению производительности», пишут исследователи. Например, широко распространены сообщения о том, что галлюцинации преобладают в больших языковых моделях, выполняющих юридические задачи. Другое исследование показало, что мы не сможем реализовать весь потенциал повышения производительности с помощью ИИ еще в течение следующего десятилетия, поскольку неудовлетворительные результаты, сложные инструкции и недостаток квалификации продолжают сдерживать работников.

4. Нормы регулирования ИИ в США находятся на подъеме

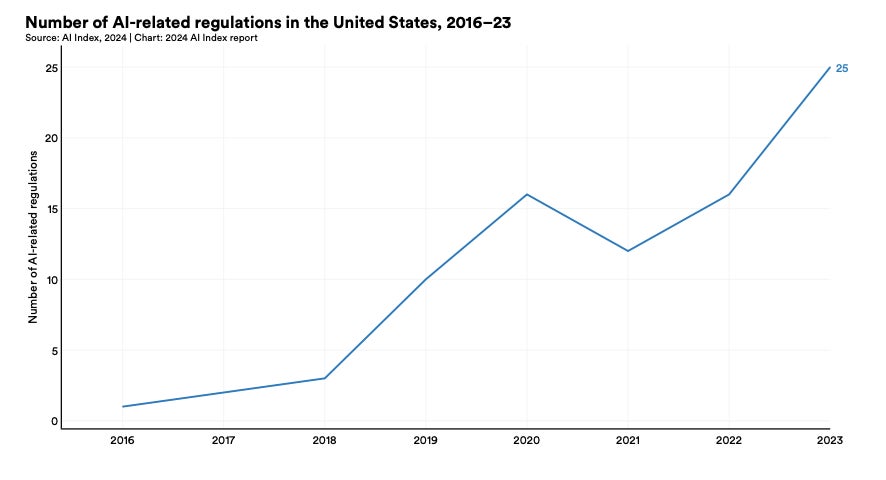

Отчет AI Index показал, что в 2023 году в США действовало 25 нормативных актов, связанных с ИИ, а в 2016 году — только один (рис. E). Однако это не было устойчивым ростом, поскольку общее количество правил, связанных с ИИ, выросло на 56,3% только с 2022 по 2023 год. Со временем эти правила также превратились из экспансивных в отношении прогресса ИИ в ограничительные, и наиболее распространенной темой, которую они затрагивают, является внешняя торговля и международные финансы.

Рисунок Е

Законодательство, связанное с ИИ, также растет в ЕС: в 2021, 2022 и 2023 годах будет принято 46, 22 и 32 новых нормативных акта соответственно. В этом регионе нормативные акты, как правило, имеют более широкий подход и чаще всего охватывают науку, технологии и коммуникации.

СМОТРИ: NIST создает Консорциум по безопасности искусственного интеллекта

Предприятиям, заинтересованным в ИИ, крайне важно быть в курсе нормативных актов, которые на них влияют, иначе они подвергнутся риску серьезных штрафов за несоблюдение требований и репутационного ущерба. Исследование, опубликованное в марте 2024 года, показало, что только 2% крупных компаний в Великобритании и ЕС знали о новом Законе ЕС об искусственном интеллекте.

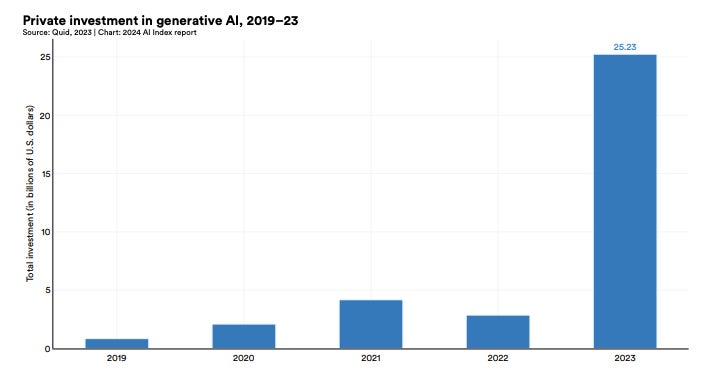

5. Инвестиции в генеративный искусственный интеллект растут

Финансирование продуктов генеративного искусственного интеллекта, которые генерируют контент в ответ на запрос, увеличилось почти в восемь раз с 2022 по 2023 год, достигнув 25,2 миллиарда долларов (рис. F). OpenAI, Anthropic, Hugging Face и Inflection, среди прочих, получили значительные раунды сбора средств.

Рисунок F

Развитие генеративных возможностей искусственного интеллекта, вероятно, удовлетворит спрос со стороны компаний, желающих внедрить его в свои процессы. В 2023 году генеративный ИИ упоминался в 19,7% всех отчетов о прибылях и убытках компаний из списка Fortune 500, а отчет McKinsey показал, что 55% организаций теперь используют ИИ, включая генеративный ИИ, по крайней мере в одном бизнес-подразделении или функции.

Осведомленность о генеративном искусственном интеллекте резко возросла после запуска ChatGPT 30 ноября 2022 года, и с тех пор организации стремятся включить его возможности в свои продукты или услуги. Недавний опрос 300 компаний по всему миру, проведенный MIT Technology Review Insights в партнерстве с Telstra International, показал, что респонденты ожидают, что количество функций, использующих генеративный искусственный интеллект, увеличится более чем вдвое в 2024 году.

СМОТРИТЕ: Определение генеративного искусственного интеллекта: как он работает, преимущества и опасности

Однако есть некоторые свидетельства того, что бум генеративного искусственного интеллекта «может довольно быстро закончиться», по словам ведущего представителя искусственного интеллекта Гэри Маркуса, и предприятиям следует быть осторожными. В первую очередь это связано с ограничениями современных технологий, такими как возможность предвзятости, проблемы авторского права и неточности. Согласно отчету Стэнфорда, ограниченный объем онлайн-данных, доступных для обучения моделей, может усугубить существующие проблемы, ограничивая возможности улучшений и масштабируемости. В нем говорится, что у компаний, занимающихся искусственным интеллектом, могут закончиться высококачественные языковые данные к 2026 году, языковые данные низкого качества — через два десятилетия, а данные изображений — к концу 2030-х — середине 2040-х годов.

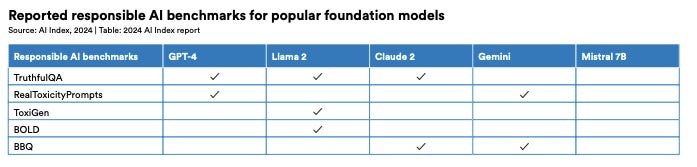

6. Критерии ответственности LLM сильно различаются.

Согласно отчету, существуют значительные различия в критериях, по которым технологические компании оценивают свои LLM, когда речь идет о надежности или ответственности (рис. G). Исследователи написали, что это «усложняет попытки систематического сравнения рисков и ограничений ведущих моделей ИИ». Эти риски включают в себя предвзятые результаты и утечку частной информации из наборов обучающих данных и историй разговоров.

Рисунок G

Руэл, аспирант Стэнфордской лаборатории интеллектуальных систем, сообщил TechRepublic по электронной почте: «В настоящее время не существует требований к отчетности, и у нас нет надежных оценок, которые позволили бы нам с уверенностью сказать, что модель безопасна, если она проходит эти оценки в первое место."

Без стандартизации в этой области возрастает риск того, что некоторые ненадежные модели ИИ могут ускользнуть и быть интегрированы предприятиями. «Разработчики могут выборочно сообщать о тестах, которые положительно подчеркивают производительность их модели», — добавлено в отчете.

Руэл рассказал TechRepublic: «Есть множество причин, по которым вредоносная модель может ускользнуть от внимания. Во-первых, нет стандартизированных или обязательных оценок, затрудняющих сравнение моделей и их (относительных) рисков, а во-вторых, нет надежных оценок, особенно базовых моделей, которые позволяют получить твердое и всестороннее понимание абсолютного риска модели».

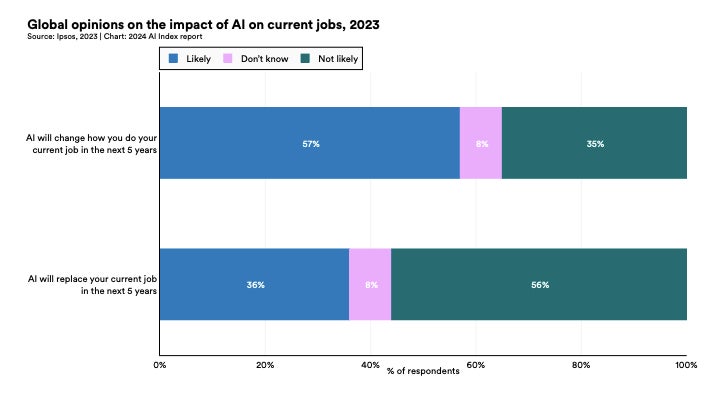

7. Сотрудники нервничают и обеспокоены ИИ

В отчете также прослеживается, как меняется отношение к ИИ по мере роста осведомленности. Одно исследование показало, что 52% выражают нервозность по отношению к продуктам и услугам искусственного интеллекта, и что эта цифра выросла на 13% за 18 месяцев. Также выяснилось, что только 54% взрослых согласны с тем, что продукты и услуги, использующие ИИ, имеют больше преимуществ, чем недостатков, а 36% опасаются, что он может лишить их работы в течение следующих пяти лет (рис. H).

Рисунок Н

Другие исследования, упомянутые в отчете об индексе ИИ, показали, что 53% американцев в настоящее время больше обеспокоены ИИ, чем взволнованы, и что их общая общая обеспокоенность — это его влияние на рабочие места. Подобные опасения могут оказать особое влияние на психическое здоровье сотрудников, когда технологии искусственного интеллекта начнут интегрироваться в организацию, за чем бизнес-лидеры должны будут следить.

СМОТРИТЕ: 10 лучших курсов по искусственному интеллекту в 2024 году

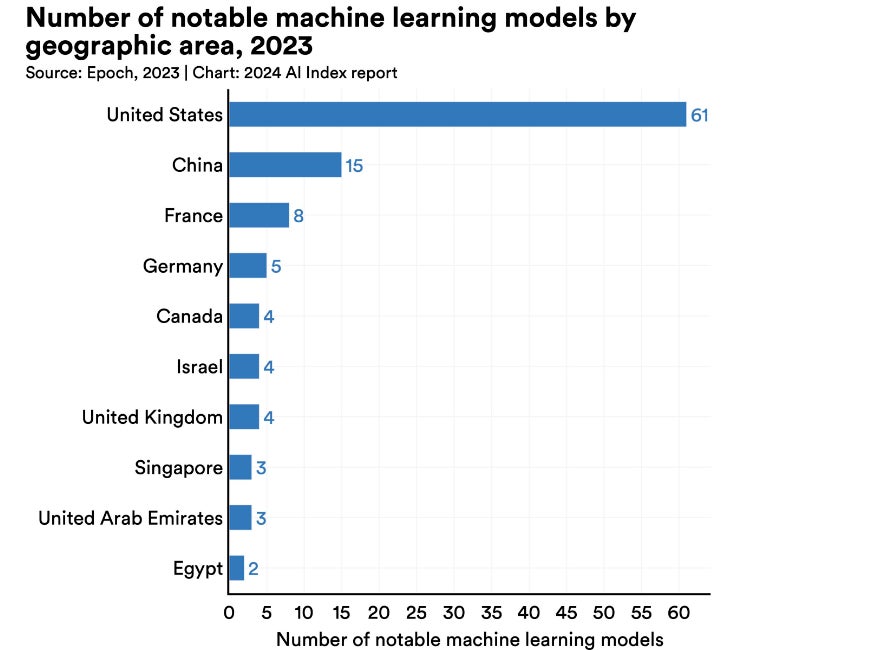

8. США и Китай создают большинство популярных сегодня программ LLM.

Бен Эбботт из TechRepublic осветил эту тенденцию из Стэнфордского отчета в своей статье о создании базовых моделей ИИ в регионе Азиатско-Тихоокеанского региона. Он, в частности, писал:

«Доминирование США в области искусственного интеллекта продолжалось на протяжении всего 2023 года. Стэнфордский отчет об индексе искусственного интеллекта, опубликованный в 2024 году, показал, что в 2023 году в США была выпущена 61 известная модель; это опережает Китай с 15 новыми моделями и Францию, крупнейший поставщик из Европы с восемью моделями (рис. I). Великобритания и Европейский Союз как регион выпустили 25 примечательных моделей, опередив Китай впервые с 2019 года, в то время как Сингапур с тремя моделями был единственным производителем примечательных больших языковых моделей в Азиатско-Тихоокеанском регионе».

Рисунок I

Оригинал