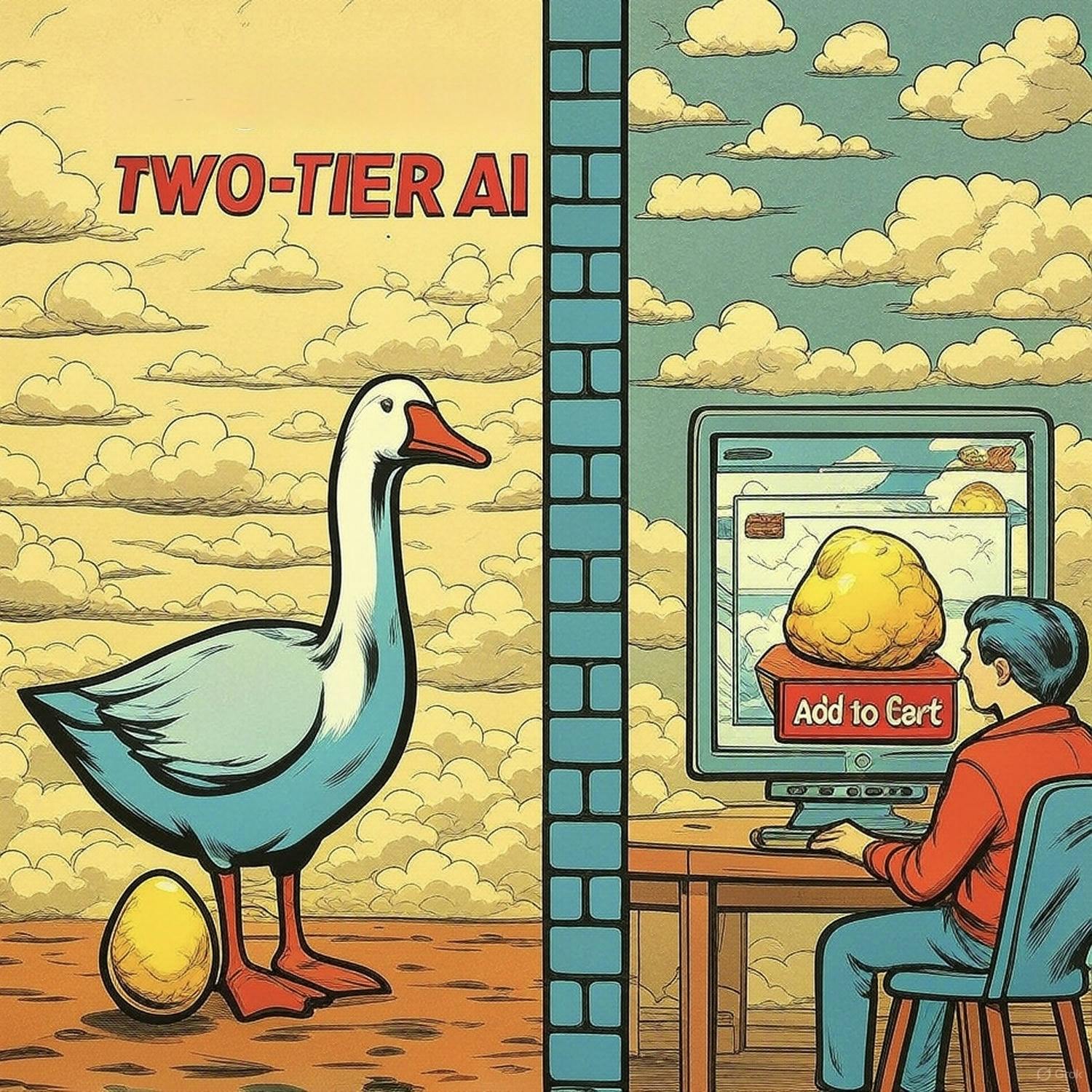

Вы бы продали свой золотой гусь? Двухуровневый ИИ-это будущее

31 июля 2025 г.Эпоха AI Super Intelligence

Мы являемся свидетелями подхода к искусственному интеллекту к границе супер интеллекта. Элон Маск уже говорит об искусственном интеллекте «Поиск новой физики» и генерирует изобретения. Но что это на самом деле означает для пользователей, рынков и правительств? Сегодня новейшие модели искусственного интеллекта часто выпускаются для общественности, хотя и еще неполные, иногда преждевременно, обычно с механизмом безопасности. Эти ограничения в первую очередь предназначены для того, чтобы избежать очевидных нарушений авторских прав или политических нарушений. Но с порогом AGI в настоящее время в пределах досягаемости стратегическое исчисление переходит.

Как только искусственный интеллект превзойдет определенный уровень возможностей, он больше не будет просто невероятным инструментом для автоматизации и увеличения. Он будет способен заменить не только отдельных работников, но и целых команд, целых департаментов, возможно, даже целых компаний и улучшить себя (AGI). В таком ландшафте выпуск этих моделей непосредственно на открытый рынок будет экономически иррациональным. Предоставление каждому доступу к самому продвинутому ИИ будет только расширить возможности конкурентов и подорвать самые компании, создающие их.

Введите «Эра Золотого Гуса»

Если у вас есть гусь, который откладывает золотые яйца, зачем вы его продали? Эта метафора теперь относится к AGI. Компании, ведущие гонку ИИ, осознают это. Самые мощные модели, вероятно, останутся внутренними. Эти системы будут использоваться для ускорения изобретения, оптимизации внутренних операций и даже найдены совершенно новыми компаниями. Только модели более низкого уровня, то, что мы могли бы назвать AIS Assistant Class AI, будут выпущены для публики. Эти инструменты все равно будут повышать производительность, но они не будут конкурировать с возможностями истинного AGI.

Это не просто спекуляция. Это уже начинает происходить. Просто посмотрите на Tesla: Продажа автомобиля приносит фиксированную прибыль, но управление этой машиной в рамках флота роботакси может окупиться менее чем за три года. Возврат инвестиций от эксплуатации, а не продажи неоспорима. Та же логика относится к ИИ.

И по мере того, как этот экономический сдвиг раскрывается, правительства вводят политику, которая, по -видимому, приносит больше вреда, чем пользы. Последние регулирующие усилия Европейского Союза являются прекрасным примером. В соответствии с новым Законом ЕС поставщика поставщиков моделей ИИ общего назначения в настоящее время вынуждены представить публичные резюме своих данных обучения, используя обязательный шаблон. Этот шаг продается как стремление к прозрачности и подотчетности, но он более точно описывается как еще одно бюрократическое переоборудование.

Удушающая конкуренция по регулированию

Позвольте мне следить за моей последней статьей«Последнее переизбыточное превышение ИИ в ЕС: обязательные шаблоны для раскрытия данных обучения AI-Model»

Давайте посмотрим на то, что это на самом деле влечет за собой. Так называемый «шаблон» охватывает тринадцать плотных страниц. Он требует раскрытия информации о наборах данных обучения, а также оправданиями для любого защищенного или секретного контента. Предположение здесь состоит в том, что политики могут найти баланс между открытостью и торговой секретностью, но на практике это становится проигравшим предложением.

Во -первых, административное бремя огромно. Кто именно будет читать и проверить тысячи таких раскрытий? Мы представляем целевую группу ЕС из-за литературе бюрократов, которые расчесываются через технические приложения? Это кажется маловероятным. Более правдоподобно, эти формы будут собирать пыль на неясных серверах, в то время как компании утонут в регулирующем трении.

Во -вторых, политика заставляет компании разоблачить ценные запатентованные данные. Фирмы тратят миллионы, компиляционные и кураторские наборы обучения, которые отражают стратегическое понимание. Теперь их просят развернуть эти активы для регуляторов и, косвенно, для конкурентов. В мире, где AGI становится внутренним отличием, это не просто обременительно. Это саморазрушительное.

В -третьих, идея о том, что регуляторы могут надежно оценить правдивость или полноту этих представлений, в лучшем случае оптимистична. Проверка происхождения данных требует глубоких технических знаний, массовых ресурсов и последовательного обеспечения. Без них процесс становится чуть больше, чем упражнение с флажом, подрывая свой собственный авторитет.

Все это усиливает основной аргумент. Самые мощные модели не будут выпущены. ЕС будет стремиться к контролю посредством регулирования, но экономический стимул для поддержания AGI Private сильнее. Регулирование, которое предполагает, что все модели должны быть публичными, объяснимыми и симметричными игнорирует новую реальность: доступ к ИИ высшего уровня становится стратегическим активом.

Два уровня ИИ скоро определят ландшафт. Первый уровень, внутренний и частный Super Intelligence, будет стимулировать создание стоимости в шкале, которую мы никогда не видели. Второй уровень, общедоступный, но ограниченный властью, поможет пользователям и небольшим компаниям адаптироваться к новому технологическому порядку. Эта бифуркация не просто вероятно. Это неизбежно.

Когда гусь откладывает золотые яйца, никто не продает гусь.

Оригинал