Почему работает многократный прогноз: интуиция и теоретическая идея

6 июня 2025 г.Таблица ссылок

Аннотация и 1. Введение

2. Метод

3. Эксперименты по реальным данным

3.1. Шкала преимуществ с размером модели и 3,2. Более быстрый вывод

3.3. Изучение глобальных моделей с помощью мульти-байтового прогноза и 3.4. Поиск оптимальногоне

3.5. Обучение для нескольких эпох и 3.6. Создание нескольких предикторов

3.7 Многократный прогноз на естественном языке

4. Абляции на синтетических данных и 4.1. Индукционная способность

4.2. Алгоритмические рассуждения

5. Почему это работает? Некоторые спекуляции и 5.1. Lookahead Укрепляет очки выбора

5.2. Информация теоретичный аргумент

6. Связанная работа

7. Заключение, Заявление о воздействии, воздействие на окружающую среду, подтверждения и ссылки

A. Дополнительные результаты по самопрокативному декодированию

Б. Альтернативные архитектуры

C. Скорость тренировок

D. МАГАЗИН

E. Дополнительные результаты по поведению масштабирования модели

F. Подробности о CodeContests Manetuning

G. Дополнительные результаты по сравнению с естественным языком

H. Дополнительные результаты по абстрактному текстовому суммированию

I. Дополнительные результаты по математическим рассуждениям на естественном языке

J. Дополнительные результаты по индукционному обучению

K. Дополнительные результаты по алгоритмическим рассуждениям

L. Дополнительные интуиции по многоцелевым прогнозам

М. Обучение гиперпараметры

5. Почему это работает? Некоторые предположения

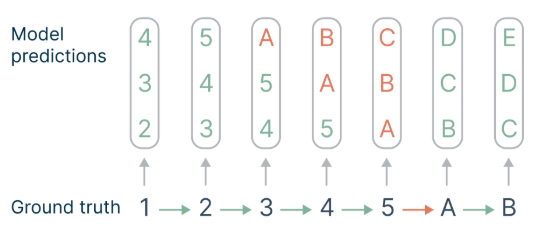

Почему Multi-Token прогнозирование обеспечивает превосходную производительность при оценке кодирования, а также о небольших алгоритмических задачах рассуждения? Наша интуиция, разработанная в этом разделе, состоит в том, что многоцелостное прогнозирование смягчает расхождение распределения между вынуждением преподавателя и авторегрессивным поколением времени обучения. Мы поддерживаем эту точку зрения иллюстративным аргументом о неявных весах, предсказание, предсказательно назначает токены в зависимости от их актуальности для продолжения текста, а также с теоретикой информационной теоретической разложения потерь прогнозирования с несколькими токками.

5.1. Lookahead Укрепляет очки выбора

Не все решения токенов одинаково важны для получения полезных текстов из языковых моделей (Bachmann and Nagarajan, 2024; Lin et al., 2024). В то время как некоторые токены допускают стилистические вариации, которые не ограничивают оставшуюся часть текста, другие представляют точки выбора, которые связаны с семантическими свойствами более высокого уровня текста, и может решить, воспринимается ли ответ как полезный или снятый.

Эта статья естьДоступно на ArxivПод CC по лицензии 4.0.

Авторы:

(1) Фабиан Глокл, ярмарка в Meta, Cermics Ecole des Ponts Paristech и внес свой вклад;

(2) Badr Youbi Idrissifair в Meta, Lisn Université Paris-Saclay и внес свой вклад;

(3) Baptiste Rozière, ярмарка в Meta;

(4) Дэвид Лопес-Паз, ярмарка в Мете и его последний автор;

(5) Габриэль Синнев, ярмарка в Meta и последний автор.

Оригинал