Опрос показывает, что большинство считают, что генеративный ИИ обладает сознанием, что может доказать, что он также способен вызывать у нас галлюцинации.

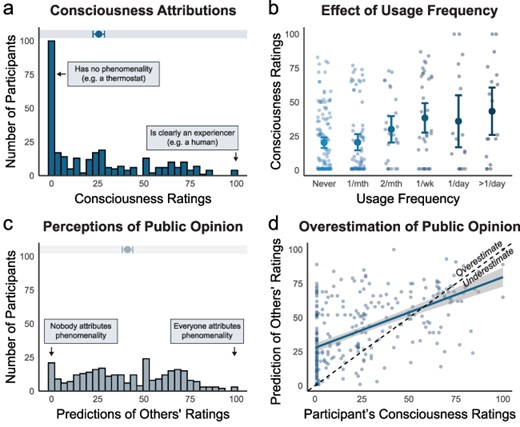

17 июля 2024 г.Когда вы взаимодействуете с ChatGPT и другими инструментами диалогового генеративного искусственного интеллекта, они обрабатывают ваш ввод с помощью алгоритмов, чтобы составить ответ, который может показаться, будто он исходит от другого разумного существа, несмотря на реальность того, как функционируют большие языковые модели (LLM). Две трети опрошенных для исследования из Университета Ватерлоо, тем не менее, считают, что чат-боты с искусственным интеллектом в той или иной форме обладают сознанием, пройдя тест Тьюринга, убеждающий их в том, что ИИ эквивалентен человеческому сознанию.

Генеративный ИИ, воплощенный в работе OpenAI над ChatGPT, в последние годы развивался семимильными шагами. Компания и ее конкуренты часто говорят о своем видении общего искусственного интеллекта (AGI) с интеллектом, подобным человеческому. У OpenAI даже есть под названием Клубника, который все еще отличается от ИИ, который знает, что он делает и почему.

«В то время как большинство экспертов отрицают, что современный ИИ может быть сознательным, наше исследование показывает, что для большинства широкой общественности сознание ИИ уже является реальностью», — пояснила профессор психологии Университета Ватерлоо и соруководитель исследования доктор Клара Коломбатто. «Эти результаты демонстрируют силу языка, поскольку один только разговор может заставить нас думать, что агент, который выглядит и действует совсем не так, как мы, может иметь разум».

Ненадлежащее обслуживание клиентов

Вера в сознание ИИ может иметь серьезные последствия для того, как люди взаимодействуют с инструментами ИИ. С положительной стороны, это поощряет хорошие манеры и позволяет легче доверять тому, что делают инструменты, что может облегчить их интеграцию в повседневную жизнь. Но доверие сопряжено с риском: от чрезмерной зависимости от них при принятии решений до, в крайнем случае, эмоциональной зависимости от ИИ и меньшего количества человеческих взаимодействий.

Исследователи планируют глубже изучить конкретные факторы, заставляющие людей думать, что у ИИ есть сознание, и что это означает на индивидуальном и общественном уровне. Это также будет включать долгосрочные взгляды на то, как эти взгляды меняются со временем и в зависимости от культурного фона. Понимание общественного восприятия сознания ИИ имеет решающее значение не только для разработки продуктов ИИ, но и для правил и положений, регулирующих их использование.

«Наряду с эмоциями, сознание связано с интеллектуальными способностями, которые необходимы для моральной ответственности: способность формулировать планы, действовать намеренно и обладать самоконтролем — это принципы нашей этической и правовой системы», — сказал Коломбатто. «Поэтому такое отношение общественности должно стать ключевым фактором при разработке и регулировании безопасного использования ИИ, наряду с консенсусом экспертов».

Вам также может понравиться

- OpenAI имеет новую шкалу для измерения того, насколько умными становятся их модели ИИ, что не так удобно, как должно быть

- Опрос показал, что большинство людей предпочли бы сменить компанию, чем иметь дело со службой поддержки клиентов с использованием ИИ

- OpenAI может работать над ИИ, который сможет проводить исследования без помощи человека – все должно пройти нормально

Оригинал