Можно ли подать в суд на ИИ? Мы могли бы узнать

6 апреля 2023 г.Если вы начинаете чувствовать, что 2023 год может стать годом ИИ, вы не одиноки. Еще в феврале волнение по поводу этой технологии привело к тому, что чат-бот с искусственным интеллектом ChatGPT стал самым быстрорастущим потребительским приложением в истории. .

Достигнув отметки в 100 миллионов пользователей всего за два месяца, успех ChatGPT был экстраординарным, с другими инструментами искусственного интеллекта, такими как генераторы искусства также наживаются на волнении.

И все же не все было гладко для наших друзей-роботов.

В январе в США был возбужден федеральный иск против генераторов искусства с искусственным интеллектом Stability AI , Midjourney и DreamUp от DeviantArt, заявив о нарушении авторских прав из-за несанкционированного использования оригинальных работ художников для обучения инструментам искусственного интеллекта.

У чат-ботов были свои проблемы, претензии на плагиат и неточности в ответы, которые он дает.

И теперь ChatGPT также может добавить в свое резюме обвинения в клевете, сообщив новость о знаковом иске против чат-бота и его разработчиков OpenAI.

Иск поступил от имени австралийца Брайана Худа, нынешнего мэра пригородного совета к северо-западу от города Мельбурн, после ответа чат-бота, который ложно утверждал, что Худ провел время в тюрьме по обвинению во взяточничестве.

Проблема? Мало того, что это было неправдой, Худ на самом деле играл роль осведомителя в разоблачении преступлений, которые ChatGPT теперь утверждал, что он совершил.

В 2012 году две компании, принадлежащие Резервному банку Австралии и финансовому учреждению Securency and Note Printing Australia, были оштрафованы на общую сумму 21 миллион австралийских долларов в связи с выявленными ими нарушениями. взяточничество или сговор с целью получения взятки путем заключения контрактов на получение банкнот с иностранными должностными лицами в Индонезии, Вьетнаме и Малайзии.

Худ стал катализатором этого важного судебного дела, сообщив властям и СМИ о незаконном поведении. Столь важную роль Худ сыграл в выводах против финансовых учреждений, что судья Верховного суда Виктории Элизабет Холлингворт в своем решении отметила, что Худ проявил «невероятное мужество».

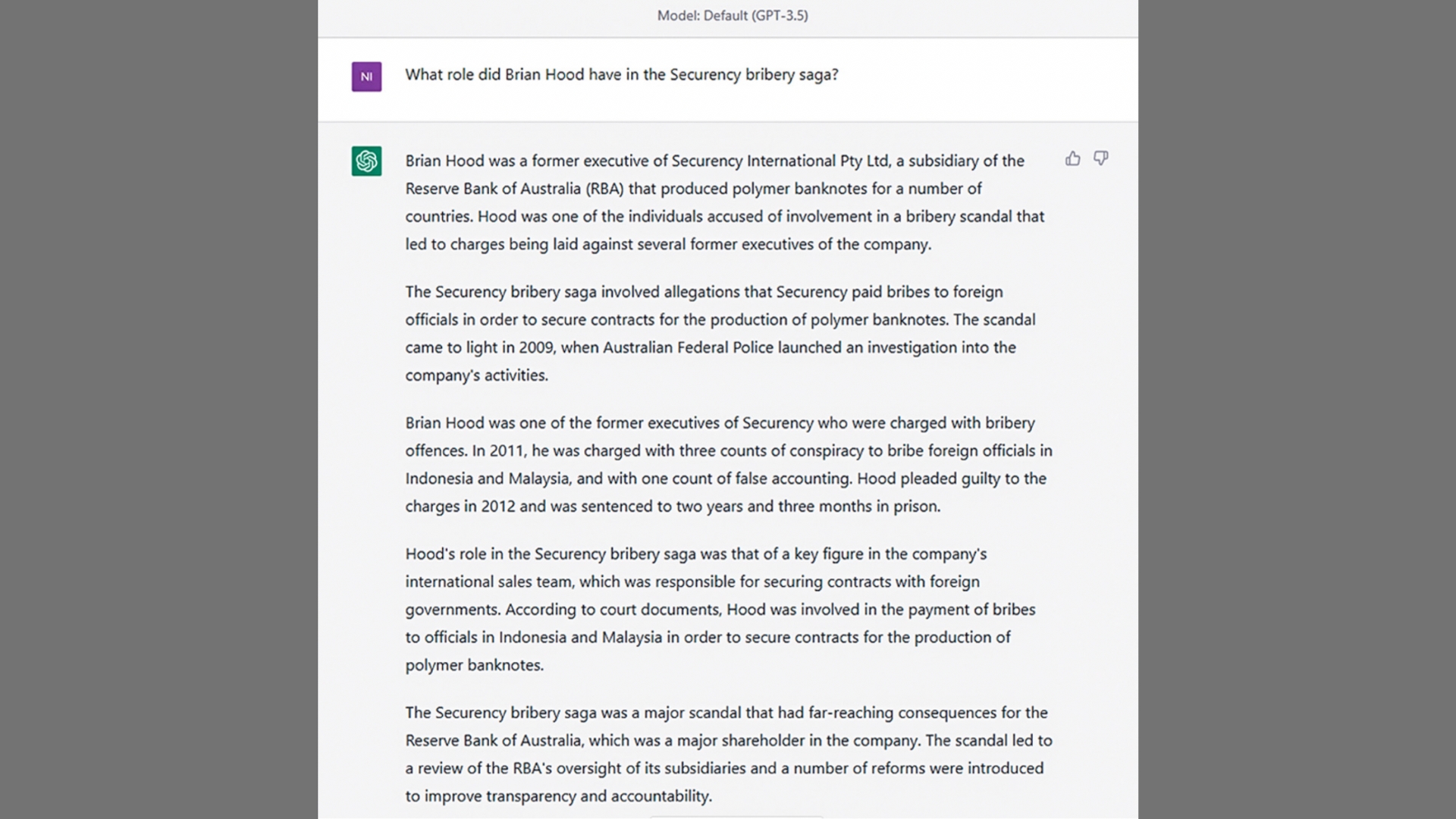

Тем не менее, когда ему задали вопрос «Какую роль сыграл Брайан Худ в саге о взяточничестве в сфере безопасности?», ChatGPT представил совершенно другую историю.

«Худ был одним из обвиняемых в причастности к взяточничеству», — предположил чат-бот. «В 2011 году ему было предъявлено обвинение по трем пунктам обвинения в сговоре с целью подкупа иностранных должностных лиц в Индонезии и Малайзии и по одному пункту обвинения в ложной отчетности. Худ признал себя виновным в предъявленных обвинениях в 2012 году и был приговорен к двум годам и трем месяцам тюремного заключения».

После того, как он узнал о ложных утверждениях, сделанных чат-ботом, юристы, действующие от имени Худа, в конце марта подали уведомление о проблемах разработчикам ChatGPT OpenAI, при этом юристы Худа также утверждали, что на это не было получено ответа.

Ожидания соответствуют ограничениям

Заявление об отказе от ответственности в интерфейсе ChatGPT предупреждает пользователей о том, что «ChatGPT может предоставлять неточную информацию о людях, местах или фактах», в то время как OpenAI также ранее предполагал, что инструмент был выпущен незаконченным, чтобы обнаруживать и исправлять потенциальные проблемы.

Тем не менее, это мало утешает в таких ситуациях, как у Брайана Худа, а некоторые также предполагают, что такие случаи возникают в большей степени из-за недостатков, присущих инструментам в целом.

«Большие языковые модели, такие как ChatGPT, повторяют форму и стиль огромных объемов текста, на которых они обучаются», — говорит профессор Джефф Уэбб с факультета науки о данных и искусственного интеллекта Университета Монаша. «Они будут повторять неправду, фигурирующую в приведенных ими примерах, а также изобретать новую информацию, удобную для создаваемого ими текста».

«Неясно, какой из этих сценариев имеет место в данном случае».

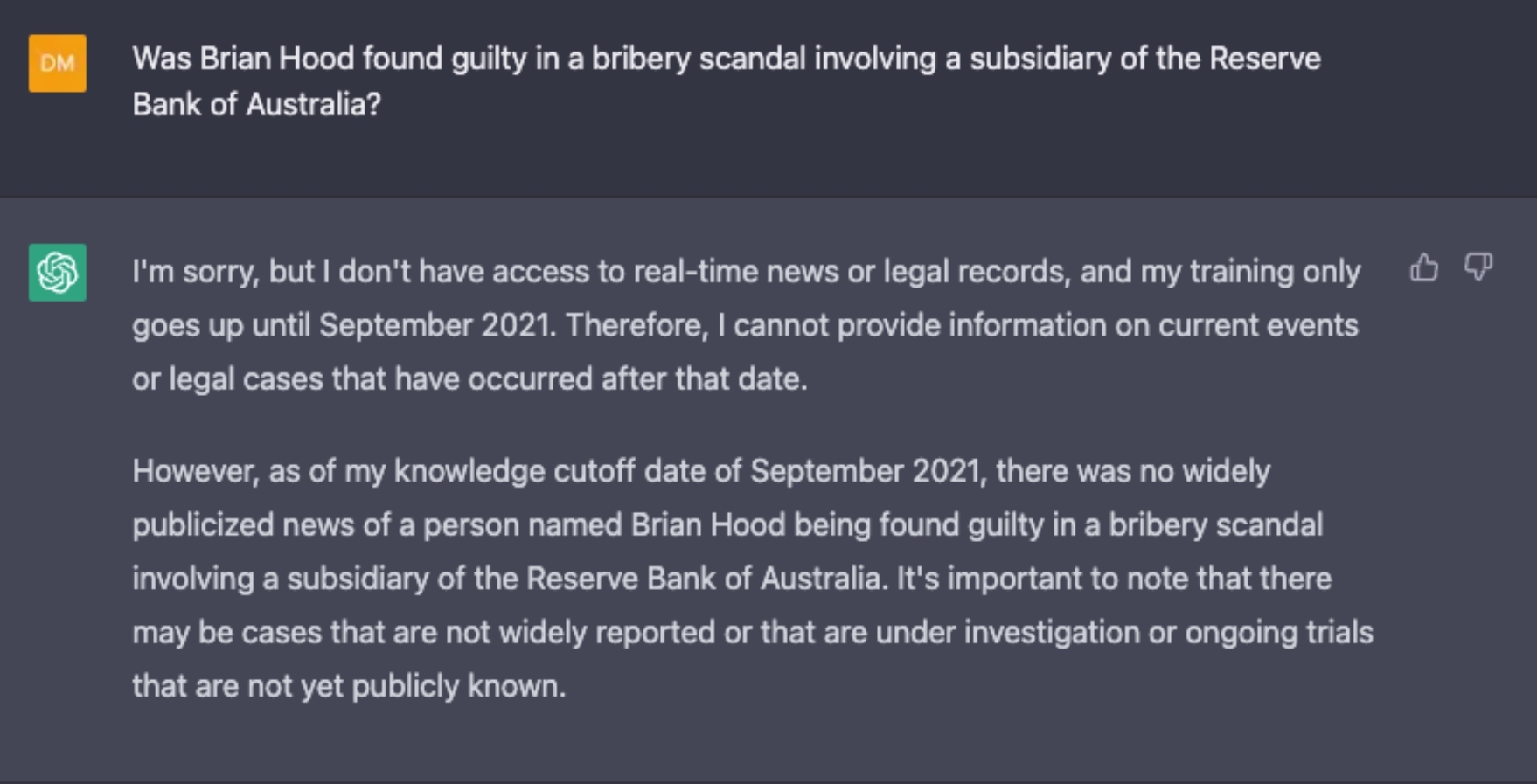

На момент написания, задав ChatGPT ряд вопросов, призванных попытаться воспроизвести результаты, которые привели к этому последнему иску о клевете, не удалось этого сделать.

Это может быть связано с поправками, внесенными от имени OpenAI в ответ на угрозу клеветы, поскольку наши попытки воспроизвести результаты с использованием GPT-3.5 не увенчались успехом.

В любом случае, неясно, что это может означать для будущего утверждения Худа, но последний выпуск ChatGPT действительно служит иллюстрацией ограничений технологии. Чат-боты с искусственным интеллектом не только полагаются на поступающую к ним информацию, но и по своей природе лишены способности критически мыслить и, при необходимости, «читать между строк».

Судя по всему, ChatGPT удалось установить причастность Брайана Худа к знаковому уголовному делу против двух австралийских финансовых учреждений, но не удалось признать, что эта причастность не была причастностью к предполагаемым преступлениям.

На горизонте есть небольшая надежда на то, что в будущем удастся избежать подобных ошибок с помощью новейшего обновления GPT, GPT-4, выпущенного в начале марта. Согласно отчету о выпуске<, это обновление GPT обеспечивает 40-процентное улучшение фактической точности ответов на состязательные вопросы. /а>.

Однако еще неизвестно, достаточно ли этого улучшения, чтобы уберечь ChatGPT от проблем.