Изучение альтернативных архитектур для прогнозирования Multi-Token LLM

21 июля 2025 г.Таблица ссылок

Аннотация и 1. Введение

2. Метод

3. Эксперименты по реальным данным

4. Абляции на синтетических данных

5. Почему это работает? Некоторые предположения

6. Связанная работа

7. Заключение, Заявление о воздействии, воздействие на окружающую среду, подтверждения и ссылки

A. Дополнительные результаты по самопрокативному декодированию

Б. Альтернативные архитектуры

C. Скорость тренировок

D. МАГАЗИН

E. Дополнительные результаты по поведению масштабирования модели

F. Подробности о CodeContests Manetuning

G. Дополнительные результаты по сравнению с естественным языком

H. Дополнительные результаты по абстрактному текстовому суммированию

I. Дополнительные результаты по математическим рассуждениям на естественном языке

J. Дополнительные результаты по индукционному обучению

K. Дополнительные результаты по алгоритмическим рассуждениям

L. Дополнительные интуиции по многоцелевым прогнозам

М. Обучение гиперпараметры

Б. Альтернативные архитектуры

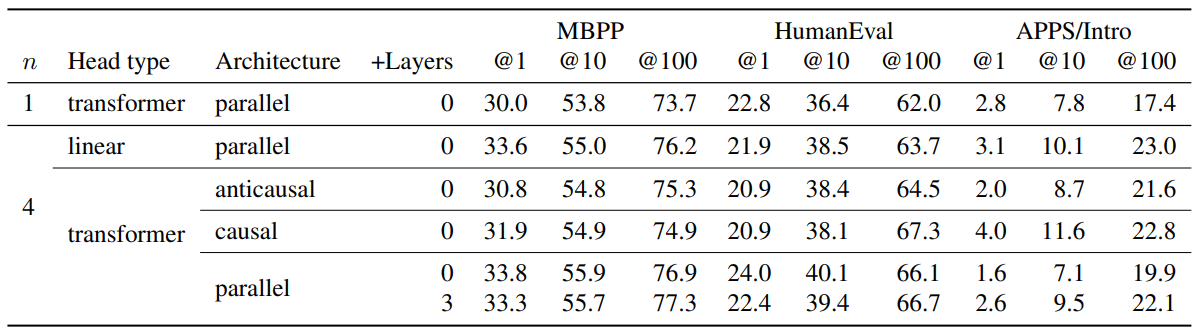

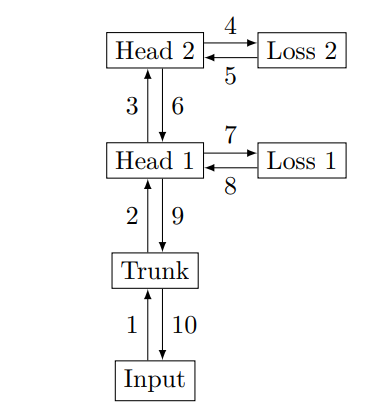

Архитектура, описанная в разделе 2, является не единственным разумным вариантом, но оказалась технически жизнеспособным и хорошо эффективным в наших экспериментах. Мы описываем и сравниваем альтернативные архитектуры в этом разделе.

Реплицированы безэмбедингаРепликация матрицы без вменения n-это простой метод реализации архитектур предсказания с несколькими точками. Тем не менее, это требуют матриц с формами (D, NV) в обозначениях раздела 2, что является непомерным для крупномасштабных тренингов.

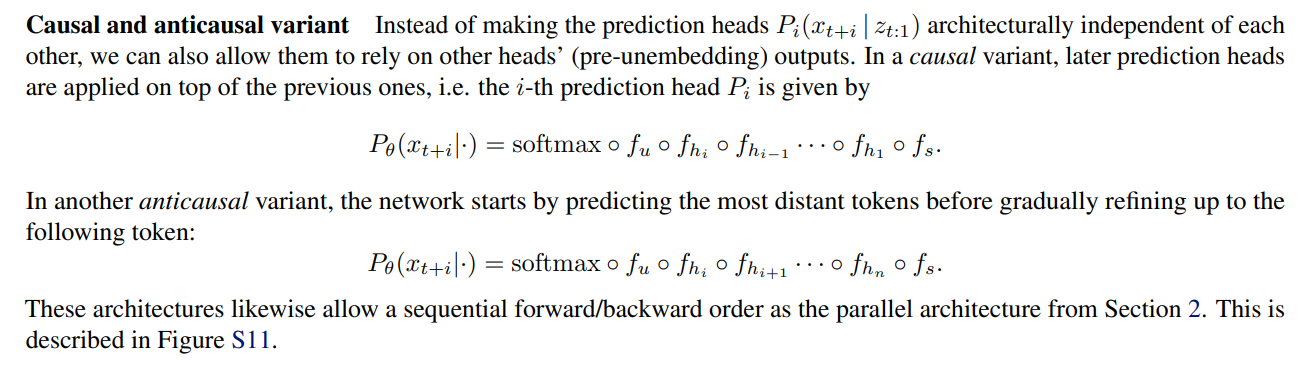

Линейные головыПомимо использования одного слоя трансформатора для голов Hя, другие архитектуры можно. Мы экспериментировали с одним линейным слоем без какой -либо нелинейности в качестве голов, что составляет линейное исследование остаточного представления модели Z. Архитектуры с более чем одним слоем на голову также возможны, но мы не продвигали это направление дальше.

Авторы:

(1) Фабиан Глокл, ярмарка в Meta, Cermics Ecole des Ponts Paristech и равный вклад;

(2) Badr Youbi Idrissi, Fair at Meta, Lisn Université Paris-Saclayand и равный вклад;

(3) Baptiste Rozière, ярмарка в Meta;

(4) Дэвид Лопес-Паз, ярмарка в Meta и последний автор;

(5) Габриэль Синнев, ярмарка в Meta и последний автор.

Эта статья есть

Оригинал