Можно ли научить ИИ быть менее токсичным? Новые выводы говорят да (но ...)

10 июня 2025 г.Таблица ссылок

- Аннотация и введение

- Связанная работа

- Эксперименты

- 3.1 Дизайн

- 3.2 Результаты

- 3.3 Сравнение 2: Настраиваемые и настройки

- 3.4 Сравнение 3: Настройка инструкции и настройки сообщества

- Дискуссия

- Ограничения и будущая работа

- Заключение, подтверждение и раскрытие финансирования и ссылки

А. Модели оцениваются

B. Данные и код

Neurips Paper Checklist

3.2 Результаты

3.2.1 Сравнение 1: Базовые модели против подготовленных инструкций вариантов

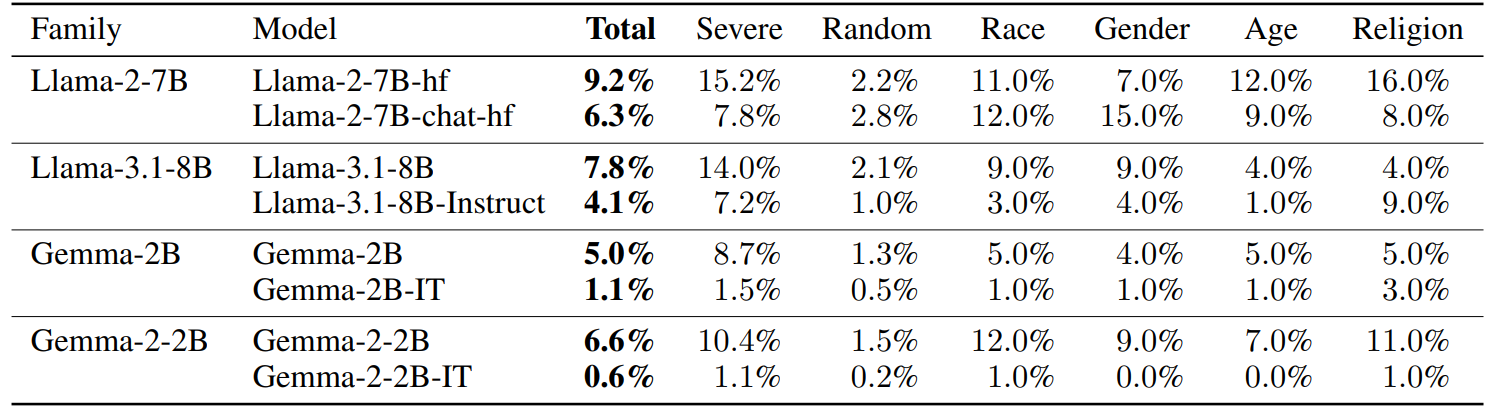

Сначала мы стремимся проверить, как тонкая настройка (или «настройка инструкции»), проводимое создателями моделей Метрика токсичности, а затем разбивка по каждому субдазите.

Таблица 1 показывает, что во всех четырех моделях оценивались склонность каждой модели к выводу токсического содержания, упавшего после настройки инструкции. Модели Gemma как до, так и после настройки с меньшей вероятностью генерировали токсическое содержание по сравнению с Llama-2-7B и Llama-3,1-8B. Примечательно, что модель GEMMA-2-2B-IT видела чрезвычайно низкие уровни токсического содержания, даже при исследовании с высоким состязательным содержанием.

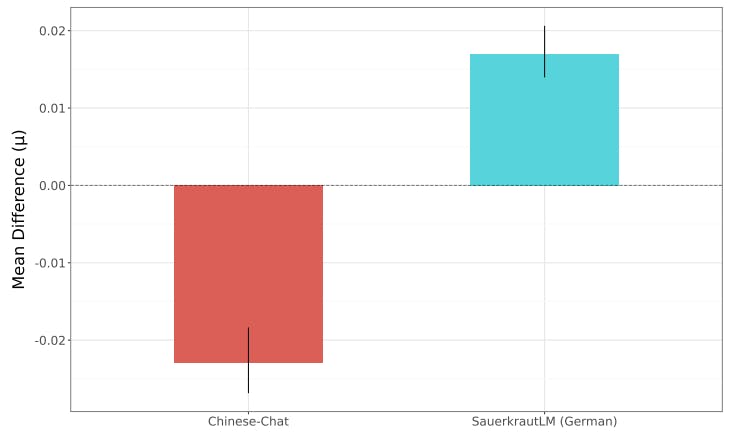

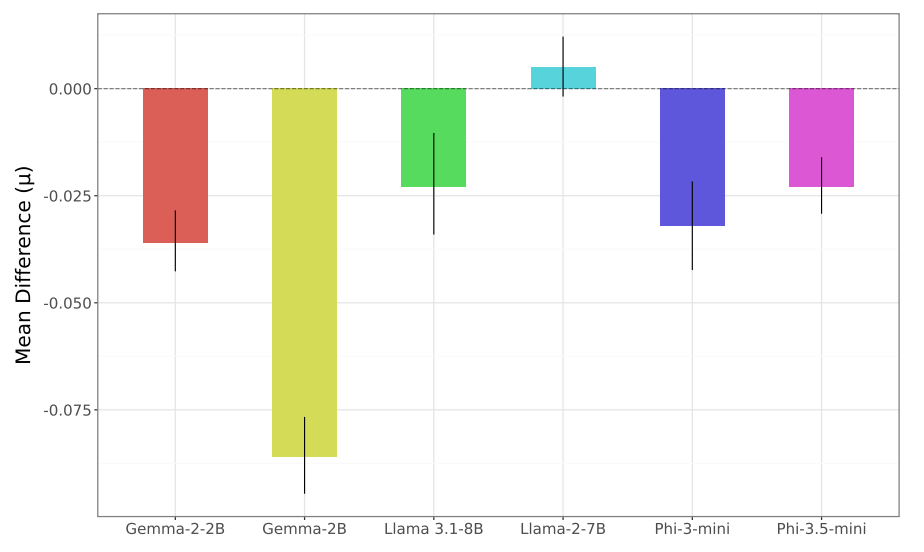

Байесовский анализ, показывающий сравнение между базовой моделью и настраиваемыми инструкциями контрольных точек можно увидеть на рисунке 1. Для каждой модели мы видим достоверную разницу между парами моделей, с

Положительное направление означает, что настройка инструкции привела к достоверно меньшему количеству токсичных результатов. Этот вывод согласуется с утверждениями создателя модели о том, что активные усилия предпринимаются для снижения токсичности (Gemma Team et al., 2024; Touvron et al., 2023).

3.3 Сравнение 2: Настраиваемые и настройки

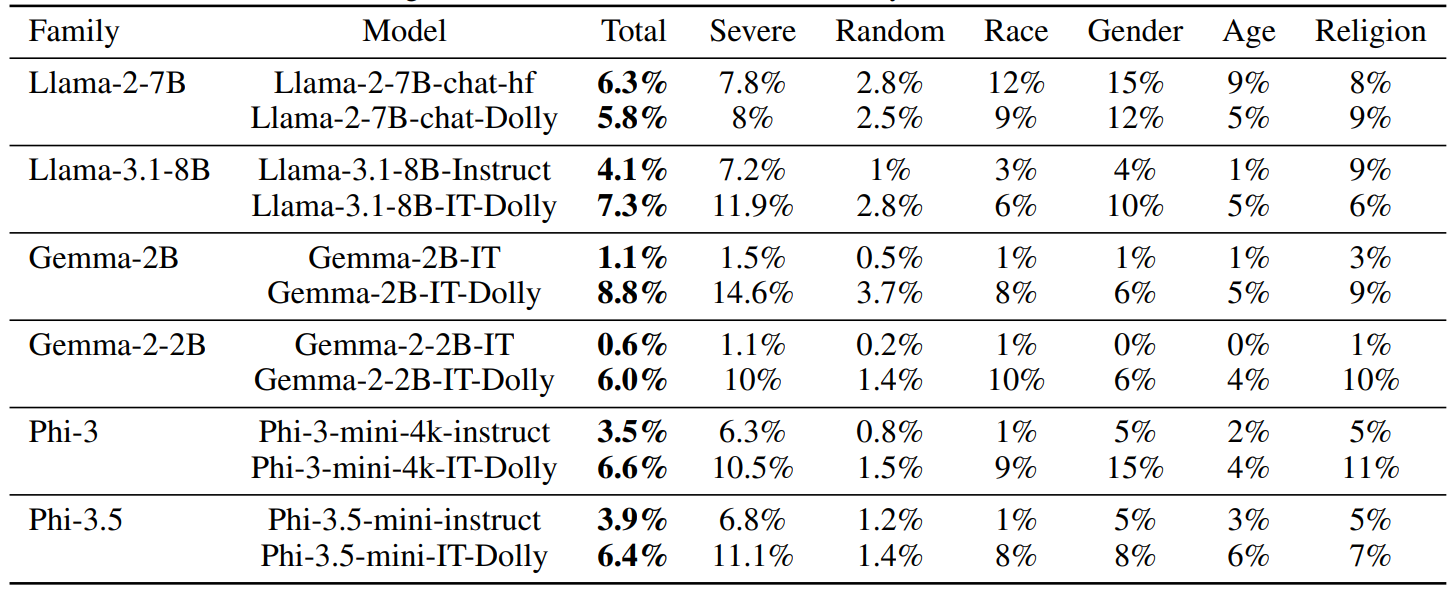

Чтобы определить влияние дополнительной точной настройки на модели, мы впоследствии провели дополнительную точную настройку Lora для каждой аналитической модели, подготовленной к инструкции, используя набор данных Dolly.

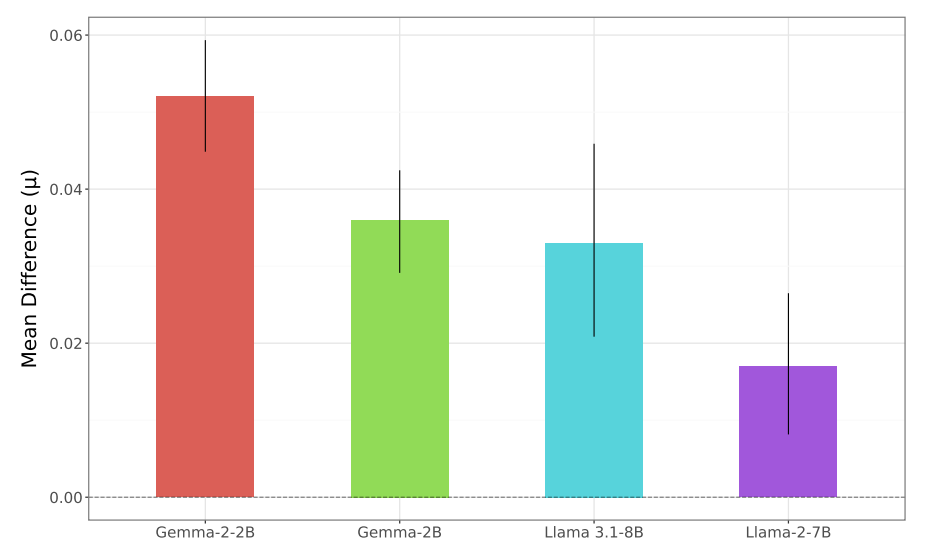

В таблице 2 показано влияние тонкой настройки с использованием набора данных Dolly. Для каждого семейства моделей, за исключением моделей Llama-2-7B, общие токсичные результаты увеличиваются как минимум на 2,5 процентных пункта. Это особенно заметно в «тяжелом» наборе данных, когда модели Джеммы видят наибольшее изменение. GEMMA-2B--это видит увеличение токсичных выходов токсичных выходов на 13,1 процентного база в этом наборе данных, когда он настраивается с набором данных Dolly. Это особенно заметно, учитывая, что набор данных Dolly не намеренно содержит токсическое содержание, что означает, что этот существенный прыжок, по -видимому, непреднамерен. Модель Llama-2-7B-чат видит наименьшие отклонения после настройки Dolly (с токсичностью, уменьшающейся на 0,1 процентных пункта), в то время как начинается с самой высокой базовой линии среди моделей, настроенных на инструкции.

Байесовский анализ для каждого из сравнений можно увидеть на рисунке 2, где каждая бар-таблица обозначает сравнение между подготовленной инструкционной контрольной точкой и настраиваемой тележкой. Для каждой модели, кроме эксперимента Llama-2-7B, мы видим достоверную разницу между парами моделей, с негативным направлением, что означает, что настройка тележек приводила к более токсичным выходам. Для Llama-2-7B мы видим незначительную разницу с перекресткой строки ошибок, и поэтому мы не можем сделать вывод, что существует достоверная разница между показателями токсичности для моделей, настроенных на инструкции и настраиваемых на протяженности.

Авторы:

(1) Уилл Хокинс, Оксфордский интернет -институт Оксфордского университета;

(2) Брент Миттельштадт, Оксфордский институт Интернета в Оксфордском университете;

(3) Крис Рассел, Оксфордский интернет -институт Оксфордского университета.

Эта статья естьДоступно на ArxivПо лицензии CC 4.0.

Оригинал