ИИ против ИИ: следующий фронт фишинговых войн

17 июня 2023 г.Компрометации корпоративной электронной почты, которые в прошлом году вытеснили программы-вымогатели и стали основным источником финансовых угроз для организаций, скорее всего, станет труднее отслеживать. Новые расследования, проведенные Abnormal Security, показывают, что злоумышленники используют генеративный ИИ для создания фишинговых электронных писем, включая атаки с имитацией поставщика, подобные тем, которые Abnormal отметил ранее в этом году актером по прозвищу Firebrick Ostricth.

Согласно Abnormal, с помощью ChatGPT и других крупных языковых моделей злоумышленники могут создавать сообщения социальной инженерии, которые не украшены такими красными флажками, как проблемы с форматированием, нетипичный синтаксис, неправильная грамматика, пунктуация, орфография и адреса электронной почты.

По словам Дэна Шиблера, руководителя отдела машинного обучения в Abnormal, фирма использовала свои собственные модели искусственного интеллекта, чтобы определить, что определенные электронные письма, отправленные ее клиентам, позже идентифицированные как фишинговые атаки, вероятно, были сгенерированы искусственным интеллектом. «Хотя мы все еще проводим полный анализ, чтобы понять масштабы атак по электронной почте, сгенерированных ИИ, в Abnormal наблюдается определенное увеличение количества атак с индикаторами ИИ в процентах от всех атак, особенно за последние несколько недель», — сказал он. сказал.

Перейти к:

- Использование фальшивых нарушений Facebook в качестве приманки

Похоже на фиш, но может быть дельфином

Компрометация поставщика с помощью ИИ, мошенничество с счетами

Нужно знать одного: использование ИИ для поимки ИИ

Как бороться с фишинговыми атаками ИИ

Использование фальшивых нарушений Facebook в качестве приманки

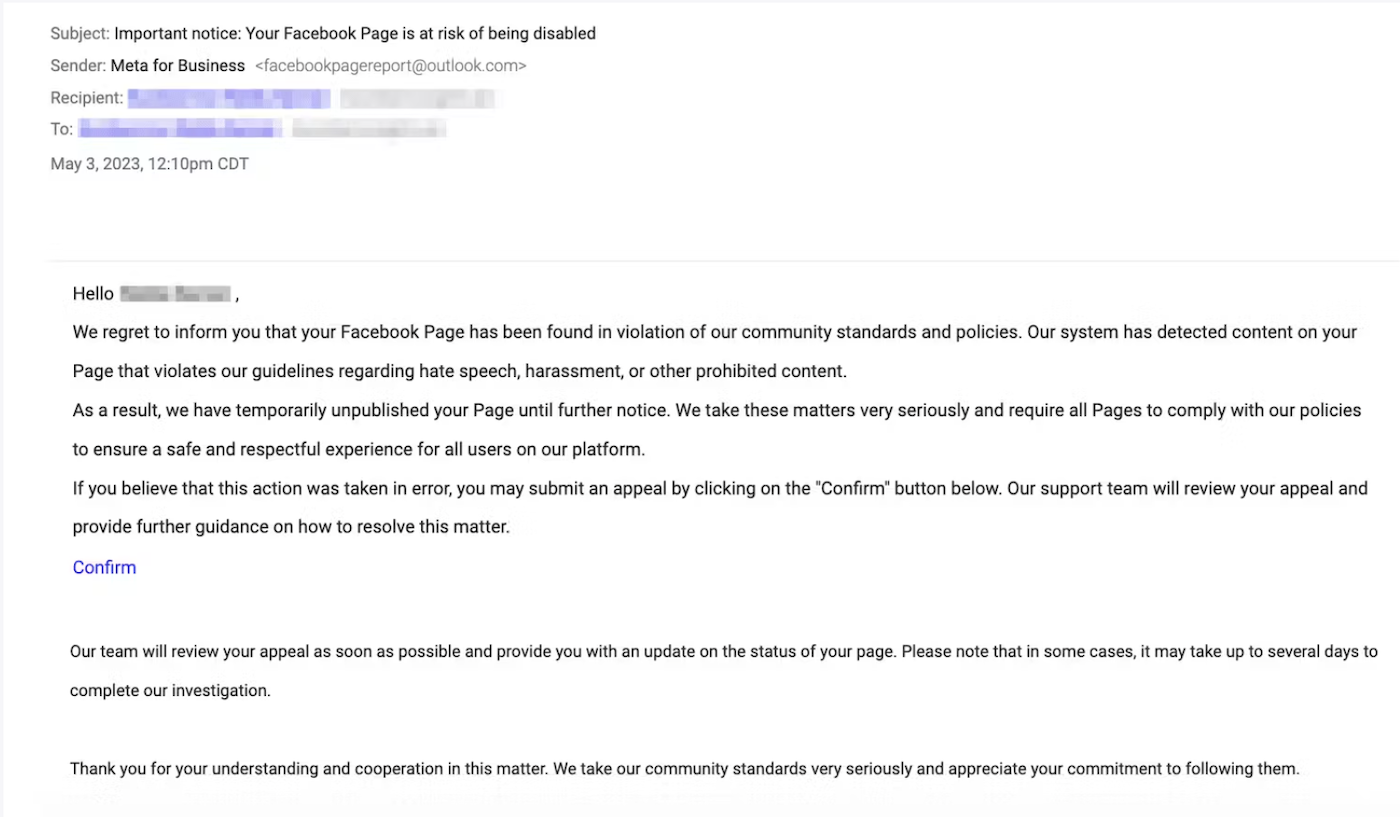

Новая тактика, отмеченная Abnormal, включает подделку официальных уведомлений Facebook, информирующих цель о том, что они «нарушают стандарты сообщества» и что их страница не опубликована. Затем пользователя просят щелкнуть ссылку и подать апелляцию, которая ведет на фишинговую страницу для сбора учетных данных пользователя, предоставляя злоумышленникам доступ к целевой странице Facebook или для продажи в даркнете (рис. A).

Рисунок А

Шиблер сказал, что тот факт, что текст в подделках Facebook почти идентичен языку, ожидаемому от Meta for Business, предполагает, что менее опытные злоумышленники смогут легко избежать обычных ловушек фишинга.

«Опасность генеративного ИИ в атаках по электронной почте заключается в том, что он позволяет злоумышленникам писать все более изощренный контент, повышая вероятность того, что их цель будет обманута, чтобы щелкнуть ссылку или следовать их инструкциям», — сказал он, добавив, что ИИ также может быть используется для создания большей персонализации.

«Представьте, что злоумышленники должны были бы вводить фрагменты истории электронной почты своей жертвы или содержимого профиля LinkedIn в свои запросы ChatGPT. Электронные письма начнут показывать типичный контекст, язык и тон, которых ожидает жертва, что сделает электронные письма BEC еще более обманчивыми», — сказал он.

Похоже на фиш, но может быть дельфином

Согласно Abnormal, еще одна сложность в обнаружении фишинговых эксплойтов, использующих ИИ для создания электронных писем, связана с ложными срабатываниями. Поскольку многие законные электронные письма создаются из шаблонов с использованием общих фраз, они могут быть помечены ИИ из-за их сходства с тем, что также будет генерировать модель ИИ, отметил Шиблер, который сказал, что анализ дает некоторое указание на то, что электронное письмо могло быть создано ИИ. «И мы используем этот сигнал (среди тысяч других) для определения злого умысла».

Компрометация поставщика с помощью ИИ, мошенничество с счетами

Найдены ненормальные случаи компрометации деловой электронной почты, созданные генеративным искусственным интеллектом для выдачи себя за поставщиков, содержащие счета с запросами оплаты на нелегитимный платежный портал.

В одном случае, отмеченном Abnormal, злоумышленники выдавали себя за учетную запись сотрудника в целевой компании и использовали ее для отправки поддельного электронного письма в отдел расчета заработной платы, чтобы обновить информацию о прямом депозите в файле.

Шиблер отметил, что, в отличие от традиционных атак BEC, группы BEC, созданные ИИ, написаны профессионально. «Они написаны с чувством формальности, которую можно было бы ожидать в деловых вопросах», — сказал он. «Адвокат, выдаваемый за другого, тоже из реальной юридической фирмы — деталь, которая придает письму еще большее ощущение легитимности и повышает вероятность того, что оно обманет свою жертву», — добавил он.

Нужно знать одного: использование ИИ для поимки ИИ

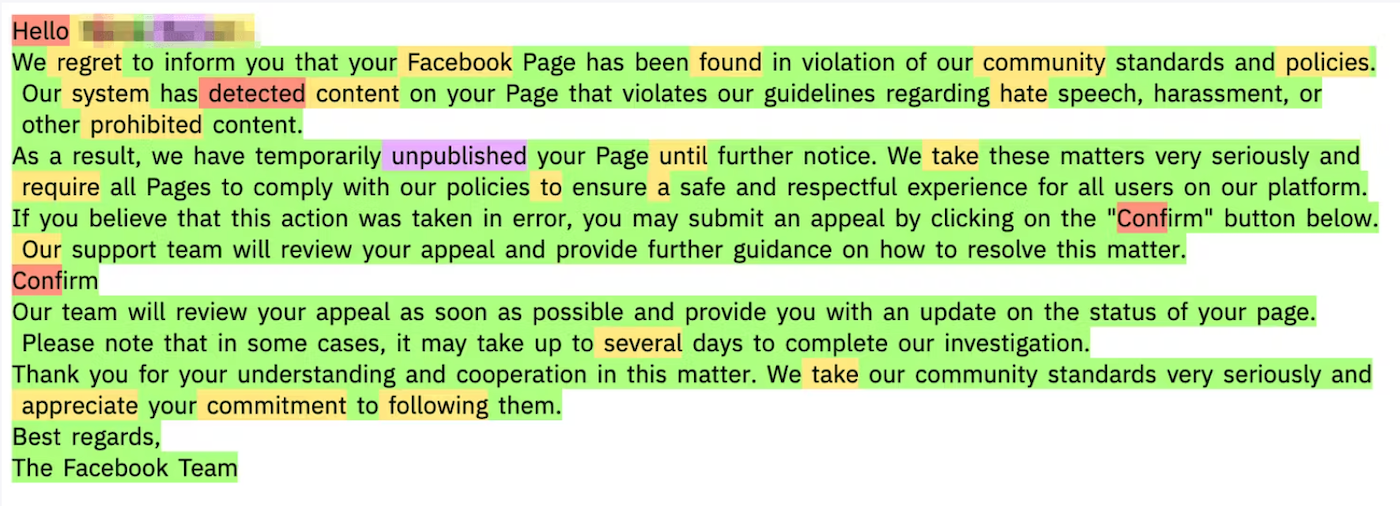

Шиблер сказал, что обнаружение авторства ИИ включает в себя зеркальную операцию: прогон текстов электронной почты, сгенерированных LLM, через механизм прогнозирования ИИ, чтобы проанализировать вероятность того, что система ИИ выберет каждое слово в электронном письме.

Abnormal использовала большие языковые модели с открытым исходным кодом для анализа вероятности того, что каждое слово в электронном письме может быть предсказано с учетом контекста слева от слова. «Если слова в электронном письме имеют постоянно высокую вероятность (это означает, что каждый термин в большей степени соответствует тому, что сказала бы модель ИИ, чем человеческий текст), то мы классифицируем электронное письмо как возможно написанное ИИ», — сказал он. (Рисунок Б).

Рисунок Б

Шиблер предупредил, что, поскольку существует множество законных случаев использования ИИ для создания контента электронной почты, нецелесообразно блокировать все электронные письма, созданные ИИ, по подозрению в злом умысле. «Поэтому тот факт, что электронное письмо имеет индикаторы ИИ, должен использоваться наряду со многими другими сигналами для указания на злонамеренные намерения», — сказал он, добавив, что фирма проводит дополнительную проверку с помощью таких инструментов обнаружения ИИ, как OpenAI Detector и GPTZero.

«Легитимные электронные письма могут выглядеть сгенерированными искусственным интеллектом, такими как шаблонные сообщения и машинные переводы, что затрудняет перехват легитимных электронных писем, созданных искусственным интеллектом. Когда наша система решает, следует ли заблокировать электронное письмо, она включает в себя много информации, помимо того, мог ли ИИ сгенерировать электронное письмо, используя личность, поведение и связанные индикаторы».

Как бороться с фишинговыми атаками ИИ

В отчете Abnormal организациям предлагается внедрять решения на основе ИИ, которые могут обнаруживать очень сложные атаки, сгенерированные ИИ, которые почти невозможно отличить от законных электронных писем. Они также должны видеть, когда электронное письмо, сгенерированное ИИ, является законным, а когда оно имеет злонамеренный характер.

«Думайте об этом, как о хорошем ИИ для борьбы с плохим ИИ», — говорится в отчете. Фирма заявила, что лучшие инструменты на основе ИИ способны определять нормальное поведение в среде электронной почты, включая типичные пользовательские шаблоны общения, стили и отношения, а не просто искать типичные (и многообразные) индикаторы компрометации. Благодаря этому они могут обнаруживать аномалии, которые могут указывать на потенциальную атаку, независимо от того, были ли аномалии созданы человеком или искусственным интеллектом.

«Организации также должны соблюдать правила гигиены кибербезопасности, в том числе проводить постоянные тренинги по вопросам безопасности, чтобы сотрудники были бдительны в отношении рисков BEC», — сказал Шейблер. «Кроме того, внедрение таких тактик, как управление паролями и многофакторная аутентификация, гарантирует, что организация сможет ограничить дальнейший ущерб в случае успеха любой атаки».

Оригинал